หากคุณกำลังตัดสินใจ H100 vs RTX 4090 สำหรับ AI ควรจำไว้ว่า "benchmark" ส่วนใหญ่ไม่มีความหมาย จนกว่าโมเดลและ cache ของคุณจะพอดีกับ VRAM จริงๆ RTX 4090 เหมาะที่สุดสำหรับงาน single-GPU ที่อยู่ภายใน 24 GB

H100 คือตัวเลือกที่ควรหันมาใช้เมื่อต้องการโมเดลขนาดใหญ่ขึ้น รองรับผู้ใช้พร้อมกันมากขึ้น แยก isolation ระหว่างผู้ใช้ หรือลดเวลาที่เสียไปกับการจัดการหน่วยความจำ

ผมจะแยกตามประเภทงาน อธิบาย benchmark แต่ละแบบ แล้วให้แผนทดสอบแบบเร็วที่คุณรันบน stack ของตัวเองได้เลย

คำตอบสั้นๆ: H100 vs RTX 4090 สำหรับงาน AI

H100 ชนะสำหรับการ training โมเดลขนาดใหญ่และการ serve จริงจัง เพราะมี HBM pool ขนาดใหญ่, memory bandwidth สูงมาก, NVLink และ MIG สำหรับ isolation RTX 4090 เหมาะกว่าสำหรับคนที่ต้องการ "ความเร็ว single-GPU ที่ดีในราคาที่สมเหตุสมผล" ตราบใดที่งานของคุณพอดีกับ 24 GB โดยไม่ต้องประนีประนอมตลอดเวลา สเปกและฟีเจอร์ของแพลตฟอร์มทำให้เรื่องนี้ตัดสินใจได้ไม่ยาก

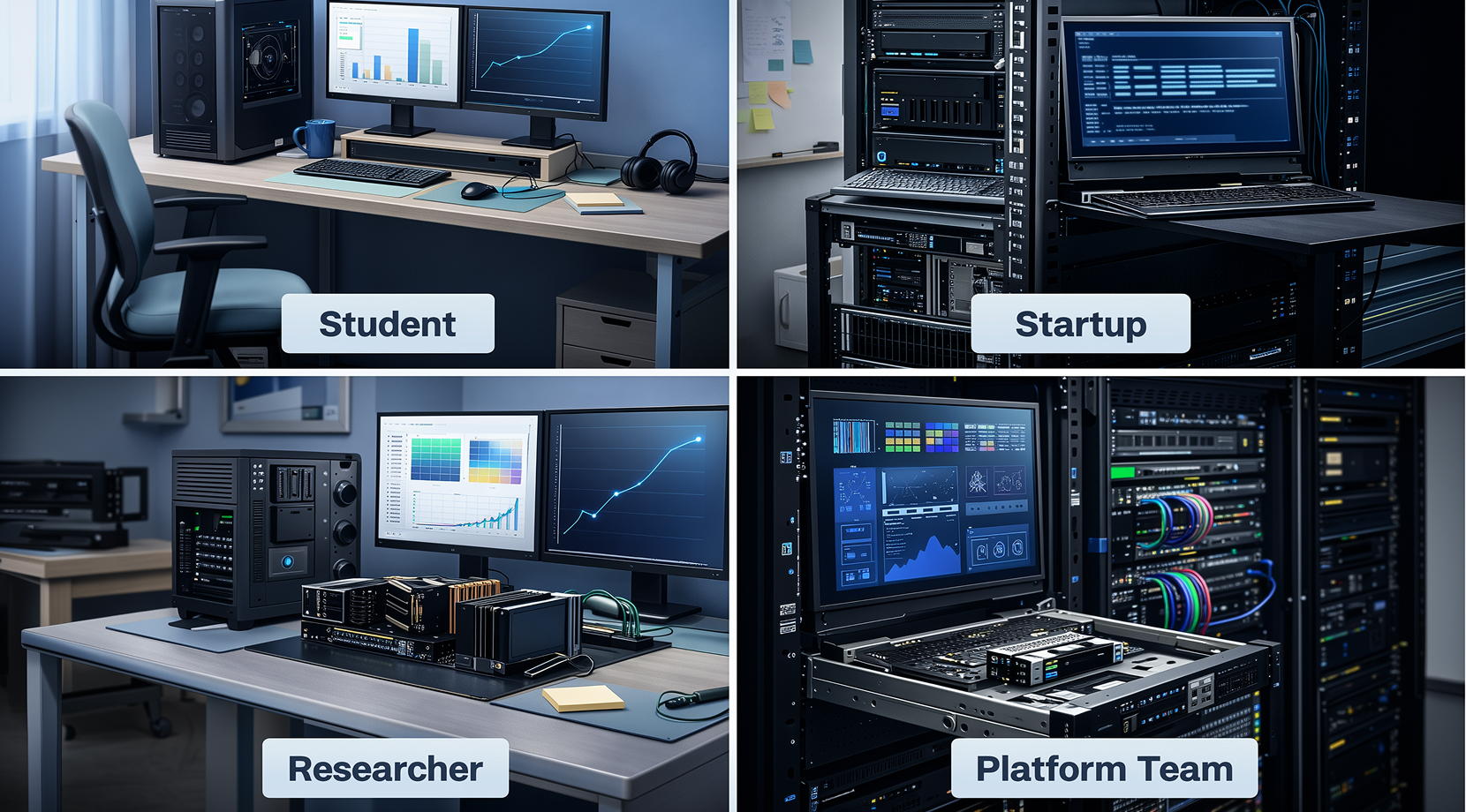

เลือกตามประเภทผู้ใช้ได้เลย:

- นักพัฒนาอิสระ / นักศึกษาที่สร้าง LLM: ใช้ RTX 4090 จนกว่า VRAM จะเป็นคอขวด

- ML Engineer ของ Startup (กำลัง deploy MVP): RTX 4090 สำหรับช่วงแรกของการ serve และ fine-tuning, เปลี่ยนเป็น H100 เมื่อต้องการ concurrency ที่เสถียรขึ้นหรือโมเดลที่ใหญ่ขึ้น

- นักวิจัยประยุกต์ (ทดลองจำนวนมาก): H100 หากคุณเจอปัญหา OOM, batch caps, หรือ context ที่ยาวมาก

- ทีม Production / Platform (Multi-Tenant Serving): H100 สำหรับ MIG slicing, headroom ที่มากขึ้น, และการ scaling ที่เสถียรกว่า

ด้วยกรอบความคิดนี้ บทความนี้จะพูดถึงข้อจำกัดที่นักพัฒนาเจอในการใช้งานจริง และตัวเลข benchmark สะท้อนข้อจำกัดเหล่านั้นอย่างไร

คำถามเดียวที่ต้องตอบให้ได้จาก Benchmark: อะไรต้องพอดีกับ VRAM?

กระทู้ส่วนใหญ่เกี่ยวกับ H100 vs RTX 4090 จริงๆ แล้วเป็นการถกเรื่อง VRAM ทั้งนั้น ในงาน LLM นั้น VRAM ถูกใช้ไปกับ น้ำหนัก, การเปิดใช้งาน ระหว่างการฝึกอบรม, สถานะของตัวปรับแต่ง ในขั้นตอน training และกับ แคช KV ในขั้นตอน inference ส่วนสุดท้ายนั้นมักเป็นสิ่งที่คนไม่ได้คาดไว้ เพราะมันขยายตามความยาว context และจำนวน concurrency

ตารางด้านล่างเป็นภาพรวมโดยเจตนา เพราะการพอดีจริงๆ ขึ้นอยู่กับ framework, precision, และ overhead

มุมมองแบบ "ใส่ได้โดยไม่มีปัญหา" มีดังนี้:

| ปริมาณงาน | ความเป็นจริงของการใช้ GPU เดี่ยวบน RTX 4090 (24 GB) | ความเป็นจริงของการใช้ GPU เดี่ยวบน H100 (80–94 GB) |

| การอนุมาน LLM ขนาด 7B (FP16 / BF16) | ปกติแล้วก็ใช้ได้ | พื้นที่ว่างที่สะดวกสบาย |

| การอนุมาน LLM 13B | มักจะตึง ขึ้นอยู่กับ context | ปกติแล้วก็ใช้ได้ |

| การอนุมานของคลาส 70B | ต้องใช้ quant/offload แบบหนัก | รองรับได้สบายกว่ามาก |

| SD/SDXL inference + small batch การอนุมาน SD/SDXL พร้อมชุดเล็ก | ปกติแล้วก็ใช้ได้ | รองรับได้ปกติ และมี batch headroom เพิ่มขึ้น |

| Serving ที่รองรับ concurrency สูงขึ้น | KV cache เริ่มกดดันได้เร็ว | มีพื้นที่มากกว่า และเสถียรกว่าภายใต้โหลด |

หากต้องการรายชื่อ GPU ที่หลากหลายกว่านี้ (ไม่ใช่แค่สองรุ่นนี้) บทความรวมของเราเกี่ยวกับ GPU ที่ดีที่สุดสำหรับ Machine Learning ในปี 2025 เป็นตารางอ้างอิงที่มีประโยชน์สำหรับ VRAM และ memory bandwidth ของ AI GPU รุ่นที่ใช้งานทั่วไป

เมื่อรู้แล้วว่า workload ของคุณพอดี สิ่งต่อไปที่กำหนดว่ามันจะ "ลื่น" แค่ไหนคือ memory bandwidth

Bandwidth: ทำไม HBM ถึงให้ความรู้สึกที่แตกต่าง

การพูดถึงประสิทธิภาพ AI ส่วนใหญ่มักวนเวียนอยู่กับจุดสูงสุดของ compute แต่ transformer นั้นไวต่อการเคลื่อนย้ายข้อมูลในหน่วยความจำมาก จุดเด่นของ H100 คือการจับคู่ HBM pool ขนาดใหญ่เข้ากับ memory bandwidth สูง บวกกับ NVLink bandwidth และการแบ่ง MIG partition ในระดับ platform

ข้อมูลคุณลักษณะโดยย่อ

Specs ไม่ได้บอกว่าคุณควรเลือก GPU หรือเปล่า แต่มันอธิบายได้ว่าทำไม workload เดียวกันถึงรู้สึกสบายบนการ์ดใบหนึ่ง แต่อึดอัดบนอีกใบ ข้อมูลนี้แสดงให้เห็นว่าอะไรส่งผลต่อพฤติกรรมการ training, inference และ serving ของ LLM มากที่สุด

| ข้อกำหนด | H100 (SXM / NVL) | RTX 4090 |

| VRAM | 80 GB / 94 GB | 24 GB |

| ความกว้างแบนด์วิดท์หน่วยความจำ | 3.35–3.9 TB/s | GDDR6X (จำกัดความจุที่ 24 GB) |

| การเชื่อมต่อระหว่างกัน | NVLink + PCIe Gen5 | PCIe (แพลตฟอร์มผู้บริโภค) |

| มัลติ-อินสแตนซ์ | Up to 7 MIG instances จำนวนมากถึง 7 MIG instances | ไม่พร้อมใช้งาน |

ข้อมูลอ้างอิงสเปค NVIDIA H100, NVIDIA RTX 4090.

ในทางปฏิบัติหมายความว่า:

- ถ้าคุณต้องการเพิ่ม batch size หรือความยาว context H100 มักจะยังคงเสถียรได้นานกว่าก่อนที่คุณจะต้องเริ่มยอมแลก

- ถ้าคุณรับ request หลายรายการพร้อมกัน H100 มี "พื้นที่หายใจ" ด้านหน่วยความจำมากกว่า ทำให้ tail latency ไม่พุ่งเร็วนัก

- ถ้างานของคุณเป็นแบบผู้ใช้คนเดียว โมเดลเดียว และ context ไม่ใหญ่มาก 4090 มักให้ความรู้สึกเร็วและตอบโจทย์ได้ดี

อย่างไรก็ตาม bandwidth ไม่ได้แทนที่การ benchmark ที่ดีได้ มันแค่อธิบายว่าทำไม GPU สองใบถึงดูใกล้เคียงกันในการทดสอบแบบแคบ แต่ห่างกันชัดเจนเมื่อรับ load จริง

Benchmark เปรียบเทียบ H100 กับ RTX 4090 ที่เชื่อถือได้

Benchmark ไม่ได้เหมือนกันทุกตัว นั่นคือเหตุผลที่ "ตัวเลขของฉันไม่ตรงกับของคุณ" เกิดขึ้นบ่อยมาก สำหรับ H100 vs RTX 4090การแยก benchmark ออกเป็นสองแนวทางจะช่วยได้:

- แนวทาง A (community-driven): llama.cpp-style tokens/sec tests and simple inference scripts.

- แนวทาง B (standardized suites): ผลลัพธ์แบบ MLPerf Training และ MLPerf Inference ที่เน้นกฎที่ทำซ้ำได้

Snapshot การ Inference แบบ Llama.cpp

นี่คือการทดสอบแบบที่คนรันกันเองที่บ้านแล้วถกเถียงกันอยู่สามวัน มันมีประโยชน์เพราะสะท้อน toolchain จริงที่นักพัฒนาหลายคนใช้ แต่ก็อ่านผิดได้ง่ายถ้าไม่ดูเรื่อง fit และ precision

การเปรียบเทียบแบบ llama.cpp แบบ public แสดงให้เห็นว่า RTX 4090 ทำได้ดีมากกับโมเดลขนาดเล็กและการรัน quantized ขณะที่โมเดลขนาดใหญ่ที่ความแม่นยำสูงก็ชนเพดาน VRAM อย่างชัดเจน

รูปแบบที่คุณควรคาดหวัง:

| รุ่น | GPU | ผลลัพธ์ทั่วไป |

| ชั้น 7B | RTX 4090 | Tokens/sec สูง, inference ผู้ใช้คนเดียวลื่นไหล |

| ชั้น 13B | RTX 4090 | ยังทำได้ดี แต่เริ่มต้องคำนึงถึง context และ overhead |

| หมวดหมู่ 70B | RTX 4090 | ไม่พอดีโดยไม่ต้องใช้ quant/offload อย่างจริงจัง |

| หมวดหมู่ 70B | H100 | เก็บไว้ใน memory และ serve ได้เสถียรกว่ามาก |

จุดประสงค์ของตารางนี้ไม่ใช่ '4090 แย่' หรือ 'H100 วิเศษ' แต่คือเพดาน VRAM เป็นตัวกำหนดว่าคุณจะเก็บข้อมูลไว้ใน memory ได้แค่ไหน และนั่นส่งผลต่อความเร็ว ความเสถียร และปริมาณการปรับแต่งที่คุณต้องทำ

ถ้าคุณต้องตัด context length ทิ้งอยู่ตลอดเวลาแค่เพื่อให้รันผ่าน นั่นแหละคือจุดที่การเปรียบเทียบนี้ไม่ใช่เรื่องสมมติอีกต่อไป

MLPerf เพิ่มอะไรที่ benchmark จากฟอรัมทั่วไปไม่มี

MLPerf มีขึ้นเพราะ "สคริปต์สุ่มและความรู้สึก" ใช้ไม่ได้เมื่อคุณกำลังตัดสินใจใช้เงินหลายพันดอลลาร์ MLCommons ได้เพิ่ม workload สไตล์ gen-AI รุ่นใหม่ เข้ามาเรื่อยๆ และ MLPerf ถูกออกแบบมาเพื่อให้เปรียบเทียบผลลัพธ์ข้ามระบบได้ตรงกว่าเดิม

ในส่วนของ training, NVIDIA's MLPerf Training v5.1 write-up เป็นตัวอย่างที่ดีของวิธีที่ vendor รายงาน time-to-train พร้อมรายละเอียดสภาพแวดล้อมที่ใช้ส่งผลและกฎ benchmark ที่ปฏิบัติตาม

ส่วนนี้ไม่ได้บอกว่า prompt ส่วนตัวของคุณจะทำงานอย่างไร แต่เป็นตัวตรวจสอบระดับระบบว่า hardware กลุ่มนี้ทำงานได้แค่ไหนภายใต้เงื่อนไขที่กำหนด

ทีนี้มาพูดถึงส่วนที่มีผลต่อการตัดสินใจซื้อมากที่สุด นั่นคือเวลาและเงินที่ใช้ไปจนงานเสร็จ

ต้นทุน, เวลา, และต้นทุนค่าเสียโอกาส

มากมาย H100 vs RTX 4090 การตัดสินใจมักถูกตีกรอบว่า "ราคาซื้อ vs ราคาเช่า" ซึ่งแทบไม่ใช่กรอบที่ถูกต้อง กรอบที่ดีกว่าคือ: คุณใช้เวลากี่ชั่วโมงกว่าจะได้ model ที่ใช้งานได้จริง และเสียเวลาไปเท่าไรกับการแก้ปัญหาข้อจำกัด

สามสถานการณ์ทั่วไปที่แสดงให้เห็น tradeoff ได้ค่อนข้างชัด

Fine-Tuning รายสัปดาห์บน model ขนาดเล็กถึงกลาง

ถ้า run ของคุณอยู่ภายใน 24 GB โดยไม่ต้องประนีประนอมตลอด แนวทาง 4090 ก็ใช้งานได้ดีมาก คุณ iterate ได้เร็ว ไม่ต้องจองเวลา cluster และ setup ก็ไม่ซับซ้อน แต่ถ้าทุก run กลายเป็น "ลด batch, ตัด context, ลองใหม่" H100 เป็นตัวเลือกที่สมเหตุสมผลกว่ามาก แม้จะมีต้นทุนสูงกว่า

การ serve ด้วย concurrency จริง

Concurrency ดัน KV cache pressure ขึ้นเร็ว นี่คือจุดที่ headroom และ platform control ของ H100 คุ้มค่า โดยเฉพาะเมื่อคุณต้องการ latency ที่คาดเดาได้

ถ้าคุณยังตัดสินใจไม่ได้ว่าเซิร์ฟเวอร์ GPU เหมาะกับ deployment ของคุณหรือเปล่า GPU VPS กับ CPU VPS ของเราเป็นวิธีที่ดีในการจับคู่ workload กับประเภท infrastructure ก่อนที่คุณจะเสียเวลา optimize ในทิศทางผิด

งาน training ขนาดใหญ่ที่มี deadline

พอคุณขยายเกินหนึ่งคนหนึ่งเครื่อง สิ่งที่ดูน่าเบื่อกลับเป็นสิ่งที่คุณอยากโฟกัส ไม่ว่าจะเป็น environment ที่เสถียร failure mode ที่น้อยลง และเวลาที่เสียไปกับการดูแลระบบที่น้อยลง H100 ถูกออกแบบมาสำหรับสิ่งเหล่านั้น

ถ้าคุณยังลังเลอยู่หลังจากอ่านส่วนนี้ ขั้นตอนต่อไปไม่ใช่อ่านเพิ่ม แต่คือการดูว่า stack ของคุณทำงานจริงอย่างไร ทั้ง driver friction และ workload แบบ multi-user

Software และ Ops: Drivers, Stability, Multi-User, และ Support

นี่คือส่วนที่ benchmark chart ส่วนใหญ่ข้ามไป แต่มันกินพื้นที่ชีวิตประจำวันไปไม่น้อย

RTX 4090 ได้รับความนิยมเพราะเข้าถึงง่ายและทำงานได้เร็วสำหรับ AI workflow หลายประเภท แต่ข้อแลกเปลี่ยนคือเมื่อ use case ของคุณขยายตัว คุณจะเจอข้อจำกัดด้าน memory ceiling และรูปแบบการ scale ที่ไม่ได้ออกแบบมาสำหรับสภาพแวดล้อม multi-tenant

H100 สร้างมาสำหรับ cluster โดยเฉพาะ MIG เป็นฟีเจอร์สำคัญสำหรับทีม platform เพราะช่วยแบ่ง GPU หนึ่งตัวออกเป็น slice ที่แยกจากกัน ลดปัญหา "noisy neighbor" และทำให้วางแผน capacity ได้ง่ายขึ้นมาก สเปคทางการของ NVIDIA ระบุว่า H100 รองรับ MIG instance ได้สูงสุด 7 instance ขึ้นอยู่กับ form factor

ถ้า workload ของคุณใช้ส่วนตัวในเครื่องท้องถิ่น คุณใช้ฝั่ง 4090 ได้สบายๆ เป็นเวลานาน แต่ถ้า workload นั้นรองรับผู้ใช้หลายคนและเปิดให้ลูกค้าเข้าถึง H100 คือตัวเลือกที่ปลอดภัยกว่า

แล้วโดยรวม ใครควรเลือกอะไร?

เลือก GPU ตัวไหนให้เหมาะกับ Workload ของคุณ

สำหรับ H100 vs RTX 4090ท้ายที่สุดแล้ว ตัวเลือกที่ดีที่สุดคือตัวที่แก้ปัญหาใหญ่ที่สุดของคุณได้

LLM Builder ในเครื่องท้องถิ่น (Dev เดี่ยว / นักศึกษา)

เลือก RTX 4090 ถ้าคุณทำงานส่วนใหญ่ในช่วง 7B–13B รัน quantized inference ทดลอง RAG หรือทำงานกับ SDXL แล้วค่อยอัปเกรดเมื่อคุณเสียเวลาไปกับการหลีกเลี่ยงข้อจำกัด memory มากกว่าสร้างสิ่งที่ตั้งใจจะทำ

ML Engineer ของ Startup (กำลัง deploy MVP)

ถ้า MVP ของคุณเป็น model เดียวที่มี traffic ระดับปานกลางและพอดีกับ memory 4090 คือจุดเริ่มต้นที่ดี แต่ถ้าคุณต้องการ latency ที่นิ่งรับมือ traffic spike ได้ รองรับ concurrency สูงขึ้น หรือรัน workload หลายตัวบน host เดียว H100 คือทางที่เสถียรกว่า

นักวิจัยประยุกต์ (ทดลองบ่อย)

ถ้าคุณถูกบังคับให้ตัดสินใจเรื่องที่ไม่ควรต้องตัดสินใจบ่อยๆ เช่น ลด batch size หรือปรับ precision ไปมา H100 ช่วยให้คุณรัน experiment ได้สะอาดขึ้นและเสีย run น้อยลง

ทีม Production / Platform (Multi-Tenant Serving)

H100 คือตัวเลือกที่ชัดเจน เพราะ MIG และ headroom ที่มากกว่าทำให้วางแผน capacity ได้ง่ายขึ้น และลด blast radius เมื่อมี spike เกิดขึ้น

ถ้าคุณยังไม่พร้อมจะซื้อฮาร์ดแวร์ การเช่าคือก้าวต่อไปที่ดีที่สุด

ทางสายกลางที่ได้ผล: เช่า GPU ก่อน แล้วค่อยตัดสินใจซื้อ

วิธีตัดสินใจที่ชัดเจนที่สุดคือทดสอบ H100 vs RTX 4090 คือการทำงาน ของคุณ โมเดล, ของคุณ คำสั่ง และ ของคุณ context length บนฮาร์ดแวร์ทั้งสองประเภท แล้วเปรียบเทียบ tokens/sec และ tail latency ภายใต้ load จริง

นั่นคือเหตุผลที่เราสร้าง Cloudzy GPU VPSคุณสามารถเปิด GPU box ได้ภายในหนึ่งนาที ติดตั้ง stack ของคุณพร้อม root เต็มรูปแบบ และหยุดเดาผลลัพธ์จาก benchmark ของคนอื่น

นี่คือสิ่งที่คุณได้รับบนแผน GPU VPS ของเรา:

- NVIDIA GPU แบบ Dedicated (รวมถึงตัวเลือกระดับ RTX 4090 และ A100) ผลลัพธ์ของคุณจึงไม่ถูกรบกวนจาก noisy neighbor

- ความเร็วการเชื่อมต่อเครือข่ายสูงถึง 40 Gbps สำหรับทุกแผน GPU ซึ่งสำคัญมากสำหรับการดึง dataset, workflow แบบ multi-node และการย้าย artifact ด้วยความเร็วสูง

- พื้นที่เก็บข้อมูล NVMe SSD, บวก DDR5 RAM และตัวเลือก CPU ความถี่สูงในทุกระดับแผน เพื่อไม่ให้ส่วนอื่นของระบบฉุดประสิทธิภาพของ GPU ลง

- การป้องกัน DDoS และ uptime 99.95%, เพื่อให้งานที่ใช้เวลานานไม่หยุดชะงักเพราะสัญญาณอินเทอร์เน็ตไม่เสถียร

- การเรียกเก็บรายชั่วโมง (สะดวกสำหรับการทดสอบประสิทธิภาพแบบสั้น) และ รับประกันคืนเงินภายใน 14 วัน สำหรับการทดสอบที่มีความเสี่ยงต่ำ

รันชุดการทดสอบประสิทธิภาพเดิมบนแผน RTX 4090 ก่อน จากนั้นทำซ้ำบนแผนระดับ A100 เมื่อคุณเริ่มใช้ context ขนาดใหญ่ขึ้น, concurrency สูงขึ้น, หรือโมเดลที่ใหญ่ขึ้น หลังจากนั้น การเลือกระหว่าง H100 vs RTX 4090 มักจะเห็นได้ชัดเจนจาก log ของคุณเอง

ชุดทดสอบประสิทธิภาพ: รันด้วยตัวเองใน 30 นาที

ถ้าต้องการผลลัพธ์ที่คุณมั่นใจได้ ให้เก็บตัวเลขสี่ค่านี้จาก stack จริงที่คุณจะ deploy:

- โทเค็น/วินาที ที่ context length เป้าหมายของคุณ

- ความเร็วการตอบสนองที่เปอร์เซ็นต์ที่ 95 ที่ concurrency ที่คาดไว้

- ความสามารถ VRAM ที่เหลือ ในช่วงที่โหลดสูงสุด

- ต้นทุนต่อการรันที่สำเร็จหนึ่งครั้ง ตั้งแต่เริ่มต้นจนถึง artifact

การทดสอบเบื้องต้นแบบเรียบง่ายด้วย vLLM มีลักษณะดังนี้:

pip install vllm transformers accelerate

python -m vllm.entrypoints.api_server \

--model meta-llama/Llama-3-8B-Instruct \

--dtype float16 \

--max-model-len 8192ถ้าอยากรู้ว่าคุณเช่าอะไรจริง ๆ โพสต์ของเราเรื่อง GPU VPS คืออะไร? อธิบายความแตกต่างระหว่างการเข้าถึง GPU แบบ dedicated, การแชร์ vGPU, และสิ่งที่ควรตรวจสอบก่อนเลือกแผน