ถ้าคุณคิดจะซื้อ GPU ใหม่เพื่อหนีปัญหา out-of-memory ถกเรื่อง 5070 Ti vs 5080 ไม่ใช่ประเด็นที่ถูก ทั้งสองการ์ดมี VRAM เท่ากันที่ 16 GB และข้อจำกัดด้านความจุนี้จะโผล่มาให้เห็นใน deep learning เร็วกว่าที่หลายคนคาด

5080 เร็วกว่าจริง แต่แทบไม่เคยทำให้คุณรันโมเดลที่ใหญ่ขึ้นได้อย่างมีนัยสำคัญ ในทางปฏิบัติ คุณยังต้องลด batch size ตัด context length หรือ offload ไปยัง system RAM อยู่ดีเพื่อให้รันต่อได้

นั่นจึงเป็นเหตุผลที่บทความนี้มองเรื่อง 5070 Ti vs 5080 สำหรับ deep learning อย่างตรงไปตรงมา พร้อมแนะนำตัวเลือกที่เหมาะกว่าหากเป้าหมายของคุณคือ train, fine-tune หรือ serve โมเดลโดยไม่ต้องกังวลเรื่องข้อจำกัดของ VRAM ตลอดเวลา

ถ้าจะอ่านแค่บางส่วน ให้อ่านหัวข้อ specs และหัวข้อ "capacity vs speed" สองส่วนนี้คือสิ่งที่จะกันคุณไม่ให้ซื้อผิด

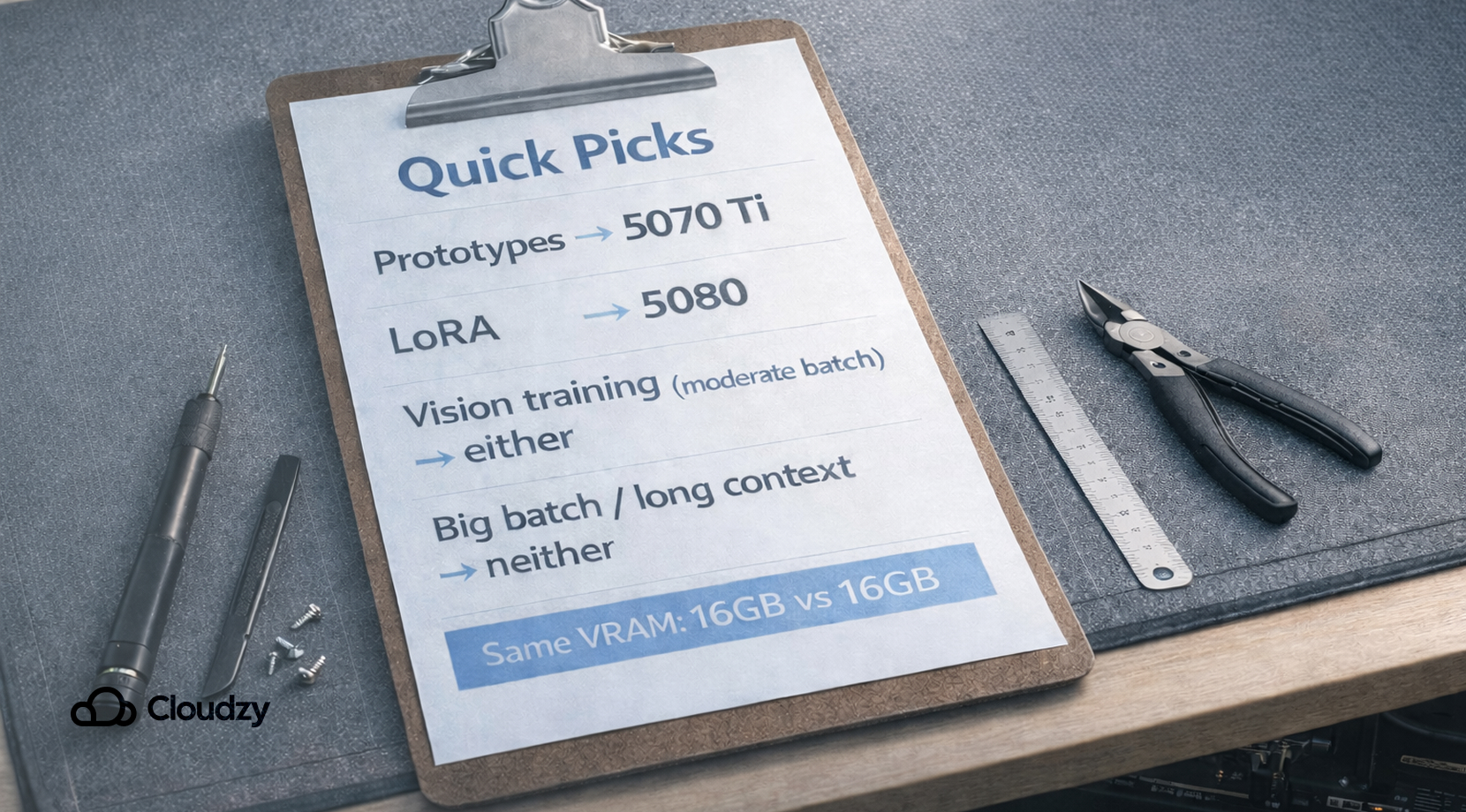

แนะนำตามสิ่งที่คุณทำ

คนส่วนใหญ่ไม่ได้เลือก GPU แบบมั่วๆ เราเห็นรูปแบบการตัดสินใจที่พบบ่อยสี่แบบซ้ำๆ และคำตอบของ 5070 Ti กับ 5080 ก็ต่างกันในแต่ละกรณี

นักทดลอง LLM ในเครื่องตัวเอง

คุณรัน notebook, ปรับ quantization, และสนใจแค่ว่า "รันได้" มากกว่า throughput ที่สมบูรณ์แบบ สำหรับคุณ 5070 Ti กับ 5080 มักตัดสินกันที่งบประมาณ เพราะทั้งสองการ์ดรู้สึกใช้ได้ดีกับโมเดลเล็กและ quantized inference แล้วก็ชนเพดาน VRAM เดียวกันเมื่อ context length หรือ batch size เพิ่มขึ้น

นักศึกษาปริญญาโทที่ฝึก vision model

คุณต้องการ experiment ที่ทำซ้ำได้ ไม่ใช่ retry ไม่รู้จบ ต้นทุนที่ซ่อนอยู่ไม่ใช่ตัวการ์ด แต่คือเวลาที่หายไปเมื่อ run ล้มเหลวที่ epoch 3 เพราะ dataloader, augmentation, และโมเดลแย่ง memory กัน

วิศวกร startup ที่ deploy inference

คุณสนใจ tail latency และ concurrency demo ผู้ใช้คนเดียวอาจดูดีบน 16 GB แต่พอ traffic จริงมา KV cache pressure ก็กิน VRAM ของคุณทีละนิดเหมือนรั่วช้าๆ สำหรับการ serve โมเดล 5070 Ti กับ 5080 อาจไม่ใช่ประเด็นหลัก ถ้าปัญหาจริงคือ capacity สำหรับ batch และ prompt ยาว

ครีเอเตอร์ที่ทำ ML ด้วย

คุณสลับระหว่างแอปสร้างคอนเทนต์กับ ML tooling และเกลียดการรีบูต ปัญหา driver และการบอกว่า "ปิด Chrome ก่อนค่อย train" สำหรับคุณ 5070 Ti กับ 5080 คุ้มค่าก็ต่อเมื่อ GPU เป็นส่วนหนึ่งของ workflow ที่ลื่นไหล ไม่ใช่เครื่องที่พังทันทีที่ multitask

เมื่อเข้าใจกรณีเหล่านี้แล้ว มาดูรายละเอียด hardware และสาเหตุที่ปัจจัยจำกัดเดียวกันปรากฏในจุดที่สำคัญที่สุด

Spec ที่สำคัญสำหรับ Deep Learning

วิธีที่เร็วที่สุดในการทำความเข้าใจ 5070 Ti กับ 5080 คือมองข้ามตัวเลขการตลาดแล้วโฟกัสที่แถว memory

ถ้าต้องการดู spec sheet แบบครบถ้วน นี่คือตารางเปรียบเทียบที่เน้นสิ่งที่ส่งผลต่อพฤติกรรมการฝึกและ inference มากที่สุด (ความเร็วสัญญาณนาฬิกาและ display output ดูน่าสนใจ แต่ไม่ได้บอกว่า run ของคุณจะพอดีหรือไม่)

| สเปค (เดสก์ทอป) | RTX 5070 Ti | RTX 5080 | ทำไมถึงสำคัญใน DL |

| VRAM | 16 GB | 16 GB | Capacity คือเพดานแข็งสำหรับ weight, activation, และ KV cache |

| ประเภทหน่วยความจำ | GDDR7 | GDDR7 | พฤติกรรมใกล้เคียงกัน bandwidth ช่วยได้ แต่ capacity ตัดสินว่า "พอดีหรือไม่" |

| บัส หน่วยความจำ | 256 บิต | 256 บิต | จำกัดแบนด์วิดท์รวม ช่วยเรื่อง throughput ไม่ใช่ขนาดโมเดล |

| CUDA Cores | 8,960 | 10,752 | Compute ที่มากขึ้นช่วยเพิ่ม tokens/sec ไม่ใช่ตัดสินว่า "โหลดได้หรือเปล่า" |

| กำลังไฟของการ์ด | 300 วัตต์ | 360 วัตต์ | ความร้อนและ PSU ที่ต้องการมากขึ้น แต่ไม่ได้เพิ่ม VRAM |

แหล่งข้อมูลสเปคอย่างเป็นทางการ: RTX 5080, ตระกูล RTX 5070

โดยสรุป 5080 เร็วกว่า และ 5070 Ti ราคาถูกกว่า สำหรับ deep learning ความต่างจะเห็นชัดก็ต่อเมื่อ workload ของคุณ fit อยู่ใน VRAM แล้ว

ต่อไป เราจะดูว่าทำไม VRAM ถึงหมดเร็วมาก แม้แต่กับ setup ที่ดูเบาบนกระดาษ

ทำไม VRAM ถึงถูกกิน หมดเร็วใน Deep Learning

คนที่มาจากวงการเกมมักคิดว่า VRAM เหมือน texture pool แต่ใน deep learning มันใกล้เคียงกับเคาน์เตอร์ครัวที่แคบมากกว่า คุณไม่ได้ต้องการแค่พื้นที่วางวัตถุดิบ แต่ยังต้องการพื้นที่หั่น ปรุง และจัดจาน ทั้งหมดพร้อมกัน

นี่คือสิ่งที่มักอยู่ใน VRAM ระหว่าง run:

- น้ำหนักโมเดล: พารามิเตอร์ที่คุณโหลด บางทีอยู่ในรูป FP16/BF16 บางทีก็ quantized

- การเปิดใช้งาน: intermediate tensors ที่เซฟไว้สำหรับ backprop ซึ่งมักกินพื้นที่มากที่สุดในการเทรน

- Gradients และ optimizer state: overhead จากการเทรนที่อาจทำให้ความต้องการ memory พุ่งขึ้นหลายเท่า

- แคช KV: overhead จากการ inference ที่เพิ่มขึ้นตาม context length และ concurrency

นี่แหละคือเหตุผลที่การเถียงกันระหว่าง 5070 Ti กับ 5080 บางทีเหมือนเถียงเรื่องแรงม้าของเครื่องยนต์ขณะลากรถพ่วงที่หนักเกินไป มีแรงม้ามากกว่าก็จริง แต่ตัวล็อครถพ่วงยังคงเป็นคอขวดอยู่ดี

วิธีที่เราใช้ตรวจสอบใน testing ของเราเองคือ log ทั้ง allocated และ reserved memory ใน PyTorch โน้ต CUDA memory ของ PyTorch อธิบาย caching allocator และเหตุผลที่ memory อาจดูเหมือน "ถูกใช้" ใน tools อย่าง nvidia-smi แม้หลังจาก tensor ถูก free ไปแล้ว

นั่นคือประเด็นหลักที่เราจะพูดถึงในที่นี้ นั่นคือความล้มเหลวของ deep learning บน VRAM 16 GB ส่วนใหญ่ไม่ได้เกิดจากความช้า แต่เกิดจาก OOM ในช่วงเวลาที่แย่ที่สุด

Workload แรกที่ทำให้เห็นความต่างระหว่าง 5070 Ti กับ 5080

ด้านล่างคือรูปแบบ deep learning ที่มักจะชนขีดจำกัด memory ก่อนใคร เมื่อใช้ 5070 Ti กับ 5080

LLM Serving ที่มี Long Prompt และ Concurrency จริง

Prompt เดี่ยวที่มี 2K token อาจดูปกติดี แต่พอเพิ่ม context ที่ยาวขึ้น เพิ่ม batching หรือมีผู้ใช้คนที่สองเข้ามา KV cache ก็เริ่มพุ่ง นั่นคือจุดที่ 5070 Ti กับ 5080 ให้ผลลัพธ์เหมือนกัน คือต้องตัด max context หรือลด batch size ลงเพื่อให้ระบบยังทำงานต่อได้

วิธีตรวจสอบเบื้องต้น:

- รัน server ของคุณด้วย max context และ batch จริงที่ใช้งาน

- ดู VRAM ตลอดช่วงเวลา ไม่ใช่แค่ตอน startup

- จดไว้ว่า latency พุ่งขึ้นที่จุดไหน แล้วตรวจ memory usage ในช่วงเวลาเดียวกัน

ถ้าต้องการระบบ monitoring ที่ใช้งานได้จริงโดยไม่ต้องมานั่งตั้งค่าเป็นโปรเจกต์ใหม่ คู่มือของเราเรื่อง ซอฟต์แวร์มอนิเตอร์ GPU รวบรวม pattern การ log ด้วย CLI ที่ใช้ได้ดีในการรันจริง

LoRA หรือ QLoRA Fine-Tuning

หลายคนบอกว่า "LoRA ใช้งานได้บน 16 GB" ซึ่งก็ไม่ผิด แต่กับดักอยู่ตรงที่คิดว่า pipeline ส่วนที่เหลือไม่กิน memory Tokenization buffer, dataloader worker, mixed precision scaling และ validation step ล้วนกินทรัพยากรสะสมกันได้เร็วมาก

ในทางปฏิบัติ คอขวดที่นี่ไม่ใช่เรื่องของการคำนวณ แต่เป็นเรื่องของ margin ถ้าไม่มี VRAM สำรองเหลือ คุณจะต้องคอยจับตาดู run ตลอดเวลา

Vision Training ด้วย Input ความละเอียดสูง

Image model มีจุดล้มเหลวที่ซ่อนอยู่ตรงที่การเพิ่ม resolution เล็กน้อย หรือการเพิ่ม augmentation อีกตัว อาจทำให้สถานะเปลี่ยนจากปกติเป็น OOM ทันที บน 5070 Ti กับ 5080 จะเห็นได้จาก batch size ที่หดเหลือ 1 แล้ว gradient accumulation ทำให้การ training กลายเป็นลูปที่ช้าผิดปกติ

Multimodal Run บน GPU เครื่องเดียว

Text encoder + image encoder + fusion layer อาจทำงานได้ปกติ แต่ถ้าเพิ่ม sequence length หรือเปลี่ยนเป็น vision backbone ที่ใหญ่ขึ้น memory จะพุ่งอย่างรุนแรง

"GPU ของฉันไม่มีปัญหา แต่เครื่อง desktop กลับมี"

นี่คือเรื่องที่เกิดขึ้นบ่อยที่สุด คุณเริ่ม training แล้ว browser, IDE และโปรแกรมอื่นที่รันอยู่ก็ดึง VRAM ไปด้วย ทำให้ config ที่เคย "เสถียร" พังในทันที คนในฟอรัม บ่นว่าปิดทุกอย่างแล้ว ปิด overlay แล้ว ก็ยังเจอ OOM กับโมเดลเดิมที่เมื่อวานยังรันได้

รูปแบบนี้ปรากฏให้เห็นซ้ำแล้วซ้ำเล่าใน การพูดคุยเรื่อง 5070 Ti กับ 5080, เช่นกัน เพราะการ์ดทั้งสองรุ่นมีขีดจำกัด VRAM เท่ากัน ถ้าฟังดูคุ้นหู คำถามต่อไปคือ "แล้วเราจะจัดการกับขีดจำกัดนี้อย่างไร?"

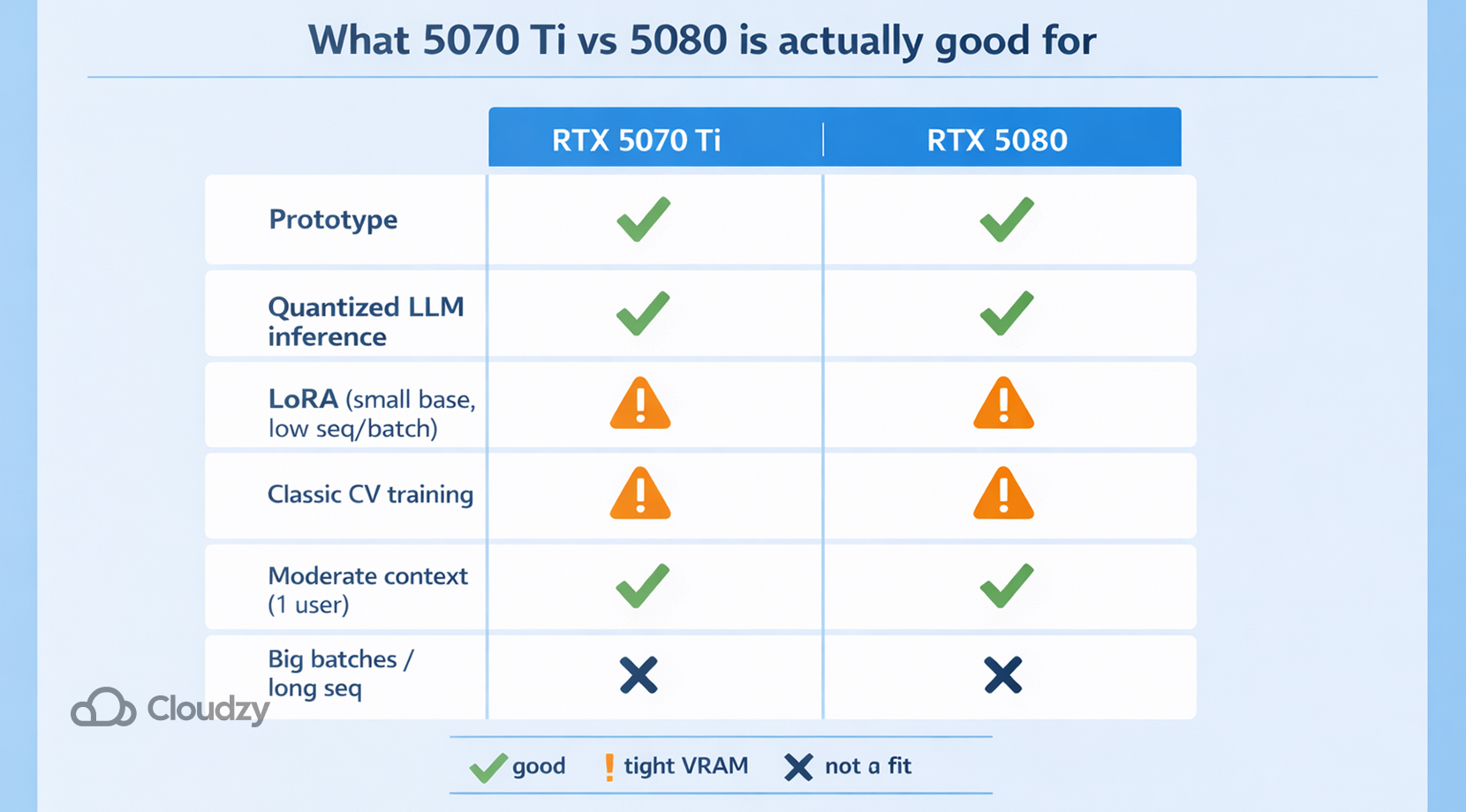

5070 Ti กับ 5080 เหมาะกับงาน Actually Good แบบไหน

ในวงการ ML มักถูกมองว่า 16 GB นั้นไม่พอ แต่ก็ไม่ได้ไร้ประโยชน์ แค่ใช้ได้กับงานบางประเภทเท่านั้น

5070 Ti กับ 5080 ใช้งานได้ดีกับ:

- งาน Prototype: ทดลองขนาดเล็ก ทดสอบแบบเร็ว และตรวจสอบความถูกต้องเบื้องต้น

- การ inference LLM แบบ Quantized: โมเดลขนาดเล็กที่มี context พอประมาณ ผู้ใช้คนเดียว

- LoRA บนโมเดลฐานขนาดเล็ก: ตราบใดที่ควบคุม sequence length และ batch size ให้อยู่ในขอบเขต

- การฝึก Vision แบบคลาสสิก: รูปภาพขนาดกลาง backbone ขนาดกลาง และต้องอาศัยความอดทนมากขึ้น

ประเด็นคือ ถ้างานของคุณอยู่ภายในขีดจำกัด VRAM 5080 มักจะรู้สึกเร็วกว่า 5070 Ti และคุณจะได้ประโยชน์จาก compute ที่มากกว่าด้วย

แต่ทันทีที่ลองทำ deep learning อย่างจริงจัง คุณจะเจอปัญหาเรื่อง memory headroom มาดูกลยุทธ์ที่ช่วยได้กับการ์ดทั้งสองรุ่นกัน

วิธีบีบ VRAM ที่มีจำกัดโดยไม่ทำให้การ training เป็นฝันร้าย

ไม่มีเทคนิคไหนที่เป็นสูตรวิเศษ แต่เหล่านี้คือชุดวิธีที่ช่วยให้ 5070 Ti กับ 5080 ยังใช้งานได้อย่างมีประสิทธิภาพนานขึ้น

เริ่มจากการวัดผล

ก่อนแตะ hyperparameter ใดๆ ให้ดูตัวเลข VRAM สูงสุดต่อ step ก่อน ใน PyTorch ใช้ max_memory_allocated() และ max_memory_reserved() เป็นวิธีเร็วที่สุดในการดูว่า run ของคุณใช้ทรัพยากรจริงๆ เท่าไร

ช่วยให้คุณตอบคำถามเช่น:

- ต้นทุนหลักมาจากตัวโมเดล หรือมาจาก activation?

- VRAM พุ่งสูงระหว่างการ validation หรือไม่?

- fragmentation เพิ่มขึ้นเรื่อย ๆ ตามเวลาหรือเปล่า?

เมื่อมี baseline แล้ว ส่วนที่เหลือจะคาดเดาได้ง่ายขึ้นมาก

ลด Memory ลงในทุกจุดที่ทำได้

ลำดับขั้นตอนที่เราใช้มีดังนี้:

- ลด batch size ลงจนพอดีกับหน่วยความจำ

- เพิ่ม gradient accumulation เพื่อรักษา effective batch ให้เท่าเดิม

- เปิดใช้ mixed precision (BF16/FP16) ถ้า stack ของคุณรองรับ

- เพิ่ม gradient checkpointing ถ้า activation กินหน่วยความจำเป็นส่วนใหญ่

- แล้วค่อยปรับขนาด model เป็นขั้นตอนสุดท้าย

มอง Context Length เหมือนงบประมาณที่มีจำกัด

สำหรับ transformer นั้น context length คือสิ่งที่สร้างปัญหาได้มากที่สุด เพราะส่งผลต่อการคำนวณ attention และขนาด KV cache ในช่วง inference เมื่อเปรียบ 5070 Ti กับ 5080 คุณจะสังเกตเห็นความแตกต่างทันทีที่ token เกินหลักพันตัว เพราะ VRAM พุ่งขึ้นเร็ว throughput ร่วงลง และคุณต้องลด batch size เพื่อให้ระบบยังทำงานได้

แนวทางที่แนะนำ:

- กำหนด max context ค่าเริ่มต้นที่ยังมีพื้นที่เหลือพอ

- สร้าง profile ที่สองสำหรับ "long context" พร้อมลด batch ลง

- อย่าใช้ทั้งสองโหมดพร้อมกันระหว่าง debug

อย่าสับสนระหว่าง PyTorch Cache กับ Memory Leak จริง ๆ

รายงาน "memory leak" จำนวนมากที่พบจริง ๆ แล้วเป็นพฤติกรรมของ allocator เอง เอกสารของ PyTorch ระบุว่า caching allocator อาจยังคง reserve หน่วยความจำไว้แม้จะ free tensor ไปแล้ว และ empty_cache() เป็นเพียงการคืน cached block ที่ไม่ได้ใช้ให้กับแอปอื่น ไม่ใช่การคืนกลับไปยัง PyTorch โดยตรง

เรื่องนี้สำคัญเพราะผู้ใช้ที่เปรียบ 5070 Ti กับ 5080 มักเสียเวลาไปกับ phantom leak แทนที่จะโฟกัสที่สาเหตุจริง ซึ่งได้แก่ batch size, sequence length และ activation memory

การปรับแต่งเหล่านี้ช่วยให้ใช้หน่วยความจำที่มีอยู่ได้เต็มประสิทธิภาพมากขึ้น แต่ไม่ได้เปลี่ยนข้อเท็จจริงพื้นฐาน ถ้าโปรเจกต์ของคุณต้องการ model ขนาดใหญ่ขึ้น context ยาวขึ้น หรือ concurrency สูงขึ้น คุณต้องการ VRAM เพิ่ม

ระหว่าง 5070 Ti กับ 5080 ฉันต้องการ Capacity หรือ Speed กันแน่

มองในแง่หนึ่ง speed คือความเร็วที่ขับได้ ส่วน capacity คือจำนวนผู้โดยสารที่รับได้ deep learning ต้องการทั้งคู่ แต่ capacity คือสิ่งที่ตัดสินว่าคุณจะออกจากที่จอดรถได้เลยหรือไม่

5080 ให้ throughput สูงกว่า 5070 Ti ในหลาย workload แต่การเปรียบ 5070 Ti กับ 5080 ไม่ได้เปลี่ยนคำถามว่า "โหลดได้และรันได้ไหม" เพราะทั้งคู่ต่างก็ชนเพดานหน่วยความจำของตัวเองเหมือนกัน

นั่นคือสาเหตุที่หลายคนรู้สึกผิดหวังหลังจากอัปเกรด พวกเขาสัมผัสได้ถึงความเร็วที่เพิ่มขึ้นในการทดสอบเล็กๆ น้อยๆ แต่พอลองใช้งานจริงก็ยังชนกำแพงเดิม แค่มาถึงช้ากว่าเดิม 30 วินาทีเท่านั้น

ดังนั้น ถ้าคุณกำลังเลือกซื้อโดยคำนึงถึง deep learning ให้ลองพิจารณาก่อนว่าตัวเองอยู่ในกลุ่มไหน:

- ติดขัดเรื่องความเร็ว: โมเดลของคุณโหลดได้พอดี แค่อยากให้ประมวลผลแต่ละ step เร็วขึ้น

- ติดขัดเรื่องขนาด: โมเดลของคุณไม่พอดีกับ VRAM เลย และต้องเสียเวลาตัดทอนปัญหาให้เล็กลงก่อน

คนส่วนใหญ่ที่กำลังเปรียบเทียบ 5070 Ti กับ 5080 สำหรับ deep learning มักอยู่ในกลุ่มที่สอง แม้จะยังไม่รู้ตัวก็ตาม

ทีนี้มาพูดถึงตัวเลือกที่ช่วยประหยัดเวลาได้มากที่สุด: ย้าย "งานหนัก" ไปรันบน GPU ที่ใหญ่กว่า โดยไม่ต้องสร้างเครื่อง local ใหม่ทั้งหมด

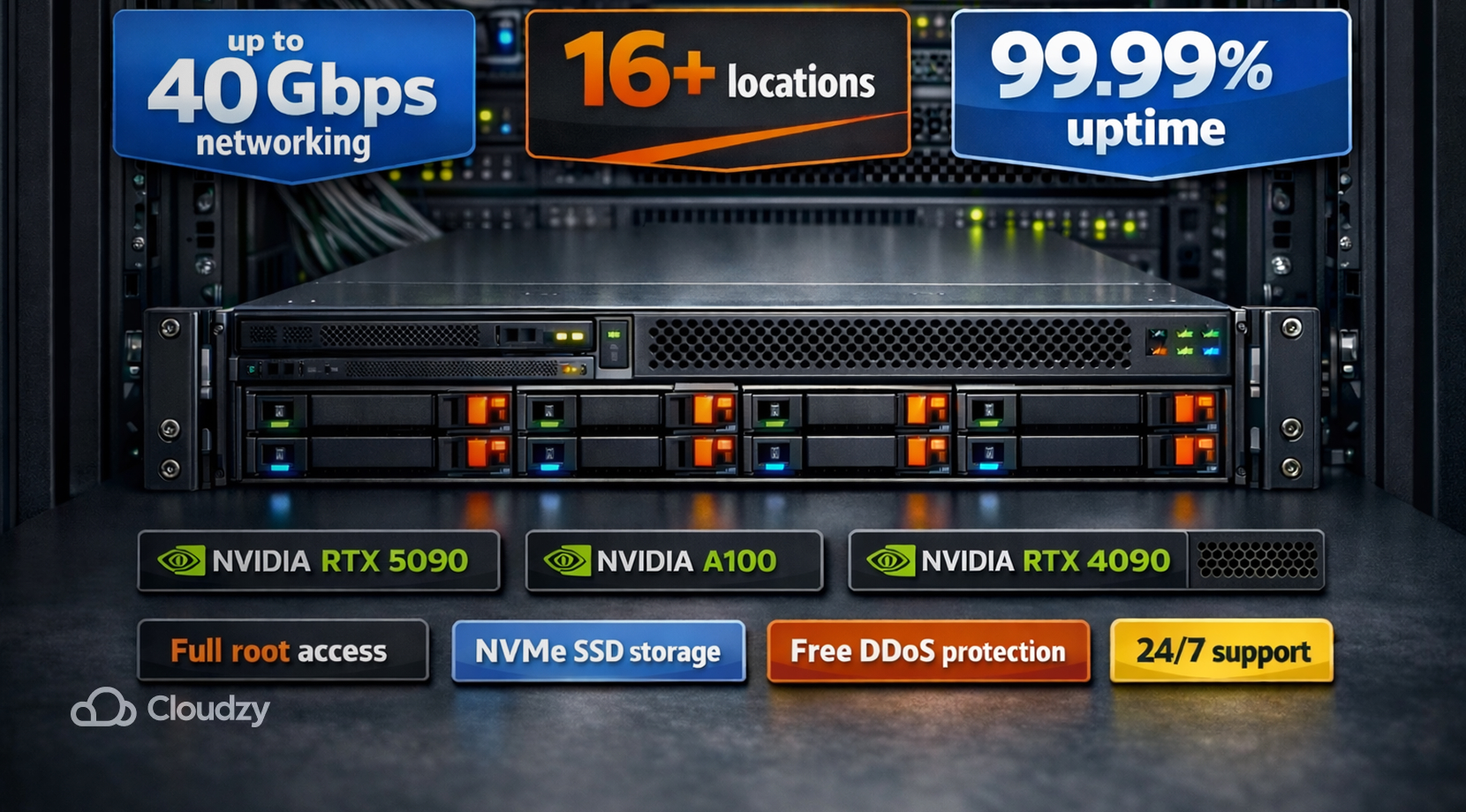

ทางเลือกที่คุ้มค่า: ใช้ GPU VPS สำหรับงานที่ต้องการพลังประมวลผลสูง

รูปแบบที่ทีม infra ของเราเห็นบ่อยที่สุดคือ คนส่วนใหญ่เริ่ม prototype บนเครื่อง local แล้วก็มาถึงจุดที่การเลือกระหว่าง 5070 Ti กับ 5080 ไม่มีความหมายอีกต่อไป เพราะโมเดลใหญ่เกินกว่าจะใส่ลงไปได้เลย

นั่นคือจุดที่คุณต้องการ VRAM pool ขนาดใหญ่กว่านี้ ทั้งสำหรับการ train และทดสอบ serving จริง และนั่นคือจุดที่ Cloudzy GPU VPS เหมาะสมพอดี

แผนบริการ GPU VPS ของเราครอบคลุม NVIDIA ตัวเลือก RTX 5090, A100 และ RTX 4090 พร้อม root access เต็มรูปแบบ, พื้นที่เก็บข้อมูล NVMe SSD, networking สูงสุด 40 Gbps, 12 ที่ตั้ง, การป้องกัน DDoS ฟรี, support ตลอด 24/7 และเป้าหมาย uptime 99.95%

แล้วสิ่งนี้ช่วยคุณได้อย่างไร ไม่ว่าจะเป็น 5070 Ti กับ 5080 หรือ GPU รุ่นอื่นในระดับเดียวกัน? คำตอบคือ:

- คุณสามารถรันโมเดลจริงและ prompt profile ของคุณบน hardware ที่มี VRAM มากกว่า ทำให้ตัดสินใจได้ชัดเจนขึ้นจาก log ของคุณเอง

- คุณสามารถเก็บ GPU บนเครื่อง local ไว้สำหรับ dev และทดสอบเบาๆ แล้วเช่า "การ์ดใหญ่" เฉพาะเวลาที่ต้องการพลังประมวลผลสูงเท่านั้น

ถ้าอยากทบทวนพื้นฐานเกี่ยวกับ GPU VPS คืออะไรและความแตกต่างระหว่าง GPU แบบ dedicated กับแบบ shared คืออะไร คู่มือสำหรับผู้เริ่มต้นของเราอธิบายไว้อย่างเข้าใจง่าย

และถ้ายังไม่แน่ใจว่าต้องการ GPU สำหรับงานของคุณหรือเปล่า GPU กับ CPU VPS การเปรียบเทียบนี้จะช่วยให้เห็นภาพชัดขึ้นว่างานประเภทไหน เช่น training, inference, database และ web app ต้องการ hardware แบบใด

เมื่อจัดการด้าน infrastructure เรียบร้อยแล้ว สิ่งที่เหลืออยู่คือการเลือก workflow ที่ไม่เสียเวลาโดยเปล่าประโยชน์

ขั้นตอนง่ายๆ ช่วยให้คุณรู้ว่าต้องการอะไร

นักพัฒนา ML หลายคนติดกับดักความคิดว่าต้องเลือกระหว่างซื้อการ์ดรุ่นใหญ่ขึ้นหรือยอมทน ในทางปฏิบัติ 5070 Ti กับ 5080 ยังใช้งานได้อย่างมีเหตุผลในกระบวนการทำงาน ถ้าคุณมองมันเป็นเครื่องมือสำหรับพัฒนาในเครื่องตัวเอง ไม่ใช่ production stack ทั้งหมดของคุณ

นี่คือขั้นตอนการทำงานที่ได้ผลดีในทางปฏิบัติ:

- ใช้ 16 GB GPU ของคุณสำหรับเขียนโค้ด ดีบั๊ก และทดลองขนาดเล็ก

- เตรียม environment template สำหรับ GPU ขนาดใหญ่ไว้ล่วงหน้า เพื่อรองรับการรันงานจากระยะไกล

- ย้ายการทดสอบ training และ serving ที่ต้องการพื้นที่ทรัพยากรเพิ่มเติมไปยัง GPU VPS

- ติดตามการทำงานและบันทึก log ไว้ เพื่อให้ผลลัพธ์ทำซ้ำได้ทุกครั้ง

หากคุณต้องการข้อมูลเชิงลึกเพิ่มเติมเกี่ยวกับการเลือก GPU ประเภทที่เหมาะสมสำหรับงาน ML โดยทั่วไป ลองดูบทสรุปของเรา GPUs ที่ดีที่สุดสำหรับ machine learning เป็นตัวเลือกถัดไปที่น่าสนใจ

ดังนั้น สรุปแล้ว การเลือกระหว่าง 5070 Ti กับ 5080 เป็นเรื่องของการประมวลผลในเครื่องของคุณเอง แต่เมื่อต้องการ scale งาน deep learning นั่นคือการตัดสินใจด้านโครงสร้างพื้นฐาน และพูดถึงเรื่อง scale หากคุณสงสัยว่าการ์ดรุ่นที่ใหญ่ขึ้นจะเปลี่ยนพฤติกรรมของ AI จริงๆ อย่างไร ลองดูที่ เปรียบเทียบประสิทธิภาพ H100 กับ RTX 4090 การเปรียบเทียบนี้มีประโยชน์ เพราะวนกลับมาที่แนวคิดเดิมเสมอ นั่นคือ VRAM ต้องเหมาะก่อน แล้วค่อยคิดเรื่องความเร็ว