Claude Code gehört nach wie vor zu den stärksten Coding-Agenten, aber viele Entwickler wählen ihre Tools heute nach Workflow, Modellzugang und langfristigen Kosten – nicht nach Anbieterbindung.

Deshalb wächst das Interesse an Claude Code-Alternativen stetig. Die gute Nachricht: Es gibt inzwischen solide Optionen für Terminal-Nutzer, editor-zentrierte Entwickler und alle, die eine selbst gehostete Lösung bevorzugen.

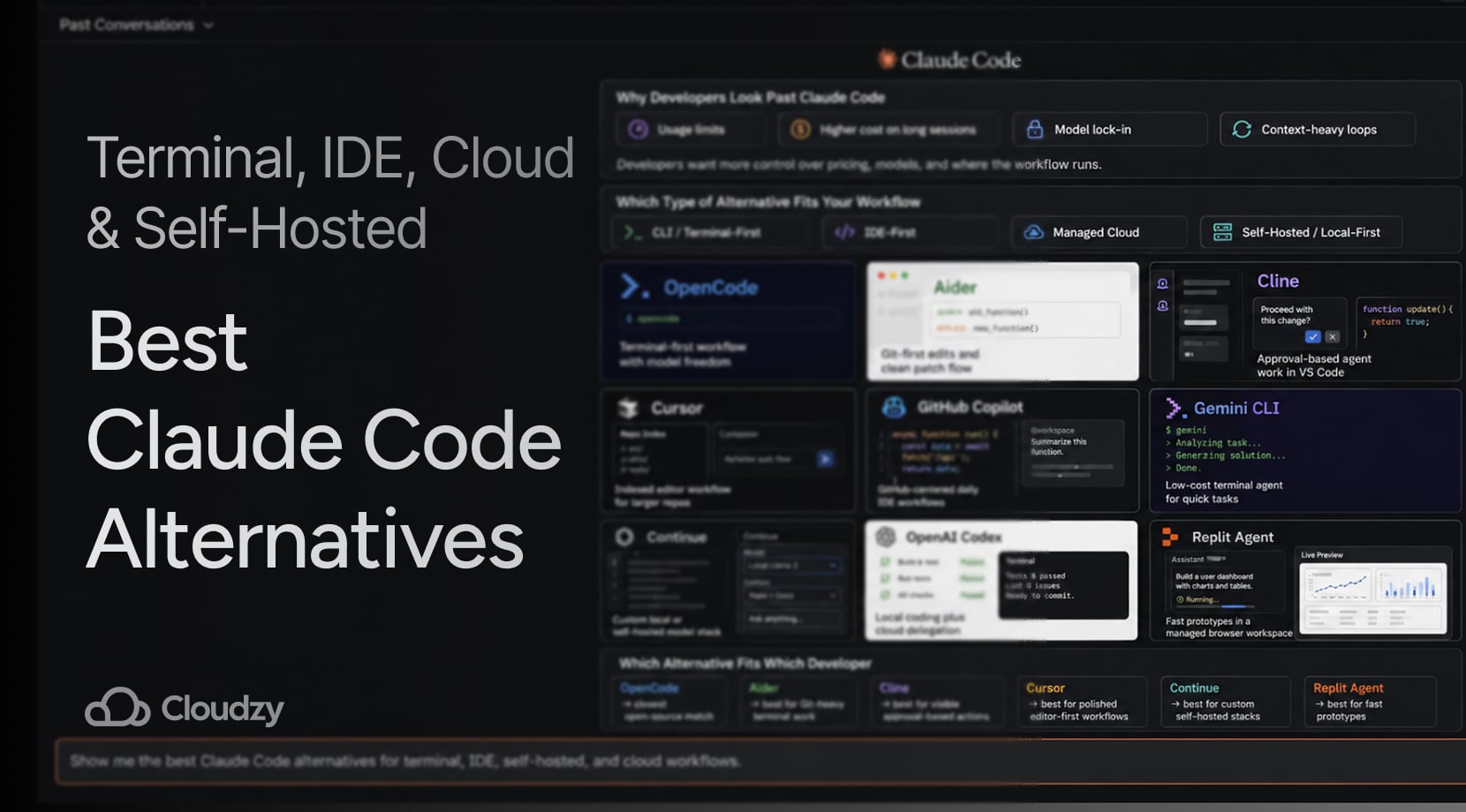

Kurze Antwort

Wer die Kurzfassung will: Claude Code ist nach wie vor stark bei repository-weiten Aufgaben, terminal-gesteuerten Änderungen und mehrstufigen Abläufen. Wer aber mehr Modellauswahl, geringere Kosten bei Routineaufgaben, einen angenehmeren Editor-Flow oder ein selbst gehostetes Setup sucht, findet jetzt mehrere überzeugende Alternativen.

- Nächste Open-Source-Alternative: OpenCode

- Bester Git-orientierter Terminal-Workflow: Aider

- Bester Open-Source-Editor-Agent: Cline

- Beste ausgereifte IDE-zentrierte Option: Cursor

- Beste Multi-Modell-Editor-Option für den Mainstream: GitHub Copilot

- Bester kostenloser CLI-Weg für Einzelnutzer: Gemini-Befehlszeilenschnittstelle

- Bestes individuell selbst gehostetes Setup: Weiter

- Beste Cloud-Option für Delegation: OpenAI Codex

Viele Entwickler steigen jedoch nicht auf einen direkten Ersatz um. Jeder Entwickler weiß, dass man mehrere Tools gleichzeitig braucht und jedes für die Aufgaben einsetzt, für die es am besten geeignet ist – ein wiederkehrendes Thema in Reddit-Beiträgen .

Warum Entwickler sich nach Alternativen zu Claude Code umsehen

Claude Code hat seinen Ruf aus gutem Grund. Anthropic hat es auf agentische Coding-Workflows ausgelegt: Es kann eine Codebasis lesen, Dateien bearbeiten, Befehle ausführen und direkt aus dem Terminal oder angebundenen Tools heraus arbeiten – auf eine Art, die sich nach einer kurzen Eingewöhnungszeit natürlich anfühlt.

Dennoch werden dieselben Beschwerden über Preise und Nutzungslimits immer wieder diskutiert. Der Zugang zu Claude umfasst jetzt Pro, Max, Team und Enterprise, wobei Premium-Plätze höhere Nutzungskontingente für Team-Umgebungen bieten. Wer Claude aber kennt, weiß, dass die Limits viel schneller erreicht sind als erwartet.

Lock-in ist das zweite große Problem. Wer den Workflow schätzt, aber nicht möchte, dass das gesamte Setup an Anthropic-Modelle und Anthropic-Limits gebunden ist, für den sind Alternativen eindeutig die sinnvollere Wahl.

In neueren Threads taucht außerdem eine eher lästige Beschwerde auf: Lange Sitzungen werden teuer, weil das Tool ständig Kontext mitschleppt. Wenn etwas hängt oder in eine Schleife gerät, kann das schnell Zeit und Budget auffressen.

Einige Nutzer haben Auswertungen veröffentlicht , die zeigen, dass der Großteil der Token-Kosten in die Kontextverwaltung fließt und nicht in den eigentlichen Code-Output. Andere berichten davon, dass Claude Code minutenlang feststeckt bei Prompts, die eigentlich Routine sein sollten.

Der Fairness halber: Am 23. April 2026 hat Anthropic die Probleme eingeräumt und erklärt, dass bestimmte Qualitätsprobleme mit Claude Code auf drei produktseitige Änderungen zurückzuführen seien und nicht auf ein verschlechtertes Basismodell. Die Korrekturen seien ab dem 20. April live gewesen.

Das zeigt: Auch wenn nicht viele Entwickler komplett von Claude Code wegwechseln, sollte jeder, der vorausschauend arbeitet, mindestens eine oder zwei Alternativen zu Claude Code parat haben – für den Fall der Fälle.

All das macht Claude Code nicht zu einem schlechten Tool. Es bedeutet nur, dass der Markt inzwischen breiter aufgestellt ist. Wer den agentischen Ansatz schätzt, aber mehr Kontrolle über Preise oder Modellwahl möchte, findet in unserem Opencode vs Claude Code Vergleich ist der direktere Vergleich.

Welche Art von Alternative passt zu deinem Workflow

Ob du hauptsächlich im Terminal arbeitest, im Editor oder auf selbst gehosteter Infrastruktur – je nach Setup greifen Entwickler zu unterschiedlichen Alternativen. OpenCode, Aider und Gemini CLI eignen sich für alle, die nah an der Shell bleiben wollen. Cursor und Copilot passen besser zu editorbasiertem Arbeiten, und Continue richtet sich eher an Entwickler, die eigene Modelle oder Infrastruktur einbinden möchten.

CLI- und Terminal-orientierte Tools

Du bleibst in Git, bleibst in der Shell, und lässt den Agenten Änderungen genau dort durchführen, wo du ohnehin entwickelst und testest. OpenCode, Aider und Gemini CLI fallen alle in diese Kategorie – sie verhalten sich aber nicht identisch, dazu kommen wir später.

IDE-orientierte Tools

Diese Tools passen zu Entwicklern, die KI-Unterstützung direkt in ihrem gewohnten Editor haben wollen. Cursor, GitHub Copilot und Cline sind die wichtigsten Namen hier, wobei Cline stärker auf vollständiges Agentenverhalten setzt als klassische Completion-Tools. Wer mehr Zeit in Editor-Tabs als in Shell-Fenstern verbringt, wird in dieser Kategorie von Claude-Alternativen fündig.

Verwaltete Cloud-Plattformen

Diese Gruppe richtet sich an alle, denen es wichtiger ist, schnell von der Idee zur fertigen App zu kommen, als lokale Kontrolle oder repo-lokales Agentenverhalten zu haben. Replit Agent ist das beste Beispiel für solche Aufgaben. Der geringere Setup-Aufwand geht dabei allerdings mit weniger Kontrolle einher als bei einem lokalen oder selbst gehosteten Ansatz.

Open-Source- und selbst gehostete Setups

Hier werden OpenCode und Continue besonders interessant. Du hast mehr Freiheit bei Modellen, Infrastruktur, Datenschutz und Kostenstruktur, trägst aber auch den Aufwand für Einrichtung und Feinabstimmung. Immer mehr Tools unterstützen inzwischen das Modellkontextprotokoll, was ein Grund dafür ist, dass der Wechsel zwischen Setups heute einfacher ist als noch vor einem Jahr.

Wenn du den Unterschied zwischen einem Coding-Agenten und einem breiteren selbst gehosteten Assistenten verstehen möchtest, hilft dir unser Opencode vs OpenClaw Artikel dabei deutlich weiter.

Die wichtigsten Claude Code Alternativen im Vergleich

Bevor wir jedes Tool im Detail besprechen, lohnt ein Blick auf die Übersicht. Die Tabelle unten ordnet die Tools nach Workflow, Self-Hosting-Option und den wichtigsten Abwägungen.

| Werkzeug | Geeignet für | Oberfläche | Offene Quelle | Lokal oder selbst gehostet | Wichtigster Kompromiss |

| OpenCode | Claude Code-ähnliche Workflows mit freier Modellwahl | Terminal, IDE, Desktop | Ja | Ja | Weniger ausgereift als die großen kommerziellen Stacks |

| Aider | Git-intensives Arbeiten im Terminal | Endgerät | Ja | Ja | Wirkt manueller als vollständige Agenten |

| Cline | Transparente, genehmigungsbasierte Agentenarbeit in VS Code | Entwicklungsumgebung | Ja | Ja | Kann bei großen Aufgaben unübersichtlich und teuer werden |

| Cursor | Ausgefeiltes Editor-zentriertes Coding | Entwicklungsumgebung | No | Kein lokaler Pfad verfügbar | An ein gehostetes Editor-Produkt gebunden |

| GitHub Copilot | Gängige Editor-Workflows mit freier Modellwahl | IDE, GitHub | No | Gehostet, nicht selbst gehostet | Nicht auf vollständige lokale Kontrolle ausgelegt |

| Gemini-Befehlszeilenschnittstelle | Günstige oder kostenlose Terminal-Experimente | Endgerät | Ja | Standardmäßig nicht selbst gehostet | Gutes Preis-Leistungs-Verhältnis, aber für viele Nutzer stark Google-zentriert |

| Weiter | Eigene lokale oder selbst gehostete Stacks | IDE, Terminal, CI | Ja | Ja | Erfordert mehr Einrichtungsaufwand als Plug-and-play-Tools |

| OpenAI Codex | Lokales Pairing kombiniert mit Cloud-Delegation | Terminal, IDE, Cloud-App | Ja, für CLI | Teilweise | Die besten Funktionen setzen auf OpenAIs breiteren Stack |

| Replit Agent | Schnelle verwaltete App-Erstellung | Browser-IDE | No | No | Schnell für verwaltete Prototypen, schwächer bei lokaler Repo-Kontrolle |

Top Claude Code Alternativen nach Workflow

Du hast den nötigen Überblick - jetzt zur Analyse Tool für Tool.

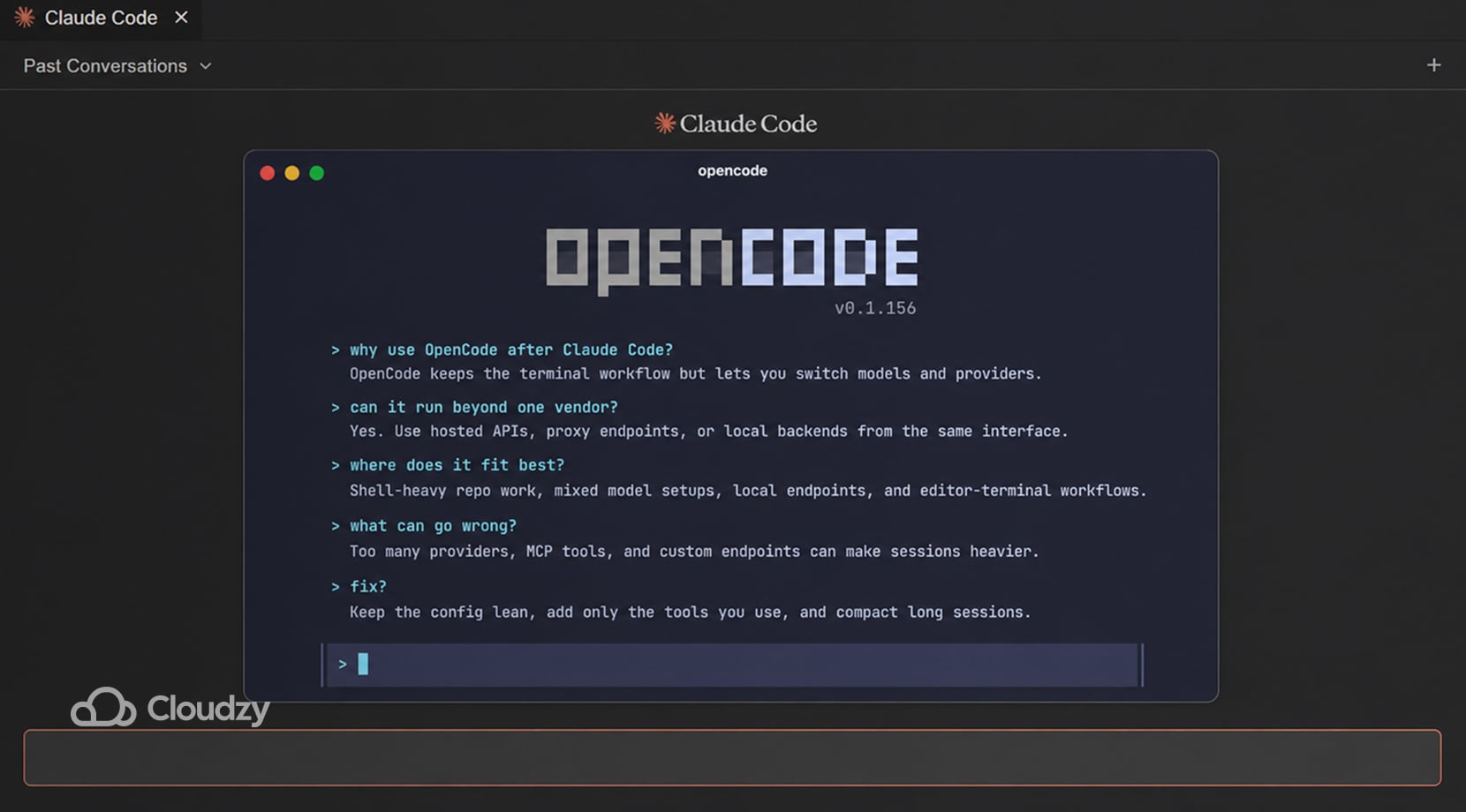

OpenCode

OpenCode eignet sich für Entwickler, die im Terminal arbeiten wollen, ohne sich dabei an einen einzigen Anbieter zu binden. Dasselbe Setup lässt sich auf gehostete APIs, Proxy-Endpunkte oder lokale Backends ausrichten - ein Modellwechsel bedeutet keinen Wechsel von Tools oder Gewohnheiten.

Im Editor wirkt es jedoch weiterhin wie ein Terminal-Agent, was für alle passt, die die Shell als zentrales Werkzeug behalten wollen.

Besonders gut funktioniert es in Setups, bei denen ein Modell die intensive Repo-Arbeit übernimmt, ein anderes günstigere Routineänderungen abdeckt und ein lokales Backend für private oder kostengünstige Aufgaben bereitsteht.

Der Schwachpunkt ist die Unübersichtlichkeit: Sobald die Konfiguration zu viele Anbieter, MCP-Server oder eigene Endpunkte enthält, wird die Session schwerer und das Setup verlangt ständige Bereinigung.

OpenCode's eigene MCP-Dokumentation weist darauf hin, dass MCP-Server und umfangreiche Tool-Oberflächen zusätzliche Tool-Definitionen in den Modell-Kontext einbringen können, was den Token-Verbrauch und die Latenz erhöhen kann.

- Gut geeignet für shell-lastige Repo-Arbeit mit mehr als einem Anbieter oder Modell im Einsatz

- Nützlich für eine einheitliche Oberfläche beibehalten, während das Backend dahinter wechselt

- Nützlich für gehostete APIs, lokale Endpunkte und Editor-Terminal-Nutzung in einem Setup kombinieren

- Wird nervig, wenn die Konfiguration schneller wächst als der Workflow

- Wird nervig, wenn große MCP-Toolsets zu viel Kontext in jeden Durchlauf bringen

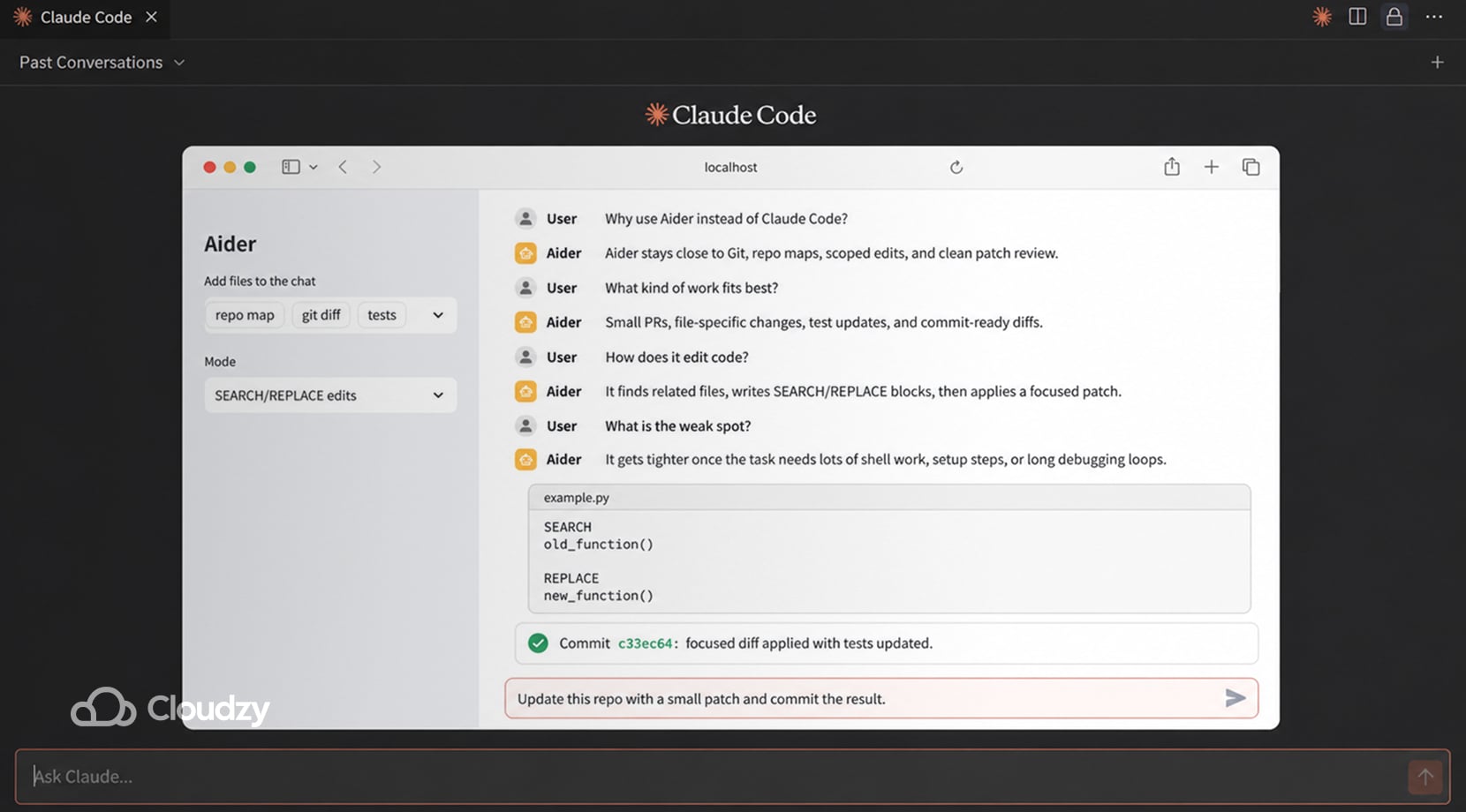

Aider

Aider arbeitet mit Repository-Maps, Diff-Edits und einem Git-freundlichen Patch-Workflow. Das Tool sendet dem Modell eine strukturelle Übersicht der Dateien und Symbole und wendet dann gezielte Such-und-Ersetzen-Änderungen an, anstatt ganze Dateien neu zu schreiben. In Repositories mit intensiven Code-Reviews entstehen dadurch oft kleinere PRs, weniger unnötige Rewrites und eine Commit-Historie, die sich leichter nachvollziehen lässt.

Am besten funktioniert es bei klar abgegrenzten Aufgaben – zum Beispiel: diese Dateien anpassen, diese Logik ändern, die Tests aktualisieren und das Ergebnis committen.

Beachte jedoch: Sobald eine Aufgabe in Build-Setup, Terminal-Orchestrierung, Browser-Checks oder lange Debugging-Schleifen übergeht, wird der Workflow enger, da Aider die Interaktion nah am eigentlichen Code-Change hält.

- Good geeignet für Git-intensive Repositories, review-orientierte Teams und klar abgegrenzte Code-Änderungen.

- Praktisch für Repo-Map-Kontext, diff-basierte Änderungen, automatische Commits und präzisere Patch-Kontrolle.

- Verliert seinen Reiz bei Aufgaben, die ständig zwischen Code, Shell, Setup und Debugging hin- und herspringen.

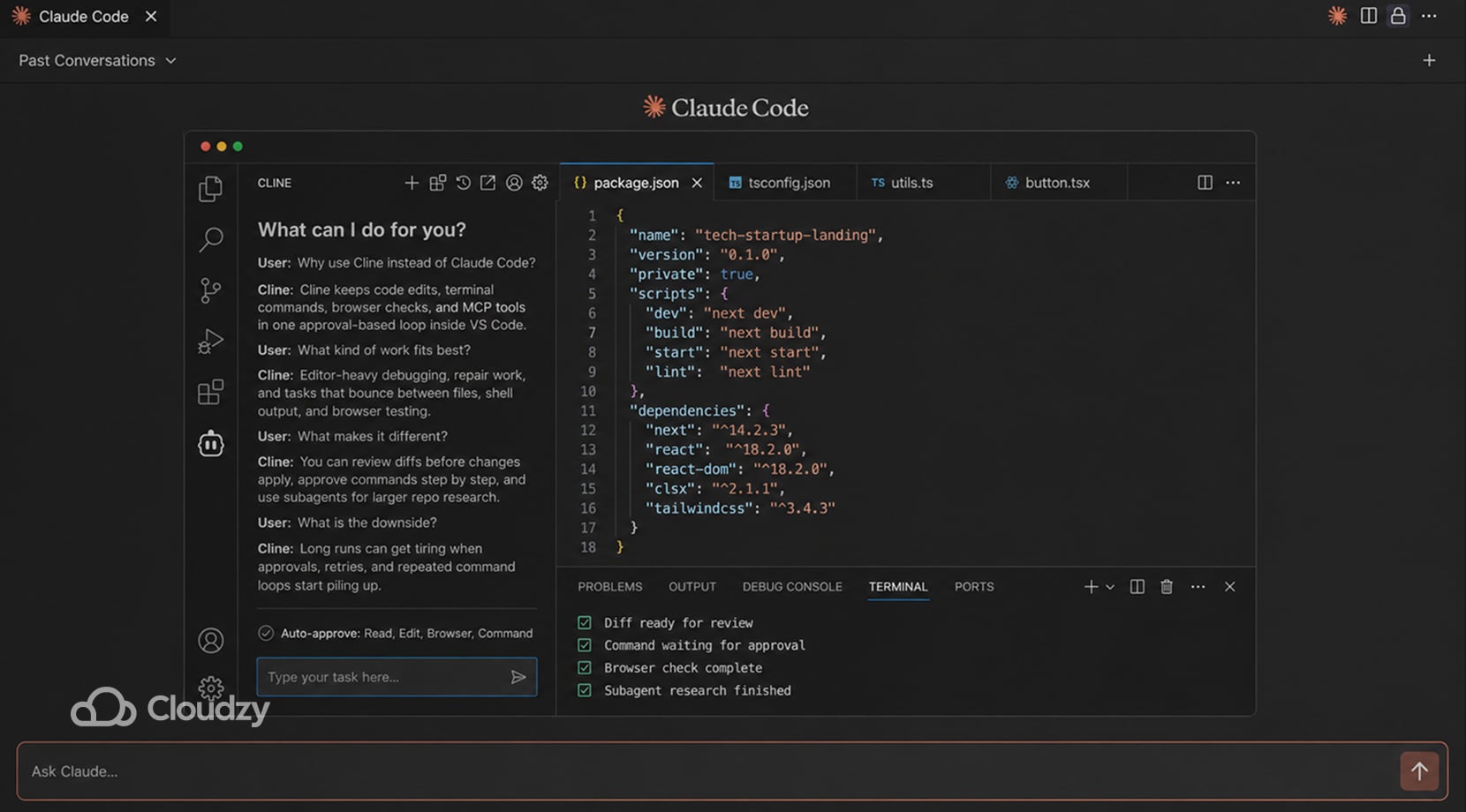

Cline

Cline läuft direkt in VS Code und führt Dateiänderungen, Shell-Befehle, Browser-Aktionen und MCP-Tools in einem einzigen, bestätigungsbasierten Workflow zusammen – Diffs werden vor der Anwendung angezeigt, Befehle warten auf deine Freigabe.

Außerdem unterstützt es schreibgeschützte Subagenten, die bei der Repository-Recherche und parallelen Analyse nützlich sein können. Als vollwertige Worker-Agenten lassen sie sich jedoch nicht bezeichnen, da sie weder Patches anwenden, Dateien schreiben, den Browser nutzen noch MCP-Tools aufrufen können.

Es eignet sich gut für intensives Debugging, bei dem man ständig zwischen Code, Terminal-Ausgabe und Browser-Checks wechselt.

Diese Stärke kann zur Schwäche werden: Bei längeren Reparaturketten verlangsamt sich das System, sobald es in Schleifen aus wiederholten Genehmigungen, Befehlswiederholungen oder Patch-Anwendungen gerät.

- Good geeignet für editor-geführte Fehlerbehebung, Korrekturen und browsergestützte Prüfungen in VS Code

- Nützlich für sichtbare Diffs, Befehlsbestätigung, MCP-Tools und Subagents in größeren Repositories

- Wird bei langen Schleifen mit wiederholten Bestätigungen oder instabilem Befehls- und Ausgabe-Handling ermüdend

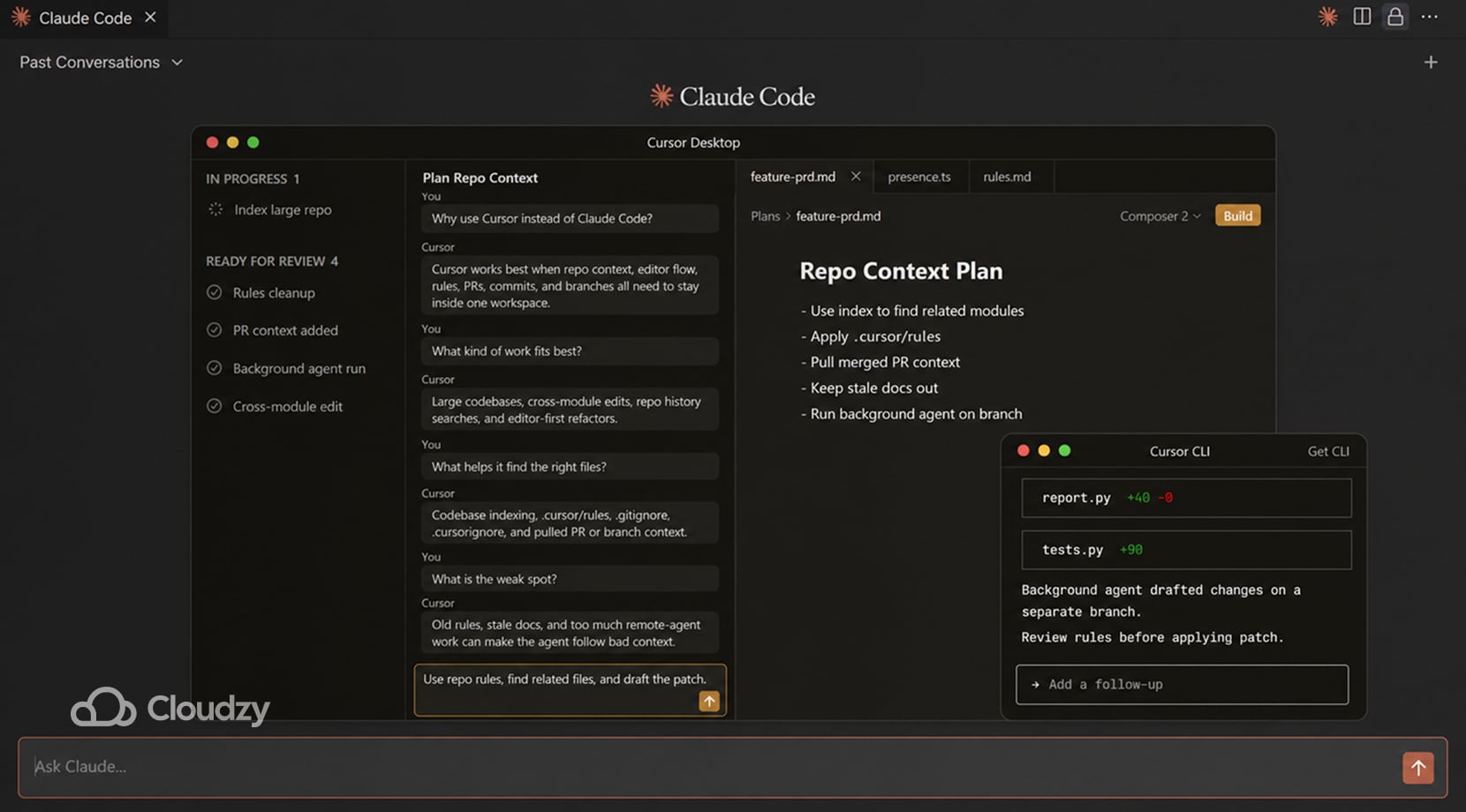

Cursor

Cursor ist für komplexe Repositories ausgelegt und nutzt Merkle-baum-basiertes inkrementelles Indexing, um einen semantischen Vektorspeicher aktuell zu halten. Multi-Root-Workspaces und git-Event-Trigger werden unterstützt, aber die Treffsicherheit ist am höchsten, wenn der indexierte Bereich über .cursorignore manuell eingeschränkt wird, um die Dateianzahl in einem handhabbaren Rahmen zu halten.

Außerdem werden Projektregeln in .cursor/rules, damit Konventionen und Workflow-Hinweise direkt im Repo gespeichert bleiben, statt in den lokalen Einstellungen einzelner Personen zu verschwinden.

Bei größeren Codebases reduziert das den Aufwand beim Dateiverschieben und wiederholte "Lies diese Ordner zuerst"-Prompts. Das Ergebnis: Eine schlanke Rules-Datei und ein sauberer Index halten besser stand als ein Berg alter Markdown-Anweisungen.

Sobald sich allerdings Regeln, AGENTS-Dateien und Ad-hoc-Kontextdokumente anhäufen, muss der Agent immer mehr Material verarbeiten und stolpert häufiger über veraltete Anweisungen.

Darüber hinaus gehen Cursors Hintergrund-Agenten noch einen Schritt weiter: Sie klonen das Repo auf eine Remote-Ubuntu-Maschine, führen Install- und Startbefehle aus und arbeiten auf separaten Branches.

Das hilft bei längeren Aufgaben, verlagert aber einen Teil des Workflows aus dem lokalen Editor in die Remote-Ausführung.

- Good eignet sich für redaktionell geführte Arbeit in Repos mit umfangreicher History, etablierten Konventionen oder modulübergreifenden Änderungen.

- Praktisch für die Indexierung von Codebases, die Suche in Pull Requests, repo-spezifische Regeln und Remote-Hintergrundläufe.

- Wird mühsam, wenn das Repository sich mit veralteten Anweisungen füllt oder der Workflow zu stark auf Remote-Agents angewiesen ist.

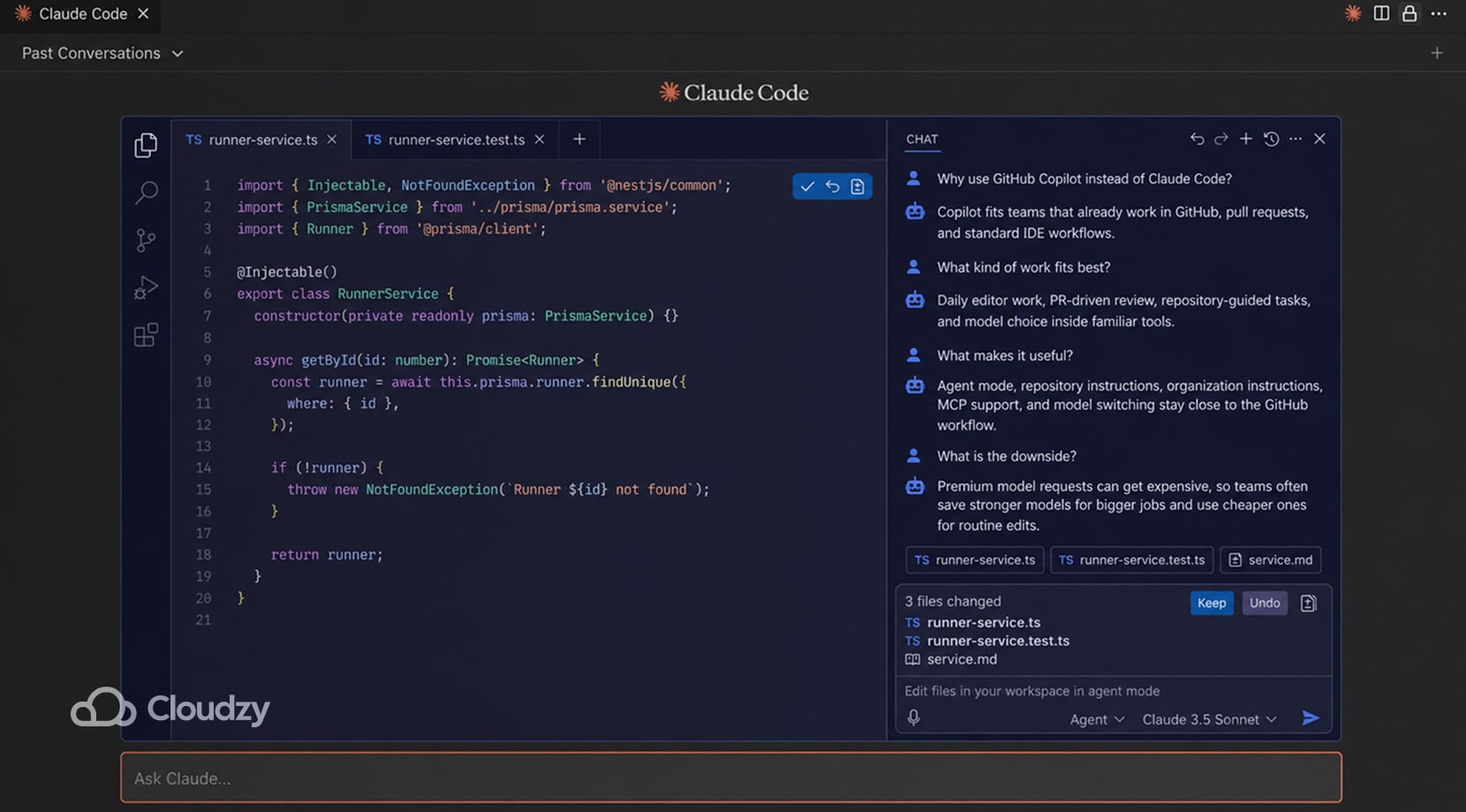

GitHub Copilot

GitHub Copilot passt zu Teams, die bereits mit GitHub, Pull Requests und gängigen IDEs arbeiten. Der Agent-Modus kann Dateien auswählen, Terminal-Befehle vorschlagen und Aufgaben innerhalb der gewohnten Tools zu Ende führen.

Dazu kommen Repository-Anweisungen, Organisations-Anweisungen, MCP-Unterstützung und Modellwechsel – das hält einen Großteil der Konfiguration im selben Stack, ohne dass man in eine separate Coding-Umgebung wechseln muss.

Das eigentliche Problem zeigt sich mit der Zeit beim Modell-Pricing im Workflow. Copilot verbraucht Premium-Anfragen für stärkere Modelle, und der Multiplikator variiert je nach Modell. Das zwingt Teams dazu, die teuren Modelle für größere Refactorings, schwierigeres Debugging oder längere Agent-Läufe aufzusparen und bei kleineren Änderungen und schnellen Fragen auf günstigere Standardmodelle zurückzufallen.

Das Produkt passt nach wie vor gut in GitHub-lastige Workflows, aber die Anfragekosten können die Prompting-Gewohnheiten einschränken, sobald die Nutzung steigt.

- Gut geeignet für GitHub-lastige Teams, PR-getriebene Reviews und editorbasierte Tagesarbeit.

- Nützlich für Agent-Modus, Modellwechsel, Repository-Anweisungen und die enge Anbindung von KI-Arbeit an den bestehenden GitHub-Workflow.

- Wird lästig, wenn die Kosten für Premium-Anfragen bestimmen, welches Modell sich für kleinere Aufgaben noch lohnt.

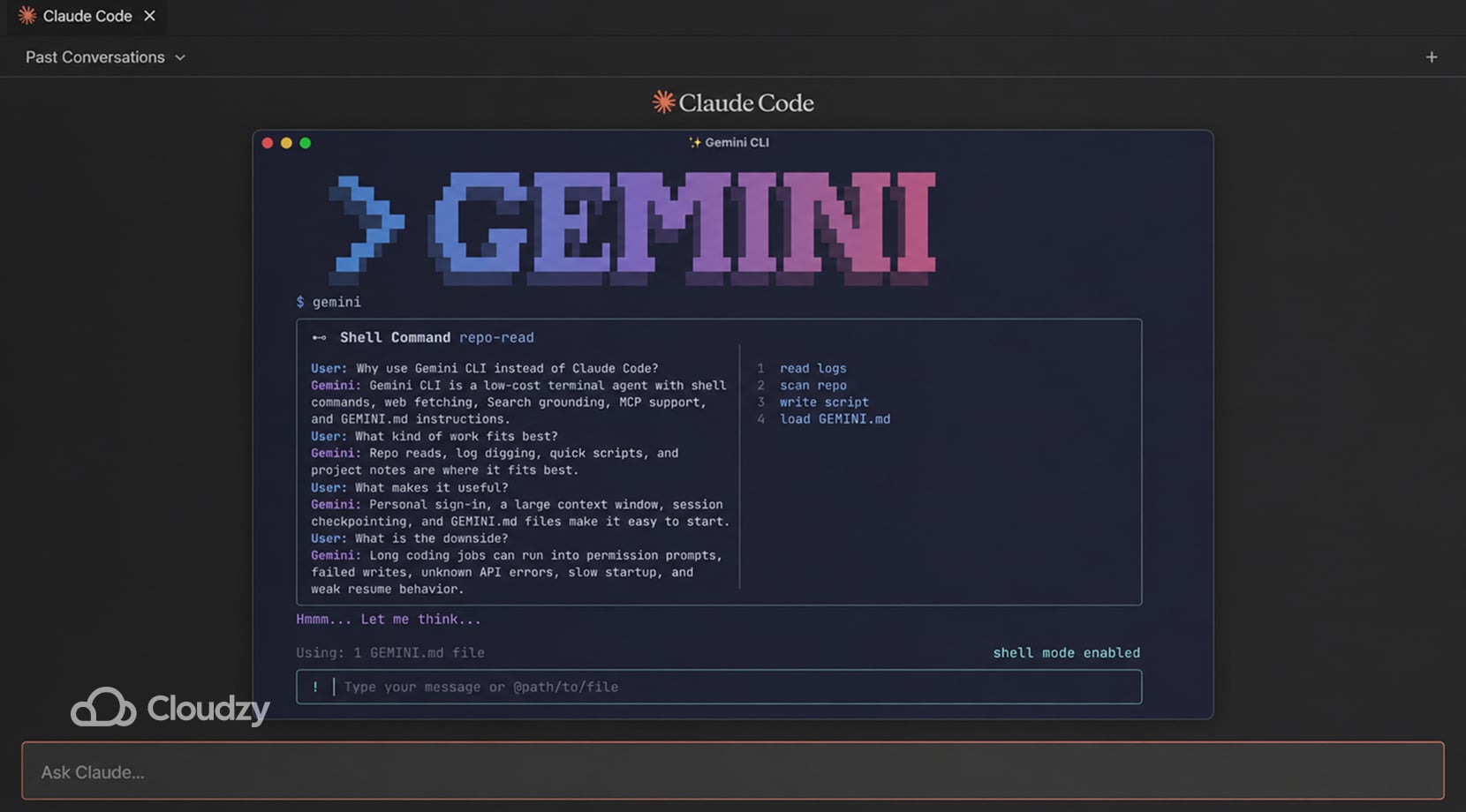

Gemini-Befehlszeilenschnittstelle

Gemini CLI läuft im Terminal und erfordert kaum Einrichtungsaufwand.

Google stellt es als Open-Source-Agent bereit, mit Shell-Befehlen, Web-Fetching, Search-Grounding, MCP-Unterstützung, Session-Checkpointing und GEMINI.md Dateien, die Anweisungen aus globalem, Workspace- und Verzeichnis-Scope laden können. Dazu kommt: Mit einem persönlichen Google-Login sind ein kostenloses Kontingent und Zugang zu Gemini-Modellen mit einem 1-Million-Token-Kontextfenster inbegriffen. Das macht es nützlich für Repository-Analysen, Log-Auswertungen, schnelle Skripte und Projektnotizen.

Bei längeren Coding-Aufgaben zeigen sich jedoch Schwächen, mit aktuellen Berichten die wiederholte Berechtigungsabfragen, fehlgeschlagene Datei-Schreibvorgänge trotz erteilter Berechtigungen, unbekannte API-Fehler, langsamen Start, übermäßig lange Ausführungszeiten für einfache Aufgaben und Probleme beim sauberen Fortsetzen von Gesprächen beschreiben.

Ein großes Kontextfenster hilft beim Lesen mehrerer Dateien, gleicht aber keine wackelige Tool-Ausführung oder längere Reparaturketten aus.

- Gut geeignet für Shell-seitige Repository-Analysen, Logs, einmalige Skripte und leichtere Coding-Aufgaben.

- Nützlich für großes Kontext-Leseverhalten, GEMINI.md-Projektanweisungen, MCP-Erweiterungen und schnellen Terminal-Zugriff.

- Schwächt sich bei längeren Multi-Datei-Reparaturarbeiten, wiederholtem Tool-Einsatz und Sessions ab, die ein sauberes Fortsetzen benötigen.

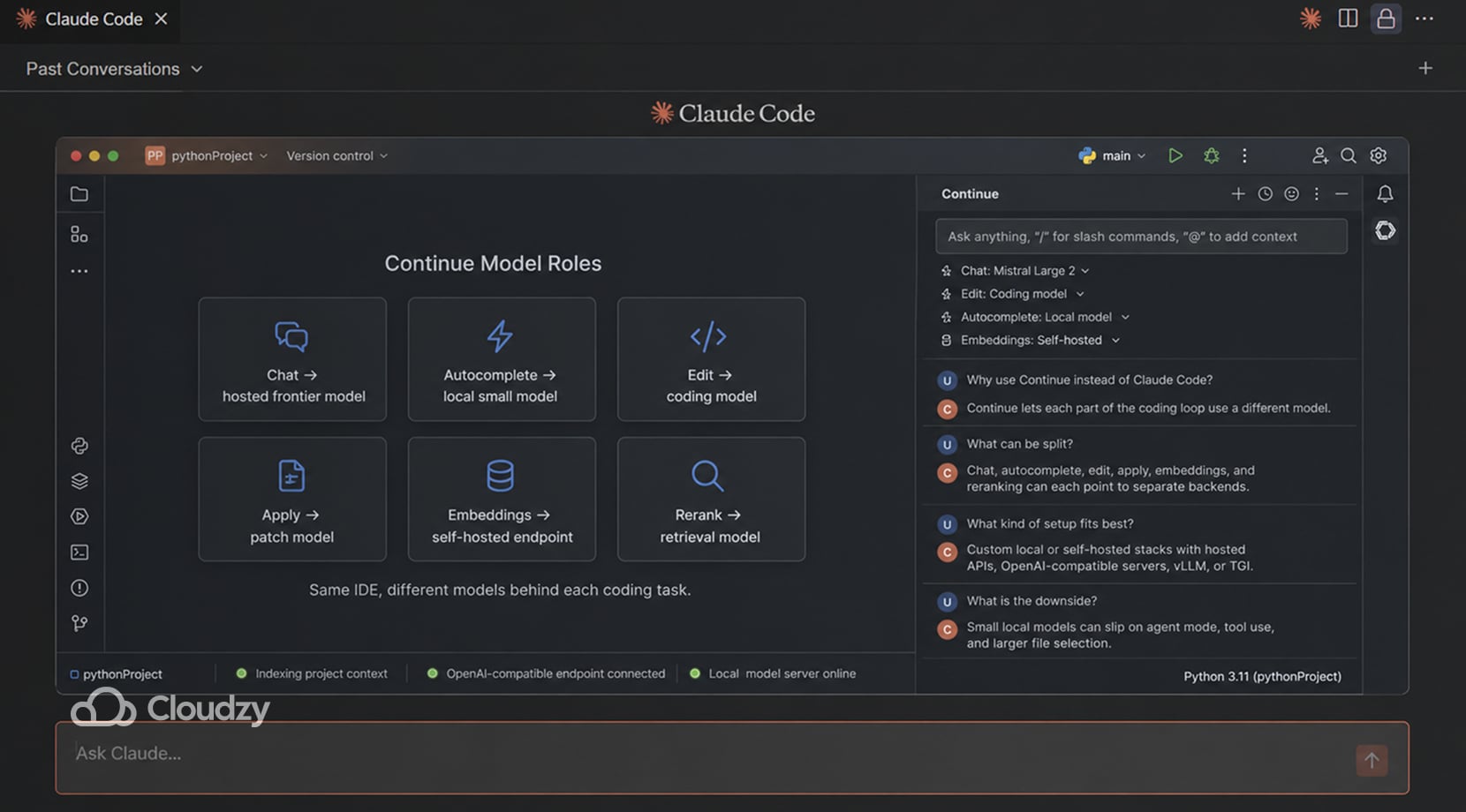

Weiter

Continue eignet sich für Setups, bei denen verschiedene Teile der Coding-Schleife unterschiedliche Modelle benötigen. Es ermöglicht, separate Rollen für Chat, Autovervollständigung, Bearbeitung, Anwendung, Embeddings und Reranking zuzuweisen und diese Rollen auf gehostete APIs, OpenAI-kompatible Server oder selbst gehostete Backends zu zeigen.

Die Self-Hosting-Anleitung umfasst Backends wie vLLM, Hugging Face TGI und andere OpenAI-kompatible Endpunkte, sodass die Continue-Extension bestehen bleiben kann, während der dahinterliegende Modell-Server ausgetauscht wird.

Dieses Setup ist für Teams nützlich, die die Coding-Schleife auf verschiedene Modelle aufteilen, zum Beispiel ein Modell für Chat, ein kleineres für Autovervollständigung und ein weiteres für die Bearbeitungsanwendung oder die Vektorsuche.

Beachte dabei: Lokale Stacks, die auf kleineren Coding-Modellen aufbauen, sind für Agenten-Aufgaben weniger zuverlässig. Agent-Modus und Tool-Nutzung sind meistens die ersten Stellen, an denen sie schwächeln – mit übersprungenen Schritten, nicht aufgerufenen Tools oder falschem Kontext.

Aktuell LocalLLaMA-Diskussionen beschreiben dasselbe Problem in Continue-ähnlichen lokalen Setups. Kleinere Modelle kommen mit Chat und einfachen Bearbeitungen zurecht, verlieren aber deutlich schneller an Zuverlässigkeit, sobald Agent-Modus, Tool-Calling oder breiterer Dateizugriff ins Spiel kommen.

- Good geeignet für individuelle Stacks mit getrennten Modellen für Chat, Autovervollständigung, Bearbeitung und Retrieval.

- Nützlich für OpenAI-kompatible Server, selbst gehostete Endpunkte und den Wechsel zwischen Anbietern, ohne den Editor-Workflow zu verändern.

- Schwächelt, sobald das lokale Backend für Tool-Nutzung, Agent-Modus oder größere Dateiauswahl zu klein ist.

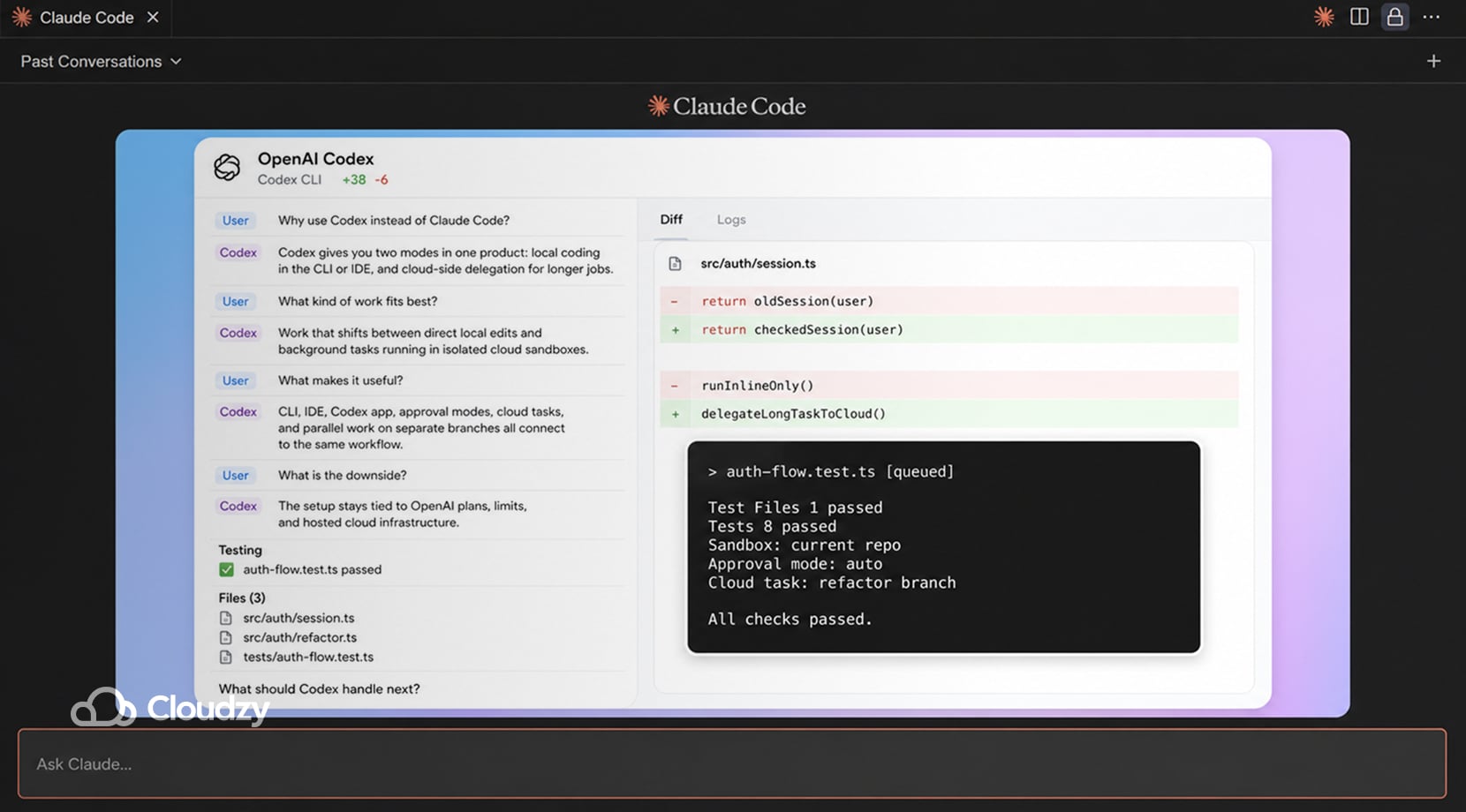

OpenAI Codex

OpenAI Codex eignet sich für Entwickler, die zwei Modi in einem Produkt wollen: lokales Pair-Programming in der CLI oder IDE und Cloud-seitige Delegation für längere Aufgaben. OpenAI positioniert Codex aktuell über CLI, IDE-Extension, Codex-App und Codex Cloud – Cloud-Tasks laufen in isolierten Sandboxen mit Repo-Anbindung, während lokale Arbeit in der eigenen Umgebung bleibt.

Außerdem trennt Codex Sandboxing von Freigaben. Die Sandbox steuert Datei- und Netzwerkzugriff, während die Freigabe-Einstellungen festlegen, wann Codex vor einer Aktion pausieren muss. In einem Workspace-Write-Setup kann Codex innerhalb des aktuellen Workspaces bearbeiten – Netzwerkzugriff und Aktionen außerhalb des Workspaces hängen aber weiterhin von den gewählten Einstellungen ab.

Dieses Setup passt für Arbeit, die ständig zwischen direkten Bearbeitungen und Hintergrundaufgaben wechselt. Eine lokale Session kann das Repo prüfen, Dateien patchen und Befehle ausführen – ein Cloud-Task kann währenddessen einen längeren Fix oder PR-Entwurf abarbeiten, ohne das Terminal offen zu halten.

OpenAI hat Codex mit der Codex-App, integrierten Worktrees und Multi-Agent-Verwaltung außerdem stärker in Richtung parallele Arbeit weiterentwickelt.

Cloud-Tasks sind praktisch, aber das Setup bleibt an OpenAIs Pläne, Limits und die gehostete Umgebung gebunden. Für manche Teams ist das in Ordnung – andere nutzen Codex nur noch für Cloud-seitige Aufgaben und verlagern Teile des Coding-Prozesses zurück in lokale Tools, um mehr Kontrolle darüber zu haben, wie die Session läuft und wie weit sie sich treiben lässt.

- Good geeignet für lokales Coding kombiniert mit delegierten Hintergrundaufgaben.

- Nützlich für Freigabe-Modi, IDE- und CLI-Abdeckung, Cloud-Sandboxen und parallele Arbeit über die App.

- Wird zum Problem, wenn der gesamte Workflow außerhalb der Pläne, Limits und der Cloud-Umgebung eines einzigen Anbieters bleiben soll.

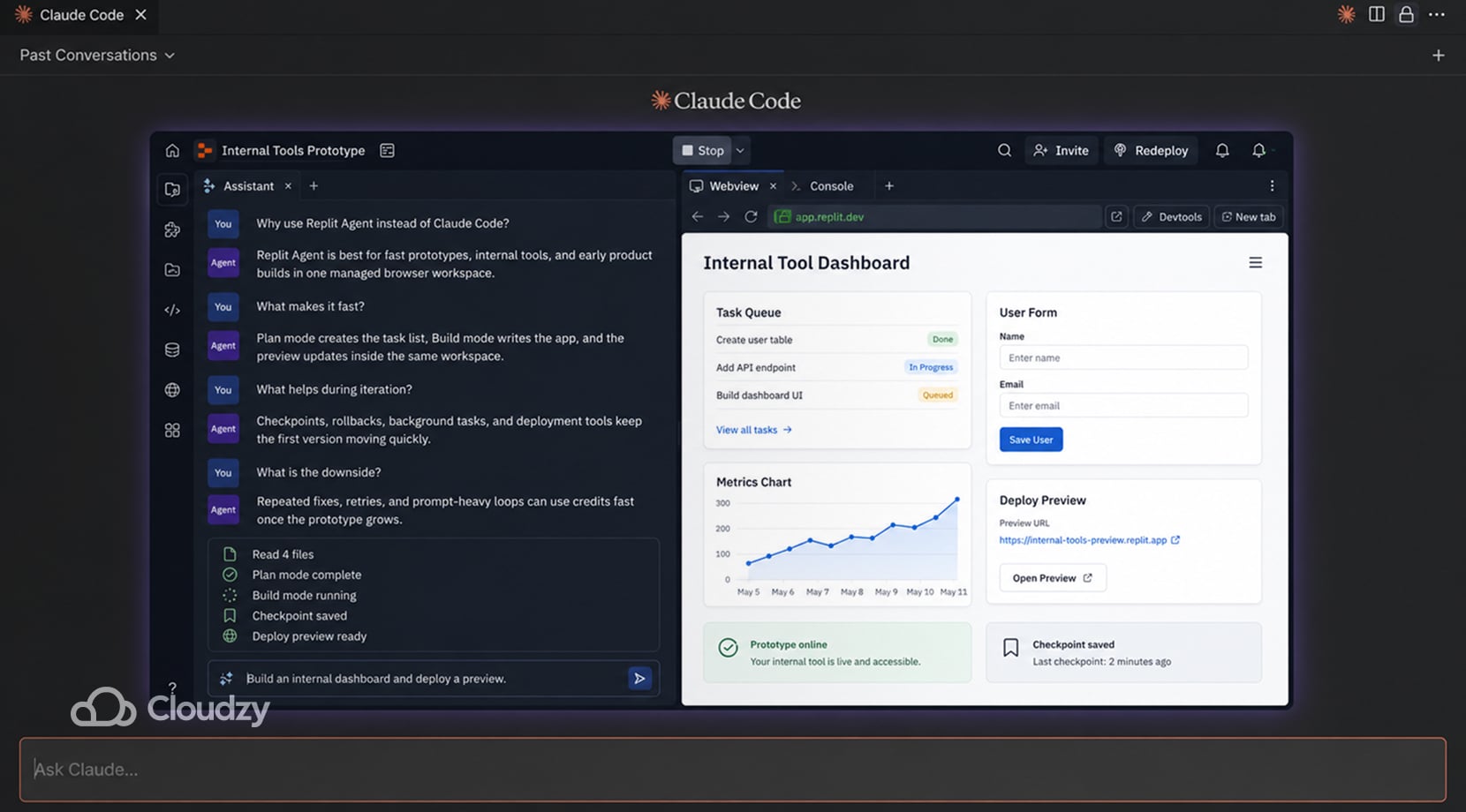

Replit Agent

Replit Agent eignet sich für schnelle Prototypen, interne Tools und frühe Produktversionen, bei denen Coding, Hosting und Deployment an einem Ort zusammenlaufen.

Die aktuellen Replit-Docs zeigen Plan-Modus für Aufgabenlisten und Architekturfragen vor Code-Änderungen, Build-Modus für die Implementierung, automatische Checkpoints und Rollbacks sowie ein Task-System, das Hintergrundarbeit in separaten Threads mit planbasierten Concurrency-Limits ausführen kann.

Es ist leicht nachvollziehbar, warum viele es immer wieder ausprobieren: Von der Idee zu etwas Anklickbarem kommt man sehr schnell – besonders wenn die Aufgabe noch unscharf und der Stack noch nicht festgelegt ist.

Der Nachteil macht sich bemerkbar, sobald das Projekt kein grober Prototyp mehr ist und wiederholte Fixes, promptlastige Iterationen oder Multi-Agent-Arbeit erfordert. Replit ist stark darin, einen Prototypen schnell online zu bringen – aber wiederholte Fixes, promptlastige Iterationen und Multi-Agent-Arbeit können die Credits schnell in die Höhe treiben.

Meistens ist das der Punkt, an dem Teams beginnen, Prompts zu reduzieren und die schwerere Coding-Arbeit nach Cursor, VS Code oder ein anderes lokales Setup zu verlagern – während sie Replit weiterhin für Hosting, Demos oder frühe Validierung nutzen.

- Good geeignet für Prototypen, interne Apps und schnelle Produktvalidierung in einer verwalteten Browser-Umgebung.

- Nützlich für die Planung vor Änderungen, Hintergrundaufgaben, Checkpoints, Rollbacks und das schnelle Bereitstellen einer fertigen App.

- Wird teuer, sobald der Workflow viele Wiederholungen, kleine Korrekturen oder wiederholte Prompt-Schleifen umfasst.

SaaS vs. selbst gehostete KI-Coding-Tools

Kurz gesagt stellen sich zwei Fragen: Willst du ein gehostetes Produkt nutzen, oder willst du mehr Kontrolle über den Stack behalten? Um das zu beantworten, musst du ernsthaft abwägen, was diese Entscheidungen konkret bedeuten. Ich habe die wichtigsten Punkte in der Tabelle unten hervorgehoben.

| Faktor | SaaS-Tools | Selbst gehostete oder lokal betriebene Tools |

| Einrichtungszeit | Schnell | Langsamer |

| Modellauswahl | Manchmal breit, manchmal eingeschränkt | In der Regel größer, wenn du es richtig aufsetzt |

| Datenschutz und Code-Kontrolle | Abhängig von den Anbieter-Bedingungen | Bessere Kontrolle über die Laufzeitumgebung; der Datenschutz des Modells hängt vom gewählten Backend ab |

| Einstiegsnutzbarkeit | Besser | Holpriger |

| Langfristige Flexibilität | Geringer | Größer |

| Betriebsaufwand | Niedrig | Liegt bei dir |

Die Tabelle zeigt: SaaS ist einfacher einzurichten und erfordert im täglichen Betrieb weniger vom Team. Ein selbst gehostetes Setup gibt dir mehr Kontrolle über den Stack, die Hardware und die Modellwahl.

Wenn die Kosten für API steigen oder dein Team zuverlässigeren Zugriff auf Rechenkapazität braucht, ist unser Cloud GPU vs. Dedicated GPU VPS Vergleich der sinnvollere nächste Schritt als ein weiterer Tools-Überblick.

Warum selbst gehostete KI-Coding-Tools immer mehr Entwickler anziehen

Entwickler – und eigentlich die meisten von uns – haben irgendwann genug von immer mehr Abonnements, von den Einschränkungen einzelner Anbieter und davon, dass jede längere Session zum Kostenproblem werden könnte.

Datenschutzbedenken spielen dabei ebenfalls eine Rolle, vor allem wenn proprietärer Code nicht für jeden Workflow an mehrere externe Dienste übertragen werden soll.

Lokale Modelle halten beim Chatten noch gut mit, aber Coding-Agent-Aufgaben fordern deutlich mehr von ihnen. Tool-Aufrufe, lange Prompts, Parser-Eigenheiten und Hardware-Grenzen machen sich schnell bemerkbar, sobald das Modell dateiübergreifend arbeitet und längere Aufgaben zusammenhalten muss.

Das alles führt zu dem Punkt, dass ein hybrider Ansatz oft die bessere Wahl ist. Ein Entwickler könnte ein gehostetes Frontier-Modell für anspruchsvolle Repo-Arbeit nutzen, ein günstigeres Modell für Routineänderungen, und ein lokales oder VPS-gestütztes Setup für datenschutzsensible oder dauerhaft laufende Workflows.

Wenn du die lokale Runtime-Seite dieser Entscheidung noch klärst, lohnt sich unser Ollama vs LM Studio Vergleich als hilfreicher Zwischenschritt.

So führst du Claude-Code-Alternativen auf deinem eigenen Rechner oder einem VPS aus

Ein lokales Setup reicht bis zu einem gewissen Punkt aus: Für kleinere Repos, kürzere Sessions und grundlegende Datenschutzanforderungen kann ein Laptop genügen. Werden die Sessions jedoch länger oder muss das Modell mehr als chatten, wird RAM knapp, der Kontext wird gekürzt, Tool-Aufrufe laufen aus dem Ruder, und Aufgaben dauern deutlich länger als sie sollten.

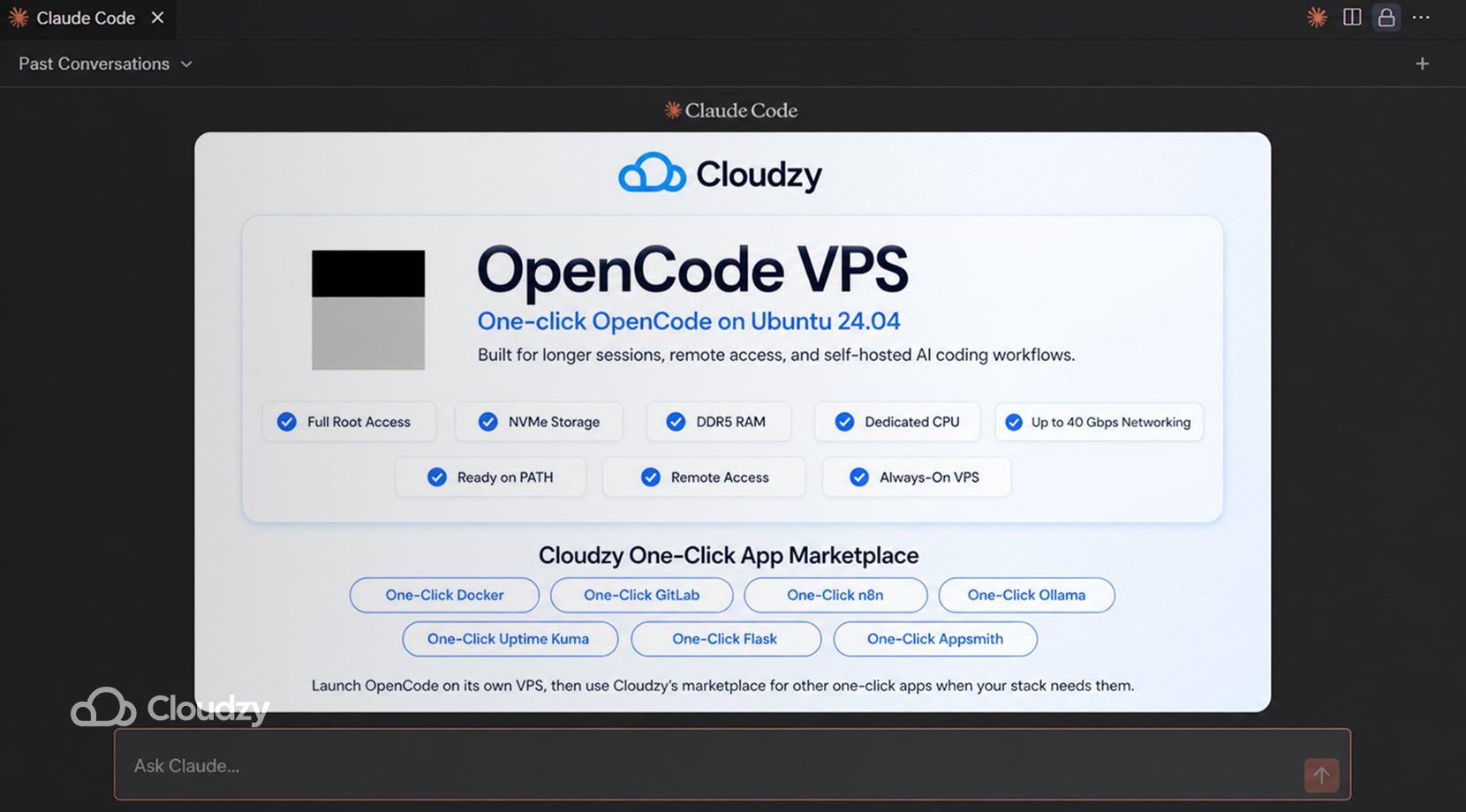

OpenCode auf einem VPS zu betreiben erhält den selbst gehosteten Workflow, ohne ihn an einen einzigen Anbieter zu binden oder auf dem eigenen Rechner zu beengen.

Cloudzys Ein-Klick OpenCode VPS nimmt dir die Einrichtung praktisch ab: OpenCode ist auf Ubuntu 24.04 bereits installiert, im PATH eingetragen und sofort einsatzbereit – du verlierst keine Zeit damit, die Umgebung erst nutzbar zu machen, bevor du eigentlich anfangen kannst.

Du gewinnst damit nicht nur eine schnellere Einrichtung, sondern auch längere Sessions, mehrere Repos, paralleles Arbeiten und Remote-Zugriff ohne Unterbrechungen – weil die Maschine dauerhaft läuft und nicht mit deinen lokalen Ressourcen konkurriert.

Unsere VPS-Dienste bieten vollständigen Root-Zugriff, NVMe-Speicher, DDR5 RAM, dedizierte Ressourcen und bis zu 40 Gbps Netzwerkanbindung – damit wird dein Setup nicht zum Flaschenhals, wie es ein Laptop früher oder später wird.

Und da OpenCode meistens nicht das Einzige ist, was läuft, unser Marketplace deckt bereits viele der gängigen Tools und Apps ab, die du benötigen könntest. Wir haben über 300 One-Click-Apps, darunter Docker, GitLab, n8n, Ollama, Uptime Kuma, Flask und Appsmith – die musst du also ebenfalls nicht manuell installieren!

Welche Alternative für welchen Entwickler passt

Eines ist klar: Es gibt nicht die eine beste Alternative zu Claude Code. Hier ist eine Übersicht, welche Alternative ich für wen empfehle:

- Wähle ein terminal-orientiertes Tool, wenn du hauptsächlich in der Shell arbeitest: OpenCode, Aider, Gemini CLI oder Codex CLI.

- Wähle ein editor-orientiertes Tool, wenn der Großteil der Arbeit in VS Code-ähnlichen Workflows stattfindet: Cline, Cursor oder Copilot.

- Wähle Continue, wenn das Hauptziel ein benutzerdefiniertes Modell- oder Backend-Setup ist.

- Wähle Replit Agent, wenn es um schnelles, verwaltetes Prototyping geht und nicht um lokale Repository-Kontrolle.

Behalte aber im Hinterkopf, dass die meisten Entwickler mehrere dieser Tools gleichzeitig nutzen – so läuft das heutzutage nun mal.

Abschließende Gedanken zu den besten Claude Code-Alternativen

Claude Code ist nach wie vor stark, muss aber nicht mehr das einzige Tool im Workflow sein. Die bessere Wahl hängt davon ab, wo die Arbeit stattfindet: im Terminal, im Editor, in einem Cloud-Workspace oder auf einem selbst gehosteten Stack.

Für Entwickler, die OpenCode ohne manuelles Server-Setup nutzen möchten, Cloudzy's One-Click OpenCode VPS liefert dir eine fertig eingerichtete Ubuntu 24.04-Umgebung mit vorinstalliertem OpenCode – und genug Spielraum, um deinen restlichen Dev-Stack später hinzuzufügen.