Ha úgy döntesz H100 versus RTX 4090 AI-hoz tartsd szem előtt: a legtöbb "benchmark" addig nem lényeges, amíg a modelled és a cache ténylegesen nem fér be a VRAM-be. Az RTX 4090 az ideális választás egyetlen GPU-es munkához, amely 24 GB alatt marad.

Az H100 akkor a jó választás, ha nagyobb modellekre, magasabb párhuzamosságra, többfelhasználós izolációra van szükséged, vagy egyszerűen nem akarod az memória kezelésével bajlódni.

Felosztom munkafolyamatok szerint, bemutatom a benchmarkolás típusait, majd adok egy gyors teszttervet, amit saját infrastruktúrádon futtatni tudsz.

Gyors válasz: H100 vagy RTX 4090 AI-feladatokhoz

H100 nagy modellek tanítása és éles szervírozása terén nyújt előnyöket, mivel nagyon nagy HBM-kapacitást, rendkívül széles memóriasávszélességet, NVLink-et és MIG-et biztosít az elkülönítéshez. RTX 4090 jó választás, ha azt mondod magadnak: "nagy single-core teljesítményre van szükségem, de kedvezőbb áron" – feltéve, hogy a munkaterhelésed elég a 24 GB-ba kompromisszumok nélkül. A specifikációk és platform funkciók ezt elég egyértelművé teszik.

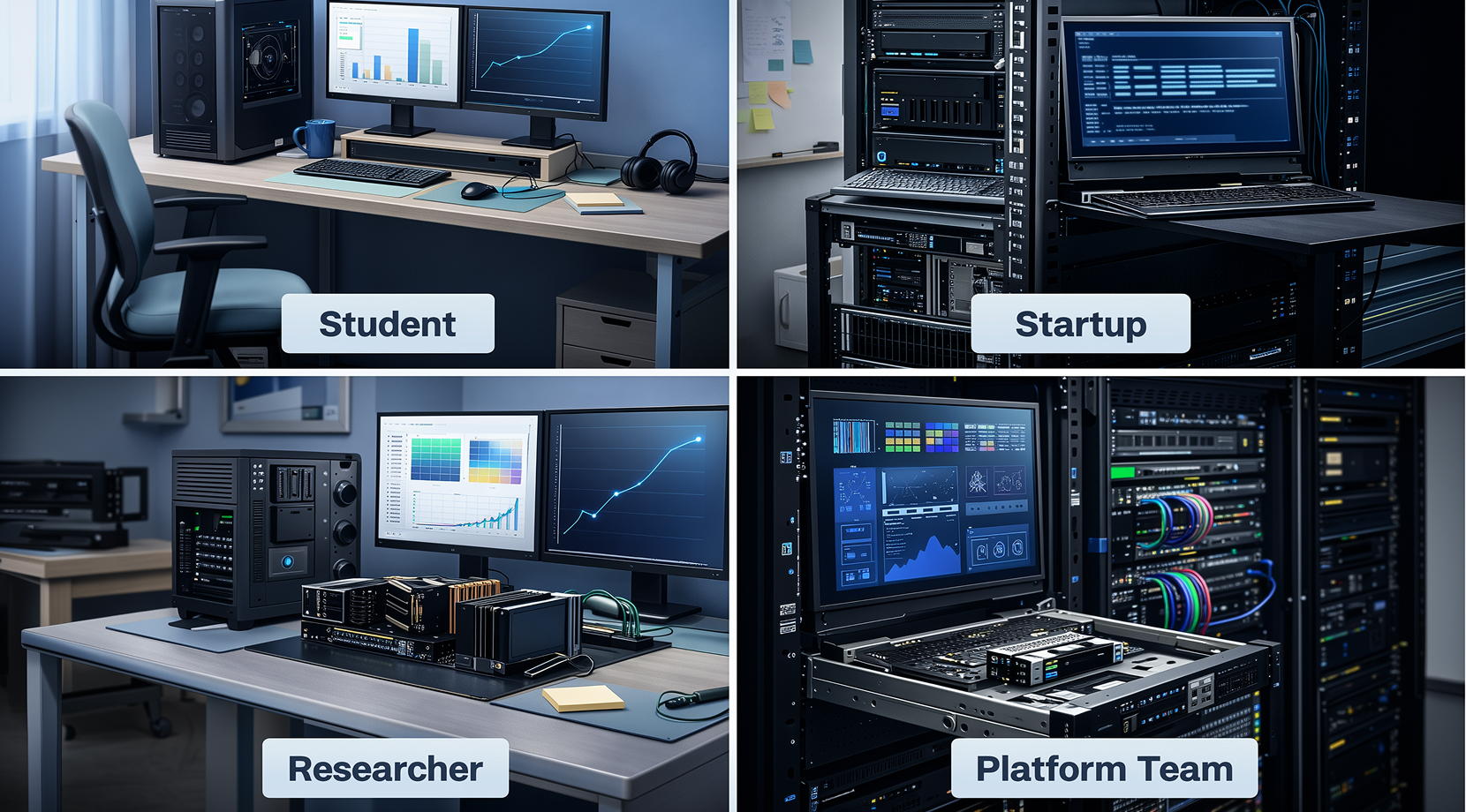

Itt van a gyors kiválasztási lista szerepkör szerint:

- Helyi LLM Builder (Solo Dev / Student): RTX 4090 amíg VRAM nem válik szűk keresztmetszetté.

- Startup ML mérnök (MVP közzétételre készülve): RTX 4090 kezdeti fázisban, kísérletezéshez és finomhangoláshoz. H100, ha stabil terheléskezelésre vagy nagyobb modellek futtatására van szükséged.

- Applied Researcher (Sok kísérlet): H100 ha folyamatosan OOM hibákba, batch korlátokba vagy hosszú kontextusokba ütkőzöl.

- Termelési / Platform csapat (multi-tenant szolgáltatás): H100 MIG szeleteléshez, nagyobb játéktérhez és sima skálázáshoz.

Ezzel az alapokkal a cikk további része a valós helyzetben felmerülő korlátokról és arról szól, hogy a mérési számok hogyan illeszkednek azokhoz.

Az egyetlen benchmark kérdés, amit érdemes vizsgálni: Mit kell elfér a VRAM-ben?

A legtöbb vita a témáról H100 versus RTX 4090 technikailag VRAM-vel kapcsolatos. LLM munkában a VRAM-t felhasználja súlyok, aktiválások edzés közben, optimalizáló állapotok tanítás közben, és a KV gyorsítótár következtetéskor. Ez utóbbi az, amit az emberek általában nem számítanak, mert a kontextus hossza és konkurenciája növeli.

Az alábbi táblázat szándékosan magas szintű, mert a pontos illeszkedés a keretrendszertől, a pontosságtól és a terheléstől függ.

Itt az "elfér-e gond nélkül?" nézet:

| Munkaterhelés | Tipikus egyetlen GPU valóság az RTX 4090-en (24 GB) | Tipikus egyetlen GPU valóság az H100-en (80–94 GB) |

| 7B LLM következtetés (FP16 / BF16) | Általában rendben | Kényelmes fejlettség |

| 13B LLM következtetés | Gyakran szűk, a kontextustól függ | Általában rendben |

| 70B-class inference | Erős kvantizációra vagy eltárolásra van szükség | Sokkal realistikusabb |

| SD/SDXL következtetés + kisebb köteg | Általában rendben | Rendben, plusz több köteghez szükséges játéktér |

| Szolgáltatás magasabb konkurenciával | KV gyorsítótár nyomása gyorsan mutatkozik | Több hely, stabilabb a terhelés alatt |

Ha szeretnél egy szélesebb GPU kivonatot (nem csak ezt a kettőt), az Legjobb GPUek a gépi tanuláshoz 2025-ben hasznos referencia táblázat a VRAM és memória sávszélesség számára a közös AI GPU-ek között.

Miután tudod, hogy a munkaterhelésed elfér, a következő dolog, ami azt dönti el, hogy mennyire érzi się "simának" a dolgot, a memória sávszélesség.

Sávszélesség: Miért érzi magát másnak az HBM

Az AI teljesítménnyel kapcsolatos sok beszélgetés a számítási csúcsra összpontosít, de a transzformátorok rendkívül érzékenyek a memóriamozgásra. Az H100 előnye az, hogy nagy HBM készleteket párosít nagyon magas memória sávszélességgel, valamint NVLink sávszélességgel és MIG particionálással a platform oldalon.

Specifikációk pillanatkép

A specifikációk nem fognak az GPU mellett dönteni érted, de megmagyarázzák, miért ugyanaz a workload egyik kártyán könnyűnek, másikat szűkösnek érzi. Ez a pillanatkép azt mutatja meg, mi befolyásolja az LLM képzésének, inferenciájának és kiszolgálásának viselkedését a legjobban.

| Specifikáció | H100 (SXM / NVL) | RTX 4090 |

| VRAM | 80 GB / 94 GB | 24 GB |

| Memória sávszélesség | 3,35–3,9 TB/s | GDDR6X (kapacitás korlátozott 24 GB-nál) |

| Összeköttetés | NVLink + PCIe Gen5 | PCIe (fogyasztói platform) |

| Több-példányos | Akár 7 MIG instance | Nem elérhető |

Spec hivatkozások: NVIDIA H100, NVIDIA RTX 4090.

A gyakorlatban ez a következőt jelenti:

- Ha növelni szeretnéd a batch méretet vagy a kontextus hosszát, az H100 általában hosszabb ideig stabil marad, mielőtt kénytelen lennél kompromisszumokra.

- Ha egyszerre sok kérést szolgálsz ki, a H100 több "memória légterrel" rendelkezik, így nem kerülsz olyan hamar bizonytalan tail latency-ba.

- Ha a munkád jellemzően egyfelhasználós, egy modellre korlátozódik, és szerény kontextusmérettel dolgozol, a 4090 gyorsnak és elegendőnek éreztetik magát.

A sávszélesség azonban nem helyettesíti az alapos teljesítménytesztelést. Csupán azt magyarázza meg, miért tűnhetnek hasonlónak két GPU a szűk tesztben, de miért válik szét a teljesítményük igazi terhelés alatt.

Megbízható H100 vs RTX 4090 benchmarkadatok

A benchmarkok nem mindegyike egyforma, és ezért fordul elő állandóan, hogy "az én számok nem egyeznek a tiéddel". Azért is H100 versus RTX 4090, érdemes az eredményeket két sávra osztani:

- A sáv (közösségi hangulat): llama.cpp-style tokens/sec tests and simple inference scripts.

- B sáv (szabványos csomagok): MLPerf Training és MLPerf Inference stílusú eredmények, amelyek az ismételhető szabályokra összpontosítanak.

Llama.cpp-stílusú Inference Snapshot

Ezt a fajta tesztet az emberek otthon futtatják, majd három napig vitáznak az eredményekről. Hasznos, mert egy olyan "valódi fejlesztői környezetet" mutat, amit sok fejlesztő használ, de könnyen félreértelmezhető, ha figyelmen kívül hagyod az illeszkedést és a pontosságot.

Nyilvános llama.cpp stílusú összehasonlítások az RTX 4090 kitűnő teljesítményt nyújt kisebb modelleknél és kvantált futtatásoknál, míg a nagyobb modellek magasabb precizióval messze túllépik a VRAM korlátját.

Erre számítson:

| Modell | GPU | Tipikus Eredmény |

| 7B osztály | RTX 4090 | Magas token/sec sebességgel, sima egyfelhasznalos következtetés |

| 13B osztály | RTX 4090 | Még jó így is, de a környezet és a terhelés már számít |

| 70B osztály | RTX 4090 | Nem fér el tisztán agresszív kvantálás vagy offload nélkül |

| 70B osztály | H100 | Sokkal reálisabb, ha helyben tartjuk az adatokat és megbízhatóan szolgáljuk ki őket |

Ez a táblázat nem azt akarja mondani, hogy a 4090 rossz, vagy hogy az H100 valami csoda. Hanem azt, hogy a VRAM felső korlátja határozza meg, mennyit tudsz resident maradva tartani, és ez kihat a sebességre, a stabilitásra, és arra, hogy mennyi finomhangolásra lesz szükséged.

Ha folyamatosan vágod le a kontextus hosszát, csak hogy működjön, akkor már nem elméleti kérdésről van szó.

Mit ad hozzá az MLPerf, amit a közösségi benchmarkok nem

Az MLPerf azért jött létre, mert ha több ezer dolláros döntésről van szó, nem elég a "random scriptekre és intuícióra" hagyatkozni. Az MLCommons hozzáadta újabb generációs AI-alapú feladatok az idő múlásával, és az MLPerf úgy lett kialakítva, hogy a különböző rendszerek között összehasonlíthatóbbá tegyük az eredményeket.

A képzés szempontjából, Az NVIDIA MLPerf Training v5.1 elemzése jó példa arra, hogy a szállítók hogyan jelentik a betanítási időt a bejelentési környezet részleteivel és az általuk követett benchmark szabályokkal.

Ez az irány nem mondja meg, hogyan viselkednek a privát promptjaid, de ez egy alapvető ellenőrzés a rendszerosztályú skálázáshoz és annak, hogy ez a hardverosztály hogyan teljesít a szabályok között.

Beszéljünk most arról, ami a leginkább befolyásolja a vásárlási döntéseket: arról, hogy mennyi idő és pénz szükséges a munka befejezéséhez.

Költség, idő és lehetőség költsége

Sok H100 versus RTX 4090 a döntéseket gyakran "vásárlási ár vs bérleti díj" keretben szokták vizsgálni. Ez ritkán a helyes megközelítés. Sokkal lényegesebb az, hogy hány óra alatt tudsz egy ténylegesen használható modellt készíteni, és mennyi időt vesztegetsz a korlátokkal való küzdelemre.

Három tipikus eset jól mutatja a kompromisszumokat.

Heti finomhangolás kis és közepes méretű modellekhez

Ha a futtatások 24 GB alatt maradnak anélkül, hogy folyamatosan kompromisszumokat kellene kötni, az RTX 4090 választás kiváló. Gyorsan iterálhatsz, nem kell klaszteridőt ütemezni, és a beállítás egyszerű. Ha viszont minden futtatás azt jelenti, hogy "kisebb batch, rövidebb kontextus, újra próba", az H100 sokkal jobb megoldás, a magasabb költség ellenére.

Valódi párhuzamosság, mindig

Az egyidejű feldolgozás gyorsan terhelést helyez a KV cache-re. Ezekben az esetekben az H100 fejlesztési lehetőségei és a platform vezérlőelemei nyújtanak megoldást, különösen ha stabil, előrejelezhető késleltetésre van szüksége.

Ha még nem vagy biztos benne, hogy az GPU szerver megfelelő választás az alkalmazásodhoz, a mi GPU VPS versus CPU VPS a költségvetés részletezése hasznos módszer annak megállapítására, hogy a terhelést melyik infrastruktúra-típushoz rendeljük, mielőtt az optimizálás rossz irányba induló időt elpazarolnánk.

Nagyobb Képzési Feladatok Határidőkkel

Amikor már nem csak te dolgoztál egy szerverrel, a rutinfeladatok azok, amikre összpontosítani kell: stabil infrastruktúra, kevesebb hiba, és kevesebb idő az adminisztrációra. Erre lett tervezve az H100.

Ha még mindig bizonytalanok vagy, nem több olvasgatásra van szükség. Próbáld ki a gyakorlatban, hogyan viselkedik az infrastruktúra – figyelj az illesztőprogram-problémákra és a többfelhasználós terhelésre.

Szoftver és működtetés: Illesztőprogramok, stabilitás, többfelhasználós támogatás és ügyfélszolgálat

Ez az a rész, amit a legtöbb benchmark-táblázat kihagyott, de a mindennapi munkáodban jelentős szerepet játszik.

Az RTX 4090 népszerű, mivel számos AI-munkafolyamathoz elérhető és gyors. Az ár azonban az, hogy ha a felhasználási eset növekszik, hamarabb érheted el a memóriakorlátozásokat és skálázási mintákat, amelyek nem megosztott, multi-tenant környezetekre vannak kalibrálva.

Az H100 klaszterekhez készült. Az MIG nagy szó a platform csapatoknak, mert lehetővé teszi, hogy egy GPU-t elszigetelt szeletekre ossz fel, ami csökkenti a "zajos szomszéd" problémákat és sokkal egyszerűbbé teszi a kapacitástervezést. Az NVIDIA hivatalos H100 specifikációja akár 7 MIG-instanciát is felsorol az alakfaktortól függően.

Ha a munkáid személyes és helyi, akkor a 4090-en hosszú ideig jól érzel magad. Ha több felhasználó és ügyfél számára dolgozol, az H100 a biztonságosabb választás.

Szóval, végeredményben ki mit vegyen?

Melyiket válassza az Ön terheléshez

Számára H100 versus RTX 4090, végső soron az a választás a helyes, amely elhárítja a legnagyobb akadályokat.

Helyi LLM fejlesztőcsomag (Egyéni fejlesztő / Diák)

Válassz RTX 4090-t, ha jellemzően 7B–13B modelleket futtatssz, kvantált inferenciát alkalmazol, RAG-on kísérletezol, vagy SDXL-lel dolgozol. Akkor lépj nagyobb konfiguráció felé, ha már inkább a memória korlátaival foglalkozol, mint azzal, amit valójában építeni szeretnél.

Startup ML mérnök (MVP bevezetése)

Ha az MVP-d egyetlen modell mérsékelt forgalommal, és kényelmesen elfér, a 4090 erős kezdés. Ha stabil késleltetésre van szükséged terhelési csúcsok alatt, magasabb egyidejűség kezelésére, vagy több munkaterhelés egy gépen, az H100 a stabilabb választás.

Alkalmazott kutató (Sok kísérlet)

Ha gyakran kompromisszumokra kényszerülsz, mint a batch méret csökkentése vagy a precizitás finomhangolása, az H100 tisztább kísérleteket és kevesebb sikertelen futást biztosít.

Termelési / Platform Csapat (Multi-Tenant Kiszolgálás)

Az H100 nyilvánvaló választás, főleg azért, mert az MIG és a nagyobb rezerva egyszerűbbé teszi a kapacitástervezést, és lényegében csökkenti a kockázatot, ha hirtelen terhelés növekedés történik.

Ha még nem szeretnél hardverbe befektetni, a bérlés a legésszerűbb megoldás.

Praktikus Középút: Előbb Bérelje az GPU-eket, Utána Döntsön

A legegyszerűbb módja a rendezésnek H100 versus RTX 4090 azt jelenti futni a te modell, a te parancsok és a te mindkét hardverosztályon mérd le a kontextushosszúságot, majd hasonlítsd össze a tokenpercenként mért teljesítményt és a terhelés alatti végsebesség-késleltetést.

Éppen ezért építettük meg Cloudzy GPU VPS, mivel egy GPU szerver percen belül üzembe helyezhető, teljes root hozzáféréssel telepítheted az alkalmazásod, és nem kell mások benchmark-ja alapján találgatnod.

Ezek a funkcionalitások az GPU VPS csomagokkal járnak:

- Dedikált NVIDIA GPUs (például RTX 4090 és A100 osztályú opciók) hogy az eredményeid ne morzsolódjanak szét a zajongó szomszédok miatt.

- Akár 40 Gbps-es hálózatkezelés az összes GPU terven, ami nagy különbség az adatkészlet-lekérésekhez, multi-node munkafolyamatokhoz és az artifaktok gyors mozgatásához.

- NVMe SSD tárterület, valamint DDR5 RAM és magas frekvenciájú CPU opciók minden szinten, így a többi komponens nem húzza le a GPU teljesítményét.

- DDoS védelem és egy 99.95% üzemidő, így a hosszú feladatok nem szenvednek el véletlenszerű hálózati problémáktól.

- Óradíjas számlázás (hasznos rövid mérési körökre) és egy 14 napos pénzvisszafizetési garancia alacsony kockázatú tesztekhez.

Futtasd le ugyanezt a mérési checklist-et egy RTX 4090 terven, majd ismételd meg egy A100-es terven, amikor nagyobb kontextust, magasabb párhuzamosságot vagy nagyobb modelleket futtatnál. Ezután a választás az H100 versus RTX 4090 között általában egyértelművé válik a saját naplóidból.

Mérési Checklist: Végezd el 30 perc alatt

Ha olyan döntést szeretnél, amit meg tudsz védeni, gyűjts össze négy szám a pontos stackből, amit majd futtatnál:

- Tokenek/másodperc a célzott kontextushosszon

- p95 latency percentilis késleltetés az elvárt párhuzamosságnál

- VRAM kapacitásrezerv a csúcsidőszakban

- Egy befejezett futás költsége az indulástól az eredményig

Egy minimális tesztet egy vLLM-vel így néz ki:

pip install vllm transformers accelerate

python -m vllm.entrypoints.api_server \

--model meta-llama/Llama-3-8B-Instruct \

--dtype float16 \

--max-model-len 8192Ha pontosan szeretnéd tudni, mit is bérelsel, a mi cikkünk az Mit jelent a GPU VPS? részletesen bemutatja a dedikált GPU hozzáférés, a vGPU megosztás és az általad választandó terv közötti különbséget.