Ha az ötlet az, hogy új GPU-t vásárolsz, hogy megszabadulj az out-of-memory hibáktól, akkor a 5070 Ti vs 5080 vita rossz irányba tart. Mindkét kártya 16 GB VRAM-vel érkezik, és ezt a kapacitásbeli korlátot a mélytanulásban sokkal hamarabb eléri az ember, mint sokan gondolnák.

Az 5080 gyorsabb, de ritkán teszi lehetővé, hogy lényegesen nagyobb modellt futtass. A gyakorlatban akkor is csökkentened kell a batch méretet, rövidítened a kontextus hosszát, vagy offloadolnod a rendszer RAM-re, csak hogy a futások élve maradjanak.

Ezért ez a cikk egy valódi, realista összehasonlítás az 5070 Ti és 5080 között deep learninghez, valamint opciókat ad, amelyek passzolnak, ha a céljaid között szerepel modellek betanítása, finomhangolása vagy serving anélkül, hogy állandó VRAM korlátokkal szembesülnél.

Ha semmi mást nem olvasol el, akkor legalább a specs részt és a "capacity vs speed" részt olvasd el; ezek az egyetlen kettő, amely megakadályoz, hogy rossz terméket vegyél.

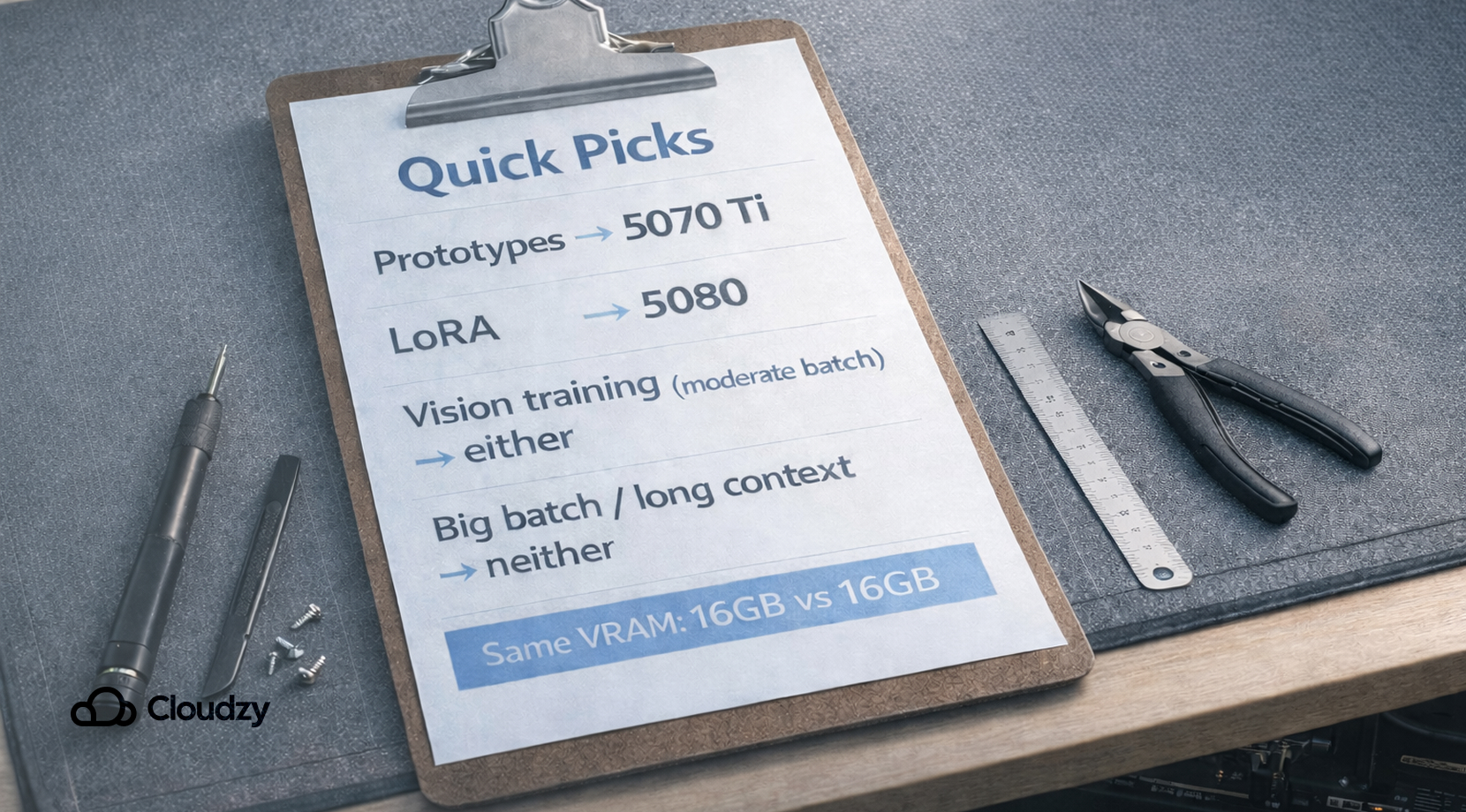

Gyors választások az alapján, amit csinálsz

A legtöbben nem úgy vásárolnak GPU-t, hogy csak úgy össze-vissza. Négy gyakori vásárlói mentalitást látunk újra és újra, és az 5070 Ti és 5080 mindegyikre máshogy hat.

A helyi LLM kísérletező

Notebookok futtatasz, kvantizációs beállításokat módosítasz, és a "működik" fontosabb számodra, mint a tökéletes áteresztőképesség. Számodra az 5070 Ti vagy 5080 választása általában a költségvetésen dől el, mert mindkét kártya jó lesz kis modellek és kvantált inferencia esetén, majd mindkettő ugyanabba a VRAM korlátba ütközik, ha a kontextus hosszát vagy batch méretet növeled.

A doktorandusz, aki vision modelleket tanít

Ismételhető kísérleteket akarsz, nem végtelen újrapróbálkozásokat. A rejtett költség nem a kártya maga; az az idő, amelyet elveszítesz, amikor a futások az epoch 3-nál meghibásodnak, mert az adatbetöltő, az augmentációk és a modell memóriáért versenyez.

A startup mérnök, aki inferenciát küld élesbe

A tail latency és a párhuzamosság érdekel. Egy egyfős demó nagyszerűnek tűnhet 16 GB-on, majd az éles adatforgalom megérkezik, és a KV cache nyomása emészteni kezdi a VRAM-t, mint egy lassú szivárgás. Serving céljára az 5070 Ti vagy 5080 összehasonlítása elteregethet, ha az igazi probléma a batch-eléshez és hosszú promptokhoz szükséges kapacitás.

A kreatív alkotó, aki ML-t is végez

Kreatív alkalmazások és ML tooling között ugrálsz, és utálod az újraindítást, az illesztőprogram fejfájásokat és a "zárd be a Chrome-ot, hogy traininizni tudjál". Számodra az 5070 Ti vagy 5080 összehasonlítása csak akkor van értelme, ha az GPU része egy tiszta munkafolyamatnak, nem egy törékeny munkaállomásnak, amely az első multitasking-nál összeomlik.

Ezekkel az esetekkel szem előtt tartva, lássunk konkrét dolgokat a hardver hátterében és arról, miért ugyanaz a korlátozó tényező azokban a helyekben, amelyek számítanak.

Magas prioritású specs deep learninghez

Az 5070 Ti és 5080 megértésének leggyorsabb módja az, ha figyelmen kívül hagyod a marketing számokat és a memória sorra koncentrálsz.

Ha a teljes spec sheet nézetet szeretnéd, itt egy részletes táblázat, amely azokra fókuszál, amelyek a leginkább befolyásolják a training és inference viselkedést. (Az órajel és a kijelző kimenetek szemkápráztatók, de nem döntik el, hogy a futásod belefér-e vagy sem.)

| Specifikáció (Desktop) | RTX 5070 Ti | RTX 5080 | Miért jelenik meg a DL-ben |

| VRAM | 16 GB | 16 GB | A kapacitás a kemény korlát a súlyok, aktivációk és KV cache esetén |

| Memória típusa | GDDR7 | GDDR7 | Hasonló viselkedés, a sávszélesség segít, de a kapacitás dönti el, hogy "belefér vagy nem" |

| Memória sín | 256 bites | 256 bites | Korlátozza az összesített sávszélességet; segít az áteresztőképességben, nem a modell méretében |

| CUDA magok | 8,960 | 10,752 | Több számítás segít a tokens/sec-ben, nem a "be tudom tölteni-e" |

| Tipikus tábla teljesítménye | 300 W | 360 W | Több hő és PSU fejtér, nincs extra VRAM |

Hivatalos spec források: RTX 5080, RTX 5070 család

Lényegében az 5080-as a gyorsabb kártya, az 5070 Ti az olcsóbb. Deep learningben a különbség főleg akkor mutatkozik meg, ha a terhelésed már úgyis elfér.

Ezután azt nézzük meg, hogy miért tűnik el az VRAM olyan gyorsan, még olyan setupokon is, amelyek papíron könnyűnek tűnnek.

Miért fogyatkozik el az VRAM olyan gyorsan a Deep Learningben

A játékokból érkezők gyakran azt gondolják, hogy az VRAM mint egy textúra-gyorsítótár működik. A deep learningben inkább egy szűk konyhai pult, mint semmi. Nem csak helyre van szükséged az alapanyagoknak, hanem arra is, hogy egyszerre vagdalhass, főzhess és tálalhass.

Az VRAM-ben tipikusan ezek vannak egy futás alatt:

- Modell súlyok: a betöltött paraméterek, néha FP16/BF16-ban, néha kvantálva.

- Aktivációk: közbenső tenzorok, amelyeket a visszafelé terjedéshez mentesz, általában a tréningben a legnagyobb "baja".

- Gradiensek és optimalizátor állapot: tréning-overhead, amely megsokszorozhatja a memóriaszükségletet.

- KV gyorsítótár: inferencia-overhead, amely növekszik a kontextus hosszával és párhuzamosságával.

Ezért az 5070 Ti versus 5080 vita olyan, mintha a motorteljesítményt vitatkoznád, miközben egy túl nehéz utánfutót vonsz. Lehet több lovaserőd, de a vonóhorog terhelhetősége még mindig a korlát.

Egy gyors ellenőrzési módszer, amit a saját tesztekhez használunk: naplózzuk az allokált és fenntartott memóriát is az PyTorch-ben. Az PyTorch CUDA memória dokumentációja ismerteti a gyorsítótár-allokátort és azt, hogy miért tűnhet a memória "felhasználtnak" az olyan eszközökben, mint az nvidia-smi, még akkor is, ha a tenzorok felszabadultak.

Ezzel eljutunk ennek a vitának a fő pontjához: a 16 GB-os deep learning kudarcok nem azért fordulnak elő, mert lassú lenne, hanem azért, mert a legrosszabb pillanatban kapod meg az OOM-ot.

Az Első Munkaterhelések, Amelyek Letörik az 5070 Ti-t versus 5080-at

Alább azok a deep learning minták vannak felsorolva, amelyek általában először érnek el memóriakorlátot az 5070 Ti-n versus 5080-on.

LLM Kiszolgálás hosszú promptokkal és valódi párhuzamossággal

Egyetlen 2K token-es prompt rendben tűnhet. Adj hozzá hosszabb kontextust, adjatok hozzá batchelést, adj hozzá egy második felhasználót, és a KV gyorsítótár elkezd nőni. Ott szakad meg az 5070 Ti versus 5080, ahol korlátozod a max kontextust vagy csökkented a batch méretét az túléléséhez.

Egy egyszerű ellenőrzési módszer:

- Futtasd a szerveredet a valós max kontextus és batch-mel.

- Figyeld az VRAM-et az idő múlásával, ne csak az induláskor.

- Jegyezd fel azt a pontot, ahol a latencia megemelkedik, majd ellenőrizd a memóriahasználatot ugyanabban az időablakban.

Ha megbízható monitorozási setupet szeretnél, amely önmagában nem válik projektté, az GPU monitorozó szoftver témakörű útmutatónk gyakorlati CLI naplózási mintákat tartalmaz, amelyek jól működnek valódi futásokon.

LoRA vagy QLoRA finomhangolás

Sokan azt mondják, hogy "a LoRA működik 16 GB-on," és nem is tévednek. A csapda az, hogy feltételezzük, a többi pipeline-elem ingyenes. A tokenizálási bufferek, adatbetöltő workerek, vegyes precizitás skálázás és validációs lépések nagyon gyorsan összeadódnak.

A gyakorlatban a szűk keresztmetszet nem annyira a számítás, mint a határ. Ha nincs szabad VRAM, végül felügyeled a futásokat.

Képzettség nagy felbontású bemenetekkel

A képmodelleknek van egy alattomos hibamódja: a felbontás kis növekedése vagy egy további augmentáció átfordíthat a stabil állapotból az OOM-ba. A 5070 Ti vs 5080 esetén ez a batchméret 1-re zsugorodásaként, majd a gradiens-felhalmozás által lassított edzésként jelenik meg.

Multimodális futások egy GPU-n

A szövegkódoló + képkódoló + fúziós rétegek rendben lehetnek, de ha növeled a szekvenciahosszat vagy nagyobb képlátási hátsót adsz hozzá, a memóriafelhalmozás brutális.

"Az én GPU rendben van, az asztali számítógépem nem"

Ez a legjellegzetesebb eset. Elkezdesz edzeni, majd a böngésződ, IDE-d és más program VRAM-t vesz igénybe, és hirtelen a "stabil" konfigurációd elromlik. Fórumok felhasználói panaszkodnak az összes bezárásáról, az átfedések letiltásáról, és még mindig OOM-ba ütköznek ugyanaz a modellnél, amit tegnap futtattak.

Ez a minta folyamatosan megjelenik itt: 5070 Ti vs 5080 megbeszélések, mivel mindkét kártya azonos kapacitáshatáron ül. Ha ezek ismerősek, a következő kérdés az, hogy "mit tehetünk ezzel a határral?"

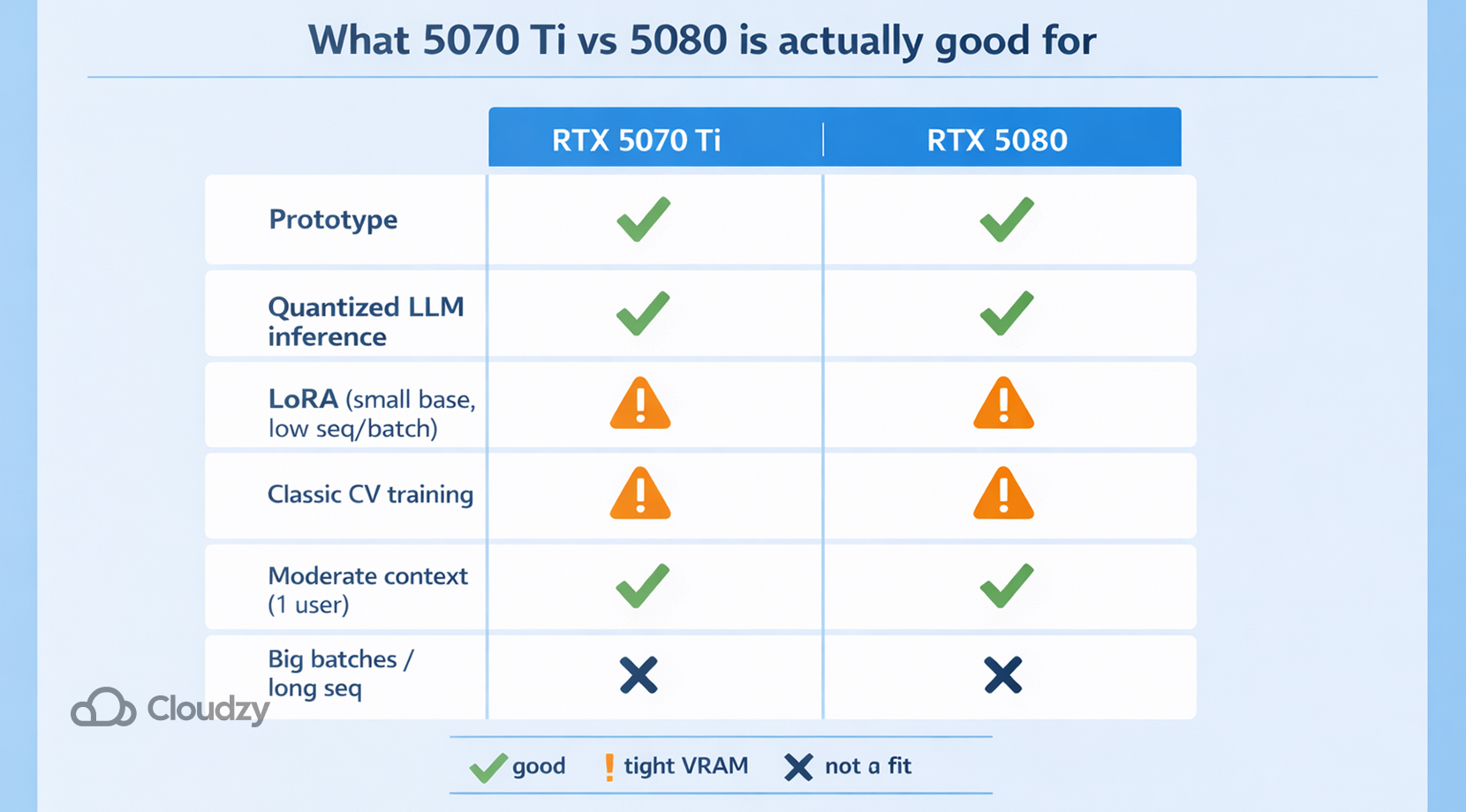

Mit jelent a 5070 Ti vs 5080 Actually Good

Könnyű lenézni a 16 GB-ot az ML körökben, de nem használtalan. Csak szűk.

Az 5070 Ti vs 5080 teljesen megfelel lehet:

- Prototípus munka: kis kísérletek, gyors ablációk és szanity checkek.

- Kvantált LLM következtetés: kisebb modellek mérsékelt kontextussal, egyetlen felhasználó.

- LoRA kisebb alapmodelleken: amíg tartod a szekvenciahosszat és a batchet.

- Klasszikus képzettség: mérsékelt képméretek, mérsékelt hátsók, több türelem.

Lényeg: ha a munkád a memóriahatáron belül marad, az 5080 általában sokkal gyorsabbnak érezhetőbb, mint a 5070 Ti, és élvezheted a többletszámítást.

De amint "komolyabb" mélytanulásba kezdesz, memóriaszélesség-problémákba fogsz ütközni. Szóval beszéljünk olyan taktikákról, amelyek mindkét kártyán segítsenek.

Hogyan maximalizáljuk a VRAM teljesítményt anélkül, hogy a tanítás poklokká válna

Ezek nem varázslatlan. Egyszerűen azok a lépések, amelyek lehetővé teszik, hogy az 5070 Ti vs 5080 tovább hasznos maradjon.

Kezdj mérésekkel

Mielőtt a hiperparamétereket módosítanád, találd meg a csúcs VRAM értéket lépésenként. Az PyTorch-ben max_memory_allocated() és max_memory_reserved() gyorsan megláthatod, mit csinál valójában a futásod.

Ez segít válaszolni olyan kérdésekre, mint:

- A modell vagy az aktivációk okozzák a költségek nagy részét?

- Megnő a VRAM az ellenőrzés közben?

- Nő a fragmentáció az idő múlásával?

Ha megvan az alapnorma, a többi sokkal kevésbé lesz véletlenszerű.

Csökkentsd a memóriahasználatot ahol lehet

Ez az egyszerű lépéssor, amit mi követünk:

- Csökkentsd a batch méretet amíg elfér.

- Adjunk hozzá gradient accumulation-t, hogy visszakapjuk az effektív batch-ot.

- Kapcsold be a vegyes precizitást (BF16/FP16), ha a stackod támogatja.

- Adjunk hozzá gradient checkpointing-et, ha az aktivációk dominálnak.

- Csak ezután kezdj el a modell méretével játszani.

Kezeld a kontextus hosszúságot költségvetésként

Transformerek esetén a kontextus hosszúsága az, ami a legtöbb problémát okozza. Befolyásolja az attention számítást és inferenciakor a KV cache méretét. Az 5070 Ti vs 5080-on rögtön észrevehető, ha néhány ezer tokent meghaladod, ahogy a VRAM ugrásszerűen nő, az áteresztőképesség csökken, és azonnal csökkenteni kell a batch méretet, hogy működőképes maradj.

Ajánlott megközelítés:

- Válassz egy alapértelmezett maximális kontextus hosszat, amellyel biztonsággal futsz.

- Hozz létre egy második profilt "hosszú kontextus" számára, kisebb batch-sal.

- Ne keverd a kettőt hibakeresés közben.

Ne keverd össze az PyTorch gyorsítótárát valós memóriaszivárgással

Sok "memórialeak" jelentés valójában az allokátor viselkedése. Az PyTorch dokumentációja megemlíti, hogy a gyorsítótárazó allokátor fenntarthat memóriát még azután is, hogy a tenzorok felszabadultak, és empty_cache() nagyobb részben visszaadja az unused cached blokkokat más alkalmazásoknak, nem magának az PyTorch-nek.

Ez azért fontos, mert az 5070 Ti vagy 5080 felhasználók gyakran elterelődnek hamis információkra, miközben a valódi memóriavesztés forrásaira kellene figyelmüket fordítaniuk: a batch méret, a szekvencia hossz és az aktivációs memória.

Ezek a finomhangolások hasznosabbá teszik a memóriakorlátot, de nem változtatják meg az alaphelyzetet. Ha a projektedhez nagyobb modellek, hosszabb kontextus vagy magasabb párhuzamosság kell, több VRAM szükséges.

5070 Ti vagy 5080: Melyikre van szükségem - kapacitásra vagy sebességre?

Gondolkodhatsz rá úgy, hogy a sebesség azt jelenti, milyen gyorsan tudsz haladni, a kapacitás pedig azt, hány utasnak van helyed. A deep learning mindkettőre figyelmet fordít, de a kapacitás dönti el, hogy egyáltalán el tudsz-e indulni a parkolóból.

Az 5080 sok feladatban magasabb átviteli sebességet nyújt, mint az 5070 Ti. Az 5070 Ti és 5080 között azonban nincs különbség abban, hogy "be tudom-e tölteni és futtatni-e", mert mindkettő az ugyanolyan korlátokba ütközik.

Ezért csalódnak meg sokan a frissítés után. Egy gyors teszten érzik az előrelépést, de amikor az igazi terhelést futtatják, ugyanabba a falba ütköznek. A fal csak 30 másodperccel később jön.

Ha mély tanulási feladatokra keresed az ideális megoldást, érdemes eldöntened, hogy melyik kategóriába tartozol:

- Sebességkorlátozott: már így is jó vagy, csak gyorsabb létre szeretnél.

- Kapacitás-korlátozott: nem illeszkedsz könnyen bele, és időt töltesz a probléma csökkentésével.

Az emberek többsége, aki az 5070 Ti és az 5080 közötti választást kutatja deep learning-hoz, már a második csoportba tartozik, még ha nem is tudnak róla.

Most beszéljünk arról az opcióról, amely általában a legtöbb időt spórolja meg: a "nagy feladatokat" egy nagyobb GPU-re bízd rá anélkül, hogy az egész munkafolyamatodat egy új helyi gép körül kellene átszervezned.

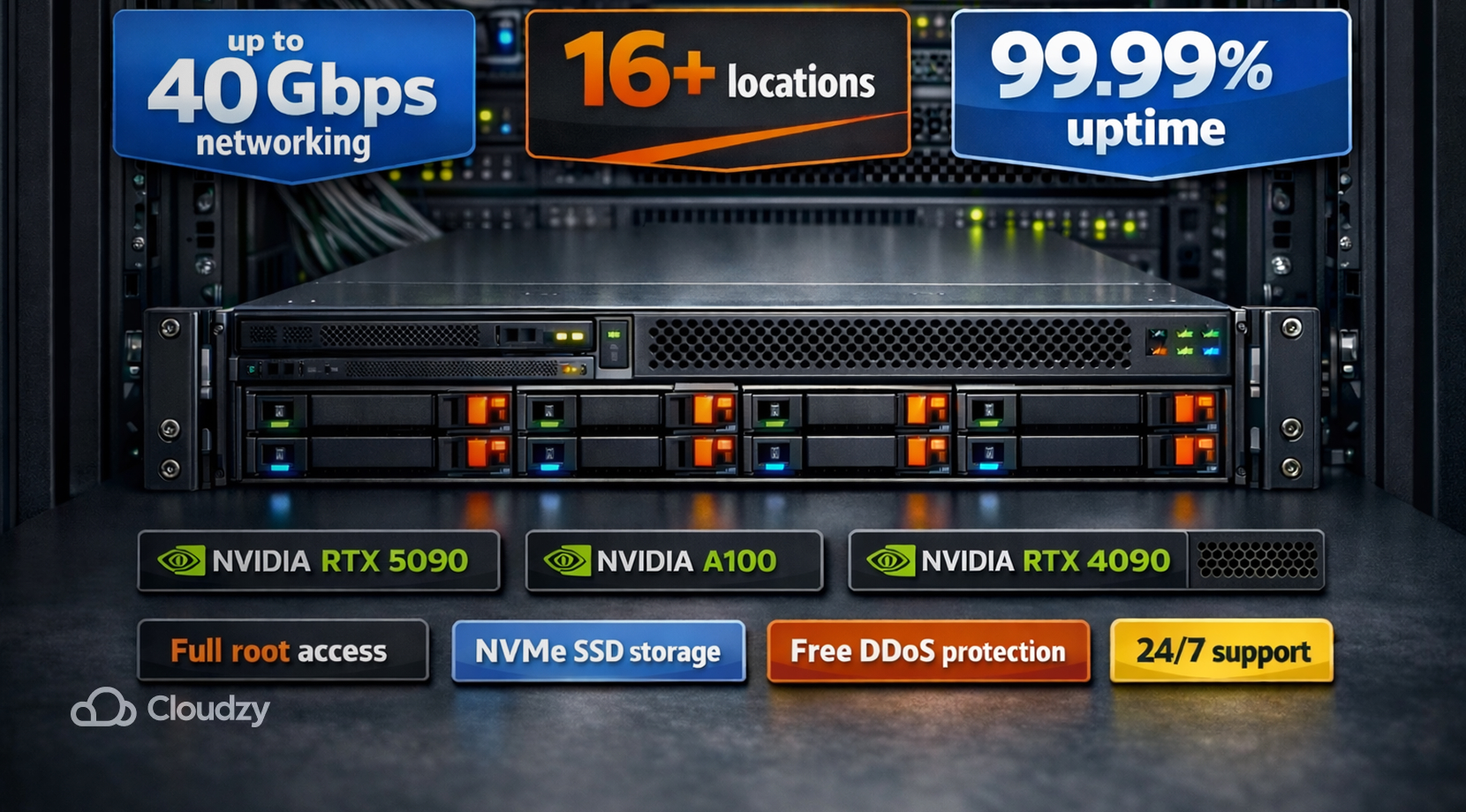

Gazdaságos megoldás: Használj GPU VPS processzort erőforrásigényes feladatokhoz

Az infrastruktúra csapatunkban az a leggyakoribb minta, hogy fejlesztők lokálisan prototipizálnak, majd egy ponthoz érnek, ahol az RTX 5070 Ti vs RTX 5080 közötti különbség már nem számít, mert az munka egyszerűen nem fér el.

Pont erre van szükséged: nagyobb VRAM poolra a tanításhoz és valós körülmények közötti szerveroldali teszteléshez. Pontosan itt Cloudzy GPU VPS jól illeszkedik.

Az GPU VPS csomagjaink NVIDIA opciókat tartalmaznak, mint az RTX 5090, A100 és RTX 4090, továbbá teljes root hozzáférés, NVMe SSD tárhelyet, akár 40 Gbps sávszélességet, 12 helyet, ingyenes DDoS védelmet, 24/7 támogatást és 99,95% üzemidő-garanciát.

De hogyan segít ez neked, legyen szó az 5070 Ti versus 5080 összehasonlításáról vagy bármelyik másik GPU a hasonló szinten? Nos:

- Futtathatod a valódi modelledet és prompt profilodat olyan hardveren, amely több VRAM erőforrással rendelkezik, így a döntések egyértelművé válnak a saját logjaidból.

- A helyi GPU-et megtarthatod fejlesztéshez és gyors tesztekhez, majd csak a nehéz számítások futtatásához bérelj nagyobb erőforrásokat.

Ha szeretnél gyorsan feleleveníteni mit jelent valójában az GPU VPS, illetve hogy mit jelent a dedikált GPU és a megosztott hozzáférés. Kezdő útmutatónk egyszerűen elmagyarázza.

Ha még mindig bizonytalanul állsz afelől, hogy szükséged van-e egy GPU szerverre az alkalmazásodhoz, akkor GPU vs CPU VPS Az összehasonlítás segít megérteni, hogy a valós feladatok - például modelltraining, inference, adatbázisok és webalkalmazások - milyen hardvereket igényelnek.

Az infrastruktúra megoldása után már csak az marad: olyan munkafolyamatot választani, amely nem pazarolja az idődet.

Egyszerű munkafolyamat, hogy megtaláld, mire van szükséged

Sok fejlesztő azt hiszi, hogy vagy egy nagyobb fogyasztói kártyát kell vennie, vagy szenvednie kell. A valóságban az 5070 Ti vagy az 5080 teljesen megállja a helyét, ha helyi fejlesztőeszközként használod, nem pedig teljes termelési infrastruktúraként.

Íme egy workflow, amely bevált a gyakorlatban:

- Használd a 16 GB GPU-t kódoláshoz, hibakereséshez és kisebb kísérletekhez.

- Tartson készen egy "big GPU" környezeti sablont a távoli futtatásokhoz.

- A headroom-igényes edzési és szervírozási teszteket helyezd át egy GPU VPS-re.

- Nyomon követheted a futtatásokat és mentheted a naplókat, így az eredmények reprodukálhatók.

Ha részletesebben szeretnél megismerni a megfelelő GPU osztály kiválasztását ML munkához, akkor nézd meg a legjobb GPUs gépi tanuláshoz jó következő lépés.

Tehát végső soron az 5070 Ti vagy 5080 választása a helyi számítást érinti, de a mély tanulás skálázása az infrastruktúra megválasztásának függvénye. Ha kíváncsi vagy, hogy egy nagyobb GPU osztály hogyan változtatja meg a gyakorlati AI-t, nézd meg a H100 vs RTX 4090 benchmark teljesítményteszt ez a felépítés hasznos összehasonlítás, mert mindig visszatér ugyanahhoz a témához: a VRAM először az illeszkedés, aztán a sebesség.