ด้วยความต้องการใช้งาน LLM แบบ local ที่เพิ่มขึ้นอย่างต่อเนื่อง หลายคนรู้สึกสับสนเมื่อต้องเลือกใช้งาน แต่การใช้งานจริงไม่ได้ง่ายอย่างที่คิด เพราะมันต้องการทรัพยากรระบบพอสมควร บางตัวมากกว่าตัวอื่น จึงมีหลายคนที่ไม่อยากยุ่งด้วย ยังไม่นับชั่วโมงที่ผู้เริ่มต้นอาจต้องนั่งงงอยู่กับหน้าจอ terminal

อย่างไรก็ตาม มีตัวเลือกที่โดดเด่นสองตัวที่ทำให้ชีวิตง่ายขึ้น Ollama และ LM Studio เป็นสองแพลตฟอร์มที่ได้รับความนิยมสูงสุดสำหรับการรัน LLM แบบ local และมีประสิทธิภาพที่น่าประทับใจ แต่การเลือกระหว่างทั้งสองอาจไม่ง่าย เพราะแต่ละตัวถูกออกแบบมาเพื่อรองรับ workflow ที่แตกต่างกัน มาดูกันเลยว่าในการเปรียบเทียบ Ollama vs LM Studio นั้น ใครจะได้เปรียบ

Ollama: เครื่องมือสำหรับผู้ที่เชี่ยวชาญด้านเทคนิค

ในบรรดาเครื่องมือสำหรับรัน LLM แบบ local Ollama เป็นตัวเลือกที่แข็งแกร่งด้วยฟีเจอร์ที่หลากหลาย ไม่เพียงแต่ปรับแต่งได้อย่างละเอียด แต่ยังใช้งานได้ฟรี เพราะเป็นแพลตฟอร์ม open-source ที่พัฒนาโดยชุมชน

แม้ Ollama จะช่วยให้การรัน LLM บนเครื่องทำได้ง่ายขึ้น แต่มันทำงานผ่าน CLI เป็นหลัก ดังนั้นคุณยังต้องมีความคุ้นเคยกับ terminal อยู่บ้าง การใช้ CLI เป็นจุดแข็งสำหรับ development workflow เพราะเรียบง่ายและตรงประเด็น แม้จะมีช่วงเรียนรู้ แต่ก็ใช้เวลาทำความเข้าใจน้อยกว่าการตั้งค่า LLM บนเครื่องเองตั้งแต่ต้น

Ollama เปลี่ยนคอมพิวเตอร์ของคุณให้กลายเป็น mini-server ในเครื่อง พร้อม API แบบ HTTP ทำให้แอปและสคริปต์ของคุณเข้าถึงโมเดลต่าง ๆ ได้หลากหลาย และตอบสนองต่อ prompt เหมือนกับ LLM ออนไลน์ทุกประการ โดยไม่ต้องส่งข้อมูลออกไปยัง cloud นอกจากนี้ API ยังช่วยให้นักพัฒนาเชื่อมต่อ Ollama เข้ากับเว็บไซต์และ chatbot ได้โดยตรง

ด้วยลักษณะที่เป็น CLI โดยธรรมชาติ Ollama จึงมีขนาดเบา ใช้ทรัพยากรน้อย และเน้นประสิทธิภาพเป็นหลัก ทว่านั่นไม่ได้หมายความว่าคุณจะรันมันบนเครื่องคอมฯ ที่อ่อนแอได้ อย่างไรก็ตาม ถ้าคุณต้องการบีบทรัพยากรทุกหยดไปให้กับโมเดล LLM โดยตรง Ollama ก็น่าสนใจทีเดียว

จากทั้งหมดที่กล่าวมา คุณคงพอเดาได้แล้วว่า Ollama เน้น development workflow เป็นหลัก และคุณเดาถูก ด้วยการ integrate ที่ทำได้ง่าย ความเป็นส่วนตัวแบบ local และการออกแบบที่ยึด API เป็นศูนย์กลาง ถ้าคุณมีแนวคิดแบบนักพัฒนา ตัวเลือกนี้แทบไม่ต้องคิดมาก

ในการเปรียบเทียบ Ollama กับ LM Studio นั้น Ollama อาจเหมาะกว่าสำหรับผู้ที่เน้นพัฒนาโดยใช้ API เป็นหลัก แต่ถ้า CLI runtime ยังรู้สึกไกลเกินไป อ่านต่อได้เลย เพราะยังมีตัวเลือกที่เบากว่าและใช้งานง่ายกว่ารออยู่

LM Studio: ตัวเลือกที่ใช้งานได้ง่าย

LM Studio แตกต่างจาก Ollama อย่างชัดเจน แทนที่จะเป็น CLI เต็มรูปแบบ LM Studio ไม่ต้องใช้คำสั่ง terminal ใด ๆ และเพราะมีหน้าจอแบบ GUI (graphical user interface) มันจึงดูเหมือนแอปเดสก์ท็อปทั่วไปทุกอย่าง สำหรับผู้เริ่มต้นหลายคน การเลือกระหว่าง Ollama กับ LM Studio จึงเป็นเรื่องของความเรียบง่ายแบบ CLI เทียบกับความสะดวกของ GUI

แนวทางของ LM Studio ในการลดกำแพงทางเทคนิคช่วยให้ผู้ใช้ทุกระดับเข้าถึงได้ง่าย แทนที่จะพิมพ์คำสั่ง คุณแค่เลือกเมนูและพิมพ์ในกล่องแชทที่คุ้นเคย ดูเผิน ๆ แล้วใครก็สามารถใช้ LM Studio ทดลองกับ LLM บนเครื่องได้ เพราะหน้าตาคล้าย ChatGPT มาก

ยังมี model browser ในแอปที่ออกแบบมาอย่างดี ให้คุณค้นหาและติดตั้งโมเดลที่ต้องการได้ ตั้งแต่โมเดลขนาดเล็กสำหรับงานทั่วไป ไปจนถึงโมเดลขนาดใหญ่สำหรับงานที่ซับซ้อน นอกจากนี้ยังมีคำอธิบายสั้น ๆ ของแต่ละโมเดลและกรณีการใช้งานที่แนะนำ พร้อมให้ดาวน์โหลดได้ด้วยคลิกเดียว

โมเดลส่วนใหญ่ดาวน์โหลดได้ฟรี แต่บางโมเดลอาจมีเงื่อนไขสิทธิ์การใช้งานเพิ่มเติม สำหรับบาง workflow LM Studio ยังรองรับ local server mode เพื่อการ integrate ที่ง่ายขึ้น แต่โดยหลักแล้วออกแบบมาเพื่อ UI บนเดสก์ท็อปที่เข้าใจง่ายสำหรับผู้เริ่มต้น ทีนี้ลองมาวางทั้ง Ollama และ LM Studio ไว้เทียบกันให้เห็นชัด ๆ

สิ่งที่ควรรู้: Ollama กับ LM Studio

ก่อนจะไปต่อ มีประเด็นสำคัญที่ต้องพูดถึง การเปรียบเทียบ Ollama กับ LM Studio อาจทำให้ดูเหมือนว่าอันหนึ่งดีกว่าอีกอันอย่างชัดเจน แต่นั่นไม่ใช่ภาพทั้งหมด เพราะทั้งสองถูกออกแบบมาสำหรับกลุ่มผู้ใช้ที่ต่างกัน นี่คือสรุปเปรียบเทียบอย่างย่อ

| ฟีเจอร์ | Ollama | LM Studio |

| ความง่ายในการใช้งาน | เริ่มต้นใช้งานยากกว่า ต้องมีความรู้ด้าน terminal | เหมาะสำหรับผู้เริ่มต้น ใช้งานด้วยการคลิกเมาส์เป็นหลัก |

| รองรับรุ่น | รองรับ open-weight model ยอดนิยมหลายตัว เช่น gpt-oss, gemma 3, qwen 3 | รองรับโมเดลเหมือนกับ Ollama เช่น gpt-oss, gemma3, qwen3 |

| ปรับแต่ง | ปรับแต่งได้สูง เชื่อมต่อผ่าน API ได้ง่าย | ยืดหยุ่นน้อยกว่า ปรับตั้งค่าทั่วไปผ่าน toggle และ slider |

| ความต้องการด้านฮาร์ดแวร์ | ขึ้นอยู่กับสถานการณ์ โมเดลขนาดใหญ่จะช้าถ้า hardware ไม่เพียงพอ | ขึ้นอยู่กับขนาดโมเดลและ hardware ของคุณเช่นกัน |

| ความเป็นส่วนตัว | ให้ความเป็นส่วนตัวดีเยี่ยมโดยค่าเริ่มต้น ไม่ต้องพึ่ง API ภายนอกเพิ่มเติม | ข้อความแชทอยู่ในเครื่องเสมอ แต่แอปยังคงติดต่อ server สำหรับอัปเดตและการค้นหา/ดาวน์โหลดโมเดล |

| การใช้งานแบบออฟไลน์ | รองรับการใช้งานออฟไลน์ได้เต็มรูปแบบหลังจากดาวน์โหลดโมเดลแล้ว | ใช้งานออฟไลน์ได้ดีเช่นกันเมื่อดาวน์โหลดโมเดลเสร็จแล้ว |

| แพลตฟอร์มที่มีให้บริการ | Linux, Windows, macOS | Linux, Windows, macOS |

- ปัญหาฮาร์ดแวร์กับโมเดลขนาดใหญ่: ใครๆ ก็อยากใช้โมเดลที่ใหญ่และมีความสามารถมากกว่าถ้าเลือกได้ แต่การรันโมเดลขนาดใหญ่บนแล็ปท็อปทั่วไปอาจสร้างปัญหาได้มาก เพราะโมเดลเหล่านี้กินทรัพยากร RAM และ VRAM สูง ผลที่ตามมาคือการตอบสนองที่ช้า, context length ที่จำกัด, หรือโมเดลโหลดไม่ขึ้นเลย

- ปัญหาแบตเตอรี่: การรัน LLM บนเครื่องตัวเองภายใต้โหลดหนักนั้นดูดแบตเตอรี่ได้เร็วมาก นอกจากแบตจะหมดเร็วแล้ว ยังต้องทนกับเสียงพัดลมและฮีตซิงค์ที่ดังน่ารำคาญอีกด้วย

Ollama vs LM Studio: การดาวน์โหลดโมเดล

อีกหนึ่งจุดที่ Ollama กับ LM Studio แตกต่างกันอย่างชัดเจนคือวิธีการดึงโมเดลมาใช้งาน อย่างที่กล่าวไปแล้วว่า Ollama ไม่ได้ติดตั้ง LLM ด้วยการคลิกเดียว แต่ต้องใช้คำสั่งผ่าน terminal ในตัวแทน อย่างไรก็ตาม คำสั่งเหล่านี้ไม่ได้ซับซ้อนอะไร

วิธีรันโมเดลบน Ollama แบบรวดเร็วมีดังนี้

- ดึงโมเดลที่ต้องการโดยพิมพ์ ollama pull gpt-oss หรือโมเดลอื่นที่ต้องการ (อย่าลืมระบุ tag ด้วย ซึ่งเลือกได้จาก library)

ตัวอย่าง: ollama pull gpt-oss:20b - จากนั้นรันโมเดลนั้นด้วยคำสั่ง ollama run gpt-oss

- เพิ่มเครื่องมือ coding อื่นๆ ได้เช่นกัน เช่น เพิ่ม Claude ด้วยคำสั่ง ollama launch claude

ถ้าไม่คุ้นเคยกับ terminal และคำสั่งต่างๆ ลอง LM Studio ดู ไม่ต้องพิมพ์คำสั่งใดๆ เลยเพื่อเริ่มใช้งานและดาวน์โหลดโมเดล แค่เลื่อนไปที่ตัวดาวน์โหลดโมเดลในตัวแล้วค้นหา LLM ด้วยคีย์เวิร์ดอย่าง Llama หรือ Gemma ได้เลย

หรือจะพิมพ์ Hugging Face URL แบบเต็มลงในช่องค้นหาก็ได้เช่นกัน

มีตัวเลือกให้เปิด discover tab จากที่ไหนก็ได้โดยกด ⌘ + 2 บน Mac หรือ Ctrl + 2 บน Windows / Linux

Ollama: เร็วกว่าในแง่ของความเร็ว

บางครั้งความเร็วคือสิ่งที่ผู้ใช้และธุรกิจให้ความสำคัญที่สุด และเมื่อพูดถึง Ollama vs LM Studio ในเรื่องนี้ Ollama ทำงานได้เร็วกว่า แม้ผลลัพธ์อาจแตกต่างกันไปตามการตั้งค่าและฮาร์ดแวร์ที่ใช้

จากกรณีของผู้ใช้รายหนึ่งใน subreddit r/ollama, Ollama ประมวลผลได้เร็วกว่า LM Studio

ไม่ใช่แค่ความรู้สึก เพราะผู้ใช้รายนั้นทดสอบทั้ง Ollama และ LM Studio จริงๆ โดยรัน qwen2.5:1.5b ห้าครั้งแล้วคำนวณค่าเฉลี่ย tokens per second

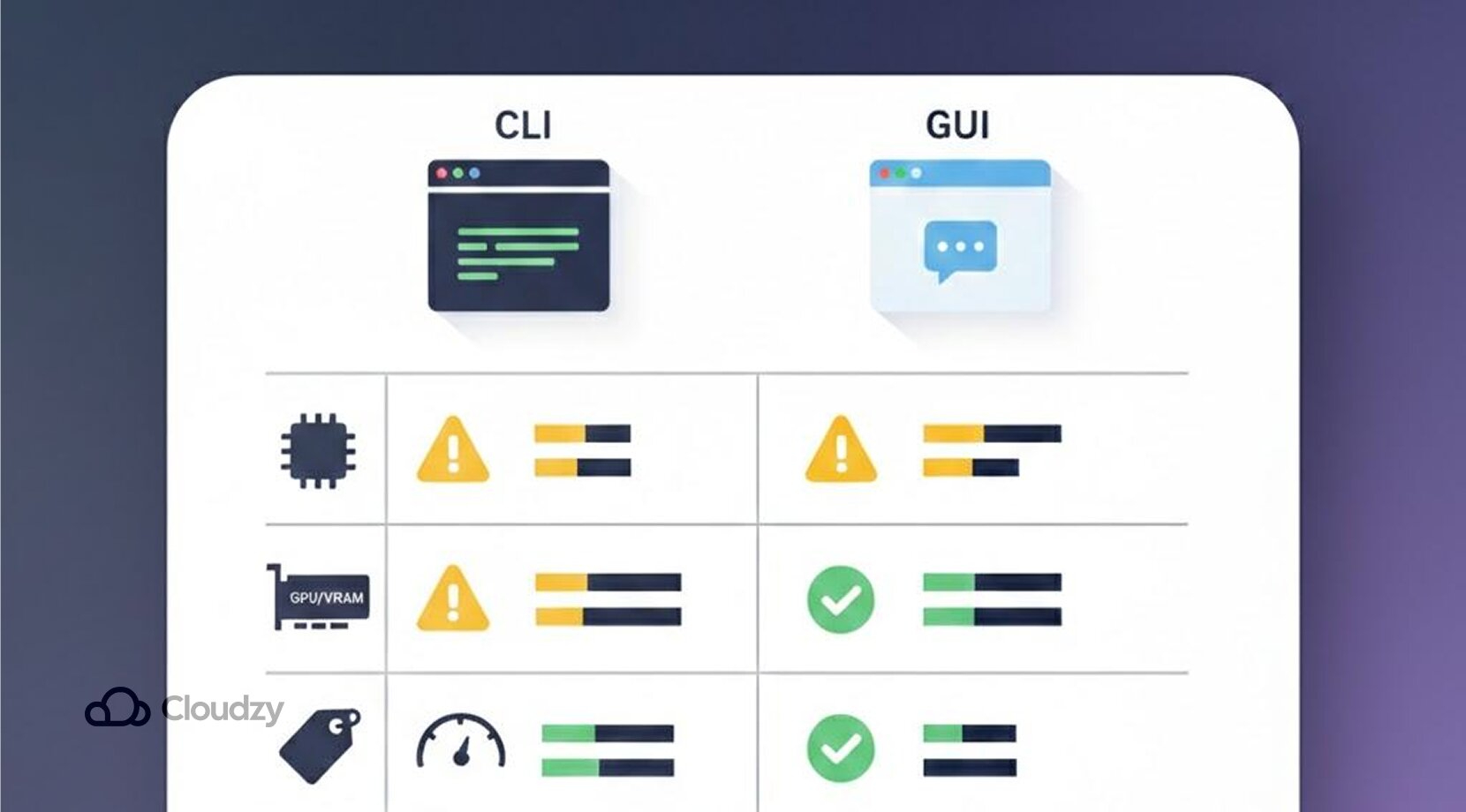

Ollama vs LM Studio: ประสิทธิภาพและความต้องการฮาร์ดแวร์

ในเรื่องประสิทธิภาพ การแข่งขันระหว่าง Ollama กับ LM Studio ขึ้นอยู่กับฮาร์ดแวร์มากกว่า UI การใช้ LLM บนเครื่องตัวเองครั้งแรกนั้นรู้สึกแตกต่างจาก LLM บน cloud มาก มันดีที่มี LLM เป็นของตัวเอง จนกว่าจะไปชนกำแพงด้านประสิทธิภาพ

เมื่อราคา RAM และ VRAM พุ่งสูงขึ้นมากในช่วงไม่กี่ปีที่ผ่านมา การอัปเกรดเครื่องให้มีพลังพอรัน LLM ขนาดใหญ่จึงไม่ใช่เรื่องง่าย

โมเดลยอดนิยมมักกิน RAM ถึง 24-64GB

ใช่แล้ว ความต้องการฮาร์ดแวร์ไม่ได้เป็นเรื่องของว่า Ollama หรือ LM Studio ใครดีกว่า ถ้าอยากใช้โมเดลขนาดกลางถึงใหญ่ได้อย่างราบรื่นโดยไม่สะดุด ทางเลือกที่ดีที่สุดคือติดตั้ง RAM ขนาด 24-64GB แต่ในหลายกรณี แม้แต่ขนาดนั้นก็ยังไม่เพียงพอเมื่อต้องรับมือกับ context ที่ยาวขึ้นหรือ workload ที่หนักขึ้น

คุณสามารถรัน model ขนาดเล็กที่เรียกว่า quantized model บน RAM ขนาด 8-16GB ได้ แต่จะไม่ได้ประสิทธิภาพเทียบเท่า model ขนาดใหญ่ และยังมีการแลกเปลี่ยนด้านคุณภาพกับความเร็วอยู่ดี นอกจากนี้ RAM ยังไม่ใช่ปัญหาเดียว ส่วนประกอบอื่น ๆ ก็ต้องแข็งแกร่งพอเช่นกัน

GPU ที่ทรงพลังคือรากฐานสำคัญในการทำงานที่ลื่นไหล

แม้ว่า model จะรันบน CPU ได้ แต่ GPU ยังคงมีบทบาทสำคัญ ถ้าไม่มี GPU ที่เร็วพอและ VRAM ในปริมาณมาก คุณจะเจอปัญหา token generation ที่ช้ามาก รอนานสำหรับการตอบสนองที่ยาว และในที่สุดก็ใช้งานไม่ได้จริง

อย่าคาดหวังมากเกินไป เพราะแม้แต่ RTX 5070Ti หรือ RTX 5080 ก็ยังไม่เพียงพอสำหรับ deep learning จริงจัง เพราะในบางการตั้งค่าที่มี context 60,000+ tokens นั้น Ollama ระบุว่าต้องการ VRAM ราว ~23GB ซึ่งมากกว่า 16GB VRAM ที่ได้จาก GPU พวกนั้นอย่างเห็นได้ชัด

การ Go สำหรับสเปกที่สูงกว่านั้นมีราคาสูงมาก และถึงแม้ราคาไม่ใช่ปัญหา ก็ยังมีบางเรื่อง ตัวเลือก GPU ที่ต้องพิจารณาเมื่อรัน LLM แบบ local

ถึงตอนนี้คุณอาจสับสนแล้วว่าจะประกอบเครื่องที่แข็งแกร่งพอสำหรับรัน local LLM model ขนาดใหญ่ได้อย่างไร และนี่คือจุดที่หลายคนเริ่มมองหาทางเลือกอื่น

ทางเลือกที่นักพัฒนาหลายคนให้ความสนใจคือการใช้ virtual machine ที่มาพร้อม hardware ที่ติดตั้งไว้พร้อมใช้ การใช้ VPS (virtual private server) เป็นวิธีที่ดีในการเชื่อมต่อ laptop หรืออุปกรณ์ส่วนตัวของคุณเข้ากับ server ส่วนตัวที่คุณเลือก โดยมีทุกอย่างตั้งค่าไว้ให้แล้ว

ถ้าคิดว่า VPS เป็นทางเลือกที่ใช่ เราแนะนำให้ลอง Ollama VPSของ Cloudzy ซึ่งให้คุณทำงานใน shell ที่สะอาด มาพร้อม Ollama ติดตั้งไว้ล่วงหน้า พร้อมใช้งานกับ local LLM ได้ทันทีพร้อมความเป็นส่วนตัวเต็มรูปแบบ ราคาเข้าถึงได้ มี 12 locations, uptime 99.95% และ support ตลอด 24/7 รวมถึง resource ที่ครบครัน ทั้ง dedicated VCPU, หน่วยความจำ DDR5 และ storage NVMe ผ่านการเชื่อมต่อสูงสุด 40 Gbps

Ollama vs LM Studio: ใครควรใช้อะไร

ดังที่กล่าวไว้ ทั้งสองแพลตฟอร์มมีความสามารถสูง และไม่มีอันไหนดีกว่าอีกอันอย่างชัดเจน แต่จุดสำคัญคือแต่ละแพลตฟอร์มเหมาะกับ workflow ต่างประเภทกัน ขึ้นอยู่กับสิ่งที่คุณต้องการ

เลือก Ollama สำหรับ Automation และการพัฒนา

เป้าหมายของ Ollama ไม่ใช่แค่การคุยกับ model แต่คือการนำ model ไปเป็นส่วนหนึ่งของโปรเจกต์อื่น Ollama เหมาะสำหรับ:

- นักพัฒนา การสร้างผลิตภัณฑ์อย่าง chatbot, copilot และผลิตภัณฑ์อื่น ๆ ที่ต้องใช้ deep learning

- Workflow ที่มี automation จำนวนมาก เช่น script สรุปรายงานหรือการสร้างฉบับร่างตามกำหนดเวลา

- ทีม ที่ต้องการ model version ที่สม่ำเสมอในทุก environment

- ผู้ใช้ที่ต้องการแนวทาง API-first เพื่อให้เครื่องมืออื่น ๆ เชื่อมต่อกับ model ได้อย่างสม่ำเสมอ

สรุปแล้ว ถ้าคุณต้องการให้ model ทำงานได้อย่างเชื่อถือได้ใน app ของคุณ Ollama อาจเป็นตัวเลือกที่ดีที่สุด

LM Studio คือทางเลือกที่เข้าถึงง่ายกว่าสำหรับ local LLM

ถ้าคุณต้องการลองใช้ AI บนเครื่องตัวเองโดยไม่อยากยุ่งกับการตั้งค่าที่ซับซ้อน LM Studio เป็นตัวเลือกที่เหมาะกว่าอย่างชัดเจน

โดยทั่วไป LM Studio เหมาะกับ:

- ผู้เริ่มต้น ที่ไม่คุ้นเคยกับ Terminal หรือคำสั่ง Command Line

- นักเขียน นักสร้างเนื้อหา หรือนักศึกษา ที่ต้องการแค่กล่องแชทสำหรับถามตอบกับ AI

- คนที่อยากลองหลายตัวเลือก เพื่อเปรียบเทียบโมเดลต่าง ๆ อย่างรวดเร็วและหาตัวที่เหมาะกับตัวเอง

- ผู้ที่เพิ่งเริ่มหัดเขียน Prompt และต้องการปรับการตั้งค่าโดยไม่ต้องพิมพ์คำสั่ง

พูดง่าย ๆ ถ้าคุณอยากดาวน์โหลดและเริ่มใช้ LLMs บนเครื่องตัวเองได้ทันที ให้ LM Studio ตอบโจทย์คุณ

Ollama vs LM Studio: ข้อสรุปและคำแนะนำ

ถ้าลองมองข้ามกระแสการเปรียบเทียบระหว่าง Ollama กับ LM Studio สิ่งที่สำคัญกว่าคือประสบการณ์การใช้งานจริงในแต่ละวัน ซึ่งขึ้นอยู่กับ Workflow และข้อจำกัดของฮาร์ดแวร์ที่คุณมี

Ollama โดยทั่วไปคือ:

- ยืดหยุ่นและออกแบบมาสำหรับนักพัฒนา

ในขณะที่ LM Studio คือ:

- ใช้งานได้สำหรับผู้เริ่มต้น พร้อม GUI ที่ใช้งานง่าย

ทั้งสองต้องใช้ฮาร์ดแวร์ที่ทรงพลังและราคาสูงจึงจะทำงานได้อย่างลื่นไหล หลายคนไม่มีทรัพยากรเพียงพอสำหรับการรัน LLMs ขนาดใหญ่บนเครื่องตัวเองทั้งหมด ดังนั้น ถ้าคุณต้องการรันโมเดลขั้นสูงโดยไม่กดดันฮาร์ดแวร์ของตัวเอง ลองพิจารณาใช้ Ollama บน GPU VPS แบบ Dedicatedด้านล่างนี้คือ คำถามที่พบบ่อยเกี่ยวกับ Ollama vs LM Studio