Якщо ви вирішуєте H100 проти RTX 4090 для AI пам'ятайте, що більшість «тестів» не мають значення, доки ваша модель і кеш фактично не вмістяться в VRAM. RTX 4090 — оптимальний варіант для роботи з одним GPU, який залишається в межах 24 ГБ.

H100 — це те, до чого ви звертаєтеся, коли потрібні більші моделі, вища паралельність, ізоляція для кількох користувачів або менше часу на маніпуляції з пам'яттю.

Розбиття за типами навантажень, огляд бенчмарків, потім швидкий план тестування, який ви можете запустити на своєму стеку.

Швидка відповідь: H100 проти RTX 4090 для AI-навантажень

H100 переважає для великомасштабного навчання і серйозного розгортання — дає великі HBM-пули, дуже високу пропускну спроможність пам'яті, NVLink і MIG для ізоляції. RTX 4090 краще підходить для «мені потрібна чудова продуктивність одного GPU за кращою ціною», якщо ваше навантаження вписується в 24 GB без постійних компромісів. Характеристики та особливості платформи роблять це цілком прямолінійним.

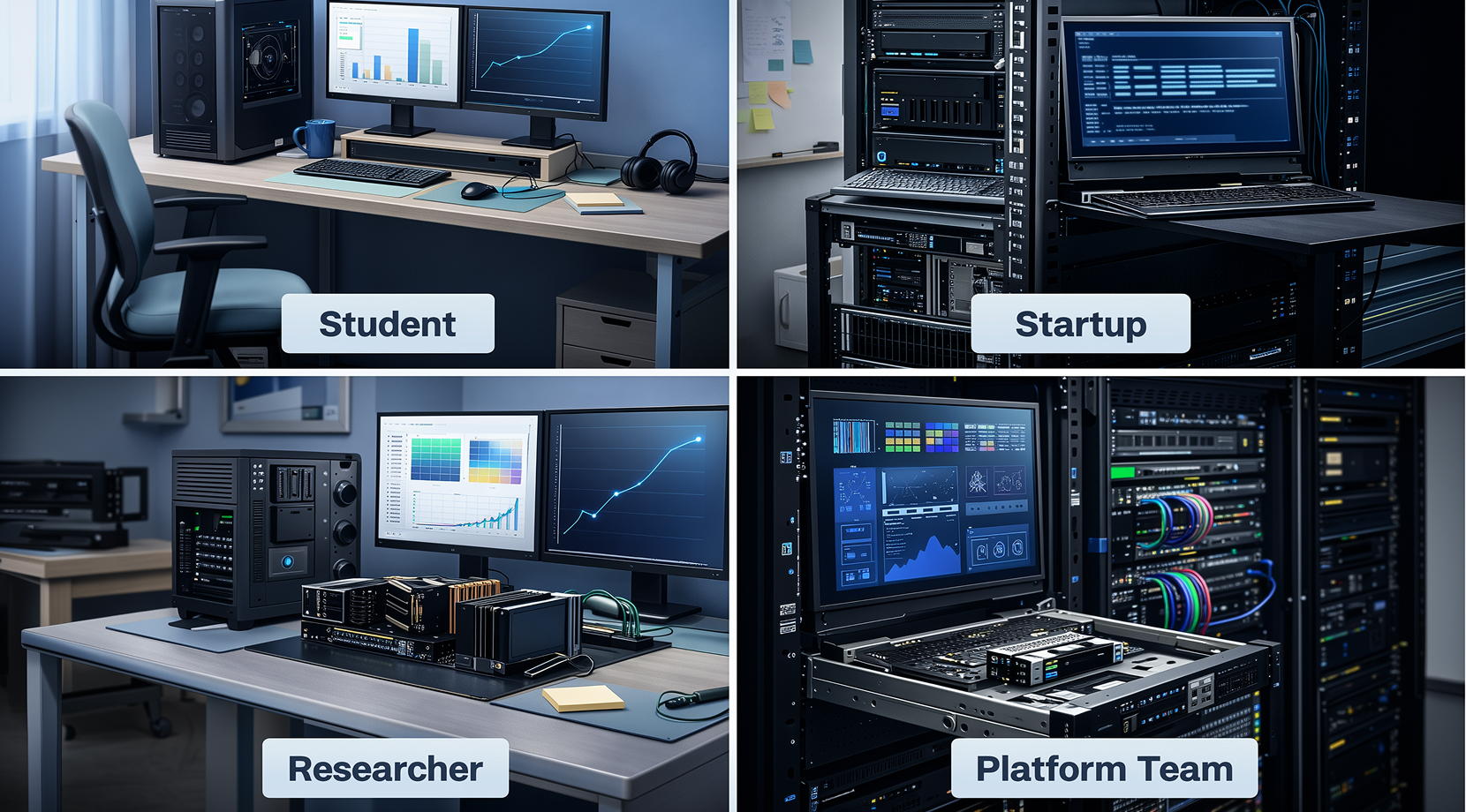

Швидкий список виборів за типом користувача:

- Локальний розробник LLM (Solo Dev / Student): RTX 4090 поки VRAM не стане вузьким місцем.

- Стартап ML-інженер (Запуск MVP): RTX 4090 для ранніх етапів розгортання та fine-tuning, H100 коли вам потрібна стійка конкурентність або більші моделі.

- Прикладний дослідник (Багато експериментів): H100 якщо ви постійно натикаєтесь на OOM, ліміти батчів або довгі контексти.

- Команда Production / Platform (Багатотенантне розгортання): H100 для MIG-слайсування, більше запасу по пам'яті і плавніше масштабування.

З цим розумінням, решта цієї статті про ліміти, на які натикаються в реальній роботі, та як бенчмарк-цифри з ними збігаються.

Єдине запитання щодо бенчмарків: Що має вмістити VRAM?

Більшість дискусій про H100 проти RTX 4090 насправді це суперечки про VRAM. У роботі з LLM VRAM займається ваги, активації під час навчання, стани оптимізатора під час навчання, а KV кеш під час виводу. Останнє — це те, що люди зазвичай не передбачають, тому що воно зростає з довжиною контексту та конкурентністю.

Таблиця нижче навмисне високорівнева, тому що точне вписування залежить від фреймворку, точності та overhead.

Ось вид «вписується без проблем?»:

| Робочий час | Типова реальність одного GPU на RTX 4090 (24 GB) | Типова реальність одного GPU на H100 (80–94 GB) |

| Висновування моделі LLM розміром 7B (FP16 / BF16) | Зазвичай все добре | Комфортний запас ресурсів |

| Висновування LLM розміром 13B | Часто щільно, залежить від контексту | Зазвичай все добре |

| Умовивід класу 70B | Потребує серйозного квантування/offload | Набагато реалістичніше |

| Інференція SD/SDXL + невелика партія | Зазвичай все добре | Добре, плюс більше місця для партій |

| Обслуговування з вищою паралельністю | KV cache тиск показує швидкість | Більше простору, більш стабільно під навантаженням |

Якщо потрібна ширша таблиця GPU (не лише ці два), наш огляд Найкращі GPU для машинного навчання у 2025 році — корисна довідкова таблиця RAM та пропускної здатності пам'яті для поширених AI GPU.

Як тільки ви переконаєтесь, що ваше завдання підходить, наступне, що визначає наскільки "гладко" це відчувається — це пропускна здатність пам'яті.

Пропускна здатність: чому HBM відчувається інакше

Більшість розмов про AI продуктивність зосереджені на пікових обчисленнях, але трансформери надзвичайно чутливі до переміщення даних в пам'яті. Перевага H100 полягає в тому, що він поєднує великі пулі HBM з дуже високою пропускною здатністю пам'яті, плюс пропускна здатність NVLink та розділення MIG на платформі.

Снімок специфікацій

Специфікація не виберуть GPU для вас, але вони пояснюють, чому одне й те саме завдання відчувається легко на одному прискорювачі та тісно на іншому. Цей снімок показує, що найбільше впливає на LLM навчання, інференцію та поведінку обслуговування.

| Специфікація | H100 (SXM / NVL) | RTX 4090 |

| VRAM | 80 GB / 94 GB | 24 GB |

| Пропускна здатність пам'яті | 3,35–3,9 ТБ/с | GDDR6X (обмежена за ємністю на 24 ГБ) |

| Міжз'єднання | NVLink + PCIe Gen5 | PCIe (платформа користувача) |

| Багатоекземплярність | До 7 екземплярів MIG | Н/Д |

Посилання на специфікації: NVIDIA H100, NVIDIA RTX 4090.

Що це означає на практиці:

- Якщо ви намагаєтесь збільшити розмір партії або довжину контексту, H100 зазвичай залишається стабільним довше, перш ніж вас змусять йти на компроміси.

- Якщо ви обслуговуєте багато запитів одночасно, H100 має більше "місця для дихання пам'яті", тому ви не отримуєте проблемну затримку хвоста так швидко.

- Якщо ваша робота переважно однокористувацька, одномодельна, скромний контекст, RTX 4090 часто відчувається швидким та задовільним.

Пропускна здатність не замінює гарного бенчмаркінгу, звичайно. Вона просто пояснює, чому два GPU можуть виглядати близько в вузькому тесті, а потім розходитися під реальним навантаженням.

Надійні бенчмарки H100 проти RTX 4090

Бенчмарки не однакові, і саме тому "мої цифри не співпадають з вашими" постійно трапляється. Для H100 проти RTX 4090корисно розділити бенчмарки на два напрями:

- Напрям A (спільнотний стиль): llama.cpp-style tokens/sec tests and simple inference scripts.

- Напрям B (стандартизовані набори): Результати стилю MLPerf Training та MLPerf Inference, які зосереджуються на повторюваних правилах.

Снимок висновків у стилі Llama.cpp

Це тест, який люди запускають вдома, а потім три дні сперечаються про результати. Він корисний, тому що відбиває «реальний інструментарій», який використовують розробники, але легко неправильно прочитати, якщо ігнорувати відповідність та точність.

Публічні порівняння у стилі llama.cpp показують, що RTX 4090 добре працює на менших моделях і при квантуванні, але великі моделі з вищою точністю суттєво перевищують межу VRAM.

Ось закономірність, яку ви повинні очікувати:

| Модель | GPU | Типовий результат |

| клас 7B | RTX 4090 | Високий показник tokens/sec, гладкий inference для одного користувача |

| 13B клас | RTX 4090 | Все ще гарно, але контекст і overhead починають мати значення |

| клас 70B | RTX 4090 | Не вписується добре без агресивного квантування/розвантаження |

| клас 70B | H100 | Набагато реалістичніше тримати в памяті і обслуговувати надійно |

Сенс цієї таблиці не в тому, що «4090 погано» або «H100 чарівність». Проблема в тому, що межа VRAM визначає, скільки ви можете тримати в памяті, а це впливає на швидкість, стабільність і обсяг налаштувань, які вам доведеться робити.

Якщо ви постійно скорочуєте довжину контексту, щоб вижити, то це момент, коли це порівняння перестає бути теоретичним.

Що MLPerf додає, чого не мають форумні бенчмарки

MLPerf існує, тому що «випадкові скрипти та вдалення» не працюють, коли ви приймаєте рішення на кілька тисяч доларів. MLCommons додав новіші стиль навантажень генеративного AI з часом, і MLPerf розроблений для того, щоб робити результати більш порівнянними між системами.

На стороні навчання стаття NVIDIA про MLPerf Training v5.1 є хорошим прикладом того, як постачальники звітують про час навчання з деталями про середовище подання та правила бенчмарку, які вони дотримуються.

Цей напрямок не скаже вам, як поводиться ваш приватний промпт, але він є перевіркою масштабування на рівні системи та «як цей клас обладнання працює за правилами».

Тепер поговоримо про частину, яка найбільше впливає на покупки - час та гроші, витрачені на завершення роботи.

Вартість, час і упущена вигода

Багато H100 проти RTX 4090 рішення часто формулюють як «ціна покупки проти ціни оренди». Це рідко правильна формулювання. Краще запитати: скільки годин вам знадобиться, щоб створити модель, яку ви насправді можете використовувати, і скільки часу ви втратите на боротьбу з обмеженнями?

Три типові сценарії дуже добре показують компроміси.

Щотижневе тонко-налаштування на моделях малого та середнього розміру

Якщо ваші запуски вкладаються в 24 ГБ без постійних компромісів, шлях з 4090 працює чудово. Ви розробляєте швидко, не потребуєте планування часу кластера, і налаштування просте. Якщо кожен запуск перетворюється на «зменшити batch, скоротити контекст, спробувати ще раз», H100 значно розумніша ідея, попри вищу вартість.

Обслуговування з реальною одночасністю

Одночасність швидко збільшує навантаження на KV cache. Тут запас міцності H100 і елементи управління платформи виправдовуються, особливо якщо вам потрібна передбачувана затримка.

Якщо ви все ще вагаєтесь, чи є сервер GPU взагалі правильною конфігурацією для вашого розгортання, наш GPU VPS проти CPU VPS порівняльний аналіз — гарний спосіб зіставити навантаження з типом інфраструктури, перш ніж витрачати час на оптимізацію не того.

Більші завдання навчання з дедлайнами

Щойно ви виходите за межі однієї людини та одного сервера, нудні речі — це те, на чому варто зосередитися: стабільні середовища, менше режимів відмови та менше часу, витраченого на те, що по суті є спостереженням. Це саме те, для чого розроблений H100.

Якщо ви все ще розтерзані після цього розділу, наступний крок — це не більше читання. Це перевірка поведінки вашого стека на практиці, включаючи конфлікти драйверів і робочі навантаження з кількома користувачами.

Програмне забезпечення та операції: драйвери, стабільність, багатокористувацькість та підтримка

Це частина, яку більшість таблиць порівняння пропускають, але вона займає значну частину повсякденного життя.

RTX 4090 популярний, тому що він доступний і швидкий для багатьох AI-робочих навантажень. Компромісом є те, що коли ваш випадок використання зростає, ви частіше натикатимесь на межі пам'яті та шаблони масштабування, які не розраховані на спільні багатооренді середовища.

H100 розроблений для кластерів. MIG — важливий елемент для команд платформи, тому що дозволяє розділити один GPU на ізольовані фрагменти, що зменшує проблеми зі «шумними сусідами» та значно спрощує планування потужностей. Офіційна специфікація H100 від NVIDIA перелічує до 7 екземплярів MIG залежно від форм-фактора.

Якщо ваше навантаження особисте та локальне, ви можете працювати на стороні 4090 довгий час. Якщо ваше навантаження багатокористувацьке та орієнтоване на клієнтів, H100 — безпечніший варіант.

Отже, загалом, хто що купувати?

Який вибрати для вашого навантаження

Для H100 проти RTX 4090, правильний вибір — це той, що усуває ваші найбільші перешкоди.

Локальний розробник LLM (самотній розробник / студент)

Вибирайте RTX 4090, якщо ви переважно працюєте з моделями 7B–13B, запускаєте квантовану інференцію, експериментуєте з RAG або працюєте над SDXL. Переходьте на вищий рівень, коли витрачаєте більше часу на роботу з пам'яттю, ніж на розробку того, на що вибралися.

ML-інженер стартапу (розгортання MVP)

Якщо ваш MVP — це одна модель з помірним трафіком і вона комфортно вміщується, 4090 — сильний старт. Якщо вам потрібна стабільна затримка при всплесках, вища одночасність або кілька робочих навантажень на сервері, H100 — спокійніший шлях.

Прикладний дослідник (багато експериментів)

Якщо вас часто змушують на компромісі, як зменшення розміру batch чи маніпуляції з точністю, H100 дає чистіші експерименти і менше марних запусків.

Виробництво / команда платформи (багатооренде обслуговування)

H100 — простий вибір, в основному тому, що MIG і вищий запас міцності спрощують планування потужностей і суттєво зменшують радіус поширення при проблемах.

Якщо ви все ще не готові вкладати в обладнання, оренда — найкращий варіант.

Практичний Компроміс: Спочатку Орендуйте GPU, Потім Вкладайте

Найпростіший спосіб прийняти рішення H100 проти RTX 4090 це запуск твій модель, твій підказки та твій довжину контексту на обох класах обладнання, потім порівняйте токени в секунду та затримку під навантаженням.

Саме тому ми створили Cloudzy GPU VPS, адже можна розгорнути GPU за менше однієї хвилини, встановити весь стек з повним доступом та припинити гадати за результатами чужих тестів.

Ось що ви отримаєте на наших планах GPU VPS:

- Виділені NVIDIA GPUs (включаючи варіанти класу RTX 4090 та A100), тому ваші результати не зміняться від сусідніх серверів.

- До 40 Гбіт/с мережі на всіх планах GPU, що критично для завантаження датасетів, багатовузлових робочих процесів та швидкого переміщення артефактів.

- NVMe SSD сховище, плюс DDR5 RAM та високочастотні варіанти CPU на всіх рівнях, щоб решта серверу не гальмувала GPU.

- Захист від DDoS і а 99.95% часу безперебійної роботи, тому тривалі завдання не зламаються від випадкових мережевих збоїв.

- Погодинне виставлення рахунків (корисно для коротких тестів) та Гарантія повернення коштів протягом 14 днів для безпечного тестування.

Запустіть ту саму контрольну перевірку на плані RTX 4090, потім повторіть на плані класу A100, коли будете працювати з більшими контекстами, вищою конкурентністю або більшими моделями. Після цього вибір між H100 проти RTX 4090 зазвичай стає очевидним з ваших власних логів.

Контрольна Перевірка: Пройдіть Тест Самостійно за 30 Хвилин

Якщо хочете рішення, яке можна обґрунтувати, зберіть чотири показники з того точного стека, який плануєте використовувати:

- Токени/сек при вашій цільовій довжині контексту

- latency p95 при очікуваній конкурентності

- Запас VRAM під час найінтенсивнішої фази

- Вартість на завершений запуск від початку до артефакту

Мінімальний тест з vLLM виглядає так:

pip install vllm transformers accelerate

python -m vllm.entrypoints.api_server \

--model meta-llama/Llama-3-8B-Instruct \

--dtype float16 \

--max-model-len 8192Якщо хочете чітко розуміти, що саме ви орендуєте, прочитайте нашу статтю про Що таке GPU VPS? пояснює різницю між виділеним доступом до GPU, спільним використанням vGPU та на що слід звернути увагу перед вибором тарифу.