Машинне навчання та його підрозділ, глибоке навчання, потребують значних обчислювальних ресурсів, які можуть забезпечити лише GPU. Але підійде не будь-яка GPU. Ось найкращі GPU для машинного навчання, пояснення того, чому вони необхідні, та поради щодо вибору потрібної для вашого проєкту.

Навіщо мені GPU для машинного навчання?

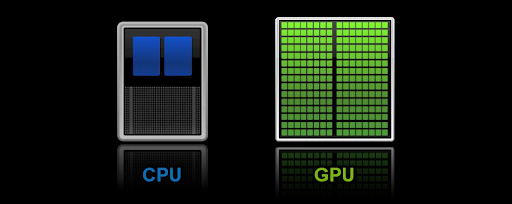

Як уже зазначалося, машинне навчання потребує значної обчислювальної потужності, яку можуть забезпечити лише GPU. CPU цілком справляться з невеликими задачами, але для всього, що виходить за межі однопотокових операцій або загальних обчислень, вони стануть вузьким місцем. Головна перевага GPU полягає в паралельній обробці даних і значно більшій кількості ядер. Типова CPU має від 4 до 16 ядер, тоді як найкращі GPU для машинного навчання можуть мати тисячі ядер, зокрема tensor cores, кожне з яких одночасно опрацьовує частину обчислення.

Саме паралельна обробка забезпечує набагато ефективніше виконання матричних обчислень і операцій лінійної алгебри порівняно з CPU. Саме тому GPU значно краще підходять для задач на кшталт тренування великих моделей машинного навчання. Втім, вибрати найкращу GPU для машинного навчання непросто.

Як вибрати найкращу GPU для AI та глибокого навчання

Більшість сучасних GPU достатньо потужні для стандартних завдань, але машинне та глибоке навчання вимагають іншого рівня продуктивності. Тож виникає закономірне питання: що робить GPU хорошою для глибокого навчання?

Хороша GPU для глибокого навчання повинна мати такі характеристики та можливості:

Cuda Cores, Tensor Cores та сумісність

AMD та Nvidia пропонують найкращі GPU для машинного навчання та глибокого навчання, причому Nvidia помітно випереджає конкурента. Це завдяки ядрам Tensor і CUDA у Nvidia. Ядра Tensor виконують обчислення, характерні для AI та машинного навчання, — зокрема матричне множення та згортки, які використовуються у глибоких нейронних мережах. Ядра CUDA, своєю чергою, забезпечують паралельну обробку даних, ефективно розподіляючи операції по всьому GPU. GPU без цих двох типів ядер, як правило, погано справляються з навантаженнями ML та глибокого навчання.

Водночас нещодавні оновлення платформи ROCm і прискорювачів серії MI від AMD покращили їхні GPU, і ви знайдете їх у нашому списку. Проте GPU від Nvidia залишаються кращим вибором для глибокого навчання завдяки добре відпрацьованій програмній екосистемі та широкій підтримці фреймворків (наприклад, TensorFlow, PyTorch, JAX). Найкращі GPU для машинного навчання мають добре сумісність з цими ML-фреймворками — невідповідність може призводити до втрат у швидкодії прискорення, проблем із підтримкою драйверів і бібліотек (наприклад, cuDNN і TensorRT від NVIDIA), а також обмежувати можливості масштабування в майбутньому.

Крім того, у вас може не бути повного доступу до інструментів набору NVIDIA CUDA toolkit — зокрема до бібліотек із прискоренням на GPU, компілятора та середовища виконання C і C++, а також засобів оптимізації та відлагодження.

VRAM (відеопам'ять RAM), стандарт пам'яті та пропускна здатність пам'яті

Як і в будь-якій комп'ютерній задачі, RAM відіграє важливу роль — і це однаково стосується найкращих GPU для машинного навчання та глибокого навчання. Оскільки набори даних для тренування моделей машинного навчання можуть бути надзвичайно великими (для глибокого навчання — до кількох TB), найкращі GPU для машинного навчання повинні мати достатній обсяг VRAM для швидкого доступу до даних. Моделям глибокого навчання потрібно значний обсяг пам'яті для зберігання ваг, активацій та інших проміжних даних під час тренування та інференсу. Найкращий GPU для тренування AI також повинен мати достатню пропускну здатність пам'яті, щоб ефективно переміщати великі набори даних і пришвидшувати обчислення.

Нарешті, стандарт пам'яті є важливим критерієм при виборі найкращих GPU для глибокого навчання. GPU зазвичай використовують пам'ять GDDR (Graphics Double Data Rate) або HBM (High Bandwidth Memory). GDDR забезпечує високу пропускну здатність для таких задач, як машинне навчання та ігри, однак найкращі GPU для машинного навчання використовують HBM — із значно вищою пропускною здатністю та кращою енергоефективністю.

| Тип GPU | Обсяг VRAM | Пропускна здатність пам'яті | Пам'ять Стандартна | Найкраще для |

| Початковий рівень (наприклад, RTX 3060, RTX 4060) | 8GB – 12GB | ~200-300 ГБ/с | GDDR6 | Невеликі моделі, класифікація зображень, хобі-проєкти |

| Середній рівень (наприклад, RTX 3090, RTX 4090) | 24GB | ~1000 ГБ/с | GDDR6X | Великі набори даних, глибокі нейронні мережі, трансформери |

| Високопродуктивні AI GPU (наприклад, Nvidia A100, H100, AMD MI300X) | 40GB – 80GB | ~1600+ ГБ/с | HBM2 | Великі мовні моделі (LLM), AI-дослідження, ML корпоративного рівня |

| Надвисокопродуктивні GPU (наприклад, Nvidia H100, AMD Instinct MI300X) | 80GB – 256GB | ~2000+ ГБ/с | HBM3 | Масштабне тренування AI, суперкомп'ютинг, дослідження на надвеликих наборах даних |

Для тих, хто працює безпосередньо з великими мовними моделями на кшталт ChatGPT, Cloudzy пропонує VPS, оптимізований для ChatGPT рішення з потужністю, необхідною для дообробки та інференсу без затримок.

TFLOPS (терафлопс) і точність із плаваючою комою

Продуктивність GPU визначається його обчислювальною потужністю, яка залежить від трьох факторів: TFLOPS, пропускної здатності пам'яті та точності з рухомою комою. Про пропускну здатність пам'яті ми вже говорили в контексті найкращого GPU для тренування AI — ось що означають два інші показники і чому вони важливі. TFLOPS, або терафлопс, — це одиниця, що вимірює швидкість виконання GPU складних обчислень. На відміну від тактової частоти процесора (кількості циклів за секунду), TFLOPS показує, скільки трильйонів операцій з рухомою комою GPU може виконати за секунду. Простіше кажучи, TFLOPS показує, наскільки GPU потужний у задачах з інтенсивними математичними обчисленнями.

Точність з рухомою комою, як випливає з назви, визначає рівень точності, який GPU забезпечує моделі. Найкращі GPU для глибокого навчання використовують вищу точність (наприклад, FP32), що дає точніші результати, але коштує продуктивності. Нижча точність (наприклад, FP16) пришвидшує обробку з незначною втратою точності — для задач AI та глибокого навчання це, як правило, прийнятно.

Почніть блогувати

Почніть блогувати

Розгорніть WordPress на потужному залізі з NVMe-сховищем і мінімальною затримкою по всьому світу. Обирайте зручний дистрибутив.

Отримати WordPress VPS| Точність | Випадок використання | Приклади застосування |

| FP32 (одинарна точність) | Тренування моделей глибокого навчання | Розпізнавання зображень (ResNet, VGG) |

| TF32 (TensorFloat-32) | Тренування зі змішаною точністю | NLP, рекомендаційні системи |

| FP16 (половинна точність) | Швидке висновування | Автономне керування, розпізнавання мовлення, AI-покращення відео |

Замість значних вкладень у фізичне залізо ви можете миттєво отримати доступ до Глибоке навчання Cloudzy GPU VPS, на базі RTX 4090s, оптимізованих для задач машинного навчання та глибокого навчання.

Найкращі GPU для машинного навчання у 2025 році

Тепер, коли ви розумієте, що має вміти найкращий GPU для машинного навчання, ось наш список найкращих GPUs, відсортованих за продуктивністю, пропускною здатністю пам'яті, VRAM тощо.

| GPU | VRAM | Пропускна здатність пам'яті | Пам'ять Стандартна | TFLOPS | Точність з рухомою комою | Сумісність |

| NVIDIA H100 NVL | 188 GB | 7.8 TB/s | HBM3 | 3,958 | FP64, FP32, FP16 | CUDA, TensorFlow |

| NVIDIA A100 Tensor Core | 80 GB | 2 TB/s | HBM2 | 1,979 | FP64, FP32, FP16 | CUDA, TensorFlow, PyTorch |

| NVIDIA RTX 4090 | 24 GB | 1.008 TB/s | GDDR6X | 82.6 | FP32, FP16 | CUDA, TensorFlow |

| NVIDIA RTX A6000 Tensor Core | 48 GB | 768 GB/s | GDDR6 | 40 | FP64, FP32, FP16 | CUDA, TensorFlow, PyTorch |

| NVIDIA GeForce RTX 4070 | 12 GB | 504 GB/s | GDDR6X | 35.6 | FP32, FP16 | CUDA, TensorFlow |

| NVIDIA RTX 3090 Ti | 24 GB | 1.008 TB/s | GDDR6X | 40 | FP64, FP32, FP16 | CUDA, TensorFlow, PyTorch |

| AMD Radeon Instinct MI300 | 128 GB | 1.6 TB/s | HBM3 | 60 | FP64, FP32, FP16 | ROCm, TensorFlow |

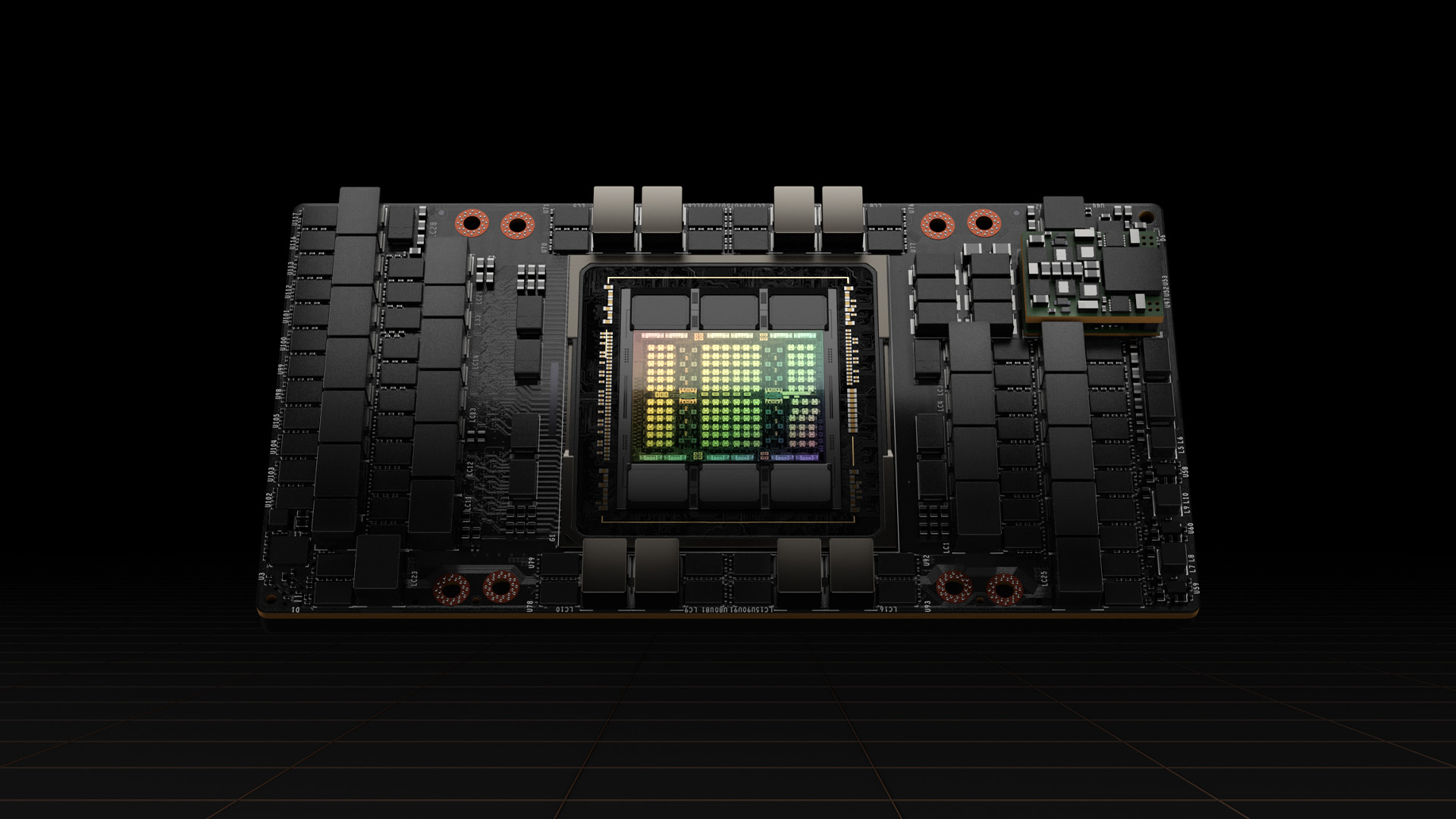

NVIDIA H100 NVL

Найкращий GPU для машинного навчання - H100 NVL - забезпечує виняткову продуктивність для глибокого навчання у великих масштабах і оптимізований для багатоорендних високопродуктивних задач.

- Найкраще для: Передові дослідження у сфері AI, навчання великомасштабних моделей та інференс.

- Недолік: Дуже висока вартість, призначений переважно для корпоративного використання або дослідницьких середовищ.

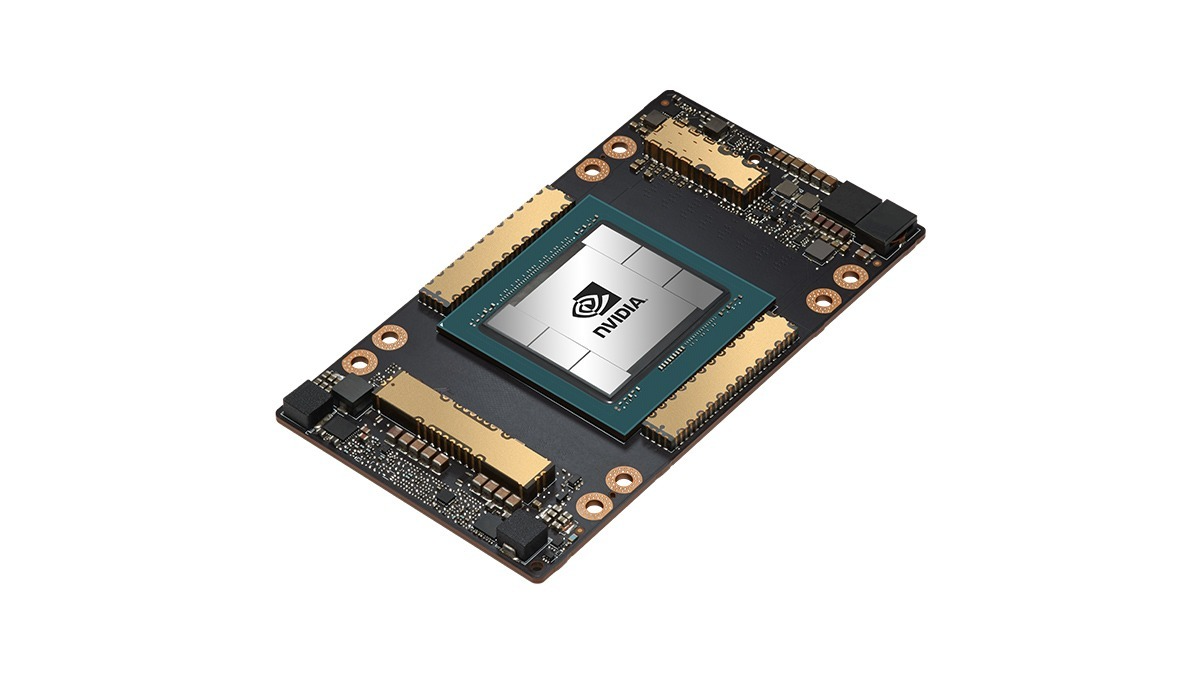

NVIDIA A100 графічний процесор Tensor Core

A100 забезпечує значну продуктивність для нейронних мереж завдяки 80 GB пам'яті з високою пропускною здатністю (HBM2) - підходить для задач з підвищеним навантаженням.

- Найкраще для: Великомасштабні моделі машинного навчання, дослідження AI та хмарні застосунки.

- Недолік: Висока вартість, орієнтований переважно на корпоративний сегмент.

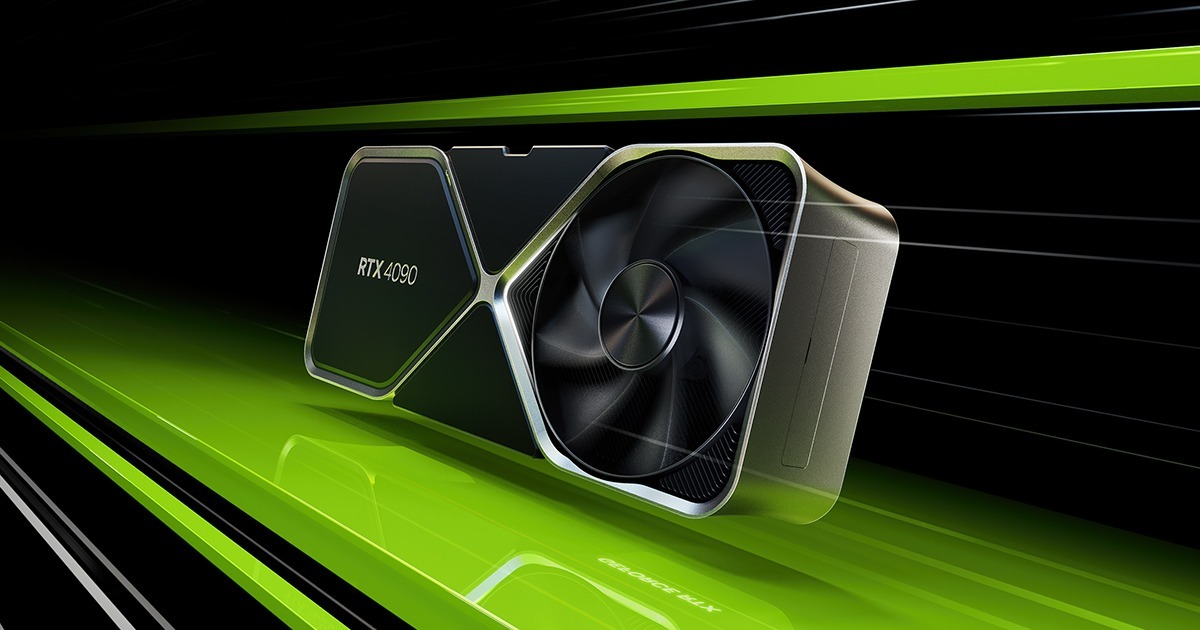

NVIDIA RTX 4090

Відмінний вибір як для ігор, так і для задач AI: 24 GB пам'яті GDDR6X і потужні можливості паралельних обчислень.

- Найкраще для: Складні задачі ML і дослідження AI, що потребують значних обчислювальних ресурсів.

- Недолік: Високе енергоспоживання, висока вартість і великі розміри.

NVIDIA RTX A6000 Tensor Core GPU

Підтримує AI-застосунки завдяки 48 GB пам'яті GDDR6, добре підходить для робочих станцій і фахівців у галузі створення контенту.

- Найкраще для: Дослідження AI, глибоке навчання та високопродуктивні задачі.

- Недолік: Висока вартість, як правило орієнтований на професійне середовище.

NVIDIA GeForce RTX 4070

Goе співвідношення ціни та продуктивності з потужними можливостями трасування променів: 12 GB пам'яті GDDR6X

- Найкраще для: Ентузіасти та невеликі компанії з середніми потребами в машинному навчанні.

- Недолік: Обмежено підходить для великих наборів даних і дуже великих моделей.

NVIDIA RTX 3090 Ti

NVIDIA RTX 3090 Ti — великий обсяг пам'яті (24 GB GDDR6X) і висока обчислювальна потужність. Відмінний вибір для навчання моделей середнього та великого розміру.

- Найкраще для: Ентузіасти та дослідницькі проєкти, яким потрібна потужна обробка даних AI.

- Недолік: Висока вартість, велике енергоспоживання — і надлишковий вибір для невеликих проєктів.

AMD Radeon Instinct MI300

Відмінно справляється з навантаженнями AI та HPC, із конкурентоспроможною продуктивністю.

- Найкраще для: Навантаження машинного навчання на платформах під AMD.

- Недолік: Поступається NVIDIA у глибокому навчанні: менше підтримуваних фреймворків і менш зрілий екосистемний інструментарій.

Хмарні GPU VPS від Cloudzy

Один із найкращих GPU для машинного навчання сьогодні — безумовно, H100. Проте він дорогий, суттєво підвищує рахунки за електроенергію, а його розміри можуть змусити вас або купувати більший корпус, або переробляти всю систему. Клопітна справа. Саме тому у Cloudzy ми пропонуємо хмарний GPU для машинного навчання — щоб ви не переймалися жодним із цих питань. Наш GPU VPS оснащений двома GPU NVIDIA H100, 4 TB NVMe SSD сховища, пропускною здатністю 25 TB на секунду та 48 vCPU!

Усе це за доступними цінами з погодинною та місячною оплатою за фактичним використанням, а також широким вибором способів оплати: PayPal, Alipay, кредитні картки (через Stripe), PerfectMoney, Bitcoin та інші криптовалюти.

І наостанок: якщо наш сервіс вас не задовольнить — ми повернемо гроші протягом 14 днів.

Хмарні платформи доповненої реальності (AR) значною мірою покладаються на високопродуктивні GPU для відтворення імерсивних середовищ у реальному часі. GPU з ядрами CUDA і Tensor незамінні не лише для навчання моделей глибокого навчання — вони так само важливі для рендерингу складних AR-середовищ і підтримки функцій на базі AI: розпізнавання об'єктів і просторового картографування. У Cloudzy наші AR Cloud хмарні сервери GPU забезпечують стабільну продуктивність, низьку затримку та гнучке масштабування — ідеальний вибір для компаній, які розгортають AR-застосунки у великих масштабах.

Чи розробляєте ви AI-застосунки, навчаєте моделі або проводите дослідження — наші Рішення AI VPS хмарні GPU розроблені так, щоб забезпечувати максимальну продуктивність за значно нижчою ціною, ніж у разі купівлі власного обладнання.

Завершальні думки

Обчислювальні потреби зростають, а моделі AI стають дедалі більшими і складнішими — GPU точно залишатимуться невід'ємною частиною нашого технологічного середовища. Тому варто розібратися, як вони влаштовані і як працюють.

Саме тому я дуже раджу ознайомитися з Тім Деттмерсматеріалом про все, що варто знати про GPU, і практичними порадами щодо вибору GPU. Автор — визнаний науковець із глибоким знанням глибокого навчання.