Machine Learning und sein Teilgebiet Deep Learning brauchen enorme Rechenleistung, die nur GPUs liefern können. Aber nicht jede GPU ist dafür geeignet. Hier sind die besten GPUs für Machine Learning, warum sie unverzichtbar sind und wie du die richtige für dein Projekt auswählst.

Warum brauche ich eine GPU für Machine Learning?

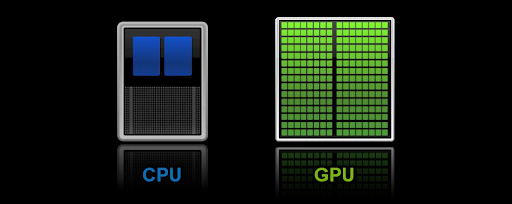

Wie bereits erwähnt, braucht Machine Learning erhebliche Rechenleistung, die nur GPUs bereitstellen können. CPUs reichen zwar für kleinere Anwendungen aus, aber sobald Aufgaben über einfaches Single-Threaded-Computing oder General-Purpose-Computing hinausgehen, stoßen sie schnell an ihre Grenzen und verursachen Flaschenhälse. Der entscheidende Unterschied liegt in der Parallelverarbeitungsfähigkeit der GPU und der deutlich höheren Anzahl an Cores. Eine typische CPU hat 4 bis 16 Cores, während die besten GPUs für Machine Learning tausende von Cores besitzen – insbesondere Tensor Cores, von denen jeder gleichzeitig einen Teil der Berechnung übernimmt.

Diese Parallelverarbeitung ist der Schlüssel, um Matrix- und Linearargebra-Berechnungen wesentlich effizienter zu bewältigen als CPUs. Deshalb sind GPUs beim Training großer Machine-Learning-Modelle so viel leistungsfähiger. Die richtige GPU für Machine Learning zu finden ist allerdings keine leichte Aufgabe.

Die richtige GPU für AI und DL auswählen

Die meisten GPUs kommen mit typischen Aufgaben gut zurecht. Machine Learning und Deep Learning stellen jedoch deutlich höhere Anforderungen an Leistung und Qualität. Die entscheidende Frage lautet daher: Was zeichnet eine gute GPU für Deep Learning aus?

Eine gute GPU für Deep Learning sollte folgende Eigenschaften und Features mitbringen:

CUDA Cores, Tensor Cores und Kompatibilität

AMD und Nvidia bieten die besten GPUs für Machine Learning und DL – wobei Nvidia klar vorne liegt. Das liegt an den Tensor Cores und CUDA Cores von Nvidia. Tensor Cores sind auf Berechnungen spezialisiert, die im AI- und ML-Bereich häufig vorkommen, wie Matrixmultiplikationen und Faltungsoperationen, die in tiefen neuronalen Netzen eingesetzt werden. CUDA Cores ermöglichen es den besten GPUs für AI-Training, Operationen effizient auf der GPU zu verteilen und so echte Parallelverarbeitung zu erreichen. GPUs ohne diese beiden Kerntypen kommen bei ML- und DL-Workloads schnell an ihre Grenzen.

AMD hat seine GPUs durch Upgrades der ROCm-Plattform und der MI-Series-Beschleuniger deutlich verbessert, weshalb sie auch auf unserer Liste erscheinen. Dennoch bleiben Nvidias GPUs die erste Wahl für Deep Learning: Das liegt am ausgereiften Software-Ökosystem und der breiten Framework-Unterstützung, etwa für TensorFlow, PyTorch und JAX. Die besten GPUs für Machine Learning sollten mit diesen ML-Frameworks gut kompatibel sein – Inkompatibilitäten führen zu Leistungseinbußen bei der Beschleunigung, Problemen mit Treibern und Bibliotheken wie NVIDIAs cuDNN und TensorRT sowie eingeschränkter Zukunftssicherheit.

Außerdem haben Sie möglicherweise keinen vollständigen Zugriff auf die Tools des NVIDIA CUDA-Toolkits, wie z. B. GPU-beschleunigte Bibliotheken, einen C- und C++-Compiler samt Runtime sowie Optimierungs- und Debugging-Tools.

VRAM (Video RAM), Speicherstandard und Speicherbandbreite

Wie bei allem rund um Computer spielt RAM eine entscheidende Rolle - das gilt auch bei der Wahl der richtigen GPUs für Machine Learning und Deep Learning. Da Trainingsdatensätze für ML-Modelle sehr groß werden können (bis zu mehreren TB beim Deep Learning), sollten die besten GPUs für Machine Learning ausreichend VRAM für schnellen Zugriff bieten. Deep-Learning-Modelle benötigen während Training und Inferenz erheblich Speicher, um Gewichte, Aktivierungen und andere Zwischendaten zu halten. Die beste GPU für das KI-Training sollte zudem eine hohe Speicherbandbreite haben, damit große Datensätze schnell verschoben und Berechnungen beschleunigt werden können.

Schließlich ist der Speicherstandard ein wichtiger Faktor bei der Wahl der besten GPUs für Deep Learning. GPUs nutzen in der Regel GDDR (Graphics Double Data Rate) oder HBM (High Bandwidth Memory). GDDR bietet zwar hohe Bandbreite für Anwendungen wie Machine Learning und Gaming, doch die besten ML-GPUs setzen auf HBM - mit deutlich höherer Bandbreite und besserem Wirkungsgrad.

| GPU-Typ | VRAM-Kapazität | Speicherbandbreite | Speicherstandard | Geeignet für |

| Einstiegsklasse (z. B. RTX 3060, RTX 4060) | 8GB – 12GB | ~200–300 GB/s | GDDR6 | Kleine Modelle, Bildklassifizierung, Hobbyprojekte |

| Mittelklasse (z. B. RTX 3090, RTX 4090) | 24GB | ~1.000 GB/s | GDDR6X | Große Datensätze, tiefe neuronale Netze, Transformer |

| High-End-KI-GPUs (z. B. Nvidia A100, H100, AMD MI300X) | 40GB – 80GB | ~1.600+ GB/s | HBM2 | Large Language Models (LLMs), KI-Forschung, ML auf Unternehmensebene |

| Super-High-End-GPUs (z. B. Nvidia H100, AMD Instinct MI300X) | 80GB – 256GB | ~2.000+ GB/s | HBM3 | KI-Training im großen Maßstab, Supercomputing, Forschung mit riesigen Datensätzen |

Speziell für alle, die an Large Language Models wie ChatGPT arbeiten, Cloudzy bietet eine ChatGPT-optimierte VPS Lösung mit der nötigen Leistung für reibungsloses Fine-Tuning und Inferenz.

TFLOPS (Teraflops) und Floating-Point-Genauigkeit

Die Leistung einer GPU wird durch ihre Rechenkapazität bestimmt. Diese hängt von drei Faktoren ab: TFLOPS, Memory Bandwidth und Floating-Point Precision. Memory Bandwidth haben wir bereits im Artikel über die besten GPUs für AI-Training behandelt. Hier erklären wir, was die anderen beiden bedeuten und warum sie wichtig sind. TFLOPS (Teraflops) misst, wie schnell eine GPU komplexe Berechnungen durchführt. Statt der Taktfrequenz eines Prozessors (Zyklen pro Sekunde) gibt TFLOPS an, wie viele Billionen Gleitkommaoperationen eine GPU pro Sekunde ausführen kann. Kurz gesagt: TFLOPS zeigt, wie leistungsfähig eine GPU bei rechenintensiven Aufgaben ist.

Floating-Point Precision gibt an, wie genau die Berechnungen sind, die eine GPU dem Modell erlaubt. Die besten GPUs für Deep Learning arbeiten mit höherer Präzision (z. B. FP32), was genauere Ergebnisse liefert, aber mehr Rechenleistung kostet. Niedrigere Präzision (z. B. FP16) beschleunigt die Verarbeitung bei leicht reduzierter Genauigkeit - für AI- und Deep-Learning-Aufgaben ist das in der Regel akzeptabel.

Blog starten

Blog starten

Hosten Sie WordPress selbst auf leistungsstarker Hardware mit NVMe-Speicher und geringer Latenz weltweit. Wählen Sie Ihre bevorzugte Distribution.

WordPress VPS holen| Präzision | Anwendungsfall | Beispielanwendungen |

| FP32 (Einfache Genauigkeit) | Training von Deep-Learning-Modellen | Bilderkennung (ResNet, VGG) |

| TF32 (TensorFloat-32) | Mixed-Precision-Training | NLP, Empfehlungssysteme |

| FP16 (Halbe Genauigkeit) | Schnelle Inferenz | Autonomes Fahren, Spracherkennung, KI-Videooptimierung |

Statt in teure physische Hardware zu investieren, können Sie sofort auf Cloudzys Deep-Learning-GPU VPSzugreifen, betrieben von RTX 4090s und optimiert für Machine-Learning- und Deep-Learning-Workloads.

Die besten GPUs für Machine Learning 2025

Nachdem Sie nun wissen, worauf es bei den besten GPUs für Machine Learning ankommt, finden Sie hier unsere Rangliste der besten GPUs - sortiert nach TFLOPS, Memory Bandwidth, VRAM und weiteren Kriterien.

| GPU | VRAM | Speicherbandbreite | Speicherstandard | TFLOPS | Gleitkomma-Genauigkeit | Kompatibilität |

| NVIDIA H100 NVL | 188 GB | 7.8 TB/s | HBM3 | 3,958 | FP64, FP32, FP16 | CUDA, TensorFlow |

| NVIDIA A100 Tensor Core | 80 GB | 2 TB/s | HBM2 | 1,979 | FP64, FP32, FP16 | CUDA, TensorFlow, PyTorch |

| NVIDIA RTX 4090 | 24 GB | 1.008 TB/s | GDDR6X | 82.6 | FP32, FP16 | CUDA, TensorFlow |

| NVIDIA RTX A6000 Tensor Core | 48 GB | 768 GB/s | GDDR6 | 40 | FP64, FP32, FP16 | CUDA, TensorFlow, PyTorch |

| NVIDIA GeForce RTX 4070 | 12 GB | 504 GB/s | GDDR6X | 35.6 | FP32, FP16 | CUDA, TensorFlow |

| NVIDIA RTX 3090 Ti | 24 GB | 1.008 TB/s | GDDR6X | 40 | FP64, FP32, FP16 | CUDA, TensorFlow, PyTorch |

| AMD Radeon Instinct MI300 | 128 GB | 1.6 TB/s | HBM3 | 60 | FP64, FP32, FP16 | ROCm, TensorFlow |

NVIDIA H100 NVL

Die GPU und die H100 NVL bieten herausragende Performance für Deep Learning in großem Maßstab – optimiert für Multi-Tenant-Workloads mit hohen Anforderungen.

- Am besten geeignet für: Anspruchsvolle KI-Forschung, Training großer Modelle und Inferenz auf hohem Niveau.

- Nachteil: Extrem teuer und hauptsächlich für Unternehmens- oder Forschungsumgebungen geeignet.

NVIDIA A100 Tensor-Core-GPU

Die A100 bietet mit 80 GB High-Bandwidth-Speicher (HBM2) enorme Rechenleistung für neuronale Netze und eignet sich für rechenintensive Workloads.

- Am besten geeignet für: Umfangreiche Machine-Learning-Modelle, KI-Forschung und cloudbasierte Anwendungen.

- Nachteil: Teuer, hauptsächlich auf Unternehmen ausgerichtet.

NVIDIA RTX 4090

Ideal für Gaming und KI-Workloads: 24 GB GDDR6X-Speicher und hohe parallele Rechenleistung.

- Am besten geeignet für: ML-Aufgaben und KI-Forschung mit hohem Rechenaufwand.

- Nachteil: Stromhungrig, teuer und sperrig.

NVIDIA RTX A6000 Tensor Core GPU

Unterstützt KI-Anwendungen mit 48 GB GDDR6-Speicher – geeignet für Workstations und professionelle Anwender.

- Am besten geeignet für: KI-Forschung, Deep Learning und rechenintensive Workloads.

- Nachteil: Hohe Kosten, in der Regel für professionelle Umgebungen geeignet.

NVIDIA GeForce RTX 4070

Good bietet ein ausgewogenes Preis-Leistungs-Verhältnis mit starken Ray-Tracing-Fähigkeiten und 12 GB GDDR6X-Speicher.

- Am besten geeignet für: Enthusiasten und kleinere Unternehmen mit mittlerem Bedarf an maschinellem Lernen.

- Nachteil: Begrenzte VRAM für größere Datensätze und sehr große Modelle.

NVIDIA RTX 3090 Ti

NVIDIA RTX 3090 TiHohe Speicherkapazität (24 GB GDDR6X) und Rechenleistung, ideal zum Trainieren mittelgroßer bis großer Modelle.

- Am besten geeignet für: Enthusiasten und Forschungsanwendungen, die leistungsstarke KI-Verarbeitung benötigen.

- Nachteil: Sehr kostspielig, hoher Stromverbrauch und für kleinere Projekte oft überdimensioniert.

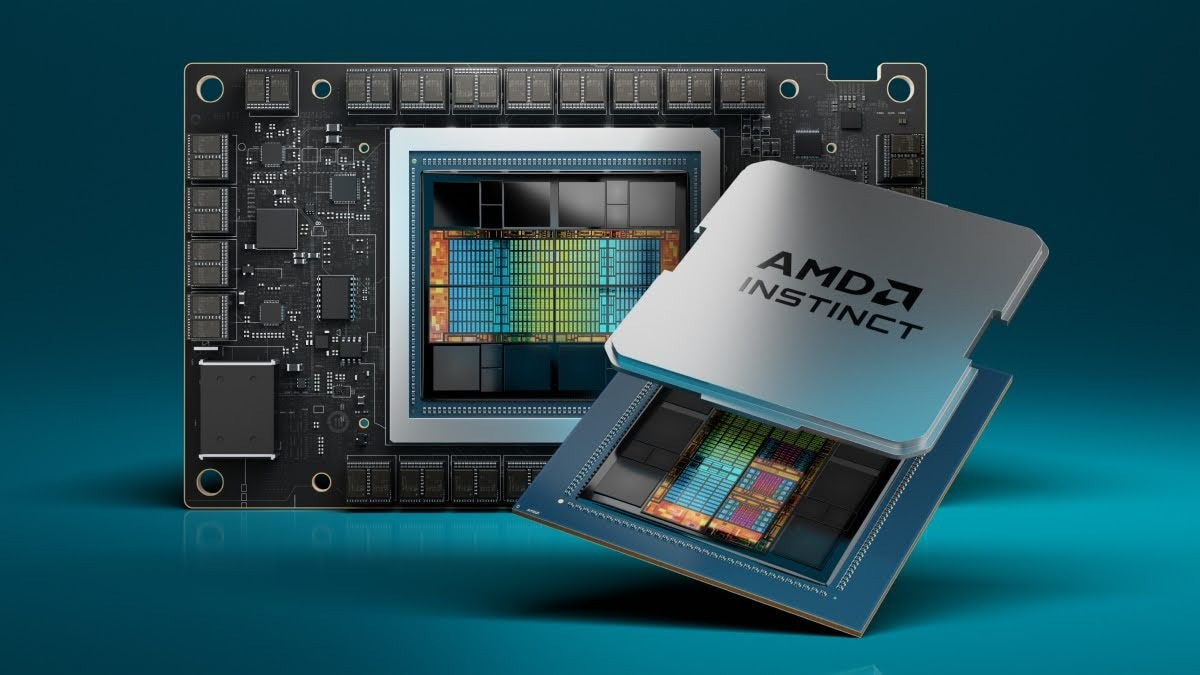

AMD Radeon Instinct MI300

Gut geeignet für KI- und HPC-Workloads mit wettbewerbsfähiger Leistung.

- Am besten geeignet für: Machine-Learning-Workloads auf AMD-basierten Setups.

- Nachteil: Im Deep Learning weniger etabliert als NVIDIA, mit geringerer Framework-Unterstützung.

Cloud GPU VPS von Cloudzy

Eine der besten GPUs für maschinelles Lernen ist zweifellos die RTX 4090. Allerdings ist sie teuer, treibt die Stromkosten in die Höhe, und ihre Größe kann dazu zwingen, auf ein größeres Gehäuse umzusteigen oder andere Komponenten anzupassen. Ein echter Aufwand. Deshalb bietet Cloudzy jetzt eine Online-GPU für maschinelles Lernen an, damit Sie sich um all das keine Gedanken machen müssen. Unser GPU VPS ist mit bis zu 2 Nvidia RTX 4090 GPUs, 4 TB NVMe SSD-Speicher, 25 TB pro Sekunde Bandbreite und 48 vCPUs ausgestattet!

Alles zu erschwinglichen Preisen mit stunden- oder monatsweiser Abrechnung nach Verbrauch sowie einer Vielzahl an Zahlungsoptionen wie PayPal, Alipay, Kreditkarten (über Stripe), PerfectMoney, Bitcoin und anderen Kryptowährungen.

Und sollten Sie im schlimmsten Fall mit unserem Service nicht zufrieden sein, gewähren wir eine 14-tägige Geld-zurück-Garantie.

Augmented-Reality-(AR-)Cloud-Plattformen sind in hohem Maße auf leistungsstarke GPUs angewiesen, um Echtzeit-Erlebnisse zu liefern. Genau wie GPUs mit CUDA- und Tensor-Kernen unverzichtbar für das Training von Deep-Learning-Modellen sind, spielen sie eine ebenso wichtige Rolle beim Rendern komplexer AR-Umgebungen und bei KI-gestützten Funktionen wie Objekterkennung und räumlichem Mapping. Bei Cloudzy nutzt unsere AR Cloud fortschrittliche GPU-Technologie, um niedrige Latenz und zuverlässige Leistung sicherzustellen - ideal für Unternehmen, die AR-Anwendungen in großem Maßstab einsetzen möchten.

Ob Sie KI-Anwendungen entwickeln, Modelle trainieren oder Forschung betreiben - unsere KI-VPS-Lösungen sind darauf ausgelegt, die bestmögliche GPU-Leistung zu einem Bruchteil der üblichen Kosten zu liefern.

Fazit

Da der Bedarf an Rechenleistung wächst und KI-Modelle immer größer und komplexer werden, werden GPUs zweifellos ein fester Bestandteil unseres Alltags. Es lohnt sich daher, sich näher damit zu beschäftigen und zu verstehen, wie sie funktionieren und was sie leisten.

Deshalb empfehle ich Ihnen dringend, sich das anzusehen Tim Dettmers' Beitrag über alles Wissenswerte zu GPUs sowie praktische Tipps bei der Auswahl einer GPU. Er ist akademisch ausgezeichnet und verfügt über fundiertes Fachwissen im Bereich Deep Learning.