Avec une demande toujours croissante pour les LLM locaux, beaucoup d'utilisateurs ne savent plus où donner de la tête au moment de choisir. Mais les utiliser n'est pas aussi simple qu'il y paraît. Gourmands en ressources, parfois plus que d'autres, nombre d'entre eux préfèrent s'en tenir à l'écart, sans parler des heures que les débutants peuvent passer à fixer un terminal.

Deux solutions se démarquent toutefois et simplifient la vie. Ollama et LM Studio sont parmi les plateformes les plus utilisées pour faire tourner des LLM en local, avec des performances solides. Choisir entre les deux n'est pas évident, car chacune répond à des flux de travail différents. Sans plus attendre, examinons ce qui oppose Ollama à LM Studio.

Ollama : un outil pensé pour les profils techniques

Parmi les solutions pour exécuter des LLM en local, Ollama se distingue par la richesse de ses fonctionnalités. Hautement configurable et entièrement gratuite, c'est une plateforme open source soutenue par sa communauté.

Si Ollama facilite l'exécution de LLM en local, il reste CLI-first (interface en ligne de commande) et exige donc une certaine maîtrise du terminal. Cette approche est un vrai atout pour les workflows de développement, grâce à sa simplicité. Travailler en CLI n'est pas trivial, mais c'est bien moins fastidieux à appréhender que de faire tourner des LLM en local de zéro.

Ollama transforme votre ordinateur en mini-serveur local doté d'une HTTP API, ce qui donne à vos applications et scripts accès à ses nombreux modèles. Il répond aux requêtes exactement comme un LLM en ligne, sans envoyer vos données vers le cloud. Sa API permet en outre d'intégrer Ollama directement dans des sites web et des chatbots.

De par sa nature CLI, Ollama est aussi particulièrement léger : moins gourmand en ressources, il concentre ses efforts sur les performances. Cela ne veut pas dire qu'il tourne sur n'importe quelle machine, mais c'est une option intéressante pour ceux qui veulent dédier un maximum de ressources au modèle LLM lui-même.

Vous l'aurez compris, Ollama est clairement orienté vers les workflows de développement. Grâce à son intégration facile, au respect de la confidentialité en local et à sa conception API-first, c'est le choix évident si vous avez un profil développeur.

Dans le débat Ollama vs LM Studio, Ollama peut être préférable grâce à son approche API-first. Si un environnement CLI vous semble trop austère, lisez la suite pour découvrir une option plus légère, conçue pour la simplicité.

LM Studio : une option accessible à tous

LM Studio est à l'opposé de Ollama. Là où ce dernier repose entièrement sur la ligne de commande, LM Studio ne nécessite aucune commande terminal : doté d'une interface graphique (GUI), il ressemble à n'importe quelle application de bureau. Pour certains débutants, choisir entre Ollama et LM Studio revient à choisir entre la simplicité du CLI et le confort d'une GUI.

En supprimant les barrières techniques, LM Studio offre un espace accessible à tous les profils. Plutôt que d'ajouter et de lancer des modèles via des lignes de commande, vous utilisez simplement les menus et saisissez vos messages dans une interface de chat. LM Studio est ainsi utilisable par pratiquement n'importe qui pour explorer des LLM en local, tant son apparence rappelle celle de ChatGPT.

Il intègre même un navigateur de modèles directement dans l'application, permettant de découvrir et de déployer le modèle de son choix, des modèles légers pour un usage courant aux modèles plus lourds pour des tâches exigeantes. Ce navigateur fournit de courtes descriptions des modèles disponibles ainsi que leurs cas d'usage recommandés, et permet de les télécharger en un clic.

Si la plupart des modèles sont gratuits, certains peuvent être soumis à des licences et conditions d'utilisation spécifiques. Pour certains workflows, LM Studio propose également un mode serveur local pour faciliter les intégrations, mais il reste avant tout conçu autour d'une interface de bureau simple, destinée aux débutants. Cela dit, comparons maintenant Ollama et LM Studio côte à côte.

Points clés à retenir : Ollama vs LM Studio

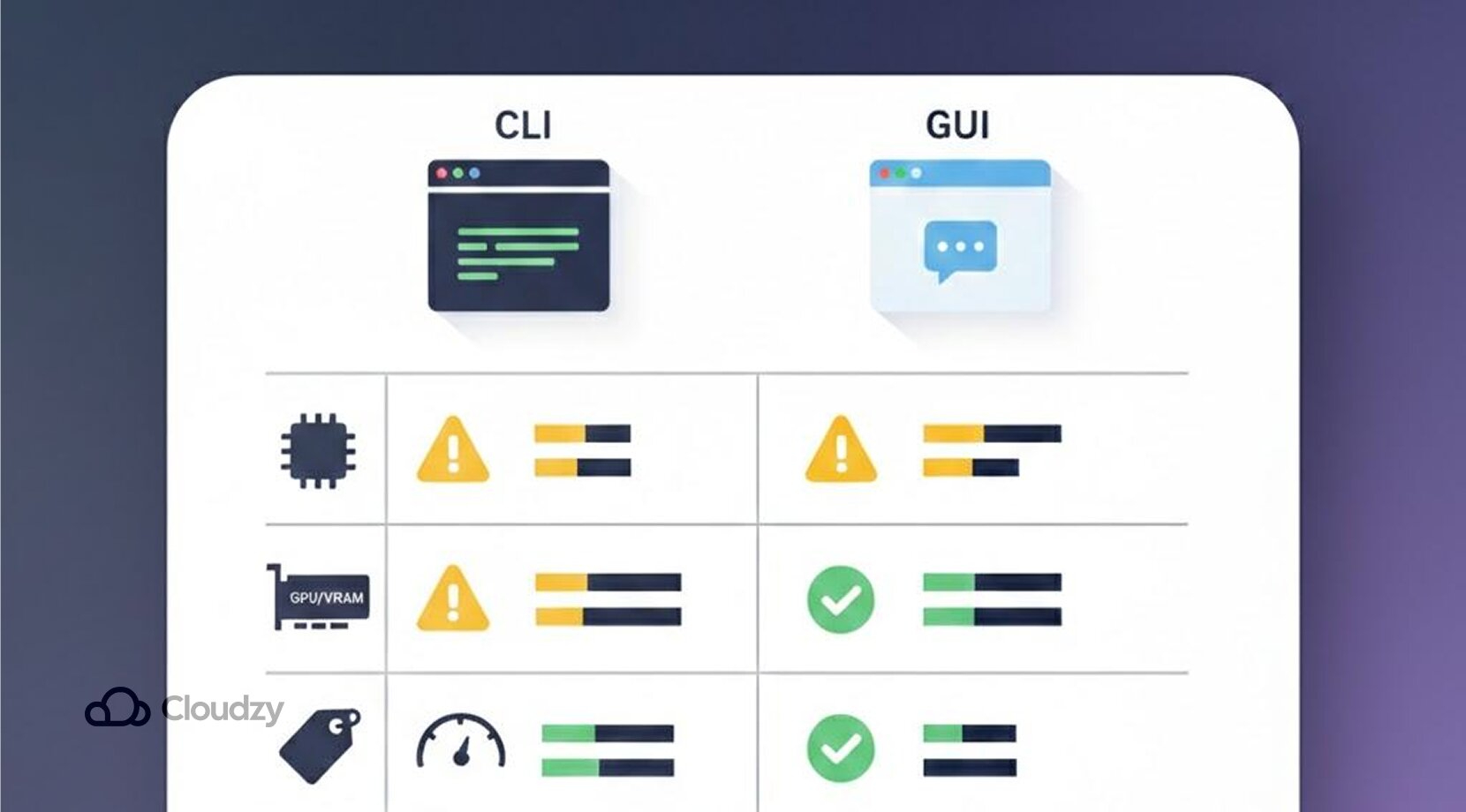

Avant d'aller plus loin, il faut clarifier un point essentiel : la formulation « Ollama vs LM Studio » pourrait laisser penser que l'un est objectivement meilleur que l'autre, mais ce n'est pas si simple, car ils s'adressent à des publics différents. Voici un aperçu rapide de Ollama vs LM Studio.

| Fonctionnalité | Ollama | LM Studio |

| Facilité d'utilisation | Moins accessible au départ, nécessite des connaissances du terminal | Accessible aux débutants, tout se fait à la souris |

| Modèles supportés | De nombreux modèles open-weight populaires : gpt-oss, gemma 3, qwen 3 | Les mêmes que Ollama : gpt-oss, gemma3, qwen3 |

| Personnalisation | Très personnalisable, s'intègre facilement via API | Moins de liberté, les réglages courants se font via des boutons et curseurs |

| Exigences matérielles | Cela dépend ; les grands modèles sont plus lents si le matériel n'est pas suffisant | Là aussi, cela dépend de la taille du modèle et de votre configuration matérielle |

| Confidentialité | Confidentialité native, sans API externe supplémentaire | Les conversations restent en local ; l'application contacte tout de même des serveurs pour les mises à jour et la recherche ou le téléchargement de modèles. |

| Utilisation hors ligne | Entièrement utilisable hors ligne après téléchargement des modèles | Également très bien adapté au hors ligne une fois les modèles téléchargés |

| Plateformes disponibles | Linux, Windows, macOS | Linux, Windows, macOS |

- Les grands modèles, un vrai casse-tête matériel : On est naturellement tenté d'utiliser un modèle plus grand et plus performant dès que possible. Mais sur la plupart des ordinateurs portables, cela peut poser de vrais problèmes : les grands modèles sont plus gourmands en RAM et en VRAM, ce qui peut se traduire par des réponses lentes, un contexte limité, voire l'impossibilité de charger le modèle.

- Autonomie de la batterie : Faire tourner des LLM en local peut vider rapidement la batterie sous charge élevée. Résultat : une autonomie réduite, sans parler du bruit agaçant des ventilateurs et du dissipateur thermique.

Ollama vs LM Studio : télécharger des modèles

La façon de télécharger les modèles est une autre différence notable entre Ollama et LM Studio. Comme mentionné plus haut, Ollama n'installe pas les LLM en local en un seul clic. Il faut passer par son terminal intégré et utiliser des lignes de commande. Ces commandes restent toutefois simples à comprendre.

Voici comment lancer des modèles sur Ollama rapidement.

- Téléchargez le modèle de votre choix avec la commande ollama pull gpt-oss, ou tout autre modèle disponible (pensez à préciser un tag, que vous pouvez choisir dans la bibliothèque).

Exemple : ollama pull gpt-oss:20b - Vous pouvez ensuite exécuter le modèle en question avec la commande ollama run gpt-oss

- D'autres outils de développement peuvent également être ajoutés. Vous pouvez par exemple intégrer Claude avec ollama launch claude

Si les terminaux et les lignes de commande ne vous sont pas familiers, LM Studio est fait pour vous. Pas besoin de taper quoi que ce soit dans un terminal pour commencer à l'utiliser et télécharger des modèles. Il suffit d'ouvrir le téléchargeur de modèles intégré et de rechercher des LLMs par mots-clés comme Llama ou Gemma.

Vous pouvez aussi saisir des Hugging Face URLs complets dans la barre de recherche.

Il est même possible d'accéder à l'onglet de découverte depuis n'importe où en appuyant sur ⌘ + 2 sur Mac, ou sur Ctrl + 2 sur Windows / Linux.

Ollama : l'avantage en matière de vitesse

La vitesse est parfois le critère décisif, que ce soit pour les particuliers ou les entreprises. Dans la comparaison Ollama vs LM Studio, Ollama se montre généralement plus rapide, même si les résultats peuvent varier selon la configuration matérielle.

Comme l'a montré un utilisateur Reddit dans le subreddit r/ollama, Ollama a traité les requêtes plus vite que LM Studio.

Ce n'est pas une affirmation en l'air : cet utilisateur a testé Ollama et LM Studio en exécutant qwen2.5:1.5b cinq fois, puis a calculé la moyenne de tokens par seconde.

Ollama vs LM Studio : performances et configuration matérielle requise

Quand on compare Ollama et LM Studio sur le plan des performances, c'est le matériel qui fait la différence, pas l'interface. Faire tourner des LLMs en local pour la première fois, c'est une expérience à part entière par rapport aux LLMs cloud auxquels on est habitués. Avoir un LLM rien que pour soi, c'est agréable, jusqu'à ce qu'on se heurte aux limites du matériel.

Avec la flambée des prix des RAM et VRAM ces dernières années, équiper sa machine pour faire tourner de grands LLMs est devenu un vrai défi.

Les modèles populaires engloutissent facilement 24 à 64 Go de RAM

C'est la réalité. La question du Ollama vs LM Studio ne change rien aux besoins en matériel. Pour faire tourner des modèles populaires de taille moyenne à grande sans ralentissements ni plantages, il faut compter sur 24 à 64 Go de RAM. Dans bien des cas, même cette quantité devient insuffisante face à des contextes longs ou des charges de travail importantes.

Il est possible de faire tourner des modèles plus petits, souvent appelés modèles quantifiés, avec 8 à 16 Go de RAM, mais les performances et la qualité ne sont pas comparables aux grands modèles, sans compter les compromis inévitables sur la vitesse et la précision. Et le RAM n'est pas le seul facteur : les autres composants doivent également être à la hauteur.

Un GPU puissant est indispensable pour éviter les frustrations

Même si les modèles peuvent tourner sur des CPUs, le GPU reste un élément clé. Sans un GPU rapide et une quantité suffisante de VRAM, vous vous retrouverez avec une génération token par token très lente, de longs délais pour les réponses complexes, et une expérience qui devient vite pénible.

N'espérez pas trop, car même le tout-puissant RTX 5070Ti ni le RTX 5080 ne suffisent pas pour du deep learning sérieux. En effet, pour certaines configurations avec plus de 60 000 tokens de contexte, Ollama lui-même indique environ 23 Go de VRAM, soit bien plus que les 16 Go de VRAM habituellement offerts par ces GPUs.

Chercher quelque chose au-delà de cette plage de puissance revient aussi à des prix astronomiques. Si le budget n'est pas un obstacle, il reste quelques options GPU à envisager pour faire tourner des LLMs en local.

À ce stade, vous vous demandez peut-être comment assembler une machine suffisamment puissante pour exécuter des modèles LLM locaux plus volumineux. C'est souvent là que beaucoup de gens commencent à envisager une autre approche.

Une alternative populaire consiste à utiliser des machines virtuelles disposant d'un matériel performant et préconfiguré. Un VPS (serveur privé virtuel), par exemple, permet de connecter votre ordinateur personnel à un serveur privé de votre choix, avec tous les prérequis déjà en place.

Si un VPS vous semble être une bonne solution, nous vous recommandons vivement le VPS Ollamade Cloudzy, où vous travaillez dans un environnement shell propre. Ollama y est préinstallé, vous pouvez donc vous lancer directement avec des LLMs locaux, en toute confidentialité. La solution est abordable : 12 emplacements géographiques, 99,95 % de disponibilité et un support 24h/24, 7j/7. Les ressources sont au rendez-vous : vCPUs dédiés, mémoire DDR5 et stockage NVMe sur une liaison allant jusqu'à 40 Gbps.

Ollama vs LM Studio : lequel choisir ?

Comme mentionné plus haut, les deux plateformes sont pleinement fonctionnelles et aucune n'est objectivement supérieure à l'autre. La différence tient au type de flux de travail que vous avez.

Choisissez Ollama pour l'automatisation et le développement

Avec Ollama, l'objectif n'est pas simplement de discuter avec un modèle, mais de l'intégrer comme composant dans un projet plus large. Ollama est idéal pour :

- Développeurs créer des produits tels que des chatbots, des copilotes ou d'autres applications nécessitant du deep learning

- Les workflows fortement automatisés, comme les scripts de synthèse de rapports ou la génération de contenus planifiée

- Les équipes qui souhaitent des versions de modèles cohérentes dans tous leurs environnements

- Les utilisateurs qui préfèrent une approche API-first, afin que d'autres outils puissent se connecter régulièrement aux modèles

En définitive, si vous voulez des modèles fiables pour vos applications, Ollama est probablement le bon choix.

LM Studio : l'option la plus accessible pour débuter avec les LLMs locaux

Si vous souhaitez explorer des configurations d'IA en local sans vous embarrasser de complexité technique, LM Studio est clairement le meilleur choix.

En général, LM Studio convient mieux aux :

- Débutants qui appréhendent le terminal et ses lignes de commande

- Rédacteurs, créateurs ou étudiants qui ont besoin d'une interface de chat simple pour interagir avec l'IA

- Personnes qui aiment tester différentes options, pour comparer rapidement plusieurs modèles et trouver celui qui leur correspond

- Tous ceux qui s'initient aux prompts et préfèrent ajuster les paramètres sans passer par le clavier

En résumé, si vous voulez télécharger des LLMs en local et les utiliser immédiatement, LM Studio est fait pour vous.

Ollama vs LM Studio : recommandation finale

Au-delà de l'effervescence autour de la comparaison entre Ollama et LM Studio, ce qui compte vraiment, c'est votre expérience au quotidien : votre flux de travail et les limites de votre matériel.

Ollama est en général :

- Flexible et orienté développeurs

Tandis que LM Studio est :

- Accessible aux débutants grâce à une interface graphique dédiée

Les deux nécessitent un matériel puissant et coûteux pour fonctionner correctement. Tout le monde n'a pas les moyens de faire tourner un grand LLM en local par ses propres moyens. C'est pourquoi, si vous souhaitez exécuter des modèles avancés sans solliciter excessivement votre matériel, envisagez d'utiliser Ollama sur un VPS GPU dédié. Voici quelques questions fréquentes sur Ollama vs LM Studio.