A helyi LLMs iránti kereslet folyamatos növekedésével sok felhasználó zavarban van a megfelelő kiválasztása során, de a használatuk nem olyan egyszerű, mint gondolnánk. Mivel meglehetősen energiaigényesek, néhány még annál is több, sokan inkább kerülik őket, nem beszélve arról, hogy az kezdők hosszú órákat tölthetnek a terminál ablakát bámulva.

Azonban két kiemelkedő megoldás létezik, amely megkönnyíti az életet. Az Ollama és az LM Studio a helyi LLMs futtatásához két legszélesebb körben használt platform, nagy teljesítménnyel. De a választás közöttük nehéz lehet, mert mindkettőt más munkafolyamatokhoz tervezték. Rögtön nézzük meg az Ollama és az LM Studio közötti összehasonlítást.

Ollama a technikai szakértők számára kifejlesztett eszköz

A helyi LLMs futtatók tekintetében az Ollama erős választás sok funkciója miatt. Nem csak erősen konfigurálható, de ingyenesen is hozzáférhetsz, mivel közösség által támogatott nyílt forráskódú platform.

Bár az Ollama egyszerűbbé teszi a helyi LLMs futtatást, CLI-alapú (parancssor), ezért még mindig szükséges valamilyen terminál-ismeret. A CLI-alapú felépítés nagy előny a fejlesztési munkafolyamatok számára az egyszerűsége miatt. Igaz, hogy a CLI-vel való munka nem könnyű, de kevesebb időbe telik megérteni, mint a helyi LLMs saját kezeléssel futtatása.

Az Ollama a személyi számítógépedet egy helyi mini-szerverré alakítja HTTP API segítségével, így az alkalmazások és szkriptek hozzáférhetnek a sok modellhez, ami azt jelenti, hogy ugyanúgy válaszol a kérésekre, mint egy online LLM, anélkül hogy az adataid a felhőbe kerülnének. Nem említve, hogy az API lehetővé teszi a felhasználók számára az Ollama integrálását és webhelyekbe, illetve chatbotokba történő beépítését.

CLI-alapú volta miatt az Ollama meglehetősen könnyű, kevesebb erőforrást igényel és teljesítmény-orientáltabb. Ez azonban nem azt jelenti, hogy a leggyengébb számítógépen is futna, de azoknak az felhasználóknak ígéretes, akik maximálisan akarnak erőforrást felhasználni a LLM modellhez.

Mindezek után azt gondolod, hogy az Ollama erősen a fejlesztési munkafolyamatokra összpontosít, és igazad van. Az egyszerű integráció, a helyi adatvédelme és a API-központú felépítése miatt nyilvánvaló választás, ha fejlesztői gondolkodásmódra orientálted magad.

Az Ollama és az LM Studio közötti vitában az Ollama jobban előnyben részesülhet API-alapú fejlesztése miatt. Ha a CLI futtatás túl ismeretlen számodra, maradj nálunk egy egyszerűbb lehetőségért, ami a könnyű használattal lett megtervezve.

LM Studio: Felhasználóbarát lehetőség

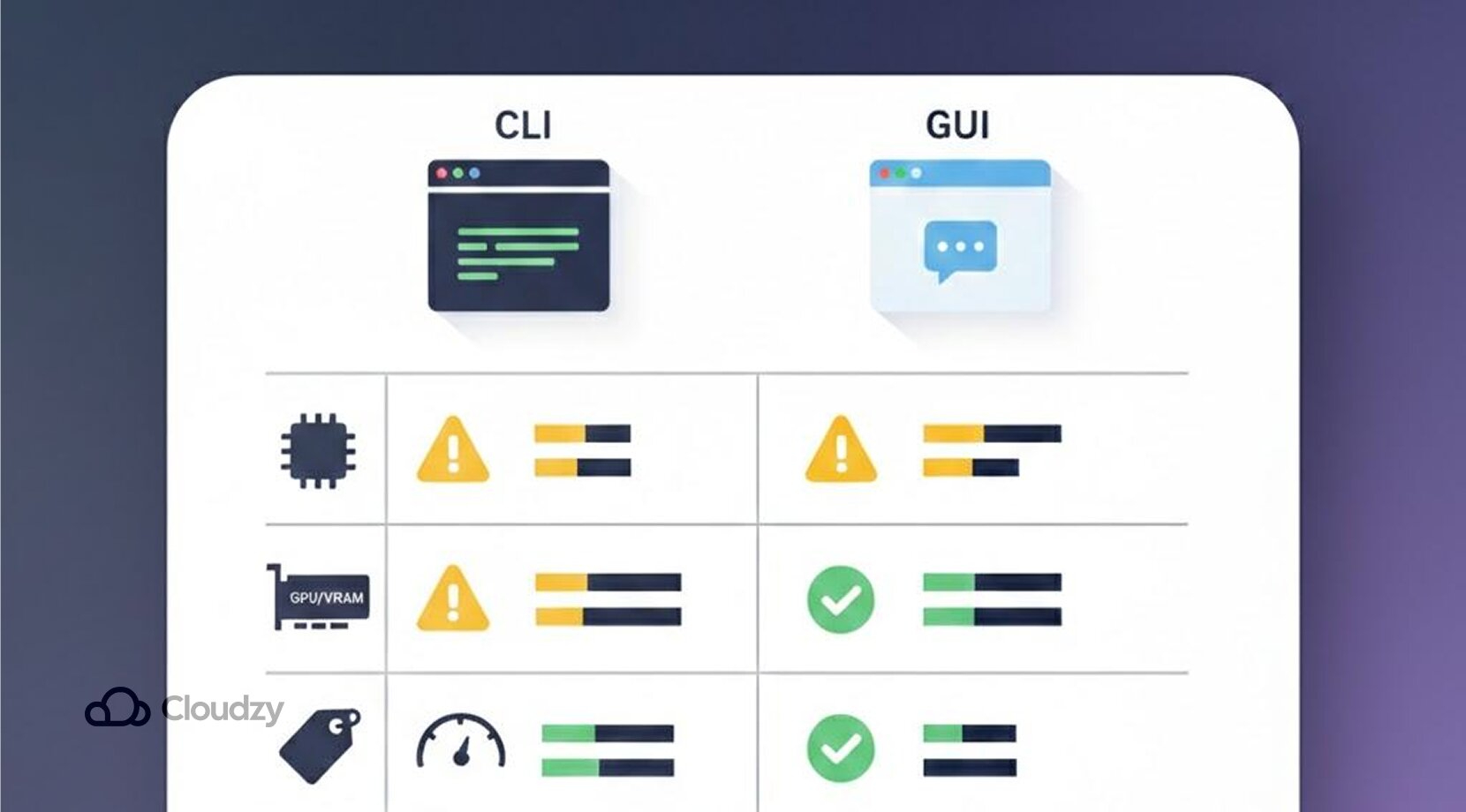

LM Studio markáns ellentétben áll az Ollama-val. Ahelyett, hogy teljes értékű CLI interfész lenne, nem igényel terminálparancsokat a futtatáshoz, és mivel GUI-val (grafikus felhasználói felülettel) van felszerelve, pontosan úgy néz ki, mint bármely más asztali alkalmazás. Néhány kezdő számára az Ollama és az LM Studio közötti választás a CLI egyszerűsége és a GUI közötti döntésre redukálódik.

Az LM Studio techikai akadályok eltávolítására irányuló megközelítése sokat tesz azért, hogy egyszerű helyet biztosítson bármely felhasználó számára. Ahelyett, hogy parancssor segítségével modelleket adnál hozzá és futtassz, egyszerűen használhatod a rendelkezésre álló menüket és beírhatod a szöveget egy csevegéshez hasonló mezőbe. Úgy tűnik, hogy bárki használhatja az LM Studio-t helyi LLM-ek kipróbálásához, mivel az felhasználói felület gördülékenynek tűnik a ChatGPT-hez képest.

Még egy ügyes, alkalmazáson belüli modellfúrészlő is van, ahol a felhasználók felfedezhetnek és telepíthetnek tetszőleges modelleket, az egyszerűbb feladatokra tervezett könnyűelosztállytól a nehezebb feladatokhoz szükséges erőspakettekig. Ezenkívül ez a böngésző rövid leírásokat ad a rendelkezésre álló modellekről és ajánlott felhasználási esetekről, és lehetővé teszi a felhasználók számára a modellek egyetlen kattintással történő letöltését.

Bár a legtöbb modell ingyenesen letölthető, néhány további licenceket és felhasználási jogokat is tartalmazhat. Néhány munkafolyamat esetén az LM Studio helyi szervermodust is kínál az egyszerű integrációhoz, de elsősorban egy könnyen használható asztali felületre lett tervezve kezdők számára. De mindezek ellenére, nézzük meg az Ollama és az LM Studio oldal mellett oldalra.

Figyelemre Méltó Megfigyelések: Ollama vs LM Studio

Mielőtt tovább mennénk, egy kritikus pontot meg kell említeni: az "Ollama és az LM Studio" kifejezés azt sugallhatja, hogy az egyik objektíven jobb a másiknál, de ez nem az egész történet, mivel másik célközönségnek lettek tervezve. Íme egy gyors Ollama és az LM Studio összehasonlítása.

| Funkció | Ollama | LM Studio |

| Könnyű használat | Kezdetben kevésbé barátságos, terminálissal kapcsolatos ismeretek szükségesek | Kezdőbarát, sok egérkattintás szükséges |

| Modell támogatása | Sok népszerű nyílt súlyú modell, gpt-oss, gemma 3, qwen 3 | Pontosan ugyanaz, mint az Ollama. gpt-oss, gemma3, qwen3 |

| testreszabás | Nagyon testreszabható, könnyen integrálható az API-n keresztül | Kevesebb szabadság, közös beállítások módosítása kapcsolók/csúszkák segítségével |

| Hardverkövetelmények | Ez függ; a nagyobb modellek lassabbak, ha nincs elegendő hardver | Ismét a modell mérete és a saját hardver függvénye |

| Adatvédelem | Alapértelmezés szerint kiváló adatvédelem/nincs szükség további külső API-ra | A csevegések helyileg maradnak; az alkalmazás továbbra is kapcsolódik a szerverekhez frissítésekért és modellkeresésért/letöltésért. |

| Offline használat | Teljesen támogatja az offline használatot a modellek letöltése után | Letöltés után kiváló offline használatra is |

| Elérhető platformok | Linux, Windows, macOS | Linux, Windows, macOS |

- Fejlett modellek hardveres fejfájása: Szinte mindenki nagyobb, képesebb modellt választana, ha lehetséges. Azonban a legtöbb laptopra telepítésük súlyos problémákat okozhat, mivel a nagyobb modellek több RAM- és VRAM-igénnyel rendelkeznek. Ez lassú válaszokat, korlátozott kontextushosszúságot vagy a modell be nem töltődését jelentheti.

- Akkumulátor problémák: A helyi LLMs futtatása nehéz terhelés alatt gyorsan meríthet az akkumátorod. Ez csökkent akkumátor-élettartamhoz vezethet, nem beszélve a hűtőventillátorok és a hűtőborda bosszantó zajaról.

Ollama vs LM Studio: Modellek letöltése

Az Ollama és az LM Studio közötti másik szempont a modellek letöltésének eltérő megközelítése. Az korábban említettem, az Ollama nem telepít helyi LLMst egy kattintással. Helyette saját terminálod és parancssorait kell használnod. A parancsok azonban egyszerűek és értelmezhetőek.

Íme egy gyors módja a modellek futtatásának az Ollama-en.

- Töltsd le a kedvenc modelledet az ollama pull gpt-oss beírásával vagy bármely más modelleddel (ne felejtsd el a taget, amit a könyvtárból választhatsz).

Például: ollama pull gpt-oss:20b - Ezt követően az ollama run gpt-oss parancs segítségével futtathatja az adott modellt

- További kódolási eszközöket is hozzáadhatsz. Például a Claudet hozzáadhatod az ollama launch claude paranccsal

Ha nem vagy otthon a terminálos parancsok világában, érdemes kipróbálnod az LM Studio-t. Nem kell semmit beírni a terminálon ahhoz, hogy működjön és modellek letöltésére kezdjen. Egyszerűen tallózz a beépített modellletöltőhöz, és keresd meg az LLMs-t kulcsszavak, például Llama vagy Gemma alapján.

Másik lehetőségként teljes Hugging Face URLs-t írhatod be a keresősávba.

Van lehetőség arra, hogy az discover lapot bárhonnan elérd az alábbi gombra történő megnyomással ⌘ + 2 Mac rendszeren, vagy Ctrl + 2 Windows / Linux rendszeren.

Ollama: Gyorsasági szempontból jobb

Néha a felhasználók és a vállalatok számára csak a sebesség számít. Kiderült, hogy ha az Ollama és az LM Studio sebességét hasonlítjuk össze, az Ollama gyorsabb, de ez még mindig függhet a különböző konfigurációktól és hardverbeállításoktól.

Egy Reddit-felhasználó esetében az r/ollama subredditben, az Ollama gyorsabban feldolgozta az eredményt, mint az LM Studio.

Ez nem alaptalan kijelentés, mivel a felhasználó mindkét Ollama-et és az LM Studio-t tesztelte úgy, hogy az qwen2.5:1.5b-t ötször futtatta és kiszámította az átlagos tokeneket másodpercenként.

Ollama vs LM Studio: Teljesítmény és hardverkövetelmények

A teljesítmény szempontjából az Ollama és az LM Studio összehasonlítása inkább a hardverről szól, mint a felhasználói felületről. A helyi LLMs-t első alkalommal használni egyáltalán nem ugyanaz, mint a felhőbeli LLMs-t, amelyre szokva vagyunk. Felemelő érzés, ha csak neked van egy LLM, amíg nem ütközel egy teljesítményi korlátba.

Tekintettel arra, hogy az RAM és a VRAM ára az elmúlt néhány évben az egekbe szaladt, nagyon nehéz felszerelni a gépedet ahhoz szükséges teljesítménnyel a nagyobb LLMs-ek futtatásához.

A népszerű modellek általában 24-64 GB RAM-ot fogyasztanak el

Igen, jól hallottad. A hardverkövetelmények nem arról szólnak, hogy ki nyer az Ollama és az LM Studio közötti versengésben. Ha zökkenőmentes élményt szeretnél nagyobb és közepes méretű modellek futtatásakor, lassulás vagy meghibásodás nélkül, legjobb esetben 24-64GB RAM-t kell telepítened. Azonban a legtöbb esetben még ez az RAM-mennyiség is irrelevánssá válik hosszabb kontextus és nehezebb terhelések esetén.

Futtathatod azonban a kisebb, gyakran kvantált modelleket 8-16GB RAM-en, de nem kapod meg ugyanazt a kényelmet vagy teljesítményt, mint a nagyobbakkal, nemhogy azt is említsük, hogy még így is lesznek minőségi és sebességi kompromisszumok. Sajnos az RAM nem az egyetlen probléma; más komponenseknek is robusztusnak kell lenniük.

Az erős GPU-k az idegesség megelőzésének alapköve

Bár a modellek futtathatók CPU-eken, a grafikus feldolgozó egységed még mindig kulcsszerepet játszik a modell engedélyezésében. Gyors GPU és megfelelő mennyiségű VRAM nélkül lassú token-by-token generációt, hosszú késleltetéseket a hosszabb válaszokhoz tapasztalsz, és minden gyorsan elviselhetetlenné válik.

Ne reménykedj túl nagyban, mert még az Mindenható sem RTX 5070Ti sem az RTX 5080 elegendő a komoly mély tanuláshoz. Ez azért van, mert egyes 60k+ kontextus beállításoknál az Ollama maga is körülbelül 23GB VRAM szükségességét említi, ami sokkal több, mint a tipikus 16GB VRAM, amelyet ezek a GPU-k biztosítanak.

Az ennél magasabb teljesítménytartomány felett történő Going is csillagászati áron drága. Ha az ár nem aggodalomra ad okot, még mindig vannak GPU beállítások amit figyelembe kell venni helyi LLMs futtatásakor.

Mostanra talán összezavarodtál, hogy hogyan állíts össze egy gépe elég erőset nagyobb helyi LLM modellek futtatásához. Ez a fordulópont sok ember számára, amikor más megoldást fontolgatnak.

Az egyik alternatív megközelítés, amelyet az rajongók szóba hoznak, a virtuális gépek használata erős, előzetesen telepített hardverrel. Egy VPS (virtuális magánszerver) használata például remek módja annak, hogy a home laptopod vagy más személyes hardvert egy privát szerverhez csatlakoztasd a saját választásod szerint, az összes előfeltétellel már beállítva.

Ha egy VPS használata jó megoldásnak tűnik számodra, komolyan ajánljuk az Cloudzy Ollama VPSa Cloudzy-ból, ahol tiszta shell környezetben dolgozhatsz. Az Ollama előre telepítve érkezik, így azonnal elkezdhetesz dolgozni helyi LLM-ekkel teljes privátszférával. Megfizethető árral rendelkezik 12 helyszínnel, 99,95%-os üzemidővel és 24/7 támogatással. Bőséges erőforrások állnak rendelkezésre, dedikált vCPU-kkal, DDR5 memóriával és NVMe tárolással akár 40 Gbps-es kapcsolaton keresztül.

Ollama vs LM Studio: Kinek melyik kell

Ahogy korábban említettem, mindkét platform erősen működőképes, és egyik sem előnyösebb, de itt jön a csavar. Mindegyik más típusú munkafolyamathoz illeszkedik, így attól függ, mire van szükséged.

Válassza az Ollama-t az automatizáláshoz és fejlesztéshez

Az Ollama-et akkor nem csupán azért használod, hogy csevegj egy modellel, hanem azért, hogy egy másik projekt komponenseként felhasználd. Az Ollama ideális:

- Fejlesztők chatbotok, copilotok és egyéb mély tanulást igénylő termékek fejlesztése

- Sok automatizálást igénylő munkafolyamatokra, például jelentésösszefoglaló szkriptek vagy időterv szerinti vázlatkészítés

- Csapatok amely konzisztens modellverziókat szeretne bármilyen környezetben

- Bármely felhasználó, aki API-first megközelítést keres, hogy más eszközök rendszeres alapon csatlakozhassanak a modellekhez

Végső soron, ha azt szeretnéd, hogy a modellek megbízhatóak legyenek az alkalmazásaidhoz, az Ollama a legjobb választás lehet.

LM Studio az egyszerűbb lehetőség a helyi LLMS-ek kezeléséhez

Ha helyi AI beállításokat szeretnél feltárni technikai zavar nélkül, az LM Studio határozottan a jobb lehetőség.

Általánosságban az LM Studio jobb:

- Kezdők akik terrorizálva vannak a terminál és a parancssorai által

- Írók, kreatívok vagy diákok akik egyszerű csevegőfelületre van szükségük, mint az AI asszisztens

- Az emberek, akik különböző lehetőségeket próbálnak ki, gyors összehasonlítást keresnek különféle modellek között a saját piaci rés megtalálásához

- Bárki, aki éppen hozzászokik a promptoláshoz és szeretné módosítani a beállításokat írás nélkül

Röviden, ha szeretnél letölteni és azonnal helyi LLMs-zel kezdeni, az LM Studio kielégíti az igényeidet.

Ollama vs LM Studio: Végső ajánlás

Ha félreteszed az Ollama és az LM Studio között folyó versengés körüli felhajtást, az igazán fontos a napi tapasztalatod, amely a munkafolyamatodon és hardverkorlátaidon alapul.

Az Ollama általánosságban:

- Rugalmas és fejlesztő-központú

Míg a LM Studio:

- Kezdőknek elérhető dedikált GUI-val

Mindkettőhöz erős, drága hardver szükséges a jó működéshez. Sokan nem engedhetik meg maguknak, hogy egy nagy LLM-t teljes egészében helyi gépen fusson. Ezért ha fejlett modelleket szeretnél futtatni anélkül, hogy megterhelned a hardvert, próbáld ki az Ollama-t egy dedikált GPU VPSLent pedig az alábbiakban találhatók gyakori kérdések az Ollama és az LM Studio összehasonlításáról