Jika Anda memutuskan H100 vs RTX 4090 untuk AI, perlu diingat bahwa sebagian besar "benchmark" tidak relevan sampai model dan cache Anda benar-benar muat di VRAM. RTX 4090 adalah titik ideal untuk pekerjaan single-GPU yang tetap berada di bawah 24 GB.

H100 adalah pilihan yang Anda butuhkan begitu model menjadi lebih besar, konkurensi meningkat, diperlukan isolasi multi-pengguna, atau Anda ingin menghabiskan lebih sedikit waktu untuk mengakali keterbatasan memori.

Saya akan menguraikannya berdasarkan beban kerja, menunjukkan jenis benchmark, lalu memberikan rencana pengujian cepat yang bisa Anda jalankan di stack Anda sendiri.

Jawaban Singkat: H100 vs RTX 4090 untuk Beban Kerja AI

H100 unggul untuk pelatihan model besar dan inferensi serius karena menawarkan kapasitas HBM yang besar, bandwidth memori sangat tinggi, NVLink, dan MIG untuk isolasi. RTX 4090 lebih cocok jika kamu butuh kecepatan per-GPU yang tinggi dengan harga lebih terjangkau, selama beban kerjamu muat dalam 24 GB tanpa harus terus-menerus berkompromi. Dari sisi spesifikasi dan fitur platform, pilihannya cukup jelas.

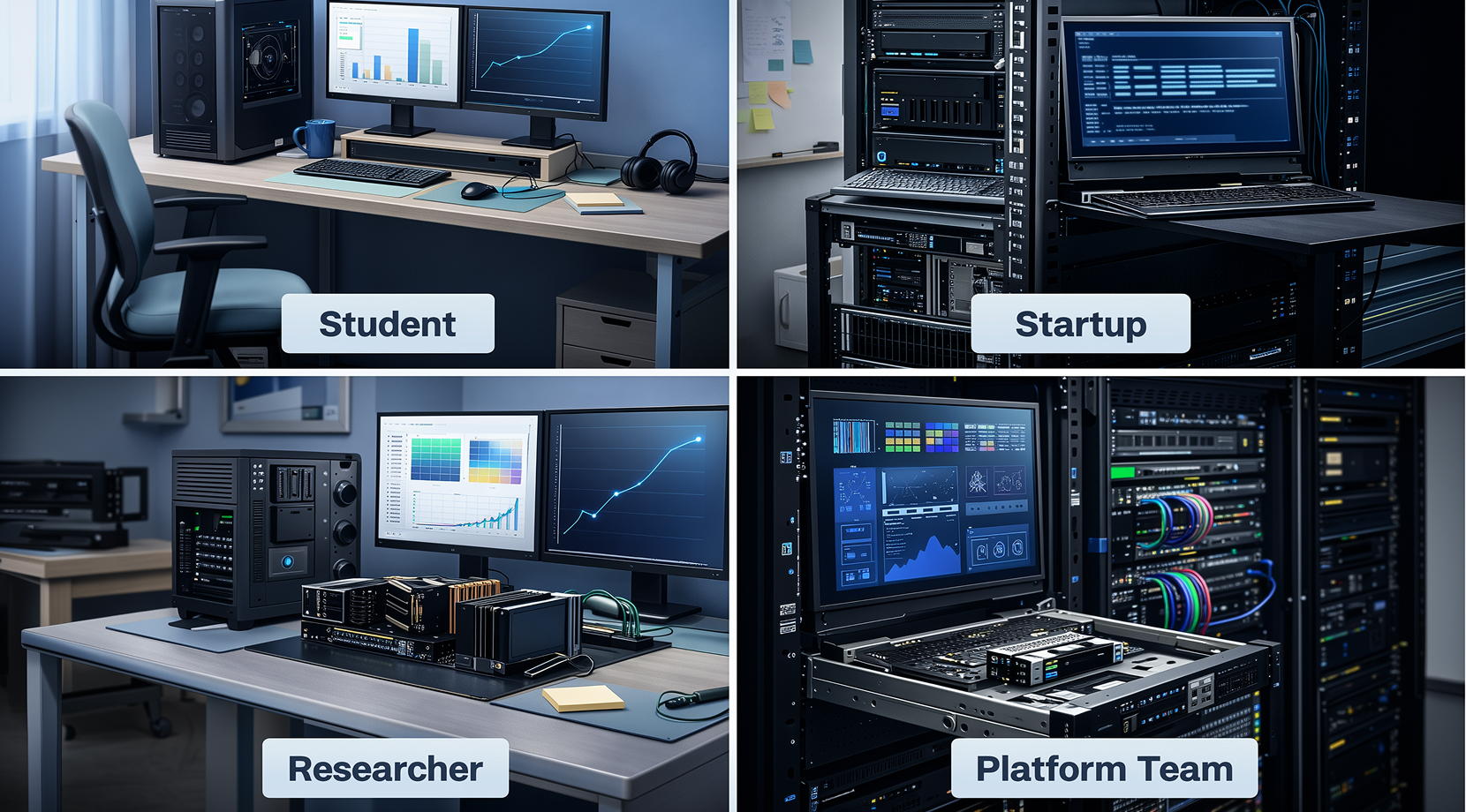

Berikut panduan cepat berdasarkan profil pengguna:

- Builder LLM Lokal (Developer Solo / Mahasiswa): RTX 4090 sampai VRAM menjadi hambatan.

- ML Engineer Startup (Merilis MVP): RTX 4090 untuk serving awal dan fine-tuning, H100 ketika kamu membutuhkan concurrency yang stabil atau model yang lebih besar.

- Peneliti Terapan (Banyak Eksperimen): H100 jika kamu sering menemui OOM, batas batch, atau konteks panjang.

- Tim Produksi / Platform (Serving Multi-Tenant): H100 untuk MIG slicing, headroom lebih besar, dan scaling yang lebih lancar.

Dengan kerangka itu, sisa artikel ini membahas batasan yang sering ditemui di dunia nyata, dan bagaimana angka-angka benchmark mencerminkannya.

Satu-satunya Pertanyaan Benchmark yang Perlu Dipertimbangkan: Apa yang Harus Muat di VRAM?

Sebagian besar diskusi tentang H100 vs RTX 4090 sebenarnya adalah perdebatan soal VRAM. Dalam pekerjaan LLM, VRAM dihabiskan oleh bobot, aktivasi selama pelatihan, status pengoptimal saat pelatihan, dan oleh cache KV saat inferensi. Yang terakhir itulah yang sering tidak diperhitungkan, karena ia bertambah seiring panjang konteks dan concurrency.

Tabel di bawah sengaja dibuat ringkas karena kesesuaian yang tepat bergantung pada framework, presisi, dan overhead.

Berikut gambaran "apakah muat tanpa masalah?":

| Beban kerja | Realita Tipikal Single-GPU pada RTX 4090 (24 GB) | Realita Tipikal Single-GPU pada H100 (80–94 GB) |

| Inferensi LLM 7B (FP16 / BF16) | Biasanya baik-baik saja | Ruang kepala yang nyaman |

| Inferensi LLM 13B | Sering mepet, tergantung konteks | Biasanya baik-baik saja |

| Inferensi kelas 70B | Butuh kuantisasi berat atau offload | Jauh lebih realistis |

| Inferensi SD/SDXL + batch kecil | Biasanya baik-baik saja | Lebih baik, dengan kapasitas batch yang lebih besar |

| Serving dengan konkurensi lebih tinggi | Tekanan KV cache terlihat lebih cepat | Lebih longgar, lebih stabil saat beban tinggi |

Jika ingin daftar pilihan GPU yang lebih luas (tidak hanya dua ini), rangkuman GPU Terbaik untuk Machine Learning di 2025 adalah tabel referensi praktis untuk VRAM dan bandwidth memori di berbagai GPU AI umum.

Setelah tahu workload Anda cocok, hal berikutnya yang menentukan seberapa "mulus" rasanya adalah bandwidth memori.

Bandwidth: Mengapa HBM Terasa Berbeda

Banyak diskusi performa AI yang terpaku pada puncak komputasi, padahal transformer sangat sensitif terhadap pergerakan memori. Keunggulan H100 adalah memadukan pool HBM besar dengan bandwidth memori yang sangat tinggi, ditambah bandwidth NVLink dan partisi MIG di sisi platform.

Ringkasan Spesifikasi

Spesifikasi tidak akan memilihkan GPU untuk Anda, tapi spesifikasi menjelaskan mengapa workload yang sama terasa ringan di satu kartu dan sempit di kartu lain. Gambaran ini menunjukkan faktor apa saja yang paling memengaruhi perilaku training, inferensi, dan serving LLM.

| Spesifikasi | H100 (SXM / NVL) | RTX 4090 |

| VRAM | 80 GB / 94 GB | 24 GB |

| Bandwidth Memori | 3,35–3,9 TB/s | GDDR6X (terbatas kapasitas pada 24 GB) |

| Interkoneksi | NVLink + PCIe Gen5 | PCIe (platform konsumer) |

| Multi-Instansi | Hingga 7 instans MIG | Tidak Tersedia |

Referensi spesifikasi: NVIDIA H100, NVIDIA RTX 4090.

Apa artinya dalam praktik:

- Jika ingin menaikkan ukuran batch atau panjang konteks, H100 cenderung tetap stabil lebih lama sebelum Anda terpaksa berkompromi.

- Jika Anda melayani banyak request sekaligus, H100 punya lebih banyak "ruang napas memori", sehingga tail latency tidak memburuk secepat itu.

- Jika pekerjaan Anda sebagian besar single-user, single-model, dengan konteks sederhana, 4090 sering terasa cepat dan memuaskan.

Bandwidth bukan pengganti benchmarking yang baik. Ia hanya menjelaskan mengapa dua GPU bisa tampak setara pada pengujian sempit, lalu menunjukkan perbedaan nyata di bawah beban sesungguhnya.

Benchmark H100 vs RTX 4090 yang Andal

Tidak semua benchmark setara, itulah mengapa "angka saya tidak cocok dengan angka Anda" sering terjadi. Untuk H100 vs RTX 4090, ada baiknya membagi benchmark ke dalam dua jalur:

- Jalur A (berbasis komunitas): llama.cpp-style tokens/sec tests and simple inference scripts.

- Jalur B (suite terstandarisasi): Hasil MLPerf Training dan MLPerf Inference yang berfokus pada aturan yang dapat diulang.

Snapshot Inferensi Gaya Llama.cpp

Ini adalah jenis pengujian yang orang lakukan di rumah, lalu diperdebatkan selama tiga hari. Berguna karena mencerminkan "toolchain nyata" yang banyak digunakan developer, tapi mudah disalahartikan jika kamu mengabaikan kesesuaian dan presisi.

Perbandingan publik gaya llama.cpp menunjukkan RTX 4090 tampil sangat baik pada model kecil dan proses kuantisasi, sementara model besar dengan presisi tinggi jauh melampaui batas VRAM.

Ini pola yang bisa kamu harapkan:

| Model | GPU | Hasil Umum |

| Kelas 7B | RTX 4090 | Tokens/sec tinggi, inferensi satu pengguna yang lancar |

| Kelas 13B | RTX 4090 | Masih baik, tapi konteks dan overhead mulai berpengaruh |

| kelas 70B | RTX 4090 | Tidak muat dengan bersih tanpa kuantisasi/offload agresif |

| kelas 70B | H100 | Jauh lebih realistis untuk tetap dimuat dan dijalankan secara stabil |

Inti dari tabel ini bukan soal "4090 buruk" atau "H100 ajaib." Intinya adalah batas VRAM menentukan seberapa banyak yang bisa kamu muat sekaligus, dan itu berdampak pada kecepatan, stabilitas, serta seberapa banyak konfigurasi tambahan yang harus kamu lakukan.

Kalau kamu terus-menerus memangkas panjang konteks hanya agar sistem tetap berjalan, di situlah perbandingan ini berhenti jadi sekadar teori.

Apa yang Ditambahkan MLPerf yang Tidak Ada di Benchmark Forum

MLPerf ada karena "skrip asal-asalan dan feeling" tidak cukup saat kamu membuat keputusan senilai ribuan dolar. MLCommons telah menambahkan workload gaya gen-AI terbaru seiring waktu, dan MLPerf dirancang agar hasil pengujian lebih mudah dibandingkan antar sistem.

Dari sisi pelatihan, laporan MLPerf Training v5.1 dari NVIDIA adalah contoh bagus bagaimana vendor melaporkan waktu pelatihan lengkap dengan detail lingkungan pengujian dan aturan benchmark yang mereka ikuti.

Kategori ini tidak memberi tahu bagaimana prompt pribadimu berperilaku, tapi ini adalah cara memverifikasi performa di tingkat sistem dan "bagaimana kelas hardware ini bekerja dalam kondisi terstandar."

Sekarang mari bicara soal hal yang paling memengaruhi keputusan pembelian, yaitu waktu dan biaya untuk menyelesaikan pekerjaan.

Biaya, Waktu, dan Biaya Kesempatan

Banyak H100 vs RTX 4090 keputusan sering dibingkai sebagai "harga beli vs harga sewa." Itu jarang menjadi kerangka yang tepat. Kerangka yang lebih baik adalah: berapa jam yang kamu butuhkan untuk menghasilkan model yang benar-benar bisa dipakai, dan berapa banyak waktu yang terbuang untuk mengatasi berbagai keterbatasan?

Tiga skenario umum menunjukkan trade-off ini dengan cukup jelas.

Fine-Tuning Mingguan pada Model Kecil hingga Menengah

Jika prosesmu tetap di bawah 24 GB tanpa kompromi terus-menerus, jalur 4090 terasa nyaman. Kamu bisa iterasi dengan cepat, tidak perlu menjadwalkan waktu cluster, dan setup-nya sederhana. Tapi jika setiap proses berubah menjadi "kurangi batch, potong konteks, coba lagi," H100 adalah pilihan yang jauh lebih masuk akal, meskipun biayanya lebih tinggi.

Melayani dengan Konkurensi Nyata

Konkurensi tinggi menekan KV cache dengan cepat. Di sinilah kapasitas ekstra dan kontrol platform H100 memberikan hasilnya, terutama jika kamu butuh latensi yang bisa diprediksi.

Jika kamu masih belum yakin apakah server GPU adalah pilihan yang tepat untuk deployment kamu, halaman GPU VPS vs CPU VPS kami adalah cara yang berguna untuk memetakan beban kerja ke jenis infrastruktur yang sesuai, sebelum kamu menghabiskan waktu mengoptimalkan hal yang salah.

Pekerjaan Training Besar dengan Tenggat Waktu

Begitu kamu mulai bekerja lebih dari satu orang dan satu mesin, hal-hal yang terasa membosankan justru yang paling penting untuk difokuskan: lingkungan yang stabil, lebih sedikit titik kegagalan, dan lebih sedikit waktu terbuang untuk urusan yang pada dasarnya hanya mengawasi sistem. Itulah yang H100 dirancang untuk tangani.

Jika kamu masih ragu setelah bagian ini, langkah selanjutnya bukan membaca lebih banyak. Melainkan melihat bagaimana stack kamu berperilaku dalam praktik, termasuk hambatan driver dan beban kerja multi-pengguna.

Software dan Operasional: Driver, Stabilitas, Multi-Pengguna, dan Dukungan

Inilah bagian yang paling sering dilewati grafik benchmark, padahal ini adalah bagian besar dari kehidupan sehari-hari.

RTX 4090 populer karena mudah diakses dan cepat untuk banyak alur kerja AI. Konsekuensinya adalah begitu kebutuhan kamu berkembang, kamu lebih mungkin menemui batasan seputar batas memori dan pola scaling yang memang tidak dirancang untuk lingkungan shared multi-tenant.

H100 dibangun untuk cluster. MIG adalah fitur penting bagi tim platform karena memungkinkan kamu membagi satu GPU menjadi irisan-irisan yang terisolasi, yang mengurangi masalah "noisy neighbor" dan membuat perencanaan kapasitas jauh lebih mudah. Spesifikasi resmi H100 dari NVIDIA mencantumkan hingga 7 instans MIG tergantung form factor.

Jika beban kerja kamu bersifat personal dan lokal, kamu bisa bertahan nyaman di sisi 4090 dalam waktu lama. Jika beban kerja kamu melibatkan banyak pengguna dan langsung menghadap pelanggan, H100 adalah pilihan yang lebih aman.

Jadi, secara keseluruhan, siapa sebaiknya memilih yang mana?

Mana yang Harus Kamu Pilih untuk Beban Kerjamu

Untuk H100 vs RTX 4090, pilihan yang tepat pada akhirnya adalah yang menghilangkan hambatan terbesarmu.

Builder LLM Lokal (Dev Solo / Mahasiswa)

Pilih RTX 4090 jika kamu kebanyakan bekerja di rentang 7B–13B, menjalankan inferensi terkuantisasi, bereksperimen dengan RAG, atau mengerjakan SDXL. Naik kelas saat kamu lebih banyak menghabiskan waktu mengatasi keterbatasan memori daripada membangun hal yang sebenarnya ingin kamu buat.

ML Engineer Startup (Merilis MVP)

Jika MVP kamu adalah satu model dengan traffic sedang dan muat dengan nyaman, 4090 adalah awal yang kuat. Jika kamu butuh latensi yang stabil saat lonjakan traffic, konkurensi lebih tinggi, atau beberapa beban kerja per host, H100 adalah jalur yang lebih tenang.

Peneliti Terapan (Banyak Eksperimen)

Jika kamu sering terpaksa berkompromi seperti memangkas batch size atau melakukan akrobat presisi, H100 memberimu eksperimen yang lebih bersih dan lebih sedikit percobaan yang gagal sia-sia.

Tim Produksi / Platform (Serving Multi-Tenant)

H100 adalah pilihan yang jelas, terutama karena MIG dan kapasitas ekstra yang lebih besar membuat perencanaan kapasitas lebih mudah dan pada dasarnya memperkecil dampak ketika ada lonjakan.

Jika kamu belum siap menggelontorkan uang untuk hardware, menyewa adalah langkah terbaik berikutnya.

Jalan Tengah yang Praktis: Sewa GPU Dulu, Lalu Putuskan

Cara paling pasti untuk menentukan pilihan H100 vs RTX 4090 adalah untuk menjalankan milik Anda model, milik Anda prompts, dan milik Anda panjang konteks pada kedua kelas hardware, lalu bandingkan tokens/sec dan tail latency di bawah beban.

Itulah alasan kami membangun Cloudzy GPU VPS, karena kamu bisa mendapatkan server GPU dalam waktu kurang dari satu menit, memasang stack-mu dengan akses root penuh, dan berhenti menebak berdasarkan benchmark orang lain.

Ini yang kamu dapatkan di paket GPU VPS kami:

- NVIDIA GPU Dedicated (termasuk opsi kelas RTX 4090 dan A100) agar hasilmu tidak bergeser akibat gangguan dari tetangga yang berisik.

- Jaringan hingga 40 Gbps di semua paket GPU, yang sangat penting untuk penarikan dataset, workflow multi-node, dan pemindahan artefak dengan cepat.

- Penyimpanan NVMe SSD, plus DDR5 RAM dan opsi CPU frekuensi tinggi di semua tier, agar komponen lain tidak memperlambat GPU.

- Perlindungan DDoS dan sebuah 99.95% waktu aktif, sehingga job yang berjalan lama tidak terganggu oleh noise jaringan yang tiba-tiba.

- Penagihan Per Jam (berguna untuk sprint benchmark singkat) dan sebuah Garansi uang kembali 14 hari untuk pengujian berisiko rendah.

Jalankan checklist benchmark yang sama di paket RTX 4090 terlebih dahulu, lalu ulangi di paket kelas A100 setelah kamu mulai mendorong konteks yang lebih panjang, konkurensi lebih tinggi, atau model yang lebih besar. Setelah itu, memilih antara H100 vs RTX 4090 biasanya menjadi jelas hanya dari log milikmu sendiri.

Checklist Benchmark: Jalankan Sendiri dalam 30 Menit

Jika ingin keputusan yang bisa kamu pertanggungjawabkan, ambil empat angka dari stack persis yang kamu rencanakan untuk di-deploy:

- Token/detik pada panjang konteks target kamu

- latensi p95 pada tingkat konkurensi yang diharapkan

- Ruang VRAM selama fase paling berat

- Biaya per run yang selesai dari awal hingga artefak

Smoke test minimal dengan vLLM terlihat seperti ini:

pip install vllm transformers accelerate

python -m vllm.entrypoints.api_server \

--model meta-llama/Llama-3-8B-Instruct \

--dtype float16 \

--max-model-len 8192Jika kamu ingin gambaran jelas tentang apa yang sebenarnya kamu sewa, artikel kami tentang Apa Itu GPU VPS? menjelaskan perbedaan antara akses GPU dedicated, berbagi vGPU, dan apa yang perlu dicek sebelum memilih paket.