Jika tujuan Anda membeli GPU baru adalah untuk menghindari error kehabisan memori, perdebatan 5070 Ti vs 5080 adalah argumen yang kurang tepat. Kedua kartu ini hadir dengan VRAM 16 GB, dan batas kapasitas itu muncul lebih cepat dari yang kebanyakan orang perkirakan saat mengerjakan deep learning.

5080 memang lebih cepat, tetapi jarang memberi Anda ruang untuk menjalankan model yang secara berarti lebih besar. Dalam praktiknya, Anda tetap harus memperkecil batch size, memotong panjang konteks, atau memindahkan beban ke RAM sistem hanya agar proses tetap berjalan.

Itulah mengapa artikel ini menyajikan perbandingan jujur dan realistis antara 5070 Ti vs 5080 untuk deep learning, lengkap dengan sejumlah pilihan yang lebih sesuai jika tujuan Anda adalah melatih, melakukan fine-tune, atau menjalankan model tanpa terus-menerus terkendala kapasitas VRAM.

Jika Anda hanya sempat membaca satu bagian, baca bagian spesifikasi dan bagian "kapasitas vs kecepatan". Keduanya yang paling menentukan agar Anda tidak salah beli.

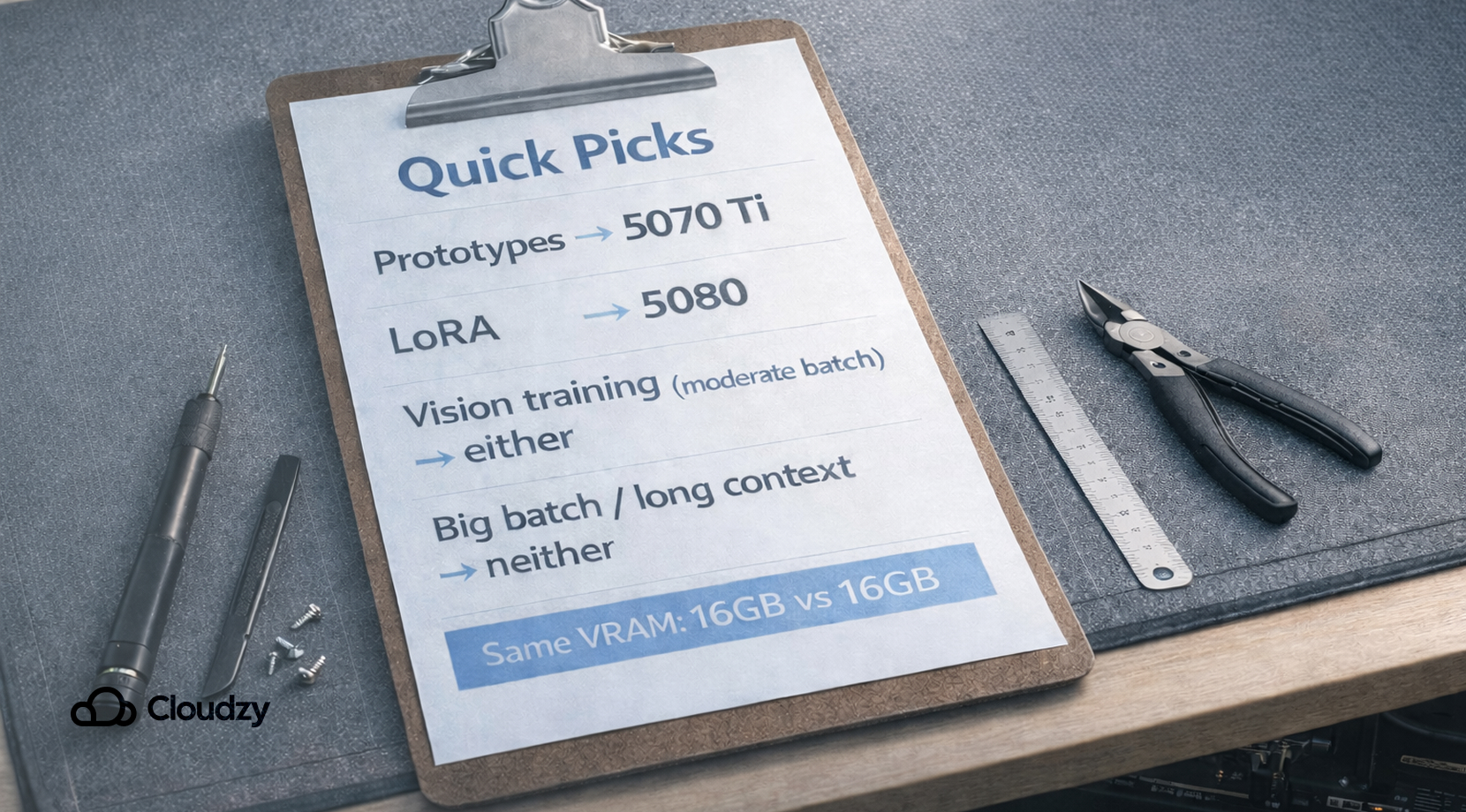

Pilihan Cepat Berdasarkan Kebutuhan Anda

Kebanyakan orang tidak membeli GPUs secara asal-asalan. Ada empat pola pikir pembeli yang kami lihat muncul berulang kali, dan perbandingan 5070 Ti vs 5080 memberikan jawaban yang berbeda untuk masing-masing.

Pengguna LLM Lokal yang Suka Bereksperimen

Kamu menjalankan notebook, mengganti pengaturan kuantisasi, dan lebih peduli pada "bisa jalan" daripada throughput sempurna. Untuk kamu, pilihan antara 5070 Ti vs 5080 biasanya ditentukan oleh anggaran, karena kedua kartu ini terasa cukup untuk model kecil dan inferensi terkuantisasi, lalu keduanya menabrak batas VRAM yang sama begitu kamu menambah panjang konteks atau ukuran batch.

Mahasiswa Pascasarjana yang Melatih Model Vision

Kamu ingin eksperimen yang bisa diulang dengan hasil konsisten, bukan percobaan yang tiada habisnya. Biaya tersembunyi bukan pada kartunya sendiri, melainkan waktu yang terbuang ketika proses gagal di epoch ke-3 karena dataloader, augmentasi, dan model semuanya berebut memori.

Engineer Startup yang Men-deploy Inferensi

Kamu peduli pada tail latency dan konkurensi. Demo untuk satu pengguna bisa terlihat lancar dengan 16 GB, tapi begitu traffic produksi masuk, tekanan KV cache menggerogoti VRAM seperti kebocoran lambat. Untuk serving, perdebatan 5070 Ti vs 5080 bisa jadi pengalih perhatian jika masalah sesungguhnya adalah kapasitas untuk batching dan prompt panjang.

Kreator yang Juga Mengerjakan ML

Kamu berpindah-pindah antara aplikasi kreatif dan perangkat ML, dan kamu tidak mau pusing dengan reboot, masalah driver, atau pesan "tutup Chrome dulu baru bisa training." Bagi kamu, memilih antara 5070 Ti vs 5080 hanya masuk akal jika GPU itu bagian dari alur kerja yang bersih, bukan workstation rapuh yang langsung bermasalah begitu kamu multitasking.

Dengan konteks tersebut, mari kita bicara konkret soal hardware dan mengapa faktor pembatasnya sama di titik-titik yang paling penting.

Spesifikasi Utama untuk Deep Learning

Cara tercepat memahami perbedaan 5070 Ti vs 5080 adalah dengan mengabaikan angka-angka marketing dan fokus pada kapasitas memori.

Jika kamu ingin melihat tabel spesifikasi lengkap, berikut tabel detail yang berfokus pada hal-hal yang paling memengaruhi perilaku training dan inferensi. (Kecepatan clock dan output display memang menarik perhatian, tapi bukan itu yang menentukan apakah proses kamu bisa berjalan.)

| Spesifikasi (Desktop) | RTX 5070 Ti | RTX 5080 | Mengapa Muncul di DL |

| VRAM | 16 GB | 16 GB | Kapasitas adalah batas keras untuk bobot, aktivasi, dan KV cache |

| Jenis Memori | GDDR7 | GDDR7 | Perilaku serupa, bandwidth membantu, tapi kapasitas yang menentukan "muat atau tidak" |

| Bus Memori | 256-bit | 256-bit | Membatasi bandwidth agregat; membantu throughput, bukan ukuran model |

| Inti CUDA | 8,960 | 10,752 | Compute lebih tinggi membantu token/detik, bukan "apakah bisa dimuat" |

| Daya Board Tipikal | 300 W | 360 W | Lebih banyak panas dan kebutuhan headroom PSU, tanpa tambahan VRAM |

Sumber resmi untuk spesifikasi: RTX 5080, Keluarga RTX 5070

Intinya, 5080 adalah kartu yang lebih cepat, 5070 Ti adalah yang lebih murah. Untuk deep learning, perbedaannya baru terasa setelah workload kamu sudah muat di memori.

Selanjutnya, kita akan melihat mengapa VRAM habis begitu cepat, bahkan pada setup yang terlihat ringan di atas kertas.

Mengapa VRAM Cepat Habis dalam Deep Learning

Orang yang terbiasa dengan gaming sering mengira VRAM seperti texture pool. Dalam deep learning, lebih tepat dibayangkan sebagai meja dapur yang sempit. Kamu tidak hanya butuh ruang untuk bahan-bahannya, kamu juga butuh ruang untuk memotong, memasak, dan menyajikan, semuanya sekaligus.

Berikut yang biasanya menempati VRAM selama proses berjalan:

- Bobot model: parameter model yang dimuat, kadang dalam format FP16/BF16, kadang dalam bentuk terkuantisasi.

- Aktivasi: tensor antara yang disimpan untuk backprop, biasanya pemakan memori terbesar saat pelatihan.

- Gradien dan status optimizer: overhead pelatihan yang bisa melipatgandakan kebutuhan memori.

- cache KV: overhead inferensi yang bertumbuh seiring panjang konteks dan konkurensi.

Inilah mengapa perdebatan 5070 Ti vs 5080 sering terasa seperti adu tenaga mesin saat kamu menarik trailer yang terlalu berat. Tenaga kuda boleh lebih besar, tapi kapasitas gandengan tetap jadi batasnya.

Cara cepat yang kami pakai saat pengujian adalah mencatat memori yang dialokasikan dan yang direservasi di PyTorch. Catatan CUDA memory PyTorch menjelaskan cara kerja caching allocator dan kenapa memori bisa tampak 'terpakai' di tools seperti nvidia-smi meski tensor sudah dibebaskan.

Inilah inti dari diskusi ini: sebagian besar kegagalan deep learning di 16 GB bukan karena lambat, melainkan karena OOM muncul di momen yang paling tidak diinginkan.

Workload Pertama yang Menguji Batas 5070 Ti vs 5080

Berikut pola-pola deep learning yang biasanya pertama kali mencapai batas memori pada 5070 Ti vs 5080.

LLM Serving dengan Prompt Panjang dan Konkurensi Nyata

Satu prompt di 2K token mungkin terlihat aman. Tambahkan konteks lebih panjang, batching, dan pengguna kedua, maka KV cache mulai naik. Di sinilah 5070 Ti vs 5080 berakhir pada hasil yang sama: kamu terpaksa membatasi max context atau mengecilkan batch size agar tidak crash.

Cara pengecekan sederhana:

- Jalankan server dengan max context dan batch yang sebenarnya kamu gunakan.

- Pantau VRAM dari waktu ke waktu, bukan hanya saat startup.

- Catat titik di mana latensi melonjak, lalu periksa penggunaan memori pada rentang waktu yang sama.

Jika kamu ingin setup monitoring yang andal tanpa harus menjadikannya proyek tersendiri, panduan kami tentang Perangkat lunak pemantauan GPU membahas pola pencatatan CLI praktis yang bekerja baik pada run nyata.

Fine-Tuning LoRA atau QLoRA

Banyak yang bilang 'LoRA bisa jalan di 16 GB,' dan itu benar. Jebaknya adalah menganggap sisa pipeline kamu tidak makan memori. Buffer tokenisasi, dataloader worker, mixed precision scaling, dan langkah validasi bisa menumpuk dengan cepat.

Dalam praktiknya, hambatan di sini bukan pada komputasi, melainkan pada margin. Kalau VRAM tidak punya ruang lebih, kamu akan menghabiskan waktu mengawasi run satu per satu.

Pelatihan Vision dengan Input Resolusi Tinggi

Model gambar punya mode kegagalan yang tidak kentara: kenaikan kecil pada resolusi atau tambahan satu augmentasi bisa langsung membuatmu dari stabil ke OOM. Pada 5070 Ti vs 5080, ini muncul sebagai batch size yang jatuh ke 1, lalu gradient accumulation mengubah pelatihanmu menjadi loop yang berjalan sangat lambat.

Multimodal Berjalan di Satu GPU

Text encoder + image encoder + fusion layers bisa berjalan lancar, tapi begitu kamu menaikkan sequence length atau menambahkan vision backbone yang lebih besar, penggunaan memori langsung meledak.

GPU saya baik-baik saja, desktop saya tidak

Yang ini paling sering dialami. Kamu mulai training, lalu browser, IDE, dan aplikasi lain yang berjalan rebutan VRAM, dan tiba-tiba konfigurasi yang tadinya "stabil" jadi berantakan. Orang-orang di forum mengeluh karena sudah menutup semua aplikasi, menonaktifkan overlay, tapi masih kena OOM pada model yang kemarin bisa jalan tanpa masalah.

Pola ini terus muncul dalam Diskusi 5070 Ti vs 5080, juga, karena kedua kartu ini memiliki batas kapasitas yang sama. Jika ini terdengar familiar, pertanyaan berikutnya adalah "apa yang harus kita lakukan dengan batas tersebut?"

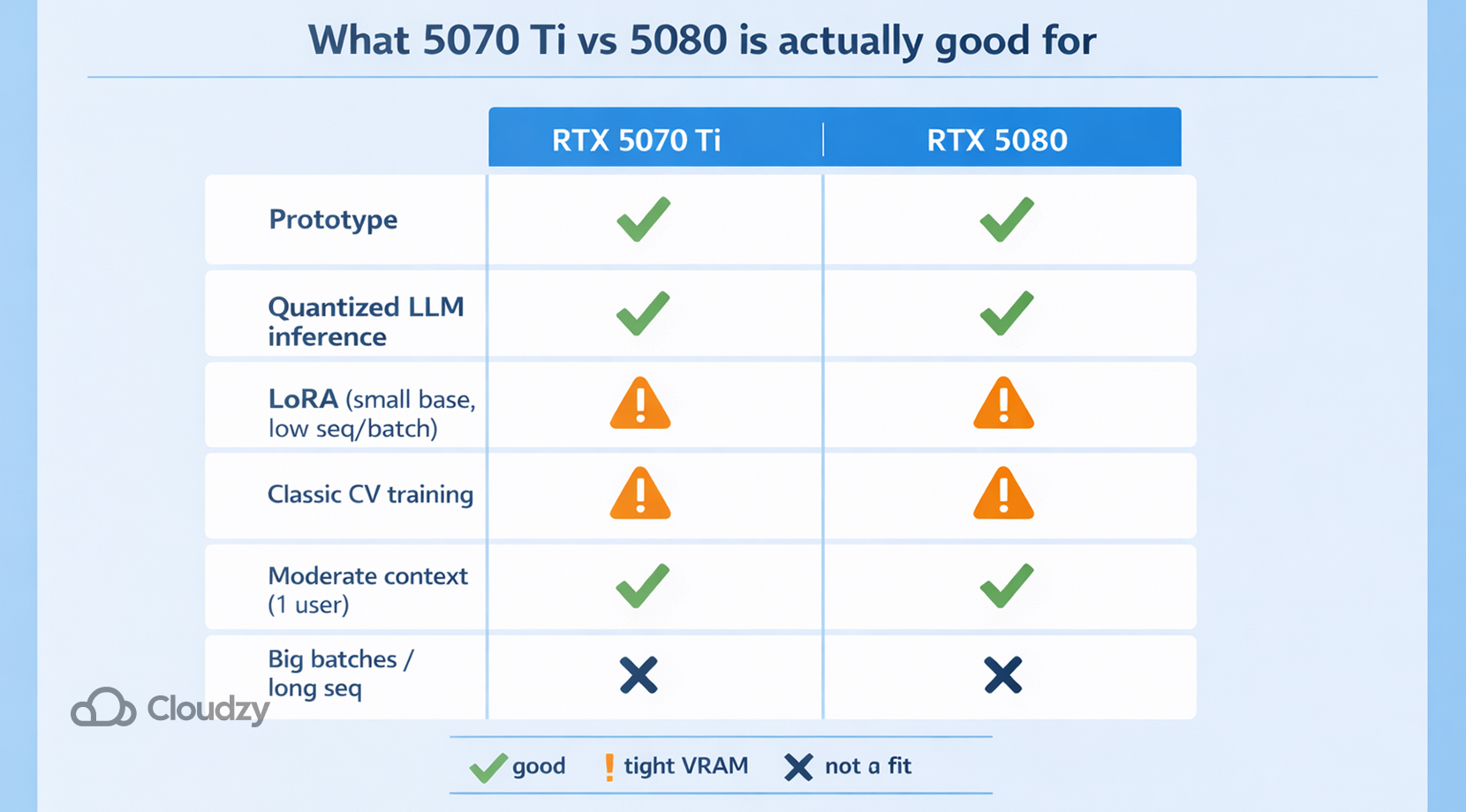

Untuk Apa Saja 5070 Ti vs 5080 Actually Good Cocok Digunakan

Mudah saja mengkritik 16 GB di kalangan ML, tapi bukan berarti tidak berguna. Hanya saja, ruang geraknya terbatas.

5070 Ti vs 5080 bisa jadi pilihan yang tepat untuk:

- Kerja Prototipe: eksperimen kecil, ablasi cepat, dan sanity check.

- Inferensi terkuantisasi LLM: model yang lebih kecil dengan konteks sedang, pengguna tunggal.

- LoRA pada model dasar yang lebih kecil: selama panjang urutan dan ukuran batch tetap terkendali.

- Pelatihan visi klasik: ukuran gambar sedang, backbone sedang, butuh lebih banyak kesabaran.

Intinya, selama pekerjaanmu tidak melebihi batas memori, 5080 biasanya terasa lebih responsif dibanding 5070 Ti, dan kamu akan merasakan manfaat dari compute yang lebih besar.

Tapi begitu kamu mencoba deep learning yang lebih serius, kamu akan langsung dihadapkan pada masalah keterbatasan memori. Jadi mari kita bahas taktik-taktik yang berlaku untuk kedua kartu ini.

Cara Kami Memaksimalkan VRAM yang Terbatas Tanpa Membuat Pelatihan Jadi Menyiksa

Semua trik ini bukan sihir. Ini hanyalah langkah-langkah yang membuat perbandingan 5070 Ti vs 5080 tetap relevan lebih lama.

Mulai dengan Pengukuran

Sebelum menyentuh hyperparameter, dapatkan angka VRAM puncak per langkah. Di PyTorch, max_memory_allocated() dan max_memory_reserved() adalah cara cepat untuk melihat apa yang sebenarnya terjadi dalam proses yang sedang berjalan.

Ini membantu Anda menjawab pertanyaan seperti:

- Apakah model itu sendiri yang menjadi biaya utama, atau aktivasi?

- Apakah VRAM melonjak saat validasi?

- Apakah fragmentasi terus meningkat seiring waktu?

Setelah Anda punya baseline, sisanya menjadi lebih mudah diprediksi.

Kurangi Penggunaan Memori Bila Memungkinkan

"Urutan langkah" sederhana yang kami gunakan:

- Turunkan batch size sampai muat.

- Tambahkan gradient accumulation untuk mendapatkan kembali effective batch Anda.

- Aktifkan mixed precision (BF16/FP16) jika stack Anda mendukungnya.

- Tambahkan gradient checkpointing jika aktivasi mendominasi.

- Baru setelah itu mulai bereksperimen dengan ukuran model.

Perlakukan Context Length Seperti Anggaran

Pada transformer, context length adalah faktor yang paling banyak menimbulkan masalah. Ini memengaruhi komputasi attention dan, untuk inferensi, ukuran KV cache. Pada 5070 Ti vs 5080, Anda akan merasakannya begitu melampaui beberapa ribu token: VRAM naik tajam, throughput turun, dan tiba-tiba Anda harus mengecilkan batch size hanya agar sistem tetap berjalan.

Pendekatan yang direkomendasikan:

- Tetapkan max context default yang masih memberi Anda ruang gerak.

- Buat profil kedua untuk "long context" dengan batch yang lebih kecil.

- Jangan campur keduanya saat Anda melakukan debug.

Jangan Kelirukan Cache PyTorch dengan Kebocoran Memori Asli

Banyak laporan "memory leak" sebenarnya adalah perilaku normal dari allocator. Dokumentasi PyTorch menyebutkan bahwa caching allocator bisa tetap mempertahankan memori meski tensor sudah dibebaskan, dan empty_cache() sebagian besar blok cache yang tidak terpakai dikembalikan ke aplikasi lain, bukan ke PyTorch itu sendiri.

Ini penting karena pengguna 5070 Ti vs 5080 sering terjebak mengejar phantom leak alih-alih sumber kebocoran yang sebenarnya, yaitu batch size, sequence length, dan activation memory.

Penyesuaian ini membuat batas memori yang ada lebih bisa dimanfaatkan, tetapi tidak mengubah kenyataan intinya. Jika proyek Anda membutuhkan model yang lebih besar, context yang lebih panjang, atau konkurensi yang lebih tinggi, Anda butuh lebih banyak VRAM.

Yang Saya Butuhkan: Kapasitas atau Kecepatan - 5070 Ti vs 5080

Satu cara untuk melihatnya: kecepatan adalah seberapa cepat Anda bisa melaju, sedangkan kapasitas adalah berapa banyak penumpang yang bisa Anda bawa. Deep learning membutuhkan keduanya, tetapi kapasitaslah yang menentukan apakah Anda bisa berangkat sama sekali.

5080 bisa menghasilkan throughput lebih tinggi dari 5070 Ti di banyak beban kerja. Tapi perbandingan 5070 Ti vs 5080 tidak mengubah pertanyaan "bisakah saya memuatnya dan menjalankannya" karena keduanya akan mencapai batasnya masing-masing.

Itulah mengapa orang sering kecewa setelah upgrade. Mereka merasakan peningkatan kecepatan di tes-tes kecil, lalu mencoba workload nyata mereka dan menabrak tembok yang sama. Temboknya hanya datang 30 detik lebih lambat.

Jadi kalau kamu sedang memilih dengan mempertimbangkan deep learning, ada baiknya menentukan kamu ada di kategori mana:

- Terbatas kecepatan: kamu sudah muat, kamu hanya ingin langkah yang lebih cepat.

- Terbatas kapasitas: kamu tidak muat dengan bersih, dan kamu menghabiskan waktu untuk memperkecil masalah.

Kebanyakan orang yang meneliti 5070 Ti vs 5080 untuk deep learning ada di kategori kedua, meski mereka belum menyadarinya.

Sekarang mari kita bahas opsi yang biasanya paling menghemat waktu: memindahkan 'pekerjaan berat' ke GPU yang lebih besar, tanpa harus membangun ulang seluruh setup lokal kamu.

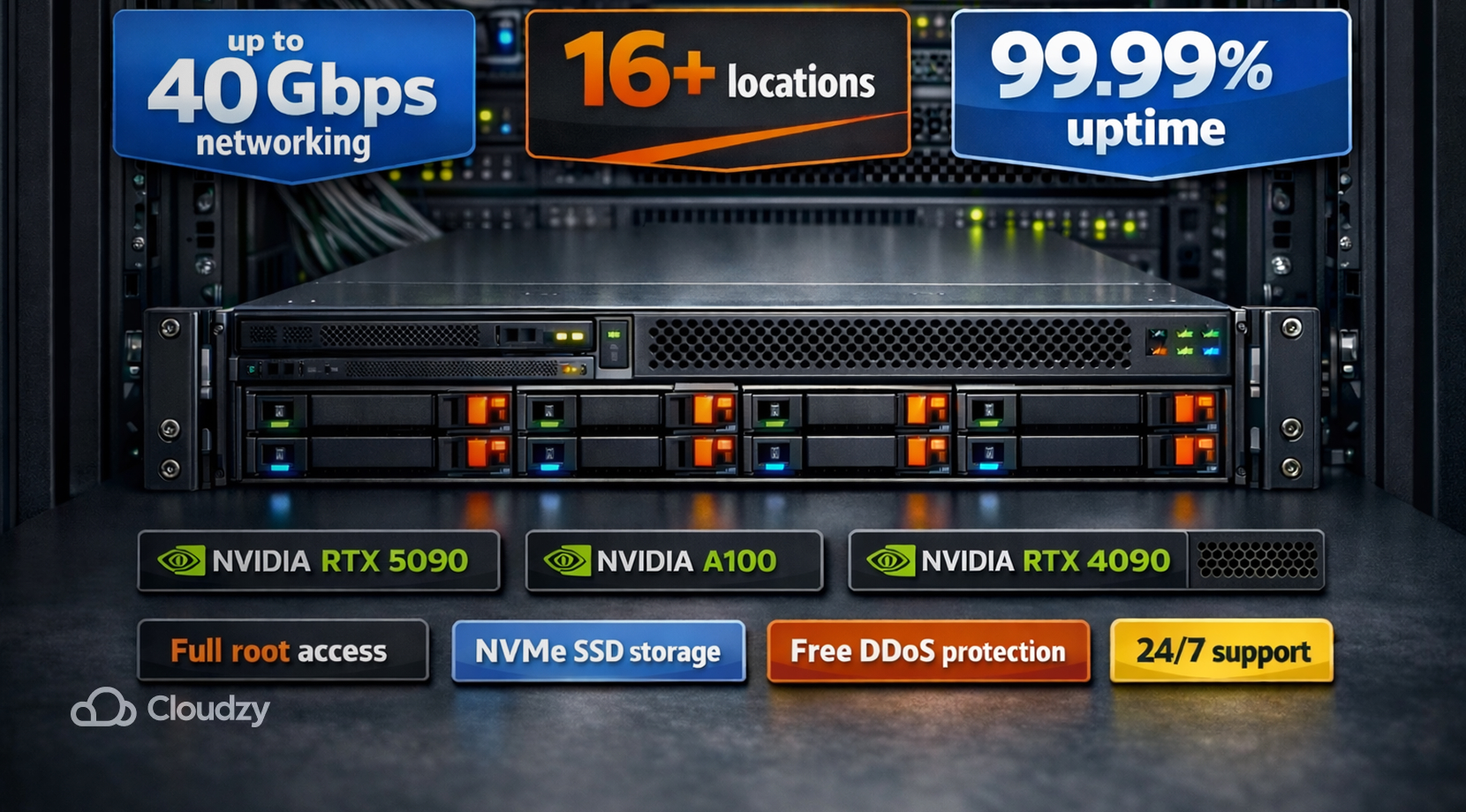

Solusi Terjangkau: Gunakan VPS GPU untuk Proses Berat

Di tim infrastruktur kami, pola yang paling sering kami lihat adalah orang-orang melakukan prototipe secara lokal, lalu mencapai titik di mana 5070 Ti vs 5080 tidak lagi relevan, karena workload-nya memang tidak muat.

Di sinilah kamu butuh akses ke pool VRAM yang lebih besar untuk training dan pengujian serving yang realistis. Dan memang itulah yang ditawarkan oleh Cloudzy GPU VPS cocok dengan sempurna.

Paket VPS GPU kami mencakup opsi NVIDIA seperti RTX 5090, A100, dan RTX 4090, ditambah akses root penuh, penyimpanan NVMe SSD, jaringan hingga 40 Gbps, 12 lokasi, perlindungan DDoS gratis, dukungan 24/7, dan target uptime 99,95%.

Tapi bagaimana ini membantumu, baik dalam memilih 5070 Ti vs 5080 maupun GPU lain di level yang sama? Begini:

- Kamu bisa menjalankan model dan profil prompt nyata kamu pada hardware dengan VRAM lebih besar, sehingga keputusannya menjadi jelas dari log kamu sendiri.

- Kamu bisa menyimpan GPU lokal untuk pengembangan dan tes cepat, lalu menyewa 'kartu besar' hanya untuk proses-proses berat.

Kalau kamu ingin kilas balik singkat tentang apa sebenarnya VPS GPU itu, dan apa perbedaan akses GPU dedicated vs shared, panduan pemula kami menjelaskannya dalam bahasa yang mudah dipahami.

Dan jika kamu masih belum yakin apakah kamu butuh GPU sama sekali untuk workload kamu, perbandingan VPS GPU vs CPU kami akan memberimu gambaran konkret tentang tugas nyata seperti training, inference, database, dan aplikasi web membutuhkan hardware yang mana.

Dengan infrastruktur yang sudah beres, langkah terakhir adalah memilih workflow yang tidak membuang waktumu.

Workflow Sederhana untuk Menentukan Apa yang Kamu Butuhkan

Banyak developer ML terjebak dalam pilihan palsu: beli kartu consumer yang lebih besar, atau menanggung konsekuensinya. Dalam praktiknya, 5070 Ti vs 5080 tetap bisa menjadi bagian dari workflow yang masuk akal jika kamu memperlakukannya sebagai alat dev lokal, bukan stack produksi penuh kamu.

Berikut workflow yang terbukti berjalan dengan baik:

- Gunakan 16 GB GPU Anda untuk coding, debugging, dan eksperimen kecil.

- Siapkan template environment "GPU besar" untuk menjalankan proses secara remote.

- Pindahkan training dan pengujian serving yang membutuhkan ruang lebih ke GPU VPS.

- Pantau proses yang berjalan dan simpan log agar hasilnya dapat direproduksi.

Jika Anda ingin panduan lebih mendalam tentang memilih kelas GPU yang tepat untuk pekerjaan ML secara umum, artikel kami tentang GPU terbaik untuk machine learning bisa menjadi referensi berikutnya.

Jadi, pada akhirnya, 5070 Ti vs 5080 adalah pilihan komputasi lokal, sedangkan skala deep learning adalah pilihan infrastruktur. Berbicara soal skala, jika Anda penasaran bagaimana kelas kartu yang lebih besar memengaruhi perilaku AI secara nyata, H100 vs RTX 4090 benchmark perbandingan tersebut berguna karena selalu kembali ke tema yang sama: kesesuaian VRAM lebih dulu, baru kecepatan.