Через постійно зростаючий попит на локальні LLM, багато користувачів у розгубленості при виборі найпридатнішого. Але користування ними не таке просте, як здається. Будучи помірно енергоспоживаючими, деякі більше за інші, багато хто краще їх обходить, не кажучи вже про те, скільки годин новачки можуть витратити на терміналі.

Проте є два видатні варіанти, які спрощують справу. Ollama та LM Studio — дві з найпоширеніших платформ з високою продуктивністю для запуску локальних LLM. Але вибір між ними може бути складним, оскільки кожна розроблена для різних робочих процесів. Отже, давайте розглянемо Ollama проти LM Studio.

Ollama як інструмент для досвідчених розробників

Якщо говорити про локальні LLM, Ollama — сильний варіант завдяки багатьом функціям. Він не тільки високо конфігурований, але й можна користуватися безплатно, оскільки це платформа з відкритим кодом, підтримуваний спільнотою.

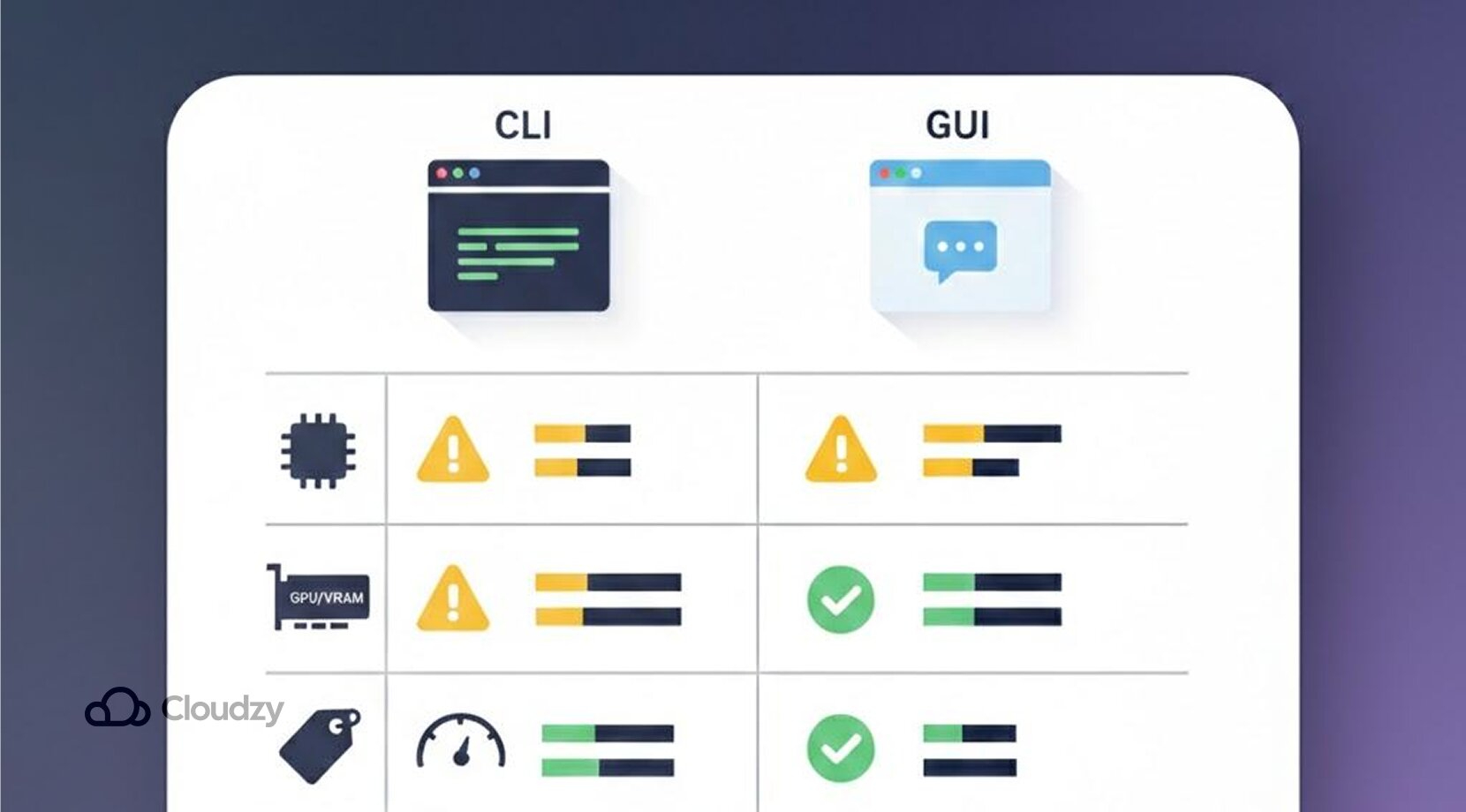

Хоча Ollama робить запуск локальних LLM простішим, він використовує CLI (командний рядок), тому потрібні базові знання терміналу. Орієнтація на CLI — величезна перевага для робочих процесів розробки завдяки простоті. Робота з CLI непроста, але дозволяє набагато швидше вникнути, ніж запускати локальні LLM самостійно.

Ollama перетворює ваш комп'ютер на локальний міні-сервер з HTTP API, даючи вашим додаткам і скриптам доступ до його множини моделей. Це означає, що він реагує на запити так само, як онлайн LLM, але без відправки ваших даних у хмару. До того ж, його API дозволяє користувачам інтегрувати Ollama та вставляти його на сайти й чатботи.

Оскільки Ollama працює через командний рядок, він досить легкий на вагу — менше навантажує ресурси й більше сконцентрований на продуктивності. Це не означає, що він запуститься на древньому комп'ютері, але все ж зберігає надію для тих, хто хоче вичавити з ресурсів максимум і спрямувати їх на саму модель LLM.

Можна заздалегідь здогадатися, що Ollama розроблений передусім для workflow розробників. І це правда. Завдяки простій інтеграції, локальній приватності й орієнтації на API, це очевидний вибір для тих, хто мислить розробником.

У дебатах Ollama проти LM Studio перевагу може мати Ollama з огляду на його розробку, орієнтовану на API. Якщо командний рядок для вас незвичний, почекайте на більш легкий варіант, розроблений з урахуванням зручності використання.

LM Studio: зручний вибір для користувачів

LM Studio різко контрастує з Ollama. Замість повнофункціонального інтерфейсу командного рядка він не потребує жодних команд терміналу для запуску. Оскільки він оснащений графічним інтерфейсом (GUI), він виглядає як звичайний настільний додаток. Для деяких початківців вибір між Ollama та LM Studio зводиться до простоти командного рядка або зручності графічного інтерфейсу.

Підхід LM Studio до усунення технічних бар'єрів дозволяє створити простий простір для будь-якого користувача. Замість того щоб додавати й запускати моделі через командний рядок, ви можете просто користуватися меню й писати в чат-подібне вікно. Здається, будь-хто може використовувати LM Studio для роботи з локальними LLM, оскільки це виглядає як ChatGPT.

Він навіть містить зручний вбудований браузер моделей, де користувачі можуть знайти й розгорнути будь-яку модель на свій смак — від легких моделей для повсякденних завдань до потужних для складніших. До того ж, браузер надає короткі описи доступних моделей, рекомендовані сценарії використання й дозволяє завантажити моделі одним клацанням.

Хоча більшість моделей можна завантажити безплатно, деякі можуть мати додаткові ліцензії й умови використання. Для деяких workflow LM Studio також пропонує режим локального сервера для простої інтеграції, але він розроблений передусім як простий настільний інтерфейс для початківців. Поклавши все це в калькулятор, порівняємо Ollama та LM Studio один проти одного.

Важливі спостереження: Ollama проти LM Studio

Перш ніж йти далі, варто розглянути одне критичне питання: фраза 'Ollama проти LM Studio' може наводити на думку, що один явно кращий за іншого, але це не вся історія. Вони розраховані на різних користувачів. Ось коротке порівняння Ollama та LM Studio.

| Функція | Ollama | LM Studio |

| Легкість використання | На початку не дуже зручний, потрібні знання командного рядка | Дружелюбний до новачків, потребує чимало клацань мишкою |

| Підтримка моделей | Багато популярних моделей відкритого вихідного коду, gpt-oss, gemma 3, qwen 3 | Ті самі моделі, що й Ollama. gpt-oss, gemma3, qwen3 |

| налаштування | Широкі можливості налаштування, легко інтегрується через API | Менше свободи, налаштування типових параметрів через перемикачі та повзунки |

| Вимоги до обладнання | Залежить від розміру моделі — більші моделі сповільнюються без достатнього обладнання | Знову ж таки, залежить від розміру моделі й вашого обладнання |

| Приватність | Відмінна приватність за замовчуванням, без додаткового зовнішнього API | Чати залишаються локальними, але додаток все ще звертається до серверів для оновлень та пошуку/завантаження моделей. |

| Використання в режимі офлайн | Повна підтримка автономної роботи після завантаження моделей | Також чудово працює в режимі офлайн після завантаження моделей |

| Доступні платформи | Linux, Windows, macOS | Linux, Windows, macOS |

- Апаратне забезпечення для розширених моделей — це головний біль: Розробники охоче використовують більші й потужніші моделі, коли це можливо. Проблема в тому, що на більшості ноутбуків це викликає серйозні проблеми: великі моделі жадають багато RAM та VRAM. Результат — повільні відповіді, обмежена довжина контексту або модель взагалі не завантажується.

- Проблеми з батареєю: Запуск LLMs локально швидко спустошує батарею під навантаженням. Це скорочує час роботи пристрою, не кажучи вже про подразливий шум від вентиляторів та радіаторів.

Ollama проти LM Studio: завантаження моделей

Ще один аспект порівняння Ollama та LM Studio — різні підходи до завантаження моделей. Як уже згадувалося, Ollama не встановлює локальні LLMs одним кліком. Замість цього потрібно використовувати вбудований термінал і командний рядок. Команди, однак, просто зрозуміти.

Ось простий спосіб запустити моделі на Ollama.

- Завантажте улюблену модель командою ollama pull gpt-oss або будь-яку іншу на ваш вибір (не забудьте додати тег з бібліотеки).

Приклад: ollama pull gpt-oss:20b - Потім ви можете запустити модель командою ollama run gpt-oss

- Можна додати й інші інструменти кодування. Наприклад, Claude можна додати командою ollama launch claude

Якщо термінали та команди — не ваше, спробуйте LM Studio. Вам не потрібно нічого вводити в термінал для початку роботи й завантаження моделей. Просто перейдіть до вбудованого завантажувача моделей і шукайте LLMs за ключовими словами: Llama або Gemma.

Як альтернатива, ви можете ввести повний Hugging Face URLs у рядок пошуку.

Є навіть опція доступу до вкладки discover звідусіль — просто натисніть ⌘ + 2 на Mac, або Ctrl + 2 на Windows / Linux.

Ollama: найшвидший у своєму класі

Для користувачів і компаній часто головне — це швидкість. Коли порівнювати Ollama та LM Studio саме за швидкістю, Ollama виграє, хоча результати можуть різнитися залежно від конфігурації й апаратури.

За словами одного користувача на r/ollama в Reddit, Ollama обробив дані швидше за LM Studio.

Це не голослівна заява — користувач тестував обидва інструменти, запустивши qwen2.5:1.5b п'ять разів і розрахувавши середню кількість токенів за секунду.

Ollama проти LM Studio: продуктивність і вимоги до апаратури

Продуктивність — це питання, де розбіжність між Ollama та LM Studio залежить насамперед від апаратури, а не від інтерфейсу. Перший досвід роботи з локальними LLMs — це зовсім інше порівняно з хмарними LLMs, до яких ми звикли. Спочатку здається захопливим мати LLM всього для себе, поки не впритул зіткнетесь з обмеженнями продуктивності.

З огляду на те, як ціни на RAM та VRAM зросли за останні роки, дуже складно оснастити свою машину достатньою потужністю для запуску великих LLMs.

Популярні моделі потребують 24-64 ГБ RAM

Саме так. Вибір апаратури — це не питання перемоги в дуелі Ollama проти LM Studio. Якщо ви хочете безперебійно працювати з популярними середніми та великими моделями без гальмування чи помилок, встановіть 24-64 ГБ RAM. Однак у більшості випадків навіть цього обсягу недостатньо при більшому контексті й інтенсивних навантаженнях.

Ви можете запускати менші, так звані квантовані моделі на 8-16 ГБ RAM, але ви не отримаєте той же комфорт і продуктивність, що й на більших. До того ж виникнуть компроміси в якості й швидкості. На жаль, RAM — це не єдиної проблем; інші компоненти також мають бути потужними.

Потужні GPUs — основа для того, щоб позбутися розчарування

Хоча моделі можуть працювати на CPUs, ваш графічний процесор все ще відіграє ключову роль у роботі моделі. Без швидкого GPU та достатньої кількості VRAM ви отримаєте повільне генерування токена за токеном, довгі затримки при довших відповідях, і все швидко стане неприйнятним.

Не піддавайтеся оптимізму, оскільки навіть всемогутні RTX 5070Ti і RTX 5080 недостатні для серйозного глибокого навчання. Причина в тому, що для деяких налаштувань з контекстом 60k+ сам Ollama згадує близько 23GB VRAM, що значно більше, ніж стандартні 16GB VRAM з цих GPUs.

Модернізація для будь-чого вище цього діапазону також коштує астрономічно. Якщо вартість вас не турбує, все ще варто розглянути кілька моментів Параметри GPU при запуску локальних LLMs.

До цього моменту ви могли вже заплутатися в тому, як зібрати машину, достатньо потужну для запуску більших локальних моделей LLM. Для багатьох це поворотна точка, коли вони розглядають альтернативне рішення.

Одна альтернатива, яку розглядають ентузіасти, — це використання віртуальних машин з потужним попередньо встановленим обладнанням. Використання VPS (виділеного приватного сервера), наприклад, — це чудовий спосіб підключити ваш домашній ноутбук або інше особисте обладнання до приватного сервера на вашу вибір, з усім необхідним уже налаштованим.

Якщо VPS звучить для вас як гарне рішення, ми серйозно рекомендуємо Ollama VPSвід Cloudzy, де ви можете працювати в чистій оболонці. Тут уже встановлений Ollama, тому ви можете одразу почати працювати з локальними LLMs з повною приватністю. Це доступно — 12 локацій, 99,95% безперервної роботи та цілодобова підтримка. Ресурси багаті: виділені VCPUs, DDR5 пам'яти та NVMe сховища через канал до 40 Gbps.

Ollama або LM Studio: кому що потрібне

Як було сказано раніше, обидві платформи дуже функціональні, і жодна не переважає іншу, але ось улов. Кожна підходить для різних типів робочих процесів, тому все залежить від ваших потреб.

Виберіть Ollama для автоматизації та розробки

Ваша мета при використанні Ollama — не просто спілкуватися з моделлю, а використовувати її як компонент у межах іншого проєкту. Ollama ідеальний для:

- Розробники створення продуктів, як чатботи, копілоти та інші продукти, що потребують глибокого навчання

- Робочих процесів, що потребують великої кількості автоматизації, як-от скрипти для реферування звітів або генерування чернеток за розкладом

- Команди які потребують узгодженої версії моделі в будь-якому середовищі

- Будь-якого користувача, що шукає підхід, орієнтований на API, щоб інші інструменти могли регулярно підключатися до моделей

Відповідно, якщо ви хочете, щоб моделі були надійні для ваших застосунків, Ollama може бути вашим найкращим вибором.

LM Studio — простіший варіант для роботи з локальними LLMs

Якщо ви хочете дослідити локальні AI-налаштування без технічних складнощів, LM Studio — це визначено кращий вибір.

Загалом LM Studio краще підходить для:

- Початківці тих, хто боїться терміналу та командного рядка

- Письменників, творців та студентів яким потрібен простий чат-бот з можливостями AI

- Люди, які тестують різні варіанти, прагнучи швидко порівняти різні моделі та знайти свою нішу

- Будь-хто, хто тільки звикає до промптування і хочет змінювати налаштування без набору команд

Коротко: якщо ви хочете завантажити й одразу почати працювати з локальними LLMs, LM Studio задовольнить ваші потреби.

Ollama та LM Studio: Підсумкова рекомендація

Якщо відійти від гайки навколо конкуренції між Ollama та LM Studio, то насправді важливий ваш щоденний досвід, який залежить від вашого робочого процесу та обмежень обладнання.

Ollama загалом:

- Гнучкий та орієнтований на розробників

Поки LM Studio це:

- Доступний для новачків із спеціалізованим інтерфейсом

Обидва потребують потужного дорогого обладнання для плавної роботи. Багато людей не мають можливості запускати велику локальну LLM самостійно. Тому якщо ви хочете запускати складні моделі без перевантаження обладнання, розгляньте використання Ollama на спеціалізованому GPU VPSНижче наведені поширені питання про Ollama та LM Studio.