Wenn Sie überlegen H100 vs RTX 4090 Beachte bei AI, dass die meisten "Benchmarks" erst zählen, wenn dein Modell und Cache tatsächlich in VRAM passen. RTX 4090 ist das Optimum für Single-GPU-Arbeit, die innerhalb von 24 GB bleibt.

H100 ist die richtige Wahl, wenn Sie größere Modelle, höhere Parallelität, Mehrbenutzerisolierung oder weniger Aufwand bei der Speicherverwaltung benötigen.

Ich gehe das nach Workload-Typen durch, zeige dir die wichtigsten Benchmark-Kategorien und gebe dir dann einen schnellen Testplan, den du direkt auf deinem eigenen Stack ausführen kannst.

Kurzantwort: H100 vs RTX 4090 für AI-Workloads

H100 überzeugt beim Training großer Modelle und im produktiven Einsatz: große HBM-Pools, sehr hohe Speicherbandbreite, NVLink und MIG zur Isolation sprechen für sich. RTX 4090 ist die bessere Wahl für alle, die hohe Single-GPU-Leistung zu einem günstigeren Preis suchen – solange die Arbeitslast in 24 GB passt, ohne ständige Kompromisse. Specs und Plattformfunktionen sprechen hier für sich.

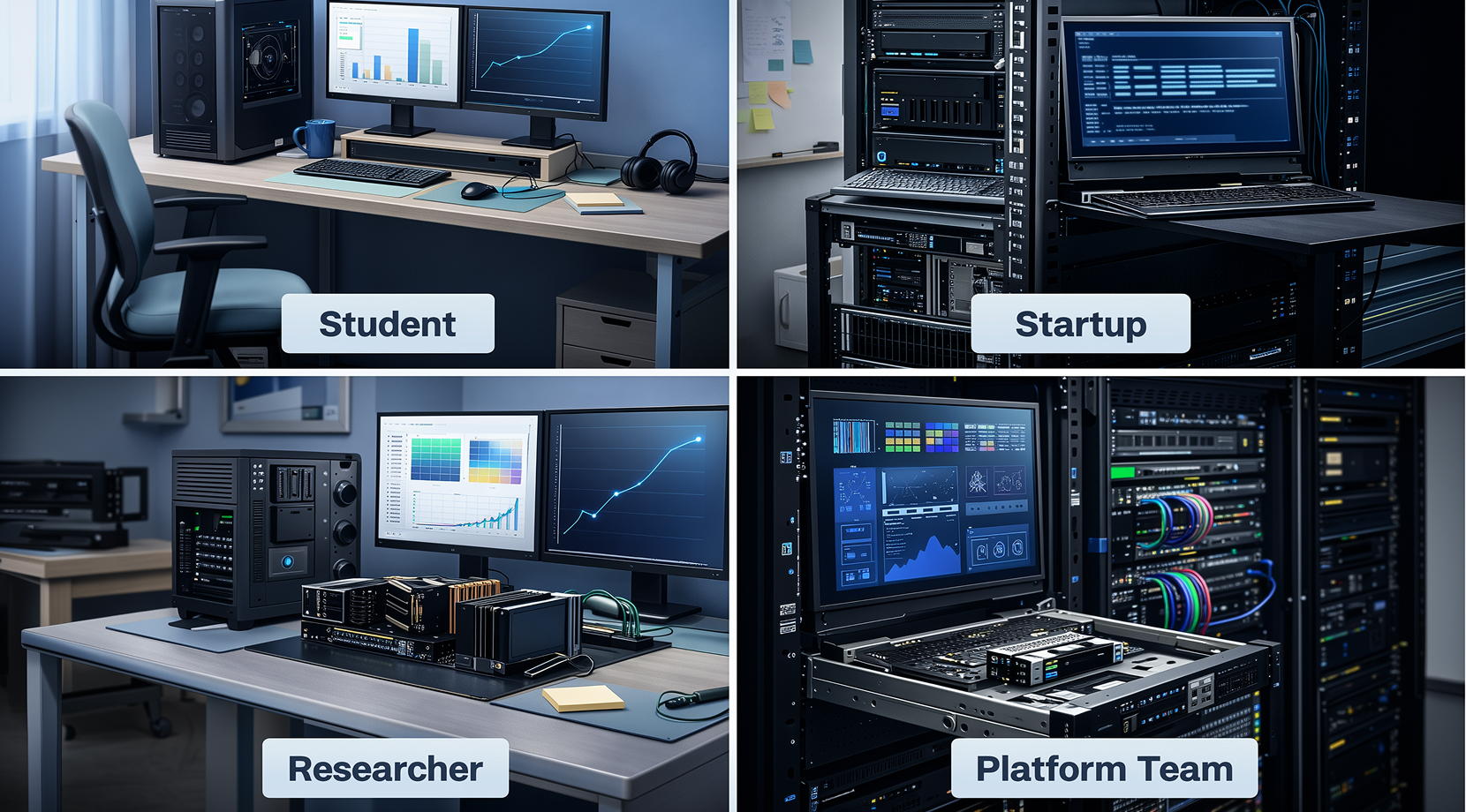

Hier eine schnelle Übersicht nach Anwendungsfall:

- Local LLM Builder (Solo-Entwickler / Student): RTX 4090 bis VRAM zum Flaschenhals wird.

- Startup-ML-Ingenieur (MVP-Launch): RTX 4090 für den Einstieg in Serving und Fine-Tuning, H100 sobald du stabile Parallelverarbeitung oder größere Modelle brauchst.

- Applied Researcher (Viele Experimente): H100 – wenn du immer wieder auf OOM-Fehler, Batch-Limits oder lange Kontextfenster stößt.

- Produktion / Plattform-Team (Multi-Tenant-Betrieb): H100 für MIG-Slicing, mehr Kapazitätspuffer und gleichmäßigeres Skalierungsverhalten.

Mit diesem Rahmen im Hinterkopf geht es im restlichen Artikel um die Grenzen, auf die man in der Praxis stößt, und darum, wie die Benchmark-Zahlen damit übereinstimmen.

Die einzige Benchmark-Frage, die zählt: Was muss in VRAM passen?

Die meisten Threads über H100 vs RTX 4090 sind technisch gesehen VRAM Argumente. In LLM Arbeit wird VRAM verarbeitet von Gewichte, Aktivierungen während des Trainings, Optimizer-Zustände im Training und der KV-Cache während der Inferenz. Letzterer ist der, den die meisten nicht auf dem Schirm haben – er wächst mit der Kontextlänge und der Anzahl gleichzeitiger Anfragen.

Die folgende Tabelle ist bewusst vereinfacht, da die tatsächliche Auslastung von Framework, Präzision und Overhead abhängt.

So sieht es aus, wenn man fragt: "Passt das problemlos?":

| Arbeitslast | Typische Einzelne-GPU-Realität auf RTX 4090 (24 GB) | Typische Einzelne-GPU-Realität auf H100 (80–94 GB) |

| 7B LLM Inferenz (FP16 / BF16) | Meist gut | Ausreichend Puffer |

| 13B LLM Inferenz | Oft knapp, abhängig vom Kontext | Meist gut |

| 70B-Klasse Inferenz | Erfordert starke Quantisierung/Offloading | Deutlich realistischer |

| SD/SDXL Inferenz + kleiner Batch | Meist gut | Problemlos, plus mehr Spielraum beim Batch |

| Serving mit höherer Parallelität | KV-Cache-Druck macht sich schnell bemerkbar | Mehr Kapazität, stabilere Last |

Wenn Sie eine umfassendere GPU-Auswahlliste möchten (nicht nur diese zwei), bietet unsere Übersicht der Die besten GPUs für Machine Learning 2025 eine praktische Referenztabelle für VRAM und Speicherbandbreite bei gängigen AI GPUs.

Wenn du weißt, dass dein Workload passt, entscheidet als nächstes die Speicherbandbreite darüber, wie flüssig sich alles anfühlt.

Bandbreite: Warum HBM sich anders anfühlt

In vielen Diskussionen über KI-Leistung dreht sich alles um Rechenspitzen, aber Transformer reagieren extrem empfindlich auf Speicherzugriffe. Der Vorteil der H100 liegt darin, dass sie große HBM-Pools mit sehr hoher Speicherbandbreite kombiniert, ergänzt durch NVLink-Bandbreite und MIG-Partitionierung auf der Plattformseite.

Technische Daten auf einen Blick

Die technischen Daten wählen die GPU nicht für dich aus, aber sie erklären, warum sich derselbe Workload auf einer Karte leicht und auf der anderen beengt anfühlt. Diese Übersicht zeigt, was das Training, die Inferenz und das Serving-Verhalten der LLM am stärksten beeinflusst.

| Spezifikation | H100 (SXM / NVL) | RTX 4090 |

| VRAM | 80 GB / 94 GB | 24 GB |

| Speicherbandbreite | 3,35–3,9 TB/s | GDDR6X (kapazitätsbegrenzt bei 24 GB) |

| Verbindung | NVLink + PCIe Gen5 | PCIe (Consumer-Plattform) |

| Multi-Instanz | Bis zu 7 MIG-Instanzen | Nicht verfügbar |

Spezifikationsquellen: NVIDIA H100, NVIDIA RTX 4090.

Was das in der Praxis bedeutet:

- Wenn du die Batch-Größe oder die Kontextlänge erhöhen möchtest, bleibt die H100 länger stabil, bevor du Kompromisse eingehen musst.

- Wenn du viele Anfragen gleichzeitig bedienst, hat die H100 mehr Speicherpuffer, sodass du nicht so schnell in problematische Tail-Latency gerätst.

- Wenn dein Einsatz hauptsächlich aus einzelnen Nutzern, einem einzelnen Modell und überschaubarem Kontext besteht, fühlt sich die 4090 oft schnell und zufriedenstellend an.

Bandbreite ersetzt kein sorgfältiges Benchmarking. Sie erklärt nur, warum zwei GPUs bei einem engen Test ähnlich abschneiden können, unter echter Last aber auseinanderdriften.

Verlässliche H100 vs. RTX 4090 Benchmarks

Nicht alle Benchmarks sind gleich, weshalb "meine Zahlen stimmen nicht mit deinen überein" so häufig vorkommt. Für H100 vs RTX 4090hilft es, Benchmarks in zwei Kategorien aufzuteilen:

- Lane A (Community-Gefühl): llama.cpp-style tokens/sec tests and simple inference scripts.

- Lane B (standardisierte Suites): MLPerf Training- und MLPerf Inference-Ergebnisse nach klar definierten, reproduzierbaren Regeln.

Llama.cpp-Inferenz-Snapshot

Das ist der Test, den Leute zu Hause durchführen und dann drei Tage lang diskutieren. Er ist nützlich, weil er eine typische Entwicklungsumgebung abbildet – aber leicht falsch zu interpretieren, wenn man Anwendungsfall und Messgenauigkeit außer Acht lässt.

Öffentliche Vergleiche im llama.cpp-Stil zeigen, dass RTX 4090 bei kleineren Modellen und quantisierten Durchläufen sehr gut abschneidet, während große Modelle mit höherer Präzision die Kapazitätsgrenze der RAM deutlich überschreiten.

So läuft es ab:

| Modell | GPU | Typisches Ergebnis |

| 7B-Klasse | RTX 4090 | Hohe Tokens/Sek., flüssige Inferenz für einzelne Nutzer |

| 13B-Klasse | RTX 4090 | Noch in Ordnung, aber Kontext und Overhead beginnen eine Rolle zu spielen |

| 70B-Klasse | RTX 4090 | Passt ohne aggressives Quant/Offloading nicht sauber |

| 70B-Klasse | H100 | Deutlich realistischer, dauerhaft bereitzustellen und zuverlässig zu betreiben |

Dieser Vergleich sagt nicht, dass die 4090 schlecht ist oder die H100 magisch. Er zeigt: Der VRAM bestimmt, wie viel du resident halten kannst – und das beeinflusst Geschwindigkeit, Stabilität und wie viel du optimieren musst.

Wenn du ständig den Kontextfenster kürzst, nur um überhaupt noch arbeiten zu können, ist der Vergleich kein theoretisches Problem mehr.

Was MLPerf leistet, was Forum-Benchmarks nicht können

MLPerf existiert, weil "irgendwelche Skripte und Bauchgefühl" nicht funktionieren, wenn es um Entscheidungen im fünfstelligen Bereich geht. MLCommons hat moderne Gen-AI-Workloads im Laufe der Zeit, und MLPerf ist darauf ausgelegt, Ergebnisse systemübergreifend besser vergleichbar zu machen.

Auf der Trainingsseite, NVIDIAs MLPerf Training v5.1 Bericht ist ein gutes Beispiel dafür, wie Anbieter Trainingszeiten transparent dokumentieren – inklusive Angaben zur Testumgebung und den verwendeten Benchmark-Regeln.

Dieser Test zeigt nicht, wie sich deine privaten Prompts verhalten, aber er ist ein solider Grundlagentest dafür, wie gut das System skaliert und wie diese Hardware-Klasse unter definierten Bedingungen abschneidet.

Kommen wir jetzt zum Teil, der Kaufentscheidungen am stärksten beeinflusst: Zeit und Geld, die du investierst, bis die Arbeit erledigt ist.

Kosten, Zeit und Opportunitätskosten

Viele H100 vs RTX 4090 Entscheidungen werden oft als "Kaufpreis vs. Mietpreis" gerahmt. Das ist selten der richtige Blickwinkel. Besser gefragt: Wie viele Stunden brauchst du, um ein Modell zu produzieren, das du wirklich nutzen kannst, und wie viel Zeit verlierst du im Kampf gegen Einschränkungen?

Drei typische Szenarien machen die jeweiligen Kompromisse gut sichtbar.

Wöchentliches Fine-Tuning bei kleinen bis mittelgroßen Modellen

Wenn deine Runs ohne ständige Kompromisse in 24 GB passen, macht der 4090-Pfad vieles richtig. Du iterierst schnell, musst keine Cluster-Zeit einplanen, und das Setup bleibt überschaubar. Wenn jeder Run in "Batch verkleinern, Kontext kürzen, nochmal versuchen" endet, ist H100 trotz der höheren Kosten die deutlich sinnvollere Wahl.

Serving mit echter Nebenläufigkeit

Nebenläufigkeit erhöht den KV-Cache-Druck schnell. Hier zahlen sich die größeren Reserven und die Plattformsteuerung von H100 aus, besonders wenn vorhersehbare Latenz wichtig ist.

Wenn du noch überlegst, ob ein GPU-Server überhaupt die richtige Grundlage für dein Deployment ist, hilft dir unsere GPU VPS vs. CPU VPS Aufschlüsselung dabei, den Workload dem richtigen Infrastrukturtyp zuzuordnen, bevor du Zeit damit verbringst, die falsche Stelle zu optimieren.

Größere Trainingsjobs mit Deadlines

Sobald du über eine Person und eine Maschine hinauswächst, zählen die unspektakulären Dinge: stabile Umgebungen, weniger Fehlerpunkte, weniger Zeit, die du im Grunde mit Babysitting verbringst. Genau dafür ist H100 ausgelegt.

Wenn du nach diesem Abschnitt noch unentschlossen bist, hilft dir weiteres Lesen wenig. Der nächste Schritt ist, dein Stack in der Praxis zu beobachten, also wie er sich bei Treiberproblemen und Mehrbenutzerlast verhält.

Software und Betrieb: Treiber, Stabilität, Mehrbenutzerbetrieb und Support

Das ist der Teil, den die meisten Benchmark-Charts überspringen, aber er macht einen großen Teil des Arbeitsalltags aus.

RTX 4090 ist beliebt, weil es zugänglich ist und für viele KI-Workflows schnell genug ist. Der Haken: Wenn dein Anwendungsfall wächst, stößt du häufiger an Grenzen bei der Speicherkapazität und bei Skalierungsmustern, die für gemeinsam genutzte, mandantenfähige Umgebungen nicht ausgelegt sind.

H100 ist für Cluster gebaut. MIG ist für Plattform-Teams ein wesentliches Feature, weil es erlaubt, eine GPU in isolierte Segmente aufzuteilen. Das reduziert "Noisy Neighbor"-Probleme und erleichtert die Kapazitätsplanung erheblich. NVIDIAs offizielle H100-Spezifikationen listen je nach Formfaktor bis zu 7 MIG-Instanzen.

Wenn dein Workload privat und lokal ist, kannst du lange gut mit der 4090-Seite leben. Wenn dein Workload mehrere Nutzer hat und nach außen gerichtet ist, ist H100 die sicherere Wahl.

Also: Wer sollte was kaufen?

Welche Option passt zu deinem Workload

Bei der H100 vs RTX 4090, die richtige Wahl ist letztlich die, die deine größten Hindernisse aus dem Weg räumt.

Lokaler LLM-Entwickler (Solo-Dev / Student)

Wähle RTX 4090, wenn du hauptsächlich im 7B–13B-Bereich arbeitest, quantisierte Inferenz ausführst, mit RAG experimentierst oder an SDXL arbeitest. Steig um, sobald du mehr Zeit damit verbringst, Speicherlimits zu umgehen, als dein eigentliches Projekt voranzutreiben.

ML-Engineer im Startup (MVP in der Entwicklung)

Wenn dein MVP ein einzelnes Modell mit moderatem Traffic ist und gut in den Speicher passt, ist die 4090 ein solider Einstieg. Brauchst du stabile Latenz unter Last, höhere Parallelität oder mehrere Workloads auf einem Host, ist H100 die zuverlässigere Wahl.

Angewandter Forscher (viele Experimente)

Wenn du regelmäßig Kompromisse eingehen musst, wie Batch-Größen reduzieren oder mit Precision-Einstellungen jonglieren, ermöglicht dir H100 sauberere Experimente und weniger fehlgeschlagene Durchläufe.

Produktions- / Plattform-Team (Multi-Tenant-Serving)

H100 ist die naheliegende Wahl, vor allem weil MIG und der größere Spielraum die Kapazitätsplanung vereinfachen und den Schaden bei Lastspitzen begrenzen.

Wenn du dich noch nicht auf Hardware-Ausgaben festlegen willst, ist Mieten der sinnvollste nächste Schritt.

Der pragmatische Mittelweg: Zuerst GPUs mieten, dann entscheiden

Die sicherste Methode zur Entscheidung H100 vs RTX 4090 ist, dein dein Modell, dein Prompts und dein die Context-Länge auf beiden Hardware-Klassen zu testen und dann Tokens/Sek. sowie Tail-Latenz unter Last zu vergleichen.

Genau dafür haben wir Cloudzy GPU VPSgebaut: Du kannst eine GPU-Instanz in unter einer Minute starten, deinen Stack mit vollem Root-Zugriff installieren und aufhören, dich auf fremde Benchmarks zu verlassen.

Das bekommst du in unseren GPU VPS-Tarifen:

- Dedizierte NVIDIA GPUs (einschließlich RTX 4090- und A100-Optionen), damit deine Ergebnisse nicht durch laute Nachbar-Instanzen verfälscht werden.

- Bis zu 40 Gbps Netzwerkanbindung in allen GPU-Tarifen enthalten, was beim Laden von Datensätzen, Multi-Node-Workflows und dem schnellen Verschieben von Artefakten einen echten Unterschied macht.

- NVMe SSD Speicher, plus DDR5 RAM und hochfrequente CPU-Optionen in allen Tarifen, damit der Rest der Instanz die GPU nicht ausbremst.

- DDoS-Schutz und ein 99,95 % Verfügbarkeit, damit lang laufende Jobs nicht durch zufällige Netzwerkprobleme unterbrochen werden.

- Stundenbasierte Abrechnung (praktisch für kurze Benchmark-Tests) und ein 14-tägige Geld-zurück-Garantie für risikoarmes Testen.

Führe denselben Benchmark-Katalog zuerst auf einem RTX 4090-Plan durch und wiederhole ihn auf einem A100-Plan, sobald du mit größeren Kontexten, höherer Parallelität oder größeren Modellen arbeitest. Danach wird die Entscheidung zwischen H100 vs RTX 4090 anhand deiner eigenen Logs meistens offensichtlich.

Benchmark-Katalog: In 30 Minuten selbst testen

Wenn du eine fundierte Entscheidung treffen willst, hole dir vier Kennzahlen aus dem genauen Stack, den du deployen möchtest:

- Tokens/Sek. bei deiner Zielkontextlänge

- p95-Latenz bei der erwarteten Parallelität

- VRAM-Reserve während der rechenintensivsten Phase

- Kosten pro abgeschlossenem Durchlauf von Start bis Artefakt

Ein einfacher Smoke-Test mit vLLM sieht so aus:

pip install vllm transformers accelerate

python -m vllm.entrypoints.api_server \

--model meta-llama/Llama-3-8B-Instruct \

--dtype float16 \

--max-model-len 8192Wenn du genau verstehen willst, was du tatsächlich mietest, erklärt unser Beitrag zu Was ist eine GPU VPS? den Unterschied zwischen dediziertem GPU-Zugriff, vGPU-Sharing und worauf du vor der Planwahl achten solltest.