Wenn Sie eine neue GPU kaufen wollen, um Out-of-Memory-Fehler zu vermeiden, ist der Vergleich 5070 Ti vs. 5080 der falsche Ansatz. Beide Karten haben 16 GB VRAM, und diese Kapazitätsgrenze macht sich im Deep Learning früher bemerkbar, als die meisten erwarten.

Die 5080 ist schneller, ermöglicht aber selten den Betrieb eines nennenswert größeren Modells. In der Praxis müssen Sie trotzdem die Batch-Größe reduzieren, die Kontextlänge kürzen oder auf System-RAM ausweichen, nur um Trainingsläufe am Laufen zu halten.

Genau deshalb wirft dieser Artikel einen ehrlichen, realistischen Blick auf 5070 Ti vs. 5080 für Deep Learning - ergänzt durch Optionen, die wirklich passen, wenn Sie Modelle trainieren, fine-tunen oder betreiben wollen, ohne ständig an VRAM-Grenzen zu stoßen.

Wenn Sie nur einen Teil lesen, dann den Abschnitt zu den Spezifikationen und den zu Kapazität vs. Geschwindigkeit. Die beiden bewahren Sie davor, das Falsche zu kaufen.

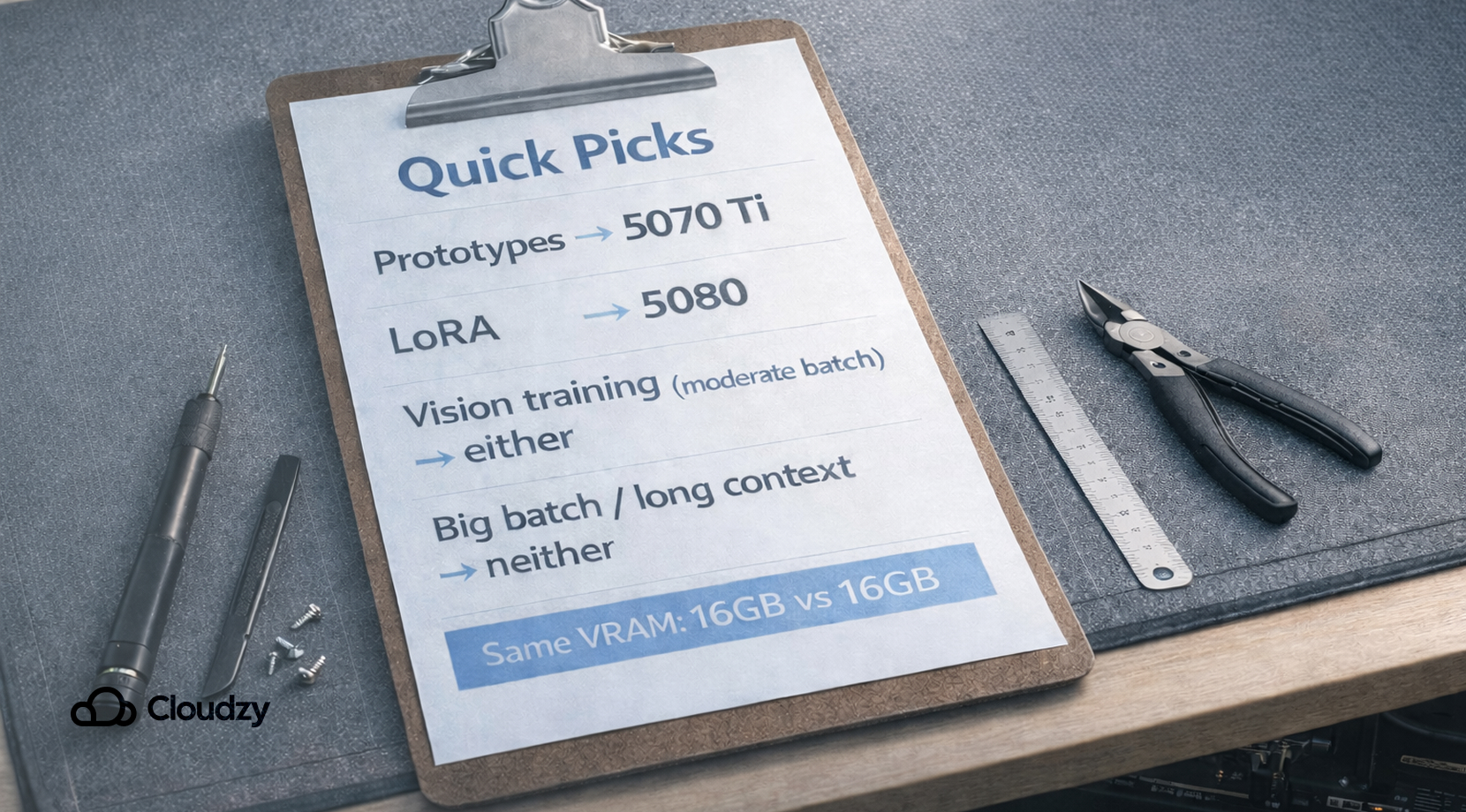

Schnelle Auswahl nach Anwendungsfall

Die meisten kaufen GPUs nicht einfach aufs Geratewohl. Wir sehen immer wieder vier typische Käuferprofile, und die Entscheidung 5070 Ti vs. 5080 fällt je nach Profil anders aus.

Der lokale LLM-Tüftler

Du arbeitest mit Notebooks, wechselst Quantisierungseinstellungen und legst mehr Wert auf "es läuft" als auf optimalen Durchsatz. Bei dir entscheidet beim Vergleich 5070 Ti vs. 5080 meistens das Budget, denn beide Karten fühlen sich bei kleinen Modellen und quantisierter Inferenz gut an. Das VRAM-Limit erreichst du mit beiden, sobald du Kontextlänge oder Batch-Größe erhöhst.

Der Doktorand, der Vision-Modelle trainiert

Du brauchst reproduzierbare Experimente, keine endlosen Neustarts. Der versteckte Kostenfaktor ist nicht die Karte selbst, sondern die Zeit, die du verlierst, wenn Runs in Epoche 3 scheitern, weil Dataloader, Augmentierungen und Modell gleichzeitig um Speicher konkurrieren.

Der Startup-Entwickler, der Inferenz deployt

Du achtest auf Tail-Latenz und Nebenläufigkeit. Eine Single-User-Demo kann auf 16 GB gut aussehen, aber sobald echter Traffic ankommt, frisst der KV-Cache-Druck deinen VRAM wie ein langsames Leck. Beim Serving kann die Frage 5070 Ti vs. 5080 zur Ablenkung werden, wenn dein eigentliches Problem die Kapazität für Batching und lange Prompts ist.

Der Creator, der auch ML macht

Du wechselst zwischen Creative-Apps und ML-Tools, und du hasst Neustarts, Treiber-Probleme und "Chrome schließen, um zu trainieren". Für dich ergibt 5070 Ti vs. 5080 nur Sinn, wenn die GPU Teil eines sauberen Workflows ist, kein wackliger Workstation-Aufbau, der beim Multitasking sofort zusammenbricht.

Mit diesen Szenarien im Kopf schauen wir uns die Hardware konkret an und erklären, warum der limitierende Faktor überall derselbe ist, wo es darauf ankommt.

Wichtige Specs für Deep Learning

Der schnellste Weg, 5070 Ti vs. 5080 zu verstehen: die Marketing-Zahlen ignorieren und auf die Speicherzeile schauen.

Wer die vollständige Spezifikationsübersicht möchte: Diese detaillierte Tabelle zeigt, was Training und Inferenz tatsächlich beeinflusst. (Taktraten und Display-Ausgänge fallen ins Auge, entscheiden aber nicht darüber, ob dein Run in den Speicher passt.)

| Spezifikation (Desktop) | RTX 5070 Ti | RTX 5080 | Relevanz für DL |

| VRAM | 16 GB | 16 GB | Die Kapazität ist die harte Grenze für Weights, Aktivierungen und KV-Cache |

| Speichertyp | GDDR7 | GDDR7 | Ähnliches Verhalten; Bandbreite hilft, aber die Kapazität entscheidet: "passt oder passt nicht" |

| Speicherbus | 256-Bit | 256-Bit | Begrenzt die Gesamtbandbreite; hilft beim Durchsatz, nicht bei der Modellgröße |

| CUDA-Kerne | 8,960 | 10,752 | Mehr Rechenleistung erhöht die Tokens/Sek., entscheidet aber nicht, ob das Modell überhaupt geladen werden kann |

| Typische Board-Leistungsaufnahme | 300 W | 360 W | Mehr Wärmeentwicklung und mehr Spielraum beim Netzteil, aber kein zusätzliches VRAM |

Offizielle Quellen für die Spezifikationen: RTX 5080, RTX 5070 Familie

Kurz gesagt: Die 5080 ist die schnellere Karte, die 5070 Ti die günstigere. Für Deep Learning macht sich der Unterschied vor allem bemerkbar, wenn die Arbeitslast ohnehin schon passt.

Als Nächstes schauen wir uns an, warum VRAM so schnell aufgebraucht ist, selbst bei Setups, die auf dem Papier wenig Ressourcen benötigen.

Warum VRAM beim Deep Learning so schnell aufgebraucht wird

Wer vom Gaming kommt, denkt bei VRAM oft an einen Textur-Pool. Beim Deep Learning ist es eher wie eine enge Küchenarbeitsplatte: Man braucht nicht nur Platz für die Zutaten, sondern gleichzeitig auch zum Schneiden, Kochen und Anrichten.

Das belegt VRAM während eines Durchlaufs typischerweise:

- Modell-Gewichte: die geladenen Parameter, manchmal in FP16/BF16, manchmal quantisiert.

- Aktivierungen: zwischengespeicherte Tensoren für Backpropagation, meist der größte Speicherfresser beim Training.

- Gradienten und Optimizer-Zustand: Trainings-Overhead, der den Speicherbedarf vervielfachen kann.

- KV-Cache: Inferenz-Overhead, der mit der Kontextlänge und der Anzahl gleichzeitiger Anfragen wächst.

Deshalb fühlt sich die Frage 5070 Ti oder 5080 manchmal an wie ein Streit über PS-Zahlen, während man einen zu schweren Anhänger zieht. Mehr Motorleistung hilft nichts, wenn die Anhängelast schon am Limit ist.

Ein schneller Prüfschritt, den wir selbst beim Testen nutzen: sowohl den allokierten als auch den reservierten Speicher in PyTorch protokollieren. Die CUDA-Speicherhinweise von PyTorch erklären den Caching-Allocator und warum Speicher in Tools wie nvidia-smi noch als "belegt" erscheinen kann, obwohl Tensoren bereits freigegeben wurden.

Das bringt uns zum Kern des Themas: Die meisten Deep-Learning-Fehler auf 16 GB entstehen nicht weil es zu langsam ist, sondern weil der Speicher genau im falschen Moment ausgeht.

Die ersten Workloads, bei denen der 5070 Ti an seine Grenzen stößt – im Vergleich zum 5080

Im Folgenden sind die Deep-Learning-Szenarien aufgeführt, die auf der 5070 Ti und 5080 erfahrungsgemäß zuerst an Speichergrenzen stoßen.

LLM Serving mit langen Prompts und echter Parallelität

Ein einzelner Prompt mit 2K Token sieht noch gut aus. Füge längeren Kontext hinzu, aktiviere Batching, kommt ein zweiter Nutzer dazu – und der KV-Cache wächst schnell. Ab diesem Punkt macht der Unterschied zwischen 5070 Ti und 5080 keinen Unterschied mehr: Du musst entweder den maximalen Kontext begrenzen oder die Batch-Größe reduzieren, um überhaupt weiterzumachen.

Eine einfache Prüfmethode:

- Betreibe deinen Server mit dem echten maximalen Kontext und Batch-Größe.

- Beobachte VRAM über die Zeit – nicht nur beim Start.

- Notieren Sie den Zeitpunkt, an dem die Latenz ansteigt, und prüfen Sie dann die Speicherauslastung im selben Zeitfenster.

Wenn du ein zuverlässiges Monitoring-Setup willst, das nicht selbst zum Projekt wird, hilft dir unser Leitfaden zu GPU Monitoring-Software behandelt praxisnahe CLI-Logging-Muster, die sich im realen Betrieb bewähren.

LoRA- oder QLoRA-Fine-Tuning

Viele behaupten, LoRA funktioniere mit 16 GB – und das stimmt. Der Haken ist, dass man dabei den Rest der Pipeline vergisst. Tokenisierungspuffer, Dataloader-Worker, Mixed-Precision-Skalierung und Validierungsschritte summieren sich schnell.

In der Praxis liegt der Engpass hier weniger beim Rechenaufwand als bei der Auslastungsreserve. Wenn keine freien VRAM verfügbar sind, muss man die Durchläufe manuell überwachen.

Visionstraining mit hochauflösenden Eingaben

Bei Bildmodellen gibt es eine tückische Fehlerquelle: Ein kleiner Sprung in der Auflösung oder eine zusätzliche Augmentierung kann den Unterschied zwischen stabilem Training und OOM ausmachen. Auf der 5070 Ti gegenüber der 5080 äußert sich das darin, dass die Batch-Größe auf 1 einbricht und Gradient Accumulation das Training in eine quälend langsame Schleife verwandelt.

Multimodal läuft auf einer GPU

Text-Encoder + Image-Encoder + Fusion-Layer können funktionieren; erhöht man jedoch die Sequenzlänge oder setzt einen größeren Vision-Backbone ein, explodiert der Speicherbedarf.

Meine GPU ist in Ordnung, mein Desktop nicht

Das kennt man. Du startest das Training, dann greifen Browser, IDE und alles andere auf VRAM zu – und plötzlich ist deine vermeintlich stabile Konfiguration kaputt. Leute in Foren beschweren sich, dass sie alles geschlossen, alle Overlays deaktiviert haben und trotzdem bei demselben Modell, das gestern noch lief, einen OOM-Fehler bekommen.

Dieses Muster taucht immer wieder auf in 5070 Ti vs 5080 im Vergleich, ebenfalls, da beide Karten dasselbe Kapazitätslimit haben. Wenn dir das bekannt vorkommt, stellt sich die nächste Frage: Was tun wir gegen dieses Limit?

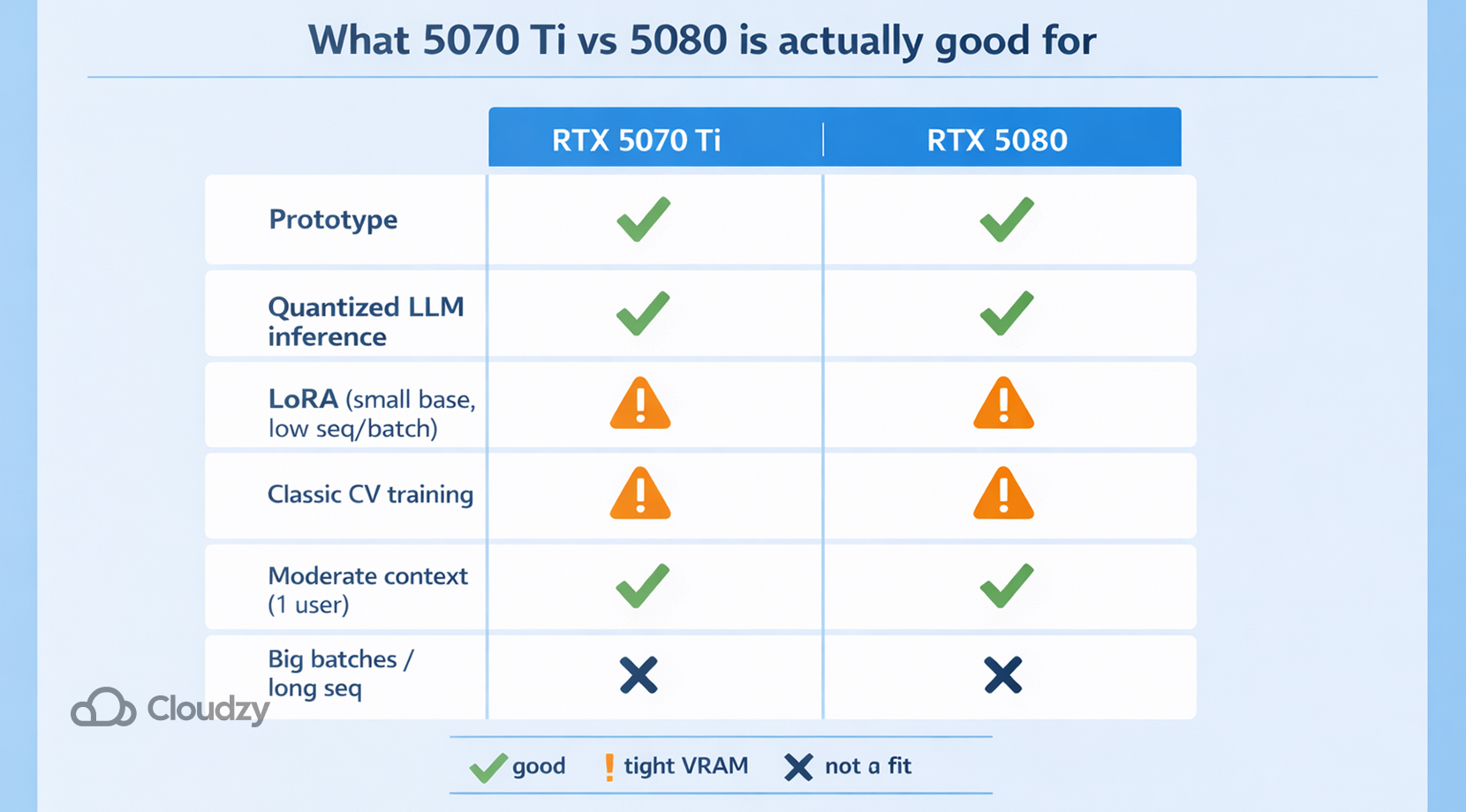

Wofür sich 5070 Ti vs 5080 Actuallich Gout eignet

In ML-Kreisen ist es leicht, 16 GB schlecht zu reden, aber nutzlos sind sie nicht. Der Einsatzbereich ist nur eng.

5070 Ti vs 5080 ist ein durchaus brauchbares Setup für:

- Prototyping: kleine Experimente, schnelle Ablations und Plausibilitätschecks.

- Quantisierte LLM-Inferenz: kleinere Modelle mit moderatem Kontext, einzelner Nutzer.

- LoRA auf kleineren Basismodellen: solange Sequenzlänge und Batch-Größe im Rahmen bleiben.

- Klassisches Vision-Training: moderate Bildgrößen, moderate Backbones, mehr Geduld.

Kurzum: Bleibt deine Arbeit innerhalb des Speicherlimits, fühlt sich die 5080 meist schneller an als die 5070 Ti, und du profitierst von der zusätzlichen Rechenleistung.

Sobald du aber ernsthafteres Deep Learning versuchst, wirst du mit Speicherengpässen konfrontiert. Sprechen wir also über Taktiken, die auf beiden Karten helfen.

Wie wir begrenzten VRAM nutzen, ohne das Training zur Qual zu machen

Keiner dieser Tricks ist Zauberei. Es sind einfach die Maßnahmen, mit denen 5070 Ti vs 5080 länger brauchbar bleiben.

Erst messen

Bevor du Hyperparameter anfasst, erfasse den VRAM-Spitzenwert pro Schritt. In PyTorch bieten sich max_memory_allocated() und max_memory_reserved() als schnelle Möglichkeiten an, um zu sehen, was dein Lauf wirklich verbraucht.

Das hilft dir, Fragen wie diese zu beantworten:

- Ist das Modell selbst der größte Kostenfaktor, oder sind es die Aktivierungen?

- Steigt VRAM während der Validierung an?

- Nimmt die Fragmentierung mit der Zeit zu?

Mit einer Basislinie wird der Rest weniger unvorhersehbar.

Speicher reduzieren, wo es geht

Eine einfache Reihenfolge, die wir verwenden:

- Batch-Größe reduzieren, bis sie passt.

- Gradient Accumulation hinzufügen, um den effektiven Batch wiederherzustellen.

- Mixed Precision (BF16/FP16) aktivieren, wenn der Stack das unterstützt.

- Gradient Checkpointing hinzufügen, wenn Aktivierungen dominieren.

- Erst dann mit der Modellgröße experimentieren.

Context Length wie ein Budget behandeln

Bei Transformers ist die Context Length das, was die meisten Probleme verursacht. Sie beeinflusst den Attention-Compute und beim Inference die KV-Cache-Größe. Im Vergleich 5070 Ti vs. 5080 fällt das sofort auf, sobald man ein paar Tausend Tokens überschreitet: VRAM steigt schnell an, der Durchsatz sinkt, und man muss die Batch-Größe zurückschrauben, nur um stabil zu bleiben.

Empfohlene Vorgehensweise:

- Einen Standard-Max-Context festlegen, der mit ausreichend Puffer läuft.

- Ein zweites Profil für "Long Context" mit kleinerem Batch erstellen.

- Beide Profile beim Debugging nicht mischen.

PyTorch-Cache nicht mit echten Speicherlecks verwechseln

Viele gemeldete "Speicherlecks" sind eigentlich das Verhalten des Allocators. Die Dokumentation von PyTorch erklärt, dass der Caching Allocator Speicher reserviert halten kann, auch nachdem Tensoren freigegeben wurden, und empty_cache() gibt hauptsächlich ungenutzte Cache-Blöcke an andere Anwendungen frei, nicht zurück an PyTorch selbst.

Das ist relevant, weil Nutzer im Vergleich 5070 Ti vs. 5080 sich häufig mit Phantomlecks aufhalten, statt die eigentlichen Ursachen zu untersuchen: Batch-Größe, Sequenzlänge und Aktivierungsspeicher.

Diese Anpassungen machen das vorhandene Speicherlimit nutzbar, ändern aber nichts an der grundlegenden Realität. Wer größere Modelle, längere Contexts oder höhere Parallelität benötigt, braucht mehr VRAM.

Kapazität oder Geschwindigkeit: Was zählt beim Vergleich 5070 Ti vs. 5080?

Eine Möglichkeit, das zu betrachten: Geschwindigkeit ist, wie schnell man fahren kann, Kapazität ist, wie viele Passagiere man mitnehmen kann. Deep Learning braucht beides, aber die Kapazität entscheidet, ob man überhaupt losfahren kann.

Die 5080 liefert in vielen Workloads einen höheren Durchsatz als die 5070 Ti. Aber der Vergleich 5070 Ti vs. 5080 ändert nichts an der Frage "Kann ich das Modell laden und ausführen?", denn beide stoßen irgendwann an ihre Grenzen.

Das ist der Grund, warum Leute nach einem Upgrade oft enttäuscht sind. In kleinen Tests spüren sie den Geschwindigkeitsgewinn, aber sobald sie ihre echte Arbeitslast ausführen, stoßen sie wieder an dieselbe Grenze. Die Grenze kommt nur 30 Sekunden später.

Wer also mit Deep Learning im Hinterkopf einkauft, sollte zuerst klären, in welche Kategorie er fällt:

- Geschwindigkeitslimitiert: Du passt bereits in den Speicher, willst aber schnellere Trainingsschritte.

- Kapazitätslimitiert: Dein Modell passt nicht sauber rein, und du verbringst Zeit damit, das Problem zu verkleinern.

Die meisten, die sich mit 5070 Ti vs. 5080 für Deep Learning beschäftigen, gehören zur zweiten Kategorie, auch wenn ihnen das noch nicht bewusst ist.

Kommen wir jetzt zur Option, die meistens die meiste Zeit spart: die "schweren Jobs" auf eine größere GPU auslagern, ohne dein ganzes Setup rund um ein neues lokales System umzubauen.

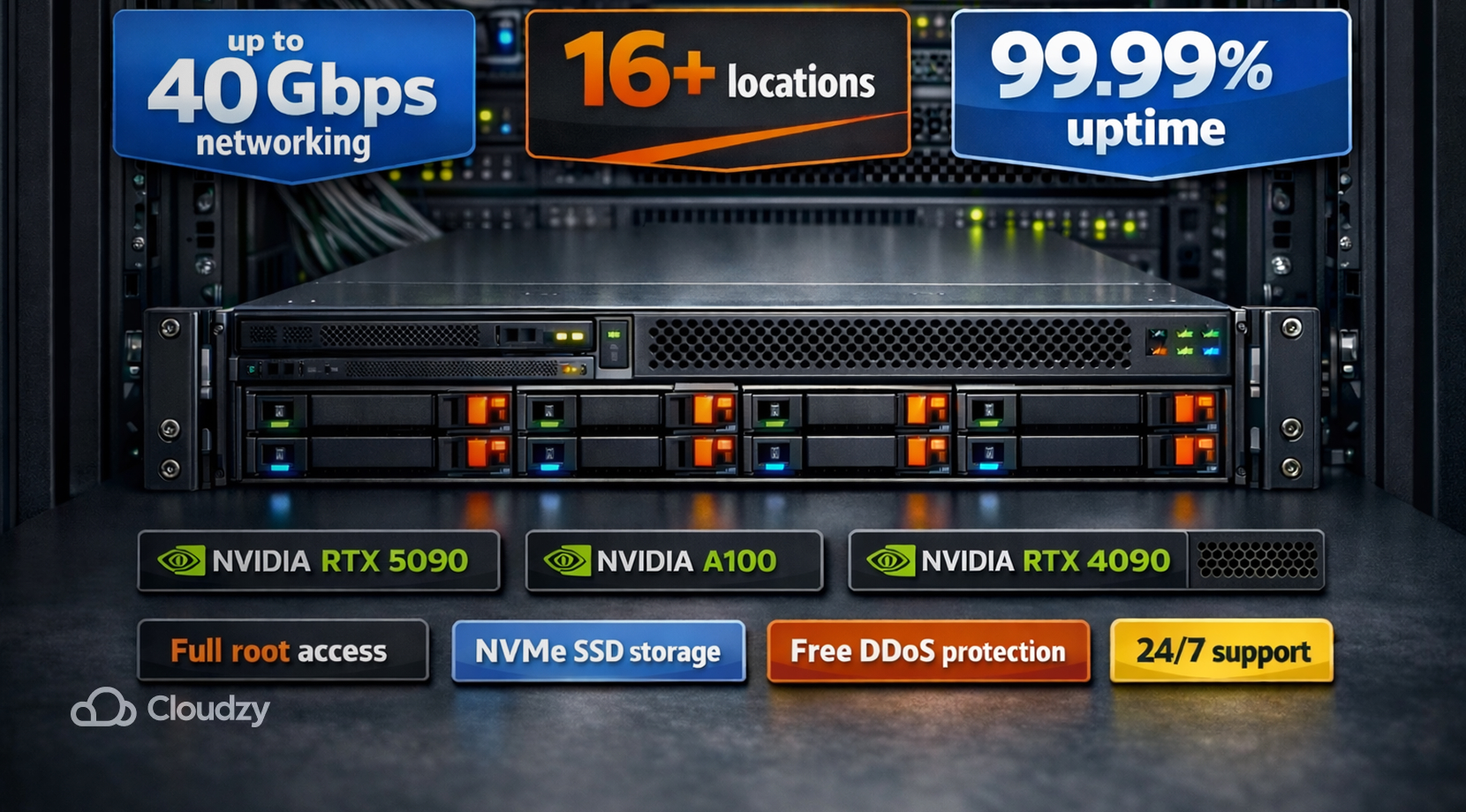

Eine günstige Alternative: GPU VPS für rechenintensive Trainings nutzen

In unserem Infra-Team beobachten wir immer wieder dasselbe Muster: Leute entwickeln lokal, bis sie an einen Punkt kommen, wo die Frage 5070 Ti vs. 5080 keine Rolle mehr spielt, weil das Modell schlicht nicht in den Speicher passt.

Genau in diesem Moment braucht man Zugriff auf einen größeren VRAM-Pool, für das Training und für realistische Inferenz-Tests. Genau dafür ist Cloudzy GPU VPS die passende Lösung.

Unsere GPU VPS-Tarife umfassen NVIDIA-Optionen wie RTX 5090, A100 und RTX 4090, dazu vollen Root-Zugriff, NVMe SSD-Speicher, bis zu 40 Gbps Netzwerk, 12 Standorte, kostenlosen DDoS-Schutz, 24/7-Support und ein Uptime-Ziel von 99,95 %.

Wie hilft dir das nun, egal ob es um 5070 Ti vs. 5080 oder eine andere GPU auf demselben Niveau geht? Ganz einfach:

- Du kannst dein echtes Modell und dein Prompt-Profil auf Hardware mit mehr VRAM testen, sodass deine eigenen Logs die Entscheidung klar machen.

- Du kannst deine lokale GPU für die Entwicklung und schnelle Tests behalten und die "große Karte" nur für rechenintensive Läufe mieten.

Falls du eine kurze Auffrischung möchtest, was ein GPU VPS überhaupt istund was der Unterschied zwischen dedizierter GPU und geteiltem Zugriff bedeutet: unser Einsteiger-Guide erklärt beides in einfachen Worten.

Und wenn du noch nicht sicher bist, ob du für deine Arbeitslast überhaupt eine GPU brauchst, gibt dir unser GPU vs. CPU VPS Vergleich eine klare Vorstellung davon, welche echten Aufgaben - Training, Inferenz, Datenbanken, Web-Apps - welche Hardware erfordern.

Wenn die Infrastruktur geklärt ist, bleibt als letzter Schritt ein Workflow, der deine Zeit nicht verschwendet.

Ein einfacher Workflow, um herauszufinden, was Sie brauchen

Viele ML-Entwickler stecken in einer falschen Entscheidung fest: entweder die größere Consumer-Karte kaufen oder leiden. In der Praxis kann die Wahl zwischen 5070 Ti und 5080 trotzdem Teil eines sinnvollen Workflows sein, wenn man die Karte als lokales Entwicklungswerkzeug behandelt, nicht als vollständigen Produktions-Stack.

Ein Workflow, der sich in der Praxis bewährt hat:

- Nutzen Sie Ihre 16 GB GPU zum Programmieren, Debuggen und für kleine Experimente.

- Halten Sie eine Umgebungsvorlage für eine "große GPU" bereit, um Trainings remote auszuführen.

- Verschieben Sie Trainings- und Serving-Tests, die mehr Spielraum benötigen, auf eine GPU VPS.

- Überwachen Sie Läufe und speichern Sie Logs, damit Ergebnisse reproduzierbar sind.

Wer einen ausführlicheren Überblick sucht, wie man die richtige GPU-Klasse für ML-Arbeit im Allgemeinen auswählt, findet in unserem Vergleich der besten GPUs für Machine Learning einen guten nächsten Anlaufpunkt.

Letztlich ist die Wahl zwischen 5070 Ti und 5080 eine Entscheidung über lokale Rechenleistung, aber Deep-Learning-Skalierung ist eine Infrastrukturentscheidung. Wer wissen möchte, wie sich eine größere Kartenklasse auf das reale KI-Verhalten auswirkt, findet in unserem H100 vs. RTX 4090-Benchmark Vergleich einen nützlichen Einstieg, denn er kehrt immer wieder zum gleichen Grundsatz zurück: VRAM-Passung zuerst, dann Geschwindigkeit.