Pada tahun 1960-an dan 1970-an, arsitektur monolitik lebih disukai untuk pengembangan aplikasi karena keterbatasan sumber daya komputasi, yang mengharuskan semua fungsionalitas digabung menjadi satu unit yang padu.

Hal itu berlangsung hingga akhir tahun 90-an dan 2000-an, ketika struktur monolitik mulai terlalu terbatas untuk menangani ukuran dan kompleksitas aplikasi yang terus berkembang, terutama seiring dengan berkembangnya internet dan sistem terdistribusi.

Kondisi ini mendorong lahirnya pendekatan yang lebih modular, seperti arsitektur berorientasi layanan (SOA) dan, nanti, arsitektur layanan mikro (MSA), yang akhirnya menjadi populer pada awal tahun 2010-an.

Namun, itu tadi hanya penjelasan singkat tentang konsep dasar dan penggunaan layanan mikro. Mari kita bahas bagaimana layanan mikro menggantikan arsitektur monolitik, cara kerjanya, dan beberapa contohnya. Setelah itu, kita akan membahas aspek-aspek utama dalam deployment layanan mikro serta langkah yang perlu dilakukan jika Anda ingin men-deploy layanan mikro.

Apa Itu Layanan Mikro? Bagaimana Cara Kerjanya?

Seperti yang saya sebutkan sebelumnya, layanan mikro hadir sebagai solusi atas meningkatnya kompleksitas dan ukuran aplikasi, memungkinkan perusahaan memecah fungsi-fungsi menjadi layanan yang dapat di-deploy secara independen.

Istilah "microservices" dipopulerkan oleh para pakar industri seperti Martin Fowler dan James Lewis, yang memperkenalkannya secara resmi melalui sebuah artikel blog pada tahun 2014. Karya mereka mendefinisikan prinsip dan karakteristik utama, termasuk kebutuhan akan layanan yang dapat di-deploy secara independen, manajemen data yang terdesentralisasi, dan ketidaktergantungan pada teknologi tertentu.

Sejak saat itu, layanan mikro menjadi pilihan arsitektur yang umum digunakan, didukung oleh perkembangan dalam teknologi containerisasi seperti Docker, alat orkestrasi seperti Kubernetes, dan platform komputasi serverless. Lalu, bagaimana sebenarnya cara kerja layanan mikro?

Cara Kerja Layanan Mikro

Pada intinya, arsitektur layanan mikro memecah aplikasi besar menjadi layanan-layanan kecil yang terpisah, masing-masing bertanggung jawab atas satu kemampuan bisnis tertentu. Layanan-layanan ini saling berkomunikasi melalui jaringan, umumnya menggunakan REST API, gRPC, atau message broker seperti RabbitMQ atau Apache Kafka.

Menurut definisi Martin Fowler dan James Lewis, semua layanan mikro memiliki empat karakteristik utama sebagai berikut:

- Tanggung Jawab Tunggal: Setiap layanan mikro dirancang untuk menjalankan satu tugas atau fungsi tertentu, memungkinkan spesialisasi yang jelas sekaligus mengurangi kompleksitas.

- Kemandirian: Microservice dapat dikembangkan, di-deploy, dan diskalakan secara independen satu sama lain, sehingga memberikan fleksibilitas dan ketahanan.

- Manajemen Data Terdesentralisasi: Microservice sering kali memiliki database tersendiri, sehingga tidak perlu bergantung pada satu database terpusat.

- Agnostisisme Teknologi: Tim dapat memilih teknologi yang paling sesuai untuk setiap layanan tanpa terikat pada pilihan layanan lain.

Pendekatan ini berbeda dengan arsitektur monolitik tradisional, di mana semua komponen aplikasi terintegrasi erat dalam satu unit yang kohesif.

Tahapan Utama Deployment Microservice

Meskipun arsitektur microservice menawarkan banyak keuntungan seperti skalabilitas tinggi, fleksibilitas, efisiensi, dan isolasi kegagalan, pendekatan ini tetap memerlukan pemahaman cara men-deploy microservice secara efektif serta perencanaan yang matang agar berhasil.

Itulah mengapa memahami konsep kunci, tahapan, dan praktik terbaik dalam men-deploy microservice sangat penting untuk keberhasilan arsitektur microservice. Mari kita telusuri tahapan utama deployment microservice dan apa yang tercakup di setiap tahapnya.

Perencanaan dan Persiapan Deployment Microservice

Semua hal yang baik membutuhkan perencanaan dan kesabaran. Untuk men-deploy microservice dengan sukses, Anda tentu memerlukan perencanaan dan kesabaran yang cukup. Karena itu, penting untuk mengikuti praktik terbaik microservice dan mempersiapkan semua yang dibutuhkan sebelum mulai men-deploy microservice.

Seperti yang disebutkan sebelumnya, salah satu prinsip dan karakteristik utama microservice adalah Prinsip Tanggung Jawab Tunggal. Dengan berpegang pada prinsip ini dan memastikan setiap microservice berfokus pada satu fungsi dan kapabilitas, Anda memungkinkan tim untuk mengembangkan, men-deploy, dan menskalakan layanan secara independen.

Selain itu, subkategori dari prinsip ini adalah prinsip desain loose coupling. Artinya, setiap layanan dapat berfungsi secara independen dalam komunikasi dan hanya bergantung seminimal mungkin pada layanan lain. Hal ini memungkinkan perubahan atau pembaruan pada satu layanan tidak memengaruhi layanan lain, sehingga mendukung penskalaan microservice secara independen.

Ini mengurangi risiko kegagalan berantai, yaitu kondisi di mana masalah pada satu bagian sistem memicu reaksi berantai yang menyebabkan kegagalan di seluruh sistem dan melumpuhkan keseluruhan layanan.

Salah satu praktik penting dalam microservice adalah menyediakan penyimpanan data khusus untuk setiap layanan saat men-deploy microservice, sebagai wujud nyata dari prinsip loose coupling. Ini mencegah konflik dan mendukung skalabilitas layanan yang lebih baik.

Selain itu, Anda memerlukan pola komunikasi asinkron antar microservice, seperti message broker, untuk memastikan setiap layanan dapat berkomunikasi tanpa ketergantungan langsung.

Bagian terakhir yang perlu diperhatikan adalah menerapkan pipeline Continuous Integration dan Continuous Delivery (CI/CD) untuk microservice. Pipeline ini memungkinkan tim men-deploy fitur baru atau perbaikan melalui Alat CI/CD seperti Jenkins dan GitLab, sehingga organisasi dapat menjaga stabilitas sistem sambil terus merilis kapabilitas baru secara rutin.

Sekarang setelah Anda memahami gambaran umum perencanaan dan persiapan yang diperlukan untuk deployment microservice, mari kita bahas strategi deployment microservice.

Strategi Deployment Microservice

Saat men-deploy microservice, pemilihan strategi deployment bergantung pada fungsi layanan, traffic, konfigurasi infrastruktur, keahlian tim, dan pertimbangan biaya. Secara umum, strategi deployment microservice adalah sebagai berikut:

- Satu Instance Layanan per Container: Dalam pendekatan ini, setiap microservice berjalan di dalam container-nya sendiri, memberikan isolasi yang lebih baik dibandingkan model beberapa instance per host. Container memudahkan penskalaan dan meningkatkan efisiensi alokasi sumber daya.

- Instansi Layanan per Mesin Virtual: Setiap service berjalan di virtual machine (VM) terpisah, memberikan isolasi yang lebih kuat dibandingkan container. Meskipun ini meningkatkan keamanan dan stabilitas, pendekatan ini umumnya membutuhkan overhead yang lebih besar.

- Rilis Bertahap: Pada awalnya, deploy versi microservice ke sebagian kecil pengguna untuk menguji stabilitasnya sebelum rollout penuh. Pendekatan ini meminimalkan dampak jika masalah muncul dan memungkinkan rollback cepat untuk menjaga integritas sistem.

- Penyebaran Biru-Hijau: Metode ini menggunakan dua lingkungan produksi yang identik. Satu lingkungan melayani traffic live, sementara yang lain digunakan untuk menguji rilis berikutnya. Blue-green deployment memudahkan rollback dan pembaruan tanpa downtime, karena traffic dapat dialihkan antara kedua lingkungan kapan saja.

- Rilis Bertahap: Strategi ini melibatkan rollout pembaruan secara bertahap ke segmen pengguna atau lingkungan yang berbeda. Biasanya dimulai dari lingkungan internal sebelum mencapai produksi, sehingga membatasi dampak dari potensi masalah dan memungkinkan tim menangani isu secara bertahap.

- Penyebaran Tanpa Server: Pendekatan ini memanfaatkan platform serverless seperti AWS Fargate dan Google Cloud Run, yang mengotomasi pengelolaan infrastruktur dengan menangani penskalaan dan alokasi sumber daya secara otomatis. Dengan serverless deployment, Anda tidak perlu mengelola server yang mendasarinya, sehingga bisa fokus sepenuhnya pada microservice itu sendiri.

Setelah memilih salah satu strategi microservice di atas, Anda akan membutuhkan alat orkestrasi microservices.

Orkestrasi Microservices

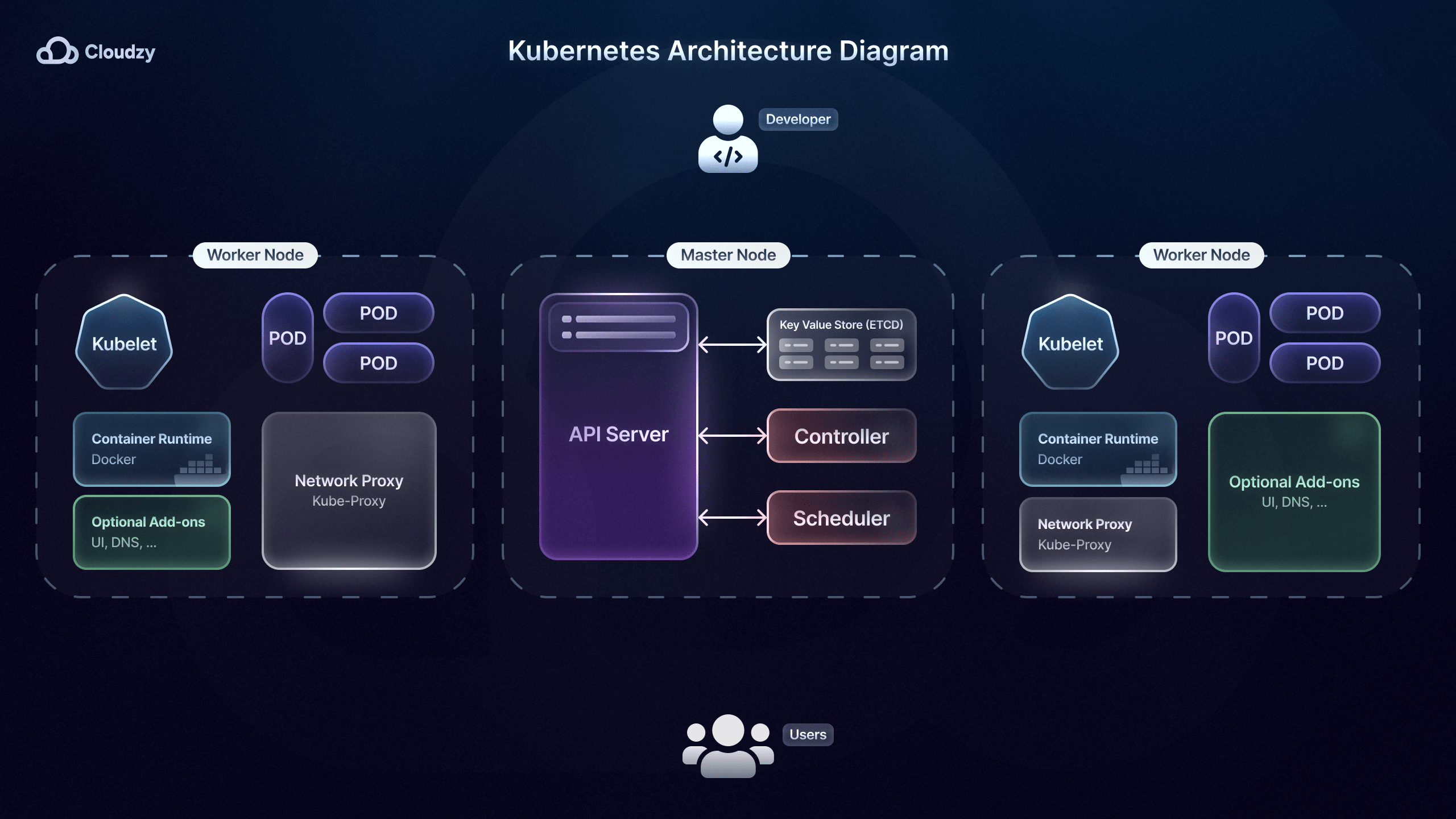

Setelah memilih salah satu dari sekian banyak strategi deployment microservices, Anda akan membutuhkan semacam pengatur untuk orkestrasi microservice. Alat orkestrasi microservices, seperti Kubernetes, membantu mengotomasi deployment, penskalaan, pemantauan, dan pengelolaan microservices yang berjalan di dalam container.

Airbnb, misalnya, menggunakan Kubernetes, sehingga para engineer-nya dapat men-deploy ratusan perubahan ke microservices mereka tanpa pengawasan manual. Salah satu fitur penting dari alat orkestrasi microservices seperti Kubernetes adalah load balancing bawaan.

Fitur load balancing yang andal membantu mendistribusikan traffic masuk ke beberapa instance microservice. Ini mencegah satu instance menjadi bottleneck dan meningkatkan kemampuan sistem dalam menangani lonjakan permintaan.

Kubernetes memainkan peran penting dalam pengelolaan microservices melalui kemampuan self-healing-nya, di mana container yang gagal secara otomatis diganti dan di-restart. The New York Times mengandalkan fitur ini untuk menjaga microservices-nya tetap berjalan tanpa memengaruhi pengalaman pengguna atau mengalami downtime.

Selain itu, Kubernetes juga meningkatkan keamanan microservice dengan mengelola konfigurasi dan secrets, seperti kredensial database atau kunci API, menggunakan ConfigMaps dan Secrets. Ini sangat penting bagi perusahaan dan layanan seperti Uber yang menangani data sensitif pelanggan.

Terakhir, alat orkestrasi microservices seperti Kubernetes sangat bermanfaat untuk strategi microservice yang melibatkan rolling updates dan rollback, seperti staged releases. Rolling updates memungkinkan versi microservice baru di-deploy tanpa gangguan layanan dengan tetap menjalankan sebagian instance versi lama.

Setelah menyiapkan alat orkestrasi microservices, Anda perlu membangun dan mengotomasi Saluran CI/CD untuk deployment microservices.

CI/CD Pipelines untuk Deployment Microservices

Seperti yang telah dibahas sebelumnya, pipeline Continuous Integration dan Continuous Delivery untuk microservices merupakan aspek penting dari deployment microservices. Bagian CD dalam CI/CD pipeline bertugas men-deploy perubahan kode ke produksi secara otomatis begitu perubahan tersebut lulus tahap pengujian dan integrasi.

Selanjutnya, bagian CD dari CI/CD pipeline bekerja sehingga setiap kali perubahan kode lulus tahap pengujian dan integrasi, service tersebut di-deploy ke alat orkestrasi microservices seperti cluster Kubernetes.

Selain itu, tahap pengujian dan integrasi semuanya dijalankan secara otomatis oleh CI/CD pipeline, mencakup unit tests, integration tests, dan end-to-end tests yang sudah terintegrasi dalam pipeline.

Ini memungkinkan tim memvalidasi pembaruan di setiap tahap sembari menjaga stabilitas sistem. Selain itu, jika ada masalah pada perubahan kode meski telah melalui berbagai pengujian, rollback otomatis dapat mengembalikan ke versi stabil sebelumnya.

Terakhir, menerapkan CI/CD pipeline untuk microservices sesuai dengan praktik terbaik microservices membantu organisasi mencapai siklus pengembangan yang lebih cepat, mengurangi kesalahan manual, dan menjaga standar kualitas yang tinggi.

Banyak perusahaan seperti Spotify, Expedia, iRobot, Lufthansa, Pandora, dan lainnya menggunakan pipeline CI/CD untuk microservices melalui alat CI/CD seperti CircleCI, AWS CodePipeline, dan GitLab untuk mengotomatiskan proses deployment, menjaga kualitas kode tetap konsisten, dan merilis fitur baru dengan cepat tanpa mengorbankan stabilitas sistem.

Pola Komunikasi Microservices

Cara microservices berkomunikasi satu sama lain sangat bergantung pada fungsinya, arsitektur keseluruhan, skalabilitas yang diinginkan, dan keandalan microservices itu sendiri. Secara umum, ada dua jenis pola komunikasi microservices yang biasa digunakan: sinkron dan asinkron pola komunikasi microservices.

Dalam pola komunikasi microservices sinkron, layanan berinteraksi secara real-time, artinya sebuah layanan akan mengirimkan permintaan dan menunggu respons sebelum melanjutkan. Pola komunikasi microservices sinkron yang paling umum digunakan adalah REST (Representational State Transfer) API, gRPC (Panggilan Prosedur Jarak Jauh Google), dan GraphQL.

Pola komunikasi microservices jenis ini umumnya digunakan di industri dan perusahaan yang membutuhkan pemrosesan data secara real-time dan respons yang langsung. Industri seperti keuangan, layanan kesehatan, dan e-commerce sering menggunakan pola komunikasi sinkron untuk memastikan transaksi, pengambilan data, atau interaksi terjadi secara instan, sehingga pengalaman pengguna tetap lancar dan responsif.

Meskipun pola komunikasi microservices sinkron menawarkan keuntungan seperti respons real-time dan kesederhanaan implementasi, ada pula kekurangannya, yaitu potensi bottleneck akibat tight coupling, skalabilitas yang rendah saat beban tinggi, waktu respons yang lambat, dan latensi tinggi pada saat trafik padat.

Di sisi lain, pola komunikasi microservices asinkron umumnya lebih sesuai untuk microservices karena didasarkan pada prinsip Loose Coupling yang telah kita bahas sebelumnya.

Pola komunikasi microservices jenis ini memisahkan layanan dengan memungkinkan mereka mengirim dan menerima pesan melalui broker seperti Kafka atau RabbitMQ. Dengan mengirimkan pesan ke antrian yang berfungsi sebagai buffer, layanan berkomunikasi secara independen tanpa harus menunggu respons seperti pada pola komunikasi sinkron. Buffer ini memungkinkan layanan lain memproses pesan sesuai kecepatan mereka sendiri, sehingga pengirim dapat melanjutkan pekerjaannya tanpa menunggu penerima.

Pola komunikasi microservices asinkron tidak hanya menawarkan struktur yang terpisah untuk deployment microservices, tetapi juga memberikan respons real-time yang setara dengan pola komunikasi sinkron.

Hal ini dimungkinkan oleh arsitektur event-driven pada pola komunikasi microservices asinkron berbasis event, di mana layanan berkomunikasi dengan memancarkan event saat tindakan tertentu terjadi. Layanan lain dapat berlangganan event tersebut dan bereaksi sesuai kebutuhan. Ini menghasilkan sistem yang sangat responsif terhadap perubahan secara real-time tanpa ketergantungan langsung antar layanan.

Selain itu, dalam asynchronous Publikasi-Berlangganan (Pub/Sub) pola komunikasi microservices, layanan (publisher) mengirimkan pesan ke sebuah topik, dan layanan lain (subscriber) mendengarkan topik tersebut untuk menerima pembaruan. Model ini mendukung banyak subscriber, yang secara bersamaan menerima siaran pesan dari berbagai layanan.

Terakhir, mirip dengan pola event-driven, pola komunikasi microservices asinkron saga berbasis koreografi juga menggunakan event untuk berkomunikasi satu sama lain; namun dalam pola ini terdapat urutan tertentu, artinya setiap event memicu langkah berikutnya dan mengaktifkan layanan yang sesuai.

Perbedaannya adalah pada pola event-driven tidak ada urutan atau alur kerja yang pasti, dan beberapa layanan dapat bereaksi terhadap satu event, berbeda dengan proses dan urutan yang spesifik dalam pola choreography-based saga.

Pola komunikasi microservices asinkron mana yang digunakan bergantung pada tugas dan fungsi keseluruhan microservices Anda. Message queue seperti RabbitMQ dan Amazon SQS umumnya digunakan untuk penjadwalan tugas, distribusi beban kerja, serta e-commerce untuk pemrosesan pesanan dan sistem notifikasi.

Event-driven message broker seperti Apache Kafka dan AWS EventBridge umumnya digunakan untuk memproses aliran event dalam skala besar secara real-time dan untuk perutean event antar microservices di bidang seperti layanan keuangan dan lingkungan AWS.

Sementara itu, message broker Publish-Subscribe (Pub/Sub) seperti Google Cloud Pub/Sub dan Redis Streams biasanya digunakan untuk pengiriman pesan terdistribusi dalam skala besar, analitik real-time, penyerapan event, serta notifikasi real-time dan aplikasi chat.

Terakhir, message broker choreography-based saga terutama digunakan untuk pemrosesan pesanan e-commerce, sistem pemesanan perjalanan, dan kasus penggunaan yang memerlukan koordinasi transaksi kompleks multi-langkah di berbagai layanan tanpa kontrol terpusat.

Service Discovery pada Microservices

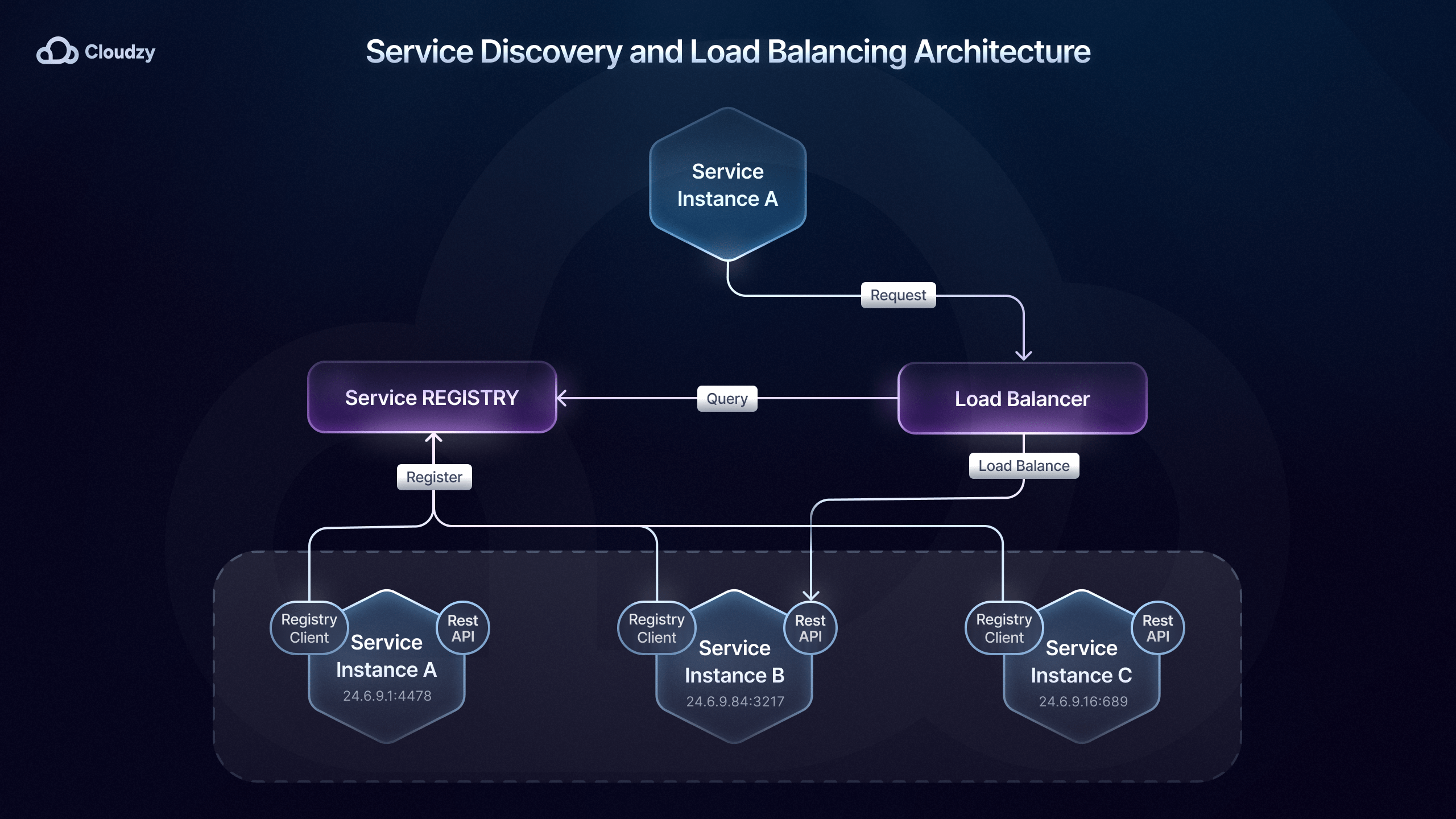

Setelah menyiapkan dan menerapkan pola komunikasi yang sesuai, langkah berikutnya adalah memastikan setiap layanan bisa saling menemukan satu sama lain. Seperti yang disebutkan sebelumnya, alat orkestrasi layanan mikro seperti Kubernetes memainkan peran penting dalam service discovery microservice.

Hal ini dilakukan melalui service discovery bawaan yang disediakan oleh Kubernetes DNS, yang secara dinamis memperbarui alamat IP dan rekaman DNS saat layanan melakukan scaling atau berpindah lokasi di dalam cluster.

Metode service discovery microservice ini disebut server-side discovery, karena tanggung jawab routing didelegasikan ke load balancer, yang kemudian melakukan query ke registry dan mengarahkan traffic ke instance yang tepat.

Di sisi lain, ada juga metode client-side discovery untuk service discovery microservice, di mana layanan atau gateway API melakukan query ke service registry seperti Consul atau Eureka untuk menemukan instance yang tersedia.

Pilihan metode service discovery yang tepat untuk deployment microservice Anda bergantung pada kebutuhan dan skala sistem.

Dengan client-side service discovery pada microservice, client memiliki kendali penuh atas instance mana yang ingin digunakan. Ini tidak hanya memungkinkan kustomisasi yang lebih luas, tetapi juga mengurangi kompleksitas karena tidak diperlukan layanan discovery terpusat.

Sebagai contoh, deployment microservice Netflix menggunakan client-side service discovery dengan Eureka dan Ribbon untuk load balancing, sehingga client dapat memilih instance terbaik berdasarkan kriteria seperti latensi dan beban server.

Sementara itu, server-side service discovery pada microservice lebih cocok untuk lingkungan yang lebih besar, karena service discovery terpusat dapat meningkatkan efisiensi dan memastikan load balancing yang konsisten di seluruh sistem terdistribusi.

Solusi server-side service discovery microservice seperti Kubernetes, AWS Elastic Load Balancing, dan API Gateway (Kong, NGINX, dll.) membantu mengarahkan traffic secara efisien, menjaga ketersediaan tinggi, dan digunakan oleh perusahaan seperti Airbnb, Pinterest, Expedia, Lyft, dan lainnya.

Keamanan Microservice

Meskipun arsitektur monolitik umumnya kalah dibandingkan MSA, ada satu aspek di mana arsitektur monolitik lebih unggul, yaitu keamanan. Karena microservice dibangun di atas prinsip Loose Coupling dan bersifat terdistribusi, satu langkah keamanan umum yang seragam tidak bisa diterapkan begitu saja.

Karena setiap layanan harus diamankan secara terpisah, perlindungan tambahan menjadi wajib mengingat permukaan serangan pada microservice jauh lebih luas. Untuk itu, standar seperti OAuth2 dan JSON Web Tokens (JWT) umum digunakan untuk autentikasi dan otorisasi.

Selain itu, gateway API juga sering digunakan untuk mengelola keamanan di seluruh microservice, karena ia menegakkan autentikasi dan otorisasi di titik masuk. Di samping itu, gateway API juga dapat menerapkan rate limiting, logging, dan monitoring sebagai lapisan keamanan tambahan pada microservice.

Meski titik masuk utama sudah terlindungi, langkah keamanan microservice lebih lanjut tetap diperlukan untuk melindungi komunikasi antar layanan.

Di sinilah service mesh berperan, karena ia menambahkan lapisan keamanan jaringan pada microservice, mengenkripsi traffic antar layanan, dan menerapkan kebijakan seperti mutual TLS. Service mesh ini pada dasarnya membangun enkripsi end-to-end yang menyeluruh, yang secara signifikan meningkatkan keamanan microservice.

Penskalaan Layanan Mikro

Salah satu keunggulan terbesar MSA, dan alasan utama dikembangkannya untuk menggantikan arsitektur monolitik, adalah skalabilitasnya yang tinggi. Pada umumnya, scaling microservice dapat dilakukan dengan dua cara: vertikal dan horizontal.

Secara umum, scaling vertikal microservice (scale up) berarti menambahkan lebih banyak sumber daya, seperti CPU atau memori, pada instance yang sudah ada. Sementara itu, scaling horizontal microservice (scale out) mendistribusikan beban dan meningkatkan kapasitas.

Dari sisi implementasi, scaling vertikal microservice lebih mudah dilakukan karena Anda hanya perlu memodifikasi satu instance, misalnya dengan upgrade ke server yang lebih besar, menambah memori atau daya pemrosesan pada cloud instance, atau menambah kapasitas penyimpanan.

Jenis scaling ini umumnya digunakan ketika peningkatan daya RAM atau CPU dapat meningkatkan performa query dan pemrosesan data, seperti pada layanan yang bertanggung jawab atas in-memory caching.

Meski demikian, meskipun scaling vertikal microservice lebih mudah dan langsung memberikan peningkatan performa, ada beberapa kelemahannya. Scaling vertikal dibatasi oleh kapasitas hardware server, sehingga pada titik tertentu Anda perlu beralih ke scaling horizontal.

Selain itu, scaling vertikal memiliki biaya yang tinggi karena hardware dan instance yang lebih besar umumnya datang dengan harga mahal. Terakhir, jika instance yang sudah di-scale up mengalami kegagalan, layanan akan mati sepenuhnya karena tidak ada instance lain yang bisa menangani beban.

Pada scaling horizontal microservice, alih-alih meningkatkan sumber daya satu instance, Anda men-deploy instance baru dari layanan tersebut. Meskipun instance-instance ini bekerja secara independen, mereka tetap menangani layanan yang sama dan bagian dari workload yang sama.

Berbeda dengan scaling vertikal, scaling horizontal microservice tidak memiliki batas, artinya Anda dapat menambahkan instance sebanyak yang dibutuhkan untuk menangani lonjakan workload dan traffic, sehingga memberikan skalabilitas yang lebih besar.

Selain itu, karena ada beberapa instance, jika salah satunya gagal, Anda tidak bergantung pada satu titik saja karena instance lain dapat terus menangani permintaan. Terakhir, scaling horizontal jauh lebih hemat biaya dalam jangka panjang, karena Anda bisa menggunakan beberapa instance yang lebih kecil dan lebih murah untuk membentuk performa yang lebih andal dan bertenaga.

Meski begitu, scaling horizontal dan penambahan instance memerlukan lebih banyak load balancer, mekanisme service discovery microservice, dan alat orkestrasi microservice, sehingga membuat arsitektur microservice Anda jauh lebih kompleks.

Scaling horizontal lebih cocok untuk kasus penggunaan seperti layanan web dan aplikasi seperti platform e-commerce atau media sosial, yang sering mengalami lonjakan traffic yang fluktuatif dan volume permintaan yang tinggi.

Perlu diingat, ini bukan soal memilih salah satu, karena kedua jenis penskalaan didukung dalam microservices dan keduanya diperlukan dalam banyak situasi. Umumnya, organisasi kecil menggunakan penskalaan vertikal karena lebih mudah diterapkan dan dikelola, namun seiring waktu dan berkembangnya aplikasi, penskalaan horizontal diperkenalkan untuk menangani lonjakan permintaan.

Terakhir, platform cloud menawarkan layanan auto-scaling yang secara otomatis menambah atau mengurangi instance berdasarkan permintaan secara real-time, yang sangat membantu organisasi dalam menyeimbangkan penskalaan vertikal dan horizontal.

Pemantauan Microservice

Pada tahap ini, deployment microservices Anda sudah hampir selesai. Yang perlu dilakukan selanjutnya adalah memastikan semuanya berjalan konsisten dan andal. Di sinilah tools monitoring microservices seperti Prometheus dan Grafana masuki.

Tools ini memberikan insight real-time ke dalam metrik layanan sehingga tim dapat memantau penggunaan resource, latensi, dan tingkat error. Selain itu, tools ini juga menawarkan distributed tracing (Jaeger, Zipkin, dll.), yang membantu memvisualisasikan alur request lintas layanan dan sangat berguna untuk mendiagnosis masalah.

Terakhir, karena kegagalan dapat merambat ke seluruh layanan akibat desain terdistribusi microservices, agregasi log adalah praktik penting dalam pemantauan microservices. Dengan mengkonsolidasikan log ke dalam satu platform terpusat dan mengatur alert real-time, Anda selalu selangkah lebih maju dari masalah dan dapat merespons secara proaktif sebelum berdampak pada pengguna.

Pemikiran Akhir

Meskipun dunia microservices memang tidak mudah dipahami, memahami dasar-dasar dan tahapan utama deployment microservices dapat membuat seluruh proses jauh lebih mudah. Ditambah lagi, seiring berjalannya waktu, semakin banyak tools dengan fitur yang lebih lengkap tersedia untuk Anda, membuat deployment microservices semakin mudah dari sebelumnya.

Pertanyaan yang Sering Diajukan

Strategi deployment apa yang umum digunakan untuk microservices?

Meskipun ada banyak strategi deployment microservices, strategi yang paling umum digunakan meliputi service instances per container, phased release, blue-green deployment, dan serverless deployment, yang masing-masing menawarkan tingkat isolasi, fleksibilitas, dan skalabilitas yang berbeda.

Apa peran Kubernetes dalam orkestrasi microservices?

Microservices bergantung pada tools orkestrasi seperti Kubernetes untuk mengotomatiskan deployment, penskalaan, dan pengelolaan layanan berbasis container, dengan menyediakan load balancing, auto-scaling, dan kemampuan self-healing guna memastikan microservices yang tangguh dan efisien.

Bagaimana cara memastikan keamanan di lingkungan microservices?

Karena sifatnya yang terdistribusi, microservices lebih kompleks dalam hal keamanan dibandingkan arsitektur monolitik. Keamanan dalam microservices mencakup autentikasi dan otorisasi request, enkripsi komunikasi antar layanan, serta penerapan gateway API dan service mesh seperti Istio untuk manajemen keamanan yang terpusat.