Dengan semakin tingginya permintaan terhadap LLM lokal, banyak pengguna merasa bingung saat memilih yang paling sesuai. Menggunakannya pun tidak semudah yang dibayangkan. Karena cukup memakan sumber daya, sebagian lebih boros dari yang lain, banyak orang enggan mencobanya, belum lagi waktu berjam-jam yang mungkin dihabiskan pemula hanya untuk menatap layar terminal.

Ada dua kandidat utama yang membuat semuanya lebih mudah. Ollama dan LM Studio adalah dua platform yang paling banyak digunakan untuk menjalankan LLM lokal, dengan performa yang sudah teruji. Tapi memilih di antara keduanya bisa jadi sulit, karena masing-masing dirancang untuk alur kerja yang berbeda. Langsung saja, mari kita bahas perbandingan Ollama vs LM Studio.

Ollama sebagai Alat untuk Pengguna Teknis

Dalam hal menjalankan LLM lokal, Ollama adalah pilihan yang kuat berkat banyaknya fitur yang ditawarkan. Selain sangat bisa dikonfigurasi, platform ini juga gratis karena didukung komunitas sebagai proyek open-source.

Meski Ollama menyederhanakan proses menjalankan LLM lokal, platform ini mengutamakan CLI (command line interface), sehingga tetap memerlukan pengetahuan dasar terminal. Pendekatan CLI-first ini menjadi nilai plus besar untuk alur kerja pengembangan karena kesederhanaannya. Bekerja dengan CLI memang tidak mudah, tapi masih lebih hemat waktu dibanding menjalankan LLM lokal secara mandiri dari nol.

Ollama mengubah komputer pribadi Anda menjadi mini-server lokal dengan HTTP API, sehingga aplikasi dan skrip Anda bisa mengakses berbagai modelnya. Artinya, ia merespons prompt seperti LLM online pada umumnya, tanpa mengirim data ke cloud. Selain itu, API-nya memungkinkan pengguna mengintegrasikan Ollama ke dalam website dan chatbot.

Karena berbasis CLI, Ollama juga cukup ringan, sehingga tidak terlalu memakan sumber daya dan lebih fokus pada performa. Ini bukan berarti Anda bisa menjalankannya di komputer lawas seadanya, tapi tetap menjanjikan bagi pengguna yang ingin memaksimalkan setiap sumber daya dan mengarahkannya langsung ke model LLM itu sendiri.

Dari semua itu, Anda mungkin sudah menebak bahwa Ollama sangat berorientasi pada alur kerja pengembangan, dan Anda benar. Berkat kemudahan integrasi, privasi lokal, dan desain yang mengutamakan API, ini adalah pilihan yang jelas jika Anda lebih condong ke pola pikir developer.

Dalam perdebatan Ollama vs LM Studio, Ollama mungkin lebih unggul berkat pendekatannya yang mengutamakan API. Jika runtime berbasis CLI terasa asing bagi Anda, lanjutkan membaca untuk menemukan opsi yang lebih ringan dan dirancang dengan kemudahan penggunaan sebagai prioritas.

LM Studio: Pilihan yang Ramah Pengguna

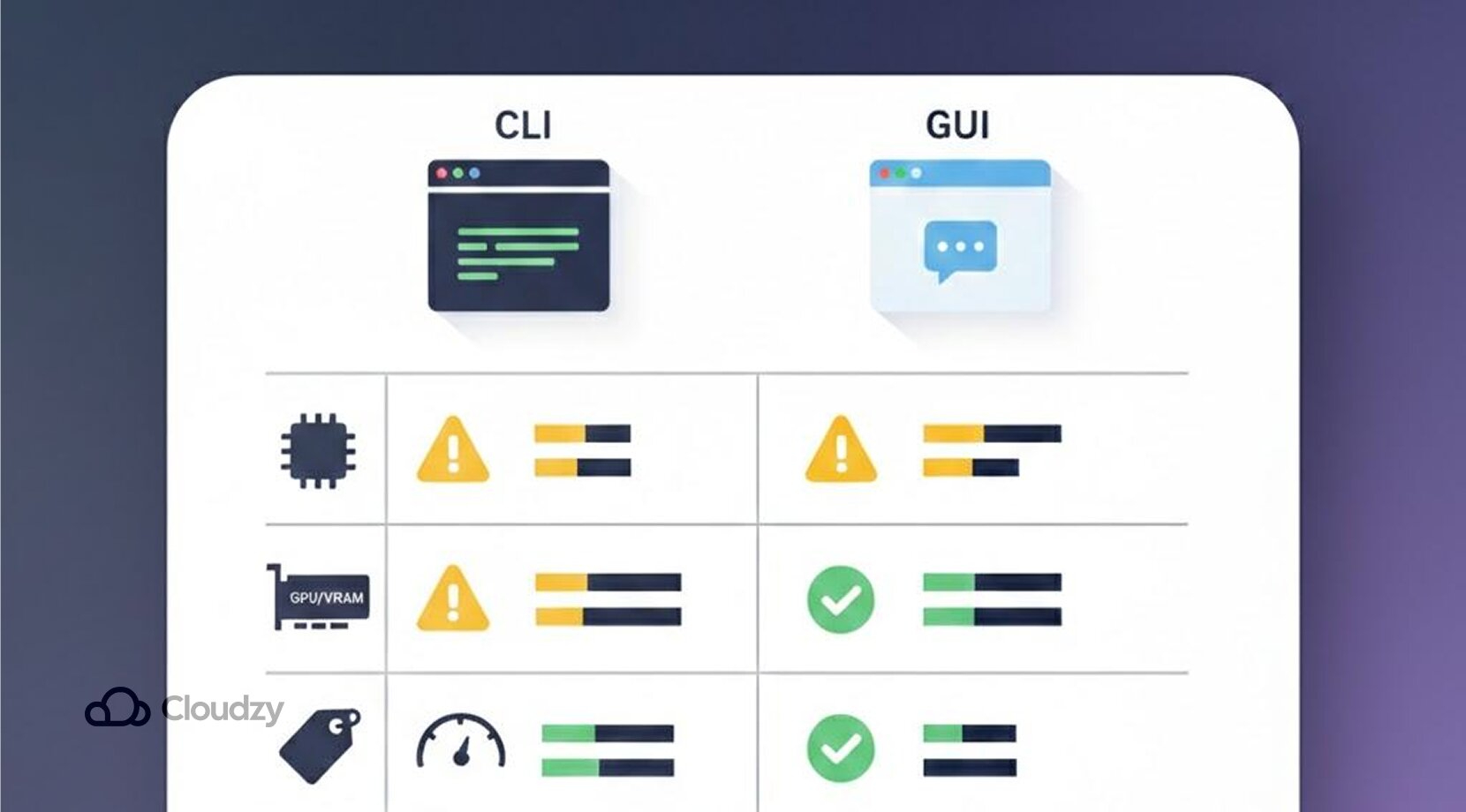

LM Studio sangat berbeda dari Ollama. Alih-alih menjadi antarmuka CLI penuh, LM Studio tidak memerlukan perintah terminal sama sekali. Karena dilengkapi GUI (graphical user interface), tampilannya seperti aplikasi desktop pada umumnya. Bagi sebagian pemula, pilihan antara Ollama vs LM Studio bermuara pada kesederhanaan CLI vs kemudahan GUI.

Pendekatan LM Studio dalam menghilangkan hambatan teknis membuka jalan bagi pengalaman yang lebih sederhana bagi semua pengguna. Daripada menambahkan dan menjalankan model lewat baris perintah, Anda cukup menggunakan menu yang tersedia dan mengetik di kotak percakapan layaknya chat biasa. LM Studio terasa bisa digunakan oleh siapa saja untuk bereksperimen dengan LLM lokal, karena tampilannya tidak jauh berbeda dari ChatGPT.

Platform ini bahkan dilengkapi browser model in-app yang rapi, tempat pengguna bisa menemukan dan menggunakan model apa saja sesuai kebutuhan, mulai dari model ringan untuk penggunaan sehari-hari hingga model berat untuk tugas yang lebih kompleks. Browser ini juga menampilkan deskripsi singkat setiap model beserta rekomendasi penggunaannya, dan memungkinkan pengguna mengunduh model hanya dengan satu klik.

Meski sebagian besar model gratis untuk diunduh, beberapa mungkin memiliki lisensi dan ketentuan penggunaan tambahan. Untuk alur kerja tertentu, LM Studio juga bisa menjalankan mode server lokal untuk integrasi yang mudah, meski pada dasarnya dirancang di sekitar UI desktop yang mudah digunakan bagi pemula. Dengan itu semua, mari kita lihat Ollama dan LM Studio secara berdampingan.

Perbandingan Penting: Ollama vs LM Studio

Sebelum melanjutkan, ada satu hal penting yang perlu digarisbawahi: frasa "Ollama vs LM Studio" mungkin terkesan menyiratkan bahwa salah satunya secara objektif lebih baik, padahal bukan itu ceritanya, karena keduanya memang ditujukan untuk audiens yang berbeda. Berikut ringkasan singkat Ollama vs LM Studio.

| Fitur | Ollama | LM Studio |

| Kemudahan penggunaan | Kurang ramah di awal, memerlukan pengetahuan terminal | Ramah pemula, cukup klik sana-sini dengan mouse |

| Dukungan model | Banyak model open-weight populer, gpt-oss, gemma 3, qwen 3 | Sama seperti Ollama. gpt-oss, gemma3, qwen3 |

| kustomisasi | Sangat fleksibel, mudah diintegrasikan lewat API | Kebebasan terbatas, pengaturan umum hanya bisa diubah lewat toggle/slider |

| Persyaratan Hardware | Tergantung; model yang lebih besar akan lebih lambat jika hardware tidak mencukupi | Sekali lagi, tergantung ukuran model dan spesifikasi hardware Anda |

| Privasi | Privasi terjaga secara default, tanpa API eksternal tambahan | Percakapan tersimpan lokal; namun aplikasi tetap menghubungi server untuk pembaruan dan pencarian/unduhan model. |

| Penggunaan offline | Sepenuhnya mendukung mode offline setelah model diunduh | Juga bisa digunakan offline sepenuhnya setelah model diunduh |

| Platform yang tersedia | Linux, Windows, macOS | Linux, Windows, macOS |

- Model canggih butuh hardware bertenaga: Hampir semua orang ingin menggunakan model yang lebih besar dan lebih mampu jika memungkinkan. Namun menjalankannya di sebagian besar laptop bisa menimbulkan masalah serius, karena model yang lebih besar lebih banyak memakan RAM dan VRAM. Akibatnya, respons bisa jadi lambat, panjang konteks terbatas, atau model tidak mau dimuat sama sekali.

- Masalah baterai: Menjalankan LLM secara lokal bisa menguras baterai dengan cepat saat beban kerja tinggi. Ini berdampak pada umur baterai, belum lagi suara kipas dan heatsink yang bisa cukup mengganggu.

Ollama vs LM Studio: Mengunduh Model

Aspek lain dari perbandingan Ollama vs LM Studio adalah cara keduanya mengunduh model. Seperti disebutkan sebelumnya, Ollama tidak menginstal LLM lokal hanya dengan satu klik. Anda perlu menggunakan terminal dan baris perintah bawaannya untuk melakukan itu. Namun perintah-perintahnya cukup mudah dipahami.

Berikut cara cepat menjalankan model di Ollama.

- Unduh model favorit Anda dengan mengetik ollama pull gpt-oss atau model lain yang Anda inginkan (jangan lupa menyertakan tag, yang bisa Anda pilih dari library).

Contoh: ollama pull gpt-oss:20b - Anda kemudian bisa menjalankan model tersebut dengan perintah ollama run gpt-oss

- Alat coding tambahan juga bisa ditambahkan. Misalnya, Anda bisa menambahkan Claude dengan ollama launch claude

Jika Anda tidak terbiasa dengan terminal dan perintah, coba LM Studio. Anda tidak perlu mengetikkan apa pun ke terminal agar bisa mulai bekerja dan mengunduh model. Cukup buka pengunduh model bawaan dan cari LLM menggunakan kata kunci seperti Llama atau Gemma.

Atau, Anda bisa memasukkan URL Hugging Face lengkap di bilah pencarian.

Ada juga opsi untuk membuka tab discover dari mana saja dengan menekan ⌘ + 2 di Mac, atau Ctrl + 2 di Windows / Linux.

Ollama: Lebih Unggul dalam Hal Kecepatan

Kadang kecepatan adalah satu-satunya hal yang penting bagi pengguna maupun bisnis. Dalam perbandingan Ollama vs LM Studio dari sisi kecepatan, Ollama terbukti lebih cepat, meski hasilnya bisa berbeda tergantung konfigurasi dan spesifikasi hardware yang digunakan.

Dalam sebuah kasus yang dibagikan pengguna Reddit di subreddit r/ollama, Ollama terbukti lebih cepat dibanding LM Studio.

Bukan klaim sembarangan, karena pengguna tersebut menguji keduanya dengan menjalankan qwen2.5:1.5b sebanyak lima kali, lalu menghitung rata-rata token per detik dari masing-masing.

Ollama vs LM Studio: Performa dan Kebutuhan Hardware

Soal performa, perbandingan Ollama vs LM Studio lebih ditentukan oleh hardware daripada antarmuka. Menjalankan LLM secara lokal untuk pertama kalinya adalah pengalaman yang benar-benar berbeda dibanding menggunakan LLM berbasis cloud seperti yang biasa kita pakai. Rasanya menyenangkan punya LLM sendiri, sampai kamu mentok di batas performa.

Mengingat harga RAM dan VRAM yang terus melonjak dalam beberapa tahun terakhir, cukup sulit untuk melengkapi mesin dengan kapasitas yang memadai untuk menjalankan LLM berukuran besar.

Model Populer Cenderung Menghabiskan 24-64GB RAM

Ya, kamu tidak salah baca. Kebutuhan hardware bukan soal siapa yang unggul dalam Ollama vs LM Studio. Jika ingin menjalankan model menengah hingga besar yang populer tanpa gangguan atau kegagalan, pilihan terbaik adalah menyiapkan 24-64GB RAM. Namun dalam banyak kasus, jumlah RAM sebesar itu pun bisa tidak cukup saat konteks semakin panjang dan beban kerja semakin berat.

Kamu bisa menjalankan model yang lebih kecil, yang sering disebut model terkuantisasi, dengan 8-16GB RAM. Namun hasilnya tidak akan setara dengan model yang lebih besar, baik dari sisi fleksibilitas maupun performa, belum lagi ada kompromi pada kualitas dan kecepatan. Sayangnya, RAM bukan satu-satunya kendala; komponen lain juga harus mumpuni.

GPU yang Kuat adalah Kunci agar Pengalaman Tetap Lancar

Meski model bisa berjalan di CPU, unit pemrosesan grafis tetap berperan penting dalam menjalankan model tersebut. Tanpa GPU yang cepat dan VRAM yang cukup besar, kamu akan mengalami generasi token yang lambat satu per satu, jeda panjang untuk respons yang lebih panjang, dan semuanya akan terasa sangat menjengkelkan dalam waktu singkat.

Jangan terlalu berharap, karena bahkan RTX 5070Ti maupun RTX 5080 tidak cukup untuk deep learning yang serius. Pasalnya, pada beberapa konfigurasi dengan konteks 60.000+ token, Ollama sendiri menyebutkan kebutuhan sekitar 23GB VRAM, jauh melebihi 16GB VRAM yang biasanya tersedia di GPU tersebut.

Hardware di atas spesifikasi itu harganya juga selangit. Sekalipun harga bukan masalah bagimu, masih ada beberapa hal lain Opsi GPU yang perlu dipertimbangkan saat menjalankan LLM secara lokal.

Sampai di sini, kamu mungkin mulai bingung bagaimana merakit mesin yang cukup kuat untuk menjalankan model LLM lokal yang lebih besar. Inilah titik balik bagi banyak orang untuk mulai mempertimbangkan solusi lain.

Salah satu pendekatan alternatif yang banyak diminati adalah menggunakan mesin virtual dengan hardware berkapasitas tinggi yang sudah terpasang. Menggunakan VPS (virtual private server), misalnya, adalah cara yang praktis untuk menghubungkan laptop atau perangkat pribadi lainnya ke server privat pilihan kamu, lengkap dengan semua prasyarat yang sudah siap digunakan.

Jika menggunakan VPS terdengar seperti solusi yang tepat, kami sangat merekomendasikan Ollama VPSdari Cloudzy, tempat kamu bisa bekerja di shell yang bersih. Sudah dilengkapi Ollama yang terinstal sejak awal, sehingga kamu bisa langsung bekerja dengan LLM lokal dengan privasi penuh. Harganya terjangkau, tersedia di 12 lokasi, dengan uptime 99,95% dan dukungan 24/7. Sumber daya yang tersedia pun memadai: VCPU dedicated, memori DDR5, penyimpanan NVMe, dan koneksi hingga 40 Gbps.

Ollama vs LM Studio: Siapa Butuh yang Mana

Seperti yang sudah disebutkan, kedua platform ini sama-sama fungsional dan tidak ada yang lebih baik secara mutlak. Tapi ada satu hal yang perlu diingat: masing-masing cocok untuk jenis alur kerja yang berbeda, jadi semuanya tergantung kebutuhanmu.

Pilih Ollama untuk Otomasi dan Pengembangan

Tujuan utama menggunakan Ollama bukan sekadar mengobrol dengan model, melainkan menjadikannya komponen dalam proyek lain. Ollama cocok untuk:

- Pengembang membangun produk seperti chatbot, copilot, dan produk lain yang membutuhkan deep learning

- Alur kerja yang melibatkan banyak otomatisasi, seperti skrip peringkasan laporan atau pembuatan draf terjadwal

- Tim yang membutuhkan versi model yang konsisten di semua environment

- Siapa pun yang menginginkan pendekatan API-first, agar berbagai alat dapat terhubung ke model secara rutin

Intinya, jika Anda ingin model yang bisa diandalkan untuk aplikasi Anda, Ollama bisa jadi pilihan terbaik.

LM Studio adalah Pilihan yang Lebih Mudah untuk Menjalankan LLM Lokal

Jika Anda ingin menjelajahi setup AI lokal tanpa kerumitan teknis, LM Studio jelas merupakan pilihan yang lebih tepat.

Secara umum, LM Studio lebih cocok untuk:

- Pemula yang tidak terbiasa dengan terminal dan command line

- Penulis, kreator, atau pelajar yang hanya butuh antarmuka chat sederhana untuk bantuan berbasis AI

- Orang yang suka mencoba berbagai pilihan, dan ingin membandingkan berbagai model dengan cepat untuk menemukan yang paling sesuai

- Siapa pun yang baru mulai belajar membuat prompt dan ingin mengatur konfigurasi tanpa harus mengetik perintah

Singkatnya, jika Anda ingin langsung mengunduh dan mencoba LLM lokal, LM Studio siap memenuhi kebutuhan Anda.

Ollama vs LM Studio: Rekomendasi Akhir

Jika Anda mengesampingkan perdebatan soal persaingan antara Ollama dan LM Studio, yang benar-benar penting adalah pengalaman sehari-hari Anda, berdasarkan alur kerja dan keterbatasan hardware yang Anda miliki.

Ollama secara umum adalah:

- Fleksibel dan berorientasi pada developer

Sementara LM Studio adalah:

- Tersedia untuk pemula dengan GUI khusus

Keduanya membutuhkan hardware yang berat dan mahal agar berjalan lancar. Banyak orang tidak punya kemewahan menjalankan LLM lokal berukuran besar sepenuhnya sendiri. Oleh karena itu, jika Anda ingin menjalankan model canggih tanpa membebani hardware Anda, pertimbangkan untuk mencoba Ollama di sebuah VPS GPU DedicatedDi bawah ini adalah beberapa pertanyaan umum tentang Ollama vs LM Studio.