如果你正在决定 H100 对比 RTX 4090 对于 AI,请记住大多数"基准测试"在你的模型和缓存实际装入内存之前都没有意义。对于保持在 24 GB 以内的单 GPU 工作,那是最佳选择。

当你需要支持更大的模型、更高的并发、多用户隔离或减少内存管理的麻烦时,H100 就是你的选择。

我按工作负载类型来拆解,展示不同的基准测试,然后给你一个快速测试方案,你可以在自己的基础设施上运行。

快速对比:H100 vs RTX 4090 在AI工作负载中的表现

H100 在大模型训练和生产部署中表现出众,因为它提供了大容量 HBM、极高的内存带宽、NVLink 以及用于隔离的 MIG。 RTX 4090 如果你的工作负载能在 24 GB 内运行,不需要经常做权衡取舍,那么这个方案就很适合「我需要出色的单核性能,但希望价格更实惠」这类需求。规格和平台功能让选择变得很明确。

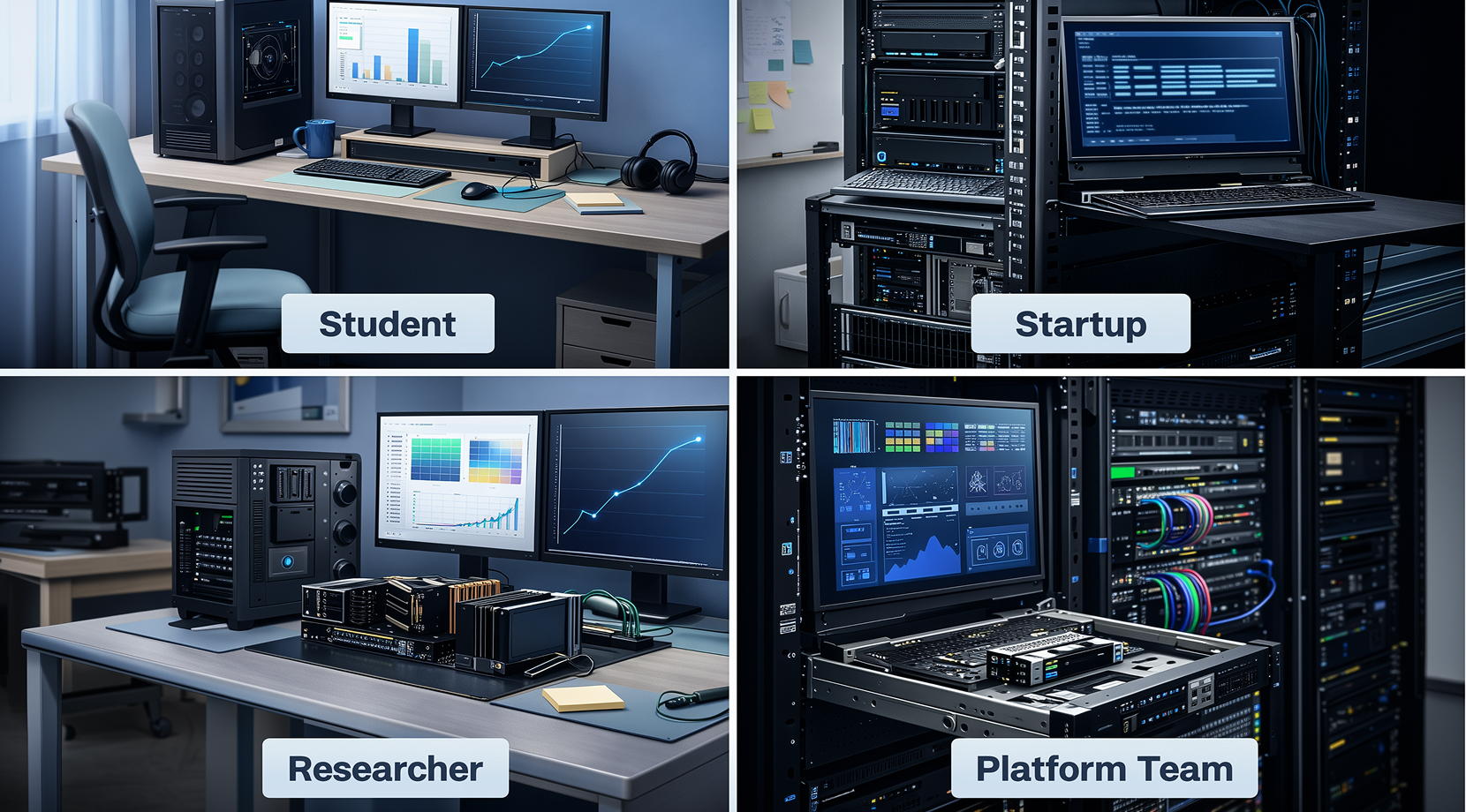

按用户类型快速查看:

- 本地 LLM 开发者方案(独立开发者 / 学生): RTX 4090 直到 VRAM 成为瓶颈。

- 初创公司 ML 工程师(发布 MVP): 初期阶段的模型部署和微调使用 RTX 4090,需要稳定的并发处理或运行更大模型时升级到 H100。

- 应用研究员(大量实验工作): H100 如果你遇到内存溢出、批处理限制或长上下文问题。

- 生产环境 / 平台团队(多租户服务): H100 用于 MIG 切片,提供更高的余量空间和更平稳的扩展。

基于这个视角,下面的内容讨论的是开发者在实际使用中遇到的限制,以及基准测试数据与这些限制的对应关系。

唯一值得考虑的基准问题:什么必须能装进 VRAM?

大多数讨论涉及 H100 对比 RTX 4090 在技术上是 VRAM 参数。在 LLM 工作中,VRAM 会被 权重, 激活 训练期间 优化器状态 在训练中,以及 KV缓存 在推理过程中。最后这一点往往出乎人们的意料,因为它会随着上下文长度和并发数增加而增长。

下面的表格故意保持高层次概览,因为具体适配情况取决于框架、精度和开销。

这是"能否顺利装下"的视图:

| 工作量 | RTX 4090 上的典型单 GPU 实际性能(24 GB) | GPU 上的典型单卡配置与 H100 上的实际情况(80–94 GB) |

| 7B LLM 推理 (FP16 / BF16) | 通常没问题 | 舒适的余量 |

| 13B LLM推理 | 通常很紧张,具体取决于使用场景 | 通常没问题 |

| 70B级推理 | 需要大量量化/卸载处理 | 更贴近真实 |

| SD/SDXL 推理 + 小批量 | 通常没问题 | 性能不错,而且批处理空间更充足 |

| 处理更高的并发请求 | KV 缓存压力立即显示 | 更多资源,高负载下更稳定 |

如果你想要更全面的 GPU 选项列表(不仅仅是这两个),可以查看我们的 2025 年最适合机器学习的 GPU 是一份实用的参考表,涵盖 VRAM 和常见 AI GPU 的内存带宽。

确定工作负载能跑起来后,决定体验流畅度的下一个因素就是内存带宽。

带宽:为什么 HBM 与众不同

很多 AI 性能讨论都聚焦于计算峰值,但 Transformer 对内存移动极为敏感。H100 的优势在于它将大容量 HBM 与极高内存带宽相结合,同时在平台层面提供 NVLink 带宽和 MIG 分区功能。

规格概览

规格表不会帮你选择 GPU,但它们解释了为什么同样的工作负载在一块卡上轻松运行,在另一块卡上却显得捉襟见肘。这个快照展示了什么因素最直接影响 LLM 的训练、推理和服务性能。

| 规格 | H100 (SXM / NVL) | RTX 4090 |

| VRAM | 80 GB / 94 GB | 24 GB |

| 内存带宽 | 3.35–3.9 TB/s | GDDR6X (容量限制为 24 GB) |

| 互联互通 | NVLink + PCIe Gen5 | PCIe(消费者平台) |

| 多实例 | 最多 7 个 MIG 实例 | 不适用 |

规格参考 NVIDIA H100, NVIDIA RTX 4090.

实际上这意味着:

- 如果你需要增加批处理大小或上下文长度,H100 能在更长时间内保持稳定,让你延后做出权衡取舍。

- 如果你需要同时处理大量请求,H100 拥有更充足的内存空间,能够避免尾部延迟问题过早出现。

- 如果你的工作主要是单用户、单模型、中等上下文规模,RTX 4090 通常感觉够快、够爽。

不过,带宽并不能替代严谨的基准测试。它只是解释了为什么两个 GPU 在狭隘的测试中看起来接近,却在实际负载下表现分化。

可靠的 H100 对比 RTX 4090 基准测试

基准测试存在差异,这就是为什么「我的数据和你的不一样」总是会发生。因为 H100 对比 RTX 4090,最好的方法是将基准测试分为两个部分:

- A 通道(社区氛围): llama.cpp-style tokens/sec tests and simple inference scripts.

- B 号线(标准套房): MLPerf Training 和 MLPerf Inference 风格的测试结果,采用可重复的标准化规则。

Llama.cpp 风格推理快照

这是那种人们在家里运行、然后争论三天的测试。它很有用,因为它反映了很多开发者实际使用的工具链,但如果忽视拟合度和精确度,也容易被误读。

公开的 llama.cpp 风格对比 RTX 4090 在小型模型和量化运行上表现出色,而大型模型在更高精度下的性能远超 VRAM 的上限。

以下是你应该期待的模式:

| 模型 | GPU | 典型结果 |

| 7B级 | RTX 4090 | 高吞吐量、流畅的单用户推理 |

| 13B级 | RTX 4090 | 还不错,但这时候上下文和开销就开始重要了 |

| 70B级 | RTX 4090 | 如果不用激进的量化或卸载方式,就装不下 |

| 70B级 | H100 | 在本地运行,可靠地服务用户 |

这个对比表的重点不是说「4090 不行」或「H100 有魔法」。关键是 VRAM 的上限决定了你能保留多少常驻数据,而这会直接影响速度、稳定性和你需要调整的工作量。

如果你不断地削减上下文长度才能勉强保持运行,那就说明这个对比已经超越理论了。

MLPerf 相比论坛基准测试的优势

MLPerf 存在的原因很简单:当你要投入几千美元时,"随意写脚本,靠感觉"是行不通的。MLCommons 已经添加了 新一代生成式AI风格的工作负载 随着时间推移,MLPerf 的设计目的是让不同系统之间的结果更具可比性。

在训练方面, NVIDIA MLPerf Training v5.1 技术报告 很好地示范了供应商如何报告培训时间,包括提交环境和所遵循的基准规则的详细信息。

这条测试路径不会告诉你私有提示词的行为方式,但它能验证系统级扩展是否正常,以及这类硬件在约束条件下的性能表现。

现在我们来聊最影响购买决策的两个因素:完成工作需要花费的时间和成本。

成本、时间和机会成本

很多 H100 对比 RTX 4090 决策往往被框定为"购买价格 vs 租赁价格"。这很少是正确的框架。更好的框架是:生成一个你实际能用的模型需要多少小时,你在应对限制上浪费了多少时间?

三个常见场景清楚地说明了各自的权衡之处。

每周微调中小型模型

如果你的任务在 24 GB 内完成,不用频繁妥协,RTX 4090 是个不错的选择。你能快速迭代,不需要排队等待集群资源,配置也很简单。但如果每次运行都得「降低批次、缩减上下文、重试」,那么 H100 会更合理,尽管成本更高。

真正的并发处理能力

并发会快速增加 KV 缓存压力。H100 的充足性能和平台控制在这里就体现出价值,特别是当你需要可预测的延迟时。

如果你还在评估 GPU 服务器是否适合你的部署需求,我们的 GPU VPS 对比 CPU VPS 成本分解能帮助你在优化之前,先把工作负载映射到合适的基础设施类型,避免白费力气优化错误的东西。

更大规模的训练任务,按时交付

一旦团队规模和基础设施超出个人单机的范围,你会希望专注于那些看似乏味但至关重要的事情:稳定的运行环境、更少的故障模式、以及减少花在维护和监控上的时间。这正是 H100 的设计初衷。

如果看到这里你还拿不准,下一步不是继续读文章。试试在实际环境中跑一遍你的技术栈,看看驱动程序的兼容性和多用户负载下的表现。

软件与运维:驱动程序、稳定性、多用户支持与技术支持

这是大多数性能对比图表都会忽略的部分,但它占据了日常工作的很大一块。

RTX 4090 之所以受欢迎,是因为它对很多 AI 工作流来说既易用又快速。代价是当你的应用规模增长后,你更容易遇到内存上限和共享多租户环境不支持的扩展模式的瓶颈。

专为集群设计。MIG 对平台团队来说是一个大功能,因为它让你可以将一个 GPU 分割成隔离的切片,这减少了"嘈杂邻居"问题,使容量规划变得容易得多。NVIDIA 的官方规格列表显示,根据形状因素,最多可以有 7 个 MIG 实例。

如果你的工作负载是个人本地使用,4090 可以满足你很长时间的需求。如果你需要支持多用户和客户应用,H100 是更稳妥的选择。

那么,总的来说,谁应该买什么?

如何为你的工作负载选择合适的方案

对于 H100 对比 RTX 4090,最终的正确选择是能解决你最大困难的那个。

Local LLM Developer (Solo Dev / Student)

如果你主要在 7B-13B 范围内工作,运行量化推理、试验 RAG,或使用 SDXL,选择 RTX 4090。当你花在处理内存问题上的时间超过实际开发时间时,再升级配置。

初创公司机器学习工程师(发布MVP产品)

如果你的 MVP 是单个模型、流量中等、资源充足,RTX 4090 是个不错的起点。如果需要在流量突增时保持稳定延迟、支持更高并发或在同一主机上运行多个工作负载,H100 是更稳妥的选择。

应用研究员(大量实验工作)

如果你经常被迫做出妥协,比如减小批次大小或调整精度参数,H100 能帮你进行更干净的实验,减少失败的运行。

生产/平台团队(多租户服务)

选择 H100 就对了,主要原因是 MIG 和更充足的资源余量让容量规划更轻松,也能有效降低流量突增时的影响范围。

如果还不想投入硬件成本,租用服务器是更好的选择。

务实之选:先租赁 GPU,再决定长期承诺

最简洁的解决方案 H100 对比 RTX 4090 是运行 你的 模型, 你的 提示,和 你的 在两类硬件上测试上下文长度,然后比较负载下的吞吐量(tokens/秒)和尾部延迟。

这正是我们开发 Cloudzy GPU VPS,因为你可以在一分钟内启动一台 GPU 服务器,用 root 权限安装你的整个技术栈,而不必再去猜测别人跑出来的基准测试结果。

在我们的 GPU VPS 套餐中,您将获得以下内容:

- 专属 NVIDIA GPUs (包括 RTX 4090 和 A100 级选项),确保你的性能不会因为邻近用户而波动。

- 最高 40 Gbps 网络 在所有 GPU 套餐上都包含,这对数据集拉取、多节点工作流和快速传输工件至关重要。

- NVMe SSD 存储,加上 DDR5 RAM 以及所有层级上的高频 CPU 选项,确保 GPU 不会因为其他组件而受到拖累。

- DDoS 防护 和一个 99.95% 正常运行时间,这样长时间的任务就不会被随机的网络问题破坏。

- 按小时计费 (适合短期基准测试),以及 14 天无理由退款保障 用于低风险测试。

先在 RTX 4090 计划上运行相同的基准检查清单,然后在处理更大的上下文、更高并发或更大模型时,在 A100 级别的计划上重复测试。之后,在以下之间选择 H100 对比 RTX 4090 通常从你自己的日志中就能看出来。

基准检查清单:30 分钟内自测

如果你想要一个能够辩护的决定,从你计划部署的确切堆栈中采集四个数字:

- 令牌/秒 在你的目标上下文长度下

- p95延迟 在你的预期并发数下

- 显存余量 在最高负载阶段

- 每次完成运行的成本 从开始到产出

用 vLLM 进行最小化冒烟测试看起来像这样:

pip install vllm transformers accelerate

python -m vllm.entrypoints.api_server \

--model meta-llama/Llama-3-8B-Instruct \

--dtype float16 \

--max-model-len 8192如果你想清楚地了解你真正租用的是什么,我们的文章 什么是 GPU VPS? 详细说明了专用 GPU 访问、vGPU 共享之间的区别,以及选择计划前需要检查的内容。