机器学习及其分支深度学习需要大量的计算能力,只有 GPU 才能提供这种能力。但不是任何 GPU 都能胜任,所以这里列出了最适合机器学习的 GPU、它们为什么必要,以及如何为你的项目选择合适的型号。

为什么我需要 GPU 来进行机器学习?

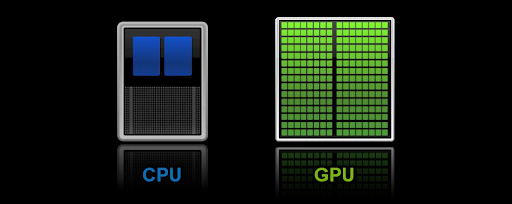

如前所述,机器学习需要大量的计算能力,只有 GPU 才能提供。虽然 CPU 对于小规模应用来说表现不错,但对于任何超出单线程任务或通用计算的工作,它们只会导致性能瓶颈和延迟。它们在计算能力上的巨大差异归结为 GPU 的并行处理能力以及核心数量的巨大差异。典型的 CPU 可能有 4 到 16 个核心,而最好的机器学习 GPU 可能有数千个核心,尤其是张量核心,每个核心都能同时处理一小部分计算。

这种并行处理能力是处理矩阵和线性代数运算的关键,这就是为什么 GPU 在训练大型机器学习模型等任务上远优于 CPU 的原因。不过,选择最佳的机器学习 GPU 并不容易。

如何为人工智能和深度学习选择最佳 GPU

现在,大多数 GPU 都足以应付典型任务。但机器学习和深度学习需要更高的计算能力和性能指标。那么问题就来了:什么样的 GPU 才算是深度学习的好选择呢?

用于深度学习的优质 GPU 应该具备以下品质和特性:

CUDA 核心、张量核心和兼容性

AMD 和 Nvidia 提供最适合机器学习和深度学习的 GPU,其中后者表现更为突出。这要归功于 Nvidia 的张量核心和 CUDA 核心。张量核心处理人工智能和机器学习中的常见计算,如矩阵乘法和卷积(用于深度神经网络)。另一方面,CUDA 核心使最适合人工智能训练的 GPU 能够通过在 GPU 上高效分配操作来执行并行处理。没有这两个特性的 GPU 通常在机器学习和深度学习工作负载上会遇到困难。

也就是说,AMD 最近对 ROCm 平台和 MI 系列加速器的升级改进了其 GPU,你会在我们的列表中看到它们。但由于 Nvidia 的 GPU 拥有优化良好的软件生态和广泛的框架支持(例如 TensorFlow、PyTorch、JAX),它们仍然是深度学习的最佳 GPU。最适合机器学习的 GPU 应该与这些机器学习框架有高度的兼容性,因为不匹配会导致加速效率低下、驱动程序和库支持不足(例如 NVIDIA 的 cuDNN 和 TensorRT),以及整体可扩展性问题。

你也可能无法完全访问 NVIDIA CUDA 工具包提供的工具,例如 GPU 加速库、C 和 C++ 编译器和运行时,以及优化和调试工具。

VRAM(视频 RAM)、显存标准和显存带宽

和任何与计算机相关的事务一样,GPU 很重要,选择最好的 GPU 用于机器学习和深度学习也是如此。由于训练机器学习模型的数据集可能变得极其庞大(深度学习可达多个 TB),最好的机器学习 GPU 应该具有充足的显存以供快速访问。这是因为深度学习模型需要大量内存来存储权重、激活函数和训练及推理过程中的其他中间数据。用于 AI 训练的最好 GPU 还应具有足够的内存带宽,以便能够处理这些大型数据集并加快计算速度。

最后,内存标准是选择最好的深度学习 GPU 时的重要因素。GPU 通常采用 GDDR(图形双倍数据速率)或 HBM(高带宽内存)。虽然 GDDR 内存为机器学习和游戏等应用提供高带宽,但最好的机器学习 GPU 采用 HBM,具有更高的带宽和更好的效率。

| GPU 类型 | VRAM 容量 | 内存带宽 | 内存标准 | 最适合用于 |

| 入门级(如 RTX 3060、RTX 4060) | 8GB – 12GB | ~200-300 GB/s | GDDR6 | 小型模型、图像分类、业余项目 |

| 中端(如 RTX 3090、RTX 4090) | 24GB | ~1,000 GB/秒 | GDDR6X | 大型数据集、深度神经网络、Transformer 模型 |

| 高端 AI GPU(如 H100、H200、L40S、A100、MI300X) | 40GB – 80GB | ~1,600+ GB/s | HBM2 | 大型语言模型(LLM)、AI 研究、企业级机器学习 |

| 超高端 GPU(如 H100、L40S、A100、Instinct MI300X) | 80GB – 256GB | ~2,000+ GB/秒 | HBM3 | 大规模 AI 训练、超级计算、海量数据集研究 |

对于专门从事 大型语言模型(如 ChatGPT),Cloudzy 提供 ChatGPT 优化 GPU 配置 解决方案,具备流畅微调和推理所需的性能。

TFLOPS(万亿次浮点运算)和浮点精度

当然,GPU 性能由其计算能力衡量。这取决于三个因素:TFLOPS、内存带宽和浮点精度。我们已经讨论过用于 AI 训练的最好 GPU 的内存带宽;以下是另外两个因素各代表什么以及其重要性。TFLOPS(万亿次浮点运算)是衡量 GPU 处理复杂计算速度的单位。因此,与其衡量处理器的时钟速度(处理器每秒完成的周期数)不同,TFLOPS 衡量的是 GPU 每秒能执行多少万亿次浮点运算。简单来说,TFLOPS 告诉你 GPU 在处理数学密集型任务时的强大程度。

然而,浮点精度顾名思义,显示的是 GPU 在模型运行中能保持的准确度水平。最好的深度学习 GPU 使用更高的精度(如 FP32),能提供更精确的计算,但性能成本较高。较低的精度(如 FP16)能加快处理速度,精度略有降低,这通常对 AI 和深度学习任务而言可以接受。

开始博客

开始博客

在一流硬件上自托管 WordPress,采用 NVMe 存储和全球最低延迟,选择你喜欢的发行版。

获取 WordPress VPS| 精度 | 用例 | 示例应用 |

| FP32(单精度) | 深度学习模型训练 | 图像识别(ResNet、VGG) |

| TF32 (TensorFloat-32) | 混合精度训练 | 自然语言处理、推荐系统 |

| FP16 (半精度) | 快速推理 | 自动驾驶、语音识别、AI 视频增强 |

与其投入大量资金购置物理硬件,不如即时访问 Cloudzy 的深度学习 GPU 配置,由 RTX 4090 驱动,针对机器学习和深度学习工作负载优化。

2025 年最适合机器学习的 GPU

现在你已经了解了机器学习所需的最佳GPU应具备的特性,下面是我们根据性能、显存带宽、显存容量等因素排名的最佳GPU列表。

| GPU | VRAM | 内存带宽 | 内存标准 | TFLOPS | 浮点精度 | 兼容性 |

| NVIDIA H100 NVL | 188 GB | 7.8 TB/s | HBM3 | 3,958 | FP64, FP32, FP16 | CUDA,TensorFlow |

| NVIDIA A100 张量核心 | 80 GB | 2 TB/s | HBM2 | 1,979 | FP64, FP32, FP16 | CUDA、TensorFlow、PyTorch |

| NVIDIA RTX 4090 | 24 GB | 1.008 TB/s | GDDR6X | 82.6 | FP32, FP16 | CUDA,TensorFlow |

| NVIDIA RTX A6000 张量核心 | 48 GB | 768 GB/s | GDDR6 | 40 | FP64, FP32, FP16 | CUDA、TensorFlow、PyTorch |

| NVIDIA GeForce RTX 4070 | 12 GB | 504 GB/s | GDDR6X | 35.6 | FP32, FP16 | CUDA,TensorFlow |

| NVIDIA RTX 3090 Ti | 24 GB | 1.008 TB/s | GDDR6X | 40 | FP64, FP32, FP16 | CUDA、TensorFlow、PyTorch |

| AMD Radeon Instinct MI300 | 128 GB | 1.6 TB/s | HBM3 | 60 | FP64, FP32, FP16 | ROCm、TensorFlow |

NVIDIA H100 NVL

最佳机器学习GPU——H100 NVL,为大规模深度学习提供卓越性能,针对多租户高性能工作负载进行了优化。

- 最适合: 前沿AI研究、大规模模型训练和推理。

- 缺点: 价格极高,主要适用于企业级或研究环境。

NVIDIA A100 张量核心 GPU

A100为神经网络提供强大性能,配备80 GB高带宽显存(HBM2),适合处理繁重工作负载。

- 最适合: 大规模机器学习模型、AI研究和云应用。

- 缺点: 价格昂贵,主要面向企业用户。

NVIDIA RTX 4090

既适合游戏也适合AI工作负载,配备24 GB GDDR6X显存和强大的并行计算能力。

- 最适合: 需要极强计算能力的高端机器学习任务和AI研究。

- 缺点: 功耗高、成本高、体积大。

NVIDIA RTX A6000 张量核心 GPU

支持AI应用,配备48 GB GDDR6显存,非常适合工作站和专业创意人士使用。

- 最适合: AI研究、深度学习和高性能工作负载。

- 缺点: 成本高,通常适用于专业环境。

NVIDIA GeForce RTX 4070

Go在价格和性能之间取得良好平衡,具备强大的光线追踪能力,配备12 GB GDDR6X显存。

- 最适合: 爱好者和具有中等规模机器学习需求的小型企业。

- 缺点: 显存容量有限,不适合处理超大数据集和大型模型。

NVIDIA RTX 3090 Ti

NVIDIA RTX 3090 Ti – 24 GB GDDR6X 显存和强大的计算能力,适合训练中等到大规模的模型。

- 最适合: 需要强大 AI 处理能力的爱好者和研究应用。

- 缺点: 成本高、功耗大,对小项目来说往往过度配置。

AMD Radeon Instinct MI300

非常适合 AI 和 HPC 工作负载,性能具有竞争力。

- 最适合: 在 AMD 为中心的配置上运行机器学习工作负载。

- 缺点: 在深度学习领域的积累不如 NVIDIA,支持的框架也较少。

Cloudzy 的云 GPU VPS

当今最好的机器学习 GPU 无疑是 RTX 4090;但它价格昂贵,会增加你的电费开支,体积也可能迫使你升级机箱或改动其他硬件。这很麻烦,这就是为什么 Cloudzy 现在提供在线 GPU 用于机器学习,让你无需担心这些问题。我们的 GPU VPS 配备最多 2 个 Nvidia RTX 4090 GPU、4 TB NVMe SSD 存储、25 TB/秒带宽和 48 个 vCPU!

价格实惠,支持按小时或按月计费,灵活按需付费。我们接受 PayPal、支付宝、信用卡(Stripe)、PerfectMoney、比特币和其他加密货币。

最后,即使最坏的情况出现,如果你对我们的服务不满意,我们提供 14 天退款保证!

增强现实 (AR) 云平台在很大程度上依赖 高性能 GPUs 以提供实时、沉浸式体验。正如配备 CUDA 和 Tensor 核心的 GPU 对深度学习模型训练至关重要一样,它们对渲染复杂的 AR 环境和支持物体识别、空间映射等 AI 功能同样重要。在 Cloudzy,我们的 AR Cloud 使用 GPU 技术实现低延迟、高性能的部署。非常适合需要大规模运行 AR 应用的团队。

无论你是在开发 AI 应用、训练模型,还是进行研究,我们的 AI VPS 解决方案 旨在以远低于常规的成本提供最佳的 GPU 性能。

最后的想法

随着计算需求的增加和 AI 模型变得越来越复杂,GPUs 必然会成为我们生活的重要组成部分。因此,最好了解一下它们的工作原理和用途。

所以我强烈建议你看看 蒂姆·德特默斯关于 GPU 的全面指南,包括选择时的实用建议。他在深度学习领域既有学术成就,也有丰富的实战经验。