如果你决定 H100 与 RTX 4090 对于 AI,请记住,在模型和缓存真正适合 VRAM 之前,大多数“基准”并不重要。 RTX 4090 是 24 GB 以内的单 GPU 工作的最佳选择。

当您需要更大的模型、更高的并发性、多用户隔离或更少的内存练习时间时,H100 就是您的选择。

我将按工作负载进行细分,显示基准测试类型,然后为您提供一个可以在您自己的堆栈上运行的快速测试计划。

快速解答:针对 AI 工作负载的 H100 与 RTX 4090

H100 在大模型训练和认真服务方面获胜,因为它带来了大型 HBM 池、非常高的内存带宽、NVLink 和用于隔离的 MIG。 RTX 4090 更适合“我需要以更优惠的价格获得出色的单 GPU 速度”,只要您的工作负载适合 24 GB,且无需不断妥协。规格和平台功能使这变得非常简单。

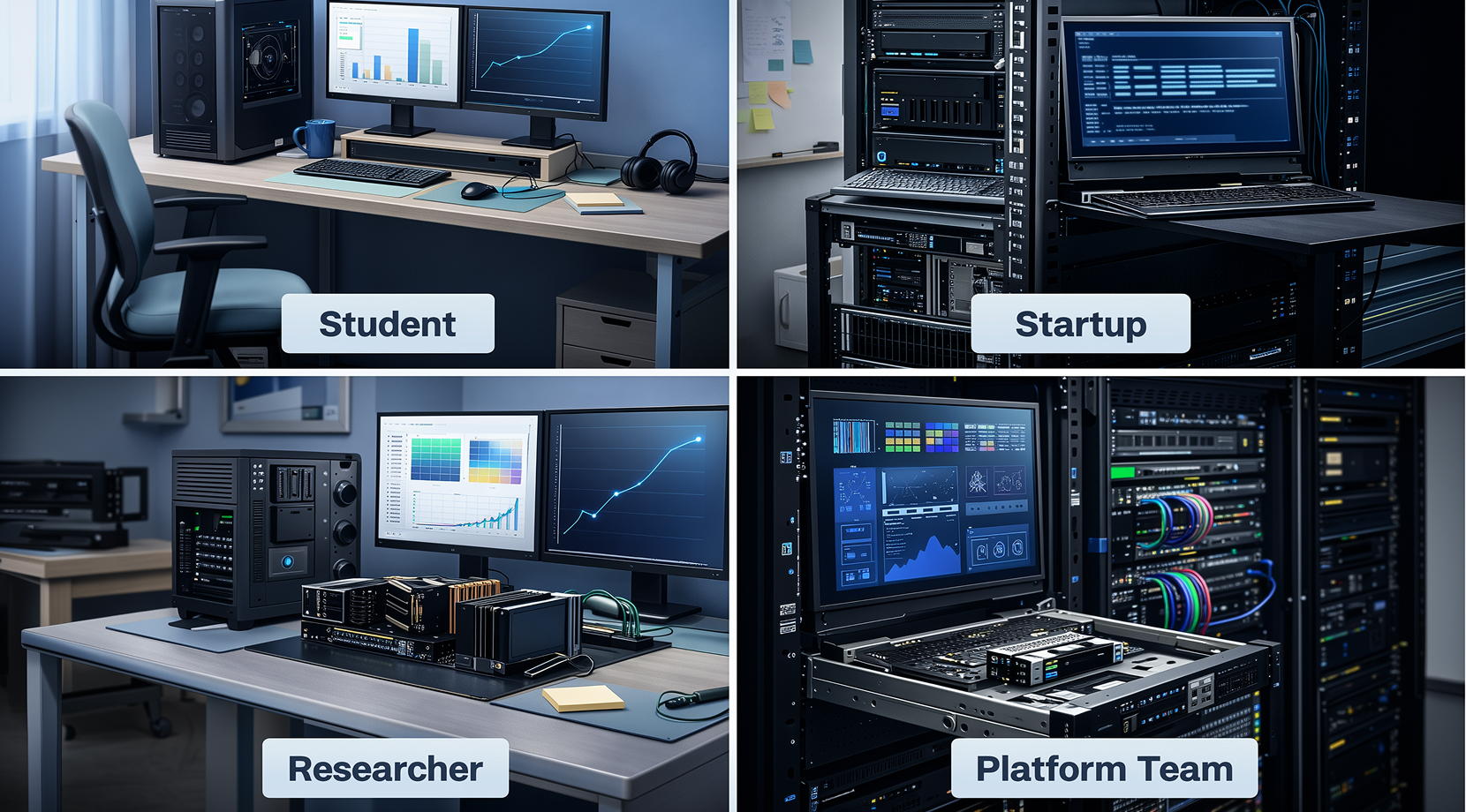

以下是按角色划分的快速选择列表:

- 本地法学硕士构建者(独立开发者/学生): RTX 4090 直到 VRAM 成为瓶颈。

- 初创公司 ML 工程师(交付 MVP): RTX 4090 用于早期服务和微调,当您需要稳定的并发或更大的模型时,H100。

- 应用研究员(大量实验): 如果您不断遇到 OOM、批次上限或长上下文,则 H100。

- 生产/平台团队(多租户服务): H100 用于 MIG 切片、更高的净空和更平滑的缩放。

在这个框架下,本文的其余部分将讨论人们在现实生活中遇到的限制,以及基准数字如何与这些限制相一致。

唯一需要考虑的基准问题:VRAM 必须适合什么?

大多数主题是关于 H100 与 RTX 4090 从技术上讲是 VRAM 参数。在 LLM 工作中,VRAM 被 重量, 激活 在训练期间, 优化器状态 在训练中,以及 KV缓存 推理过程中。最后一项是人们并不真正期望的,因为它随着上下文长度和并发性而增长。

下表特意设置为高级表,因为确切的配合取决于框架、精度和开销。

这是“如果没有戏剧性的话,它是否合适?”看法:

| 工作量 | RTX 4090 (24 GB) 上的典型单 GPU 现实 | H100 (80–94 GB) 上的典型单 GPU 现实 |

| 7B LLM推理(FP16 / BF16) | 通常很好 | 舒适的头部空间 |

| 13B LLM推理 | 通常很紧,取决于上下文 | 通常很好 |

| 70B级推理 | 需要大量量化/卸载 | 更现实 |

| SD/SDXL推理+小批量 | 通常很好 | 很好,加上更多的批次空间 |

| 更高并发服务 | KV缓存压力显示快 | 更多空间,负载下更稳定 |

如果您想要更广泛的 GPU 候选名单(不仅仅是这两个),我们对 2025 年最适合机器学习的 GPU 是常见 AI GPU 的 VRAM 和内存带宽的便捷参考表。

一旦您知道您的工作负载适合,下一个决定它感觉如何“流畅”的是内存带宽。

带宽:为什么 HBM 感觉不同

许多人工智能性能讨论都集中在计算峰值上,但 Transformer 对内存移动极其敏感。 H100 的优势在于,它将大型 HBM 池与非常高的内存带宽配对,再加上平台端的 NVLink 带宽和 MIG 分区。

规格快照

规格不会为您选择 GPU,但它们解释了为什么相同的工作负载在一张卡上感觉很轻松,而在另一张卡上却很拥挤。此快照显示了对 LLM 训练、推理和服务行为影响最大的因素。

| 规格 | H100(SXM/NVL) | RTX 4090 |

| 显存 | 80 GB / 94 GB | 24 GB |

| 内存带宽 | 3.35–3.9 TB/秒 | GDDR6X(容量限制为 24 GB) |

| 互连 | NVLink + PCIe Gen5 | PCIe(消费级平台) |

| 多实例 | 最多 7 个 MIG 实例 | 不适用 |

规格参考: 英伟达 H100, NVIDIA RTX 4090.

这在实践中意味着什么:

- 如果您尝试提高批量大小或上下文长度,H100 往往会在您陷入权衡之前保持稳定更长时间。

- 如果您同时处理多个请求,H100 拥有更多的“内存呼吸空间”,因此您不会很快出现不确定的尾部延迟。

- 如果您的工作主要是单用户、单模型、适度的环境,那么 4090 通常会让人感觉快速且令人满意。

不过,带宽并不能取代良好的基准测试。它只是解释了为什么两个 GPU 在狭窄的测试中看起来很接近,但在实际负载下却相差甚远。

可靠的 H100 与 RTX 4090 基准测试

基准并不完全相同,这就是为什么“我的数据与你的数据不符”的情况经常发生。为了 H100 与 RTX 4090,它有助于将基准分为两个通道:

- A巷(社区氛围): llama.cpp-style tokens/sec tests and simple inference scripts.

- B巷(标准化套房): MLPerf Training 和 MLPerf Inference 风格的结果,重点关注可重复的规则。

Llama.cpp 式推理快照

这是人们在家进行的测试,然后争论三天。它很有用,因为它反映了许多构建者使用的“真实工具链”,但如果您忽略适合度和精度,它也很容易被误读。

公共 llama.cpp 风格的比较 显示 RTX 4090 在较小模型和量化运行上表现出色,而在更高精度的大型模型上则突破了 VRAM 上限。

这是您应该期望的模式:

| 模型 | 图形处理器 | 典型结果 |

| 7B级 | RTX 4090 | 高代币/秒,单用户推理流畅 |

| 13B级 | RTX 4090 | 仍然不错,但是上下文和开销开始变得重要 |

| 70B级 | RTX 4090 | 如果没有积极的量化/卸载,就无法完全适应 |

| 70B级 | H100 | 更现实地保留居民并可靠地提供服务 |

这张表的重点不是“4090 糟糕”或“H100 魔法”。 VRAM 上限决定了您可以保留多少内存,这会影响速度、稳定性以及您要做的修改量。

如果你为了生存而不断削减上下文长度,那么这种比较就不再是理论上的了。

MLPerf 添加了哪些论坛基准没有添加的内容

MLPerf 的存在是因为一旦你做出了数千美元的决定,“随机脚本和氛围”就不再起作用。 MLCommons 已添加 新一代人工智能风格的工作负载 随着时间的推移,MLPerf 旨在使结果在系统之间更具可比性。

在训练方面, NVIDIA 的 MLPerf Training v5.1 文章 是一个很好的例子,说明供应商如何报告训练时间以及提交环境和他们遵循的基准规则的详细信息。

该通道不会告诉您私人提示的行为方式,但它是对系统级扩展以及“此类硬件在规则下如何执行”的健全性检查。

现在我们来谈谈对购买影响最大的部分,即完成工作所花费的时间和金钱。

成本、时间和机会成本

很多 H100 与 RTX 4090 决策被框架为“购买价格与租赁价格”。这很少是正确的框架。一个更好的框架是你需要多少小时来制作一个你可以实际使用的模型,以及你花多少时间来对抗约束?

三种常见场景非常清楚地显示了权衡。

中小型型号每周微调

如果您的运行保持在 24 GB 以内且没有不断的妥协,那么 4090 路径感觉很棒。您可以快速迭代,无需安排集群时间,而且设置也很简单。如果每次运行都变成“降低批次、切断上下文、重试”,那么 H100 是一个更明智的想法,尽管成本更高。

真正的并发服务

并发性快速推动KV缓存压力。这就是 H100 的空间和平台控制带来回报的地方,特别是如果您需要可预测的延迟。

如果您仍在决定 GPU 服务器是否适合您的部署或是否适合您的部署,我们的 GPU VPS 与 CPU VPS 在您花时间优化错误的事情之前,分解是一种将工作负载映射到基础设施类型的有用方法。

有期限的更大的培训工作

一旦你的规模超出了一个人、一个盒子,无聊的事情就是你想要关注的事情,比如稳定的环境、更少的故障模式以及更少的时间投入到基本上是保姆的事情上。这就是 H100 的设计目的。

如果读完本节后您仍然感到困惑,那么下一步就不是继续阅读了。它着眼于您的堆栈在实践中的表现,包括驱动程序摩擦和多用户工作负载。

软件和操作:驱动程序、稳定性、多用户和支持

这是大多数基准图表都会跳过的部分,但它是日常生活的很大一部分。

RTX 4090 很受欢迎,因为它对于许多 AI 工作流程来说都很方便且快速。代价是,一旦您的用例增长,您更有可能遇到内存上限和扩展模式的边缘,而这些模式并不是为共享、多租户环境构建的。

H100专为集群打造。 MIG 对于平台团队来说意义重大,因为它可以让您将一个 GPU 分割成独立的片,从而减少“吵闹的邻居”问题并使容量规划变得更加容易。 NVIDIA 的官方 H100 规格列出了最多 7 个 MIG 实例,具体取决于外形规格。

如果你的工作量是个人的、本地的,那么你可以在4090这边幸福地生活很长一段时间。如果您的工作负载是多用户且面向客户,H100 是更安全的方法。

那么,总的来说,谁应该买什么?

您应该为您的工作负载选择哪一个

为了 H100 与 RTX 4090,正确的选择最终会消除你最大的障碍。

本地法学硕士构建者(独立开发者/学生)

如果您主要使用 7B–13B 范围、运行量化推理、修补 RAG 或处理 SDXL,请选择 RTX 4090。一旦你花在记忆上的时间多于构建你打算构建的东西,就可以升级。

初创公司 ML 工程师(交付 MVP)

如果您的 MVP 是流量适中的单一型号并且佩戴舒适,那么 4090 是一个不错的开始。如果您需要峰值下的稳定延迟、更高的并发性或每台主机多个工作负载,H100 是更平静的路径。

应用研究员(大量实验)

如果您经常被迫做出妥协,例如削减批量大小或进行精确体操,H100 可以为您带来更干净的实验和更少的死角。

生产/平台团队(多租户服务)

H100 是一个简单的选择,主要是因为 MIG 和更高的净空使容量规划变得更容易,并且在出现峰值时基本上可以减少爆炸半径。

如果您仍然不想投入硬件资金,那么租赁是最好的下一步。

实用的中间路径:先租用 GPU,然后再使用

最干净的安顿方式 H100 与 RTX 4090 是运行 你的 模型, 你的 提示,以及 你的 两类硬件上的上下文长度,然后比较负载下的令牌/秒和尾延迟。

这正是我们建造的原因 云智GPU VPS,因为您可以在一分钟内获得一个 GPU 盒子,以完全 root 的方式安装您的堆栈,并停止根据其他人的基准进行猜测。

以下是您通过我们的 GPU VPS 计划获得的服务:

- 专用 NVIDIA GPU (包括 RTX 4090 和 A100 级选项),因此您的结果不会因嘈杂的邻居而漂移。

- 高达 40 Gbps 网络 在所有 GPU 计划上,这对于数据集拉取、多节点工作流程和快速移动工件来说非常重要。

- NVMe SSD存储,加上 DDR5内存 以及所有层上的高频 CPU 选项,因此盒子的其余部分不会拖累 GPU。

- DDoS 防护 和一个 99.95% 正常运行时间,这样长久的工作就不会被随机的互联网噪音破坏。

- 按小时计费 (对于短基准冲刺来说很方便)和 14 天退款保证 用于低风险测试。

首先在 RTX 4090 计划上运行相同的基准检查清单,然后在推送更大的上下文、更高的并发性或更大的模型时在 A100 级计划上重复。之后,选择 H100 与 RTX 4090 通常从您自己的日志中可以明显看出。

基准清单:30 分钟内运行您自己的基准清单

如果您想要一个可以捍卫的决定,请从您计划发送的确切堆栈中取出四个数字:

- 令牌/秒 在你的目标上下文长度

- p95潜伏期 按照您预期的并发量

- 显存余量 在最热的阶段

- 每次完成运行的成本 从开始到神器

vLLM 的最小冒烟测试如下所示:

pip install vllm transformers accelerate

python -m vllm.entrypoints.api_server \

--model meta-llama/Llama-3-8B-Instruct \

--dtype float16 \

--max-model-len 8192如果您想清楚地了解自己真正租的是什么,我们的帖子 什么是 GPU VPS? 列出了专用 GPU 访问、vGPU 共享之间的区别以及选择计划之前要检查的内容。