随着对本地 LLM 需求的不断增加,许多用户在选择时往往感到困惑,但实际使用起来并不像想象那么简单。由于功耗相对较高,有些甚至更高,许多人更愿意敬而远之,更不用说初学者可能要花许多小时盯着终端了。

不过,有两个主流选择能让一切变得简单。Ollama 和 LM Studio 是运行本地 LLM 最常用的两个平台,性能领先。但在两者之间做选择可能很困难,因为它们分别针对不同的工作流设计。废话不多说,我们来看看 Ollama 和 LM Studio 的对比。

Ollama:给专家用的技术工具

作为本地 LLM 运行器,Ollama 是个不错的选择,拥有众多功能。不仅高度可配置,而且可以免费使用,因为它是由社区支持的开源平台。

虽然 Ollama 简化了运行本地 LLM 的流程,但它采用 CLI 优先(命令行界面)的设计,所以仍需一定的终端知识。CLI 优先对开发工作流来说是个巨大优势,因为它足够简洁。虽然使用 CLI 不是件容易事,但比起自己运行本地 LLM,花费的时间少得多。

Ollama 把你的个人电脑变成一个本地迷你服务器,配备 HTTP API,让你的应用和脚本能访问它的众多模型,这意味着它对提示的响应方式和在线 LLM 一样,而无需把你的数据发送到云端。更不用说它的 API 让用户能集成 Ollama 并将其接入网站和聊天机器人。

由于采用 CLI 设计,Ollama 也相当轻量,资源占用少,性能表现专注。不过这不是说你可以在低配电脑上运行它,但对想要榨干硬件性能并把资源全部用于 LLM 模型的用户来说,前景还是不错的。

总的来说,你现在可能已经猜到 Ollama 是专为开发工作流设计的,你说得对。凭借易于集成、本地隐私和 API 优先的设计,如果你更倾向于开发者思维,选它肯定没错。

在 Ollama 与 LM Studio 的比较中,Ollama 因其 API 优先开发可能更胜一筹。如果 CLI 运行时对你来说太陌生,继续往下看,我们会介绍一个更轻量、注重易用性的选择。

LM Studio:用户友好的选择

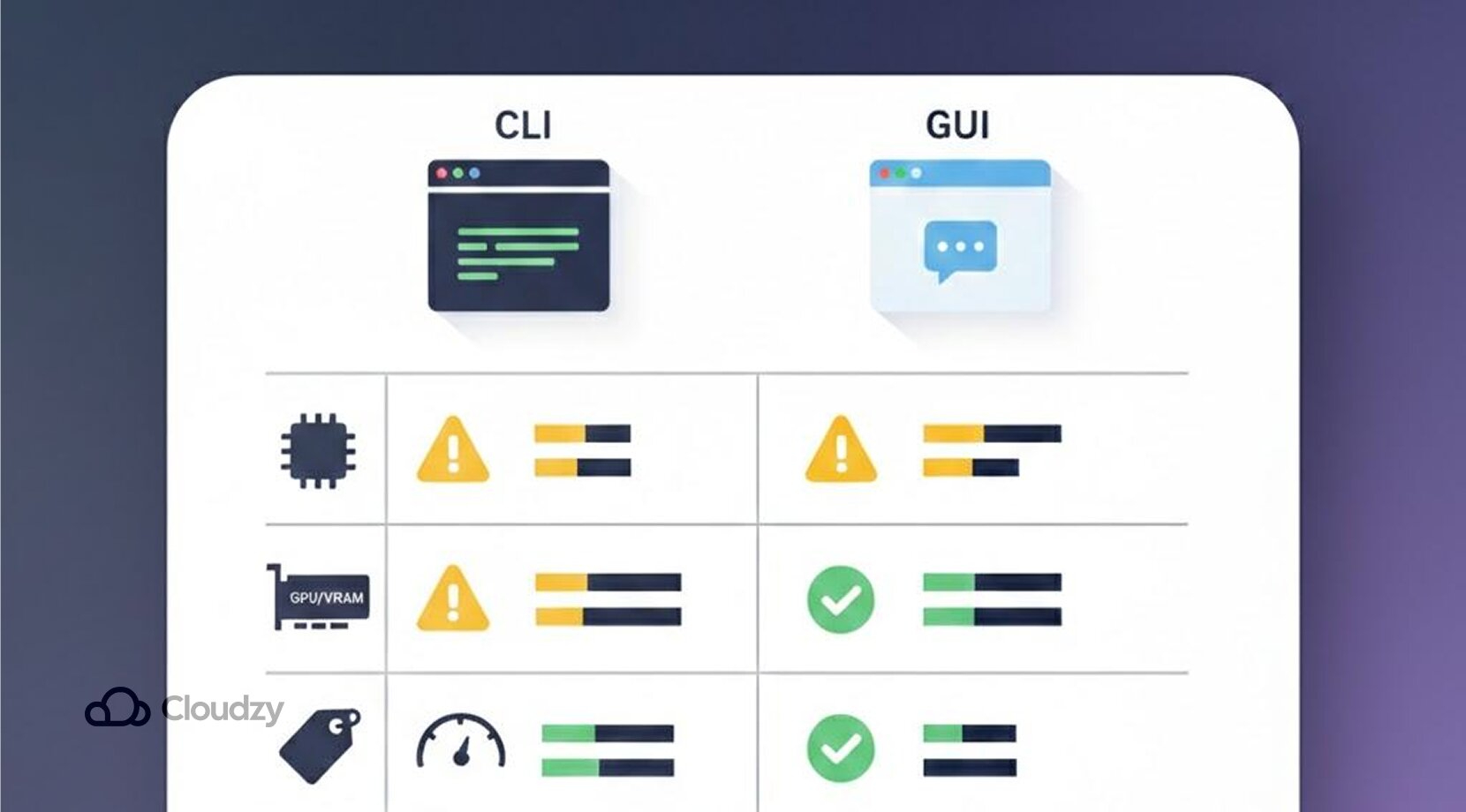

LM Studio 与 Ollama 形成鲜明对比。它不是一个完整的 CLI 界面,不需要任何终端命令就能运行,因为它配备了 GUI(图形用户界面),看起来就像任何其他桌面应用。对一些新手来说,Ollama 与 LM Studio 的比较归结为 CLI 的简洁性与 GUI 的易用性。

LM Studio 消除技术壁垒的方式大大简化了用户体验。与其用命令行添加和运行模型,你可以直接使用菜单并在类似聊天的输入框中输入。看起来任何人都能用 LM Studio 玩本地 LLM,因为它用起来就像 ChatGPT 一样顺畅。

它甚至内置了一个整洁的模型浏览器,用户可以在其中发现和部署任何喜欢的模型,从轻量级模型到重型模型应有尽有。而且这个浏览器还提供模型的简短描述和推荐用途,允许用户一键下载模型。

虽然大多数模型可以免费下载,但有些可能包含额外的许可证和使用权限。对于某些工作流,LM Studio 也可以提供本地服务器模式以便集成,但它主要是为初学者设计的易用桌面界面。不过,我们先把 Ollama 和 LM Studio 放在一起对比看看。

值得关注的对比:Ollama vs LM Studio

在继续之前,有一个关键问题需要说明:「Ollama vs LM Studio」这个说法可能暗示其中一个客观上更好,但实际并非如此,因为它们针对不同的用户。下面是 Ollama vs LM Studio 的简要对比。

| 功能 | Ollama | LM Studio |

| 易用性 | 上手难度高,需要终端知识 | 对初学者友好,需要鼠标点来点去 |

| 模型支持 | 包含许多流行的开源权重模型,gpt-oss、gemma 3、qwen 3 | 与 Ollama 相同。gpt-oss、gemma3、qwen3 |

| 自定义 | 高度可定制,通过 API 轻松集成 | 自由度有限,通过开关和滑块调整常见设置 |

| 硬件要求 | 取决于具体情况;没有足够硬件的情况下,大型模型会运行缓慢 | 同样取决于模型大小和你自己的硬件配置 |

| 隐私 | 默认隐私保护很强,无需额外的外部 API | 聊天内容保持本地,但应用仍会连接服务器用于更新和模型搜索/下载。 |

| 离线使用 | 下载模型后完全支持离线运行 | 下载模型后离线表现也很出色 |

| 可用平台 | Linux、Windows、macOS | Linux、Windows、macOS |

- 高级模型硬件挑战: 几乎每个人在可能的情况下都会选择更大、更强大的模型。但在大多数笔记本电脑上运行它们可能会导致严重问题,因为更大的模型需要更多的 RAM 和 VRAM。这会导致响应缓慢、上下文长度受限,或模型根本无法加载。

- 电池问题: 在本地运行 LLM 在高负载下会快速消耗电池。这会导致电池续航时间减少,更不用说风扇和散热器发出的令人烦恼的噪音了。

Ollama vs LM Studio:拉取模型

Ollama vs LM Studio 的另一个区别在于它们拉取模型的方式不同。如前所述,Ollama 无法一键安装本地 LLM。相反,你需要使用它的原生终端框和命令行来完成。不过这些命令很容易理解。

下面是在 Ollama 上运行模型的快速方法。

- 通过输入 ollama pull gpt-oss 或任何其他你喜欢的模型来拉取你最喜爱的模型(别忘了加上标签,你可以从库中选择)。

例如:ollama pull gpt-oss:20b - 然后你可以用命令 ollama run gpt-oss 来运行该模型

- 你也可以添加其他编码工具。例如,你可以通过 ollama launch claude 来添加 Claude。

如果你不习惯使用终端和命令行,不妨试试 LM Studio。它不需要你在终端中输入任何东西就能开始工作并拉取模型。只需滚动到内置的模型下载器,然后用 Llama 或 Gemma 这样的关键词搜索 LLMs。

或者,你可以在搜索栏中输入完整的 Hugging Face URLs。

你甚至可以从任何地方按下某个键来访问发现标签页。 ⌘ + 2 在 Mac 上,或 Ctrl + 2 在 Windows / Linux 上。

Ollama:速度更快

有时候速度对用户和企业来说是最重要的。事实证明,在速度方面比较 Ollama 和 LM Studio,Ollama 更快,但这在不同的配置和硬件设置中可能会有所不同。

在 r/ollama subreddit 中,一位 Reddit 用户的情况是这样的,Ollama 的处理速度比 LM Studio 更快。

这不是凭空捏造的说法,因为这位用户通过运行 qwen2.5:1.5b 五次来测试 Ollama 和 LM Studio,并计算了平均每秒生成的 token 数。

Ollama 对比 LM Studio:性能和硬件需求

性能方面,Ollama 对比 LM Studio 更多取决于硬件而不是用户界面。第一次体验本地 LLMs 与我们习惯的云端 LLMs 有很大不同。拥有一个只属于自己的 LLM 感觉很棒,直到你遇到性能瓶颈。

考虑到过去几年 RAM 和 VRAM 的价格飙升,要给你的机器配置足够的电源来运行大型 LLMs 相当困难。

热门模型通常需要 24-64GB 的 RAM

是的,你没听错。硬件需求与 Ollama 和 LM Studio 孰优孰劣无关。如果你想在运行中型到大型热门模型时获得流畅的体验,不出现卡顿或崩溃,最好的办法是安装 24-64GB 的 RAM。不过在大多数情况下,即使有这么多 RAM,面对更长的上下文和更重的工作负载也会显得不足。

你可以在 8-16GB 的 RAM 上运行较小的模型(通常称为量化模型),但你无法获得与较大模型相同的便利和性能,更不用说还会有一些质量和速度的折衷。不幸的是,RAM 不是唯一的问题,其他硬件组件也必须足够强劲。

强大的 GPUs 是消除挫折的基石

虽然模型可以在 CPUs 上运行,但你的图形处理单元仍然在启用你的模型中起着关键作用。没有快速的 GPU 和充足的 VRAM,你会遇到逐个 token 生成缓慢、长响应延迟长等问题,很快就会变得难以忍受。

别抱太大希望,因为即使是强大的 RTX 5070Ti 或 RTX 5080 也不足以进行严肃的深度学习。那是因为对于某些 60k+ 上下文的设置,Ollama 本身提到需要约 23GB 的 VRAM,这远超过这些 GPUs 通常提供的 16GB VRAM。

升级到更高的性能范围也贵得离谱。如果价格不是问题,运行本地 LLMs 时仍有一些 GPU选项 因素需要考虑。

到现在为止,你可能对如何组装一台足够强大来运行大型本地 LLM 模型的机器感到困惑。这是许多人的转折点,他们开始考虑不同的解决方案。

一种爱好者们考虑的替代方案是使用配置强大、预装硬件的虚拟机。例如,使用 VPS(虚拟专用服务器)是一个很好的办法,可以将你的家用笔记本电脑或其他个人硬件连接到你选择的专用服务器,所有前置条件都已预先配置好。

如果您认为 VPS 是一个不错的解决方案,我们强烈推荐 Cloudzy 的 Ollama VPS,您可以在一个干净的终端环境中工作。它预装了 Ollama,您可以立即开始使用本地 LLM,完全私密。价格实惠,覆盖 12 个地区,99.95% 的正常运行时间和 24/7 全天候支持。资源充足,提供专用 VCPU、DDR5 内存和 NVMe 存储,链接速度高达 40 Gbps。

Ollama vs LM Studio:谁需要哪个

如前所述,两个平台的功能都很强大,没有绝对的优劣之分,但这里有个关键点。每个平台适合不同的工作流,所以取决于您的具体需求。

选择 Ollama 用于自动化和开发

使用 Ollama 的目的不只是与模型聊天,而是将其作为另一个项目的组件。Ollama 适合:

- 开发者 构建聊天机器人、编程助手和其他需要深度学习的产品

- 涉及大量自动化的工作流 例如定时运行的报告总结脚本或草稿生成

- 团队 需要在任何环境中保持一致模型版本的用户

- 任何寻求 API 优先方案的用户 这样其他工具可以定期连接到模型

总的来说,如果您希望模型能够为您的应用提供可靠的支持,Ollama 可能是您的最佳选择。

LM Studio:接触本地 LLM 的更简单选择

如果您想探索本地 AI 设置而不想面对技术复杂性,LM Studio 无疑是更好的选择。

总体而言,LM Studio 更适合:

- 初学者 害怕终端和命令行的用户

- 作家、创意工作者或学生 需要简单的聊天式 AI 助手的用户

- 想要尝试不同选项的人 希望快速比较各种模型以找到自己的定位

- 刚开始学习提示词的任何人 以及希望调整设置而不用输入代码的用户

简单来说,如果您想下载并立即开始使用本地 LLM,LM Studio 能满足您的需求。

Ollama vs LM Studio: 最终推荐

撇开 Ollama 和 LM Studio 之间竞争的炒作不谈,真正重要的是你的日常使用体验,这取决于你的工作流和硬件限制。

Ollama 的基本情况是:

- 灵活且以开发者为中心

LM Studio的特点是:

- 为初学者提供专用 GUI

两者都需要高性能且昂贵的硬件才能平稳运行。大多数人没有条件在本地独立运行大型 LLM。因此, 如果你想运行高级模型而不给硬件带来压力,可以尝试在 专用 GPU VPS以下是 关于 Ollama vs LM Studio 的常见问题。