如果你打算买一块新的 GPU 来解决内存溢出错误,纠结 5070 Ti 和 5080 哪个更好就走错方向了。这两块卡都配 16 GB 的 VRAM,在深度学习中这个容量限制会比大多数人预期来得更快。

5080 速度更快,但很难让你运行更大规模的模型。实际上,你往往还是要缩小批处理大小、截断上下文长度,或者卸载到系统 RAM 才能保证任务完成。

这就是为什么这篇文章真实地对比了 5070 Ti 和 5080 在深度学习中的表现,并提供了多种方案选择。无论你是想训练、微调还是部署模型,都能找到适合的方案,而不受 VRAM 限制的困扰。

如果只看一部分,就看配置参数和「容量与速度」这两节——它们能帮你避开最常见的选购误区。

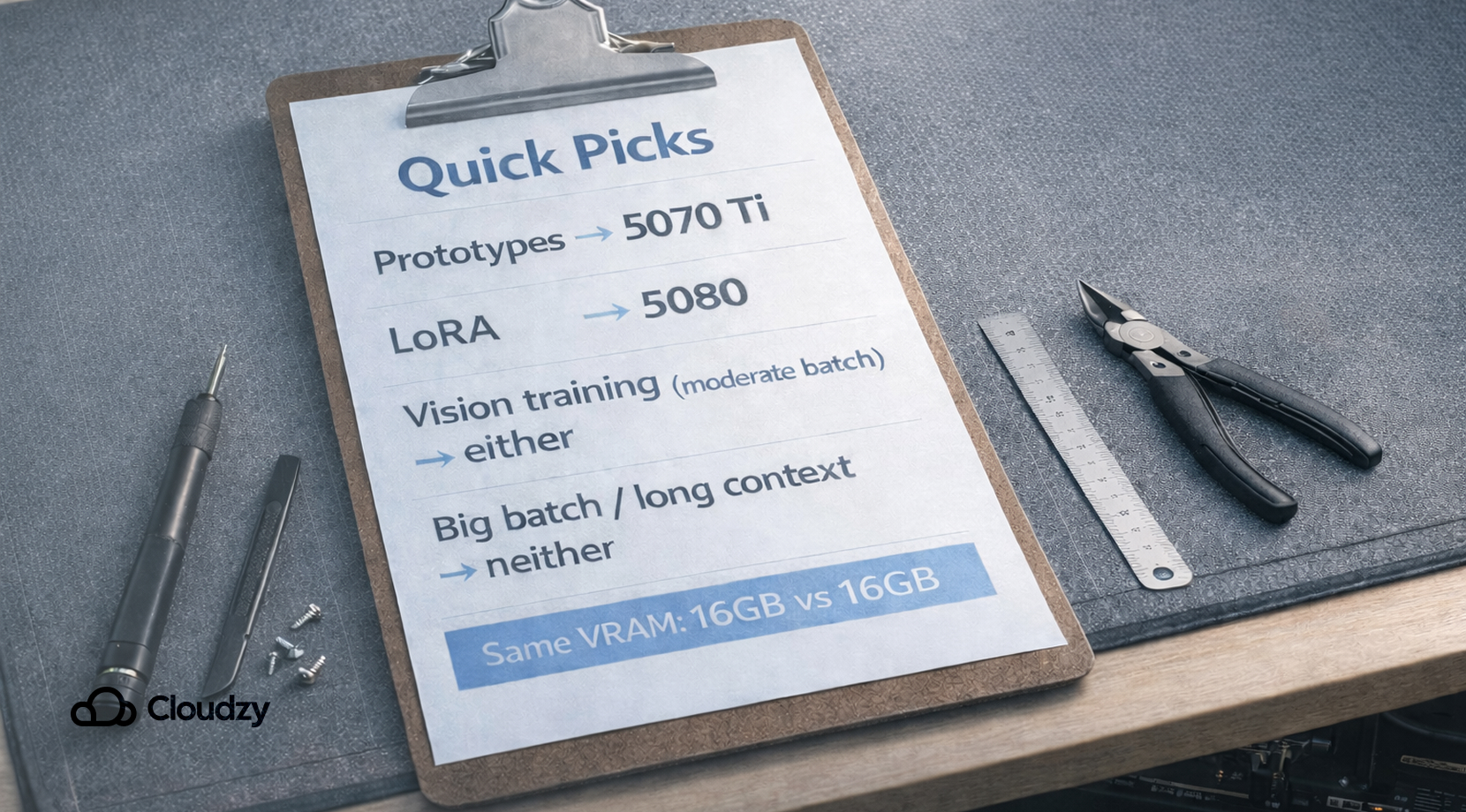

根据你的工作类型推荐

很少有人随意购买 GPU。我们发现客户通常有四种典型的购买思路,而 5070 Ti 和 5080 对每一类都有不同的吸引力。

本地 LLM 开发者

你在运行notebook、调整量化设置,更在乎「能跑」而不是完美的吞吐量。对你来说,5070 Ti还是5080通常由预算决定,因为这两块卡在小模型和量化推理上都够用,但一旦你增加context长度或batch大小,都会碰到同样的VRAM瓶颈。

研究生训练视觉模型

你需要可重复的实验,而不是无休止地重试。隐藏成本不在于显卡本身,而在于当数据加载器、数据增强和模型争夺内存导致训练在第3个epoch失败时浪费的时间。

初创工程师们正在部署推理模型

你在乎尾部延迟和并发性能。单用户演示在16 GB内存上看起来很流畅,但生产流量一上来,KV缓存压力就会像慢泄漏一样吃掉你的VRAM。在推理服务中,5070 Ti和5080之间的差异可能不是重点,如果你真正的瓶颈是批处理能力和长序列处理容量。

既是创作者,也做机器学习的开发者

你在创意软件和 ML 工具之间来回切换,最烦的就是重启、驱动报错,还有"先关掉 Chrome 再跑训练"这种破事。对你来说,讨论 5070 Ti 还是 5080 只有在 GPU 融入顺畅工作流的前提下才有意义,而不是一开多任务就崩的脆弱工作站。

考虑到这些情况,让我们具体看看硬件问题,以及为什么在关键领域中限制因素是相同的。

深度学习的关键配置需求

要快速理解 5070 Ti 和 5080 的区别,最好忽略营销数据,直接看显存配置。

如果你想看完整的规格清单,这里有一份详细表格,重点展示对训练和推理性能影响最大的指标。(主频和显示输出很吸眼球,但决定不了你的任务能否跑起来。)

| 规格(桌面版) | RTX 5070 Ti | RTX 5080 | 为什么会在下载中显示 |

| VRAM | 16 GB | 16 GB | 容量是权重、激活和 KV 缓存的硬限制 |

| 内存类型 | GDDR7 | GDDR7 | 表现相似,带宽有帮助,但容量才是关键 |

| 内存总线 | 256位 | 256位 | 限制总带宽;提升吞吐量,不影响模型大小 |

| CUDA 核心 | 8,960 | 10,752 | 更多算力提升 tokens/秒,不是「能否加载它」 |

| 典型主板功耗 | 300瓦 | 360瓦 | 更多散热和电源余量,无需额外的 VRAM |

官方规格信息: RTX 5080, RTX 5070 系列

简单来说,5080 是性能更强的卡,5070 Ti 是更便宜的选择。对于深度学习,只有当你的工作量已经能装进显存后,性能差异才会明显体现出来。

接下来,我们看看为什么 VRAM 消耗得这么快,即使是在纸面上看起来负载很轻的设置上也是如此。

为什么 VRAM 在深度学习中供不应求

很多从游戏开发转过来的人会把 VRAM 想象成纹理池。但在深度学习中,它更像一个狭窄的厨房操作台。你需要的不仅是放食材的空间,还要有地方同时切菜、烹饪和装盘。

VRAM 在运行期间通常包含以下内容:

- 模型权重:你加载的参数,有时是 FP16/BF16 格式,有时是量化后的格式。

- 激活:用于反向传播的中间张量会被保存下来,这通常是训练过程中的主要内存消耗。

- 梯度与优化器状态:训练开销可能会增加多倍的内存需求。

- KV缓存:推理开销随着上下文长度和并发数增加而增长。

这就像争论5070 Ti和5080的性能差别,但你的拖车超重了。再强的发动机也没用,因为拖钩承载能力才是真正的瓶颈。

我们在自己的测试中常用的一个快速验证方法,是同时记录 PyTorch 中已分配内存和已预留内存的数值。PyTorch 的 CUDA 内存说明文档解释了缓存分配器的工作原理,以及为什么在张量释放之后,nvidia-smi 等工具中的内存仍可能显示为"占用"状态。

这就回到了我们讨论的核心问题:16 GB 显存下深度学习模型失败,通常不是因为速度慢,而是因为在最关键的时刻突然爆显存。

首次对比:哪些工作负载让 RTX 5070 Ti 和 RTX 5080 有明显差异

以下是通常会首先在 RTX 5070 Ti 和 RTX 5080 上触及内存限制的深度学习模式。

LLM 支持长提示词和真正的并发处理

单个 2K token 提示词看起来没问题。加入更长的上下文、加入批处理、再加第二个用户,KV 缓存就开始急速增长。这时 5070 Ti 和 5080 的差异就消失了,你要么限制最大上下文长度,要么降低批处理大小来维持运行。

简单的检查方法:

- 用你真实的最大上下文和批处理能力运行你的服务器。

- 持续监控 VRAM,不只是在启动时查看。

- 找出延迟激增的位置,然后在同一时间窗口检查内存使用情况。

如果你需要一套可靠的监控方案,又不想把它变成一个额外的项目,可以查看我们的指南 GPU 监控软件 涵盖在实际运行中表现良好的实用 CLI 日志记录模式。

LoRA 或 QLoRA 微调

很多人说「LoRA 在 16 GB 显存上能跑」,这没错。但陷阱在于你以为管道的其他部分不消耗显存。分词缓冲、数据加载器、混合精度缩放、验证步骤——这些加起来会很快吃满你的显存。

实际上,这里的瓶颈不是计算能力,而是利润空间。如果你没有多余的 VRAM,就得一直盯着任务跑。

高分辨率输入的视觉模型训练

图像模型有个隐藏的失败模式:分辨率稍微提高,或者多加一个数据增强,就会让你从稳定训练直接跳到 OOM。在 RTX 5070 Ti 和 RTX 5080 上,这表现为批处理大小崩溃到 1,然后梯度累积把你的训练变成了慢动作循环。

多模态在单个 GPU 上运行

文本编码器 + 图像编码器 + 融合层可以工作,但一旦增加序列长度或使用更大的视觉主干网络,内存占用会急剧上升。

我的 GPU 没问题,我的台式机有问题

这个最让人感同身受。你开始训练模型,浏览器、IDE 和其他运行中的应用突然占用了 VRAM,你那个「稳定」的配置就散架了。 论坛上的人 抱怨关闭所有程序、禁用覆盖层,但同一个昨天还能运行的模型今天仍然因内存溢出而崩溃。

这种模式不断出现在 5070 Ti vs 5080 讨论,两款显卡都面临相同的容量瓶颈,情况如出一辙。如果这些问题你也遇到过,下一步自然要问:怎么突破这个限制?

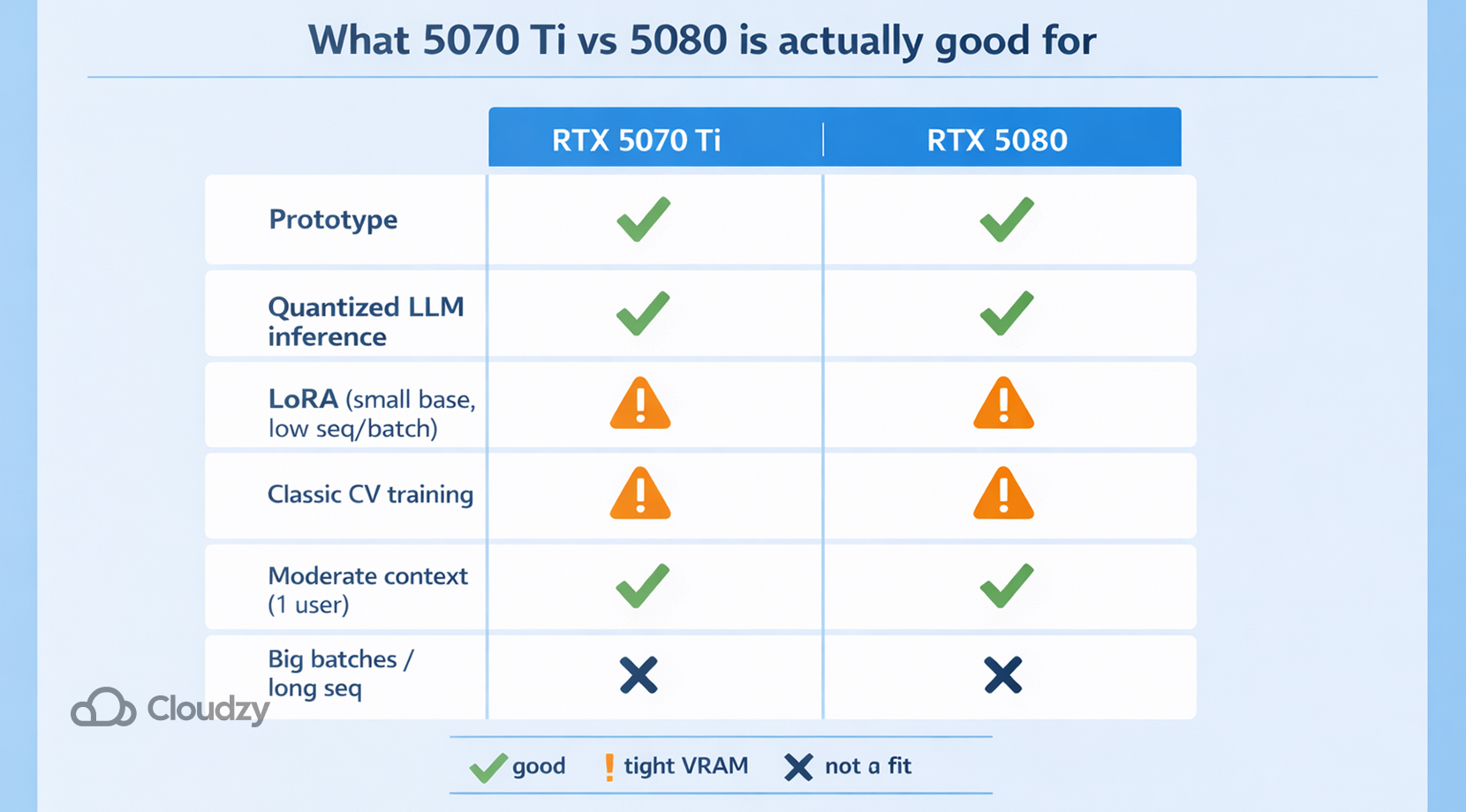

5070 Ti 与 5080 对比:Actually 与 Good 的差异

在 ML 圈子里,16 GB 经常被吐槽,但它并非没有用处。只是应用面比较窄。

5070 Ti vs 5080 都可以完全胜任:

- 原型工作:小型实验、快速消融测试和完整性检查。

- 量化 LLM 推理:参数量较小的模型,上下文窗口中等,支持单个用户。

- 在较小的基础模型上使用 LoRA:只要你控制好序列长度和批次大小就行。

- 经典视觉训练:中等规模的图像,中等规模的模型架构,更多耐心。

关键是,只要你的任务不超过显存限制,5080 通常会比 5070 Ti 响应更快,你还能获得更强的计算性能。

但一旦你开始做真正的深度学习,就会碰上显存不足的问题。所以我们来聊聊两种显卡都适用的解决方案。

我们如何在不牺牲训练体验的前提下充分利用有限的 VRAM 资源

这些技巧没有什么神奇的。就是一套方法,让 5070 Ti 和 5080 继续保持价值更久。

从测量开始

在调整超参数之前,获取每一步的 VRAM 峰值数。在 PyTorch 中, max_memory_allocated() 和 max_memory_reserved() 是快速查看你的运行过程真正在做什么的方式。

这样你就能回答以下问题:

- 主要成本是模型本身,还是激活费用?

- VRAM 在验证期间会出现峰值吗?

- 随着时间推移,碎片化在不断增加吗?

有了基准线,其余的就不再那么随意了。

在可能的地方减少内存占用

我们遵循的简单操作顺序:

- 逐步减小批处理大小,直到能够运行。

- 添加梯度累积来恢复有效批大小。

- 如果你的技术栈支持,启用混合精度(BF16/FP16)。

- 如果激活值占用大量内存,可以启用梯度检查点。

- 只有这样,才开始调整模型大小。

把上下文长度当作一项预算来管理

对于 Transformer,上下文长度是最容易出问题的地方。它影响注意力计算,对于推理阶段还会影响 KV 缓存大小。在 RTX 5070 Ti 和 RTX 5080 上,一旦超过几千个 token,你会立即感受到这一点:VRAM 快速飙升,吞吐量下降,你只能减小批次大小来维持性能。

推荐的方法:

- 选择一个默认最大上下文大小,确保有足够的运行余量。

- 为"长上下文"创建第二个配置文件,降低批处理量。

- 调试时不要混用这两个。

别把 PyTorch 缓存跟真实数据泄露搞混了

很多'内存泄漏'的报告,其实是分配器的正常行为。PyTorch 的文档提到,缓存分配器在张量释放后仍可能保留内存,而且 empty_cache() 主要是将未使用的缓存块释放给其他应用,而不是释放给 PyTorch 本身。

这很重要,因为 5070 Ti 和 5080 用户经常被虚假的内存泄漏信息分散注意力,而真正导致泄漏的源头是批处理大小、序列长度和激活内存。

这些调整让内存限制变得更实用,但改变不了根本现实。如果你的项目需要更大的模型、更长的上下文或更高的并发,你需要更多的 VRAM。

RTX 5070 Ti 还是 RTX 5080:你需要的是性能还是速度

可以这样理解:速度是你能开多快,容量是你能载多少乘客。深度学习两者都关心,但容量决定了你能否首先离开停车场。

5080 在很多工作负载中的吞吐量确实超过 5070 Ti。但在 5070 Ti vs 5080 的对比中,"我能加载它并运行它吗" 这个问题的答案不会改变,因为两者都有各自的限制。

升级后很多人最终失望,就是因为这个。他们在小规模测试中感受到速度提升,转身用实际工作负载一跑就撞墙了。只不过这次撞墙晚了30秒。

如果你在为深度学习项目选型,先确定自己属于哪一类会很有帮助:

- 速度受限:你已经能做到了,只是想跑得更快。

- 容量受限:你的需求不标准,你得花时间去改造服务。

研究 RTX 5070 Ti 和 RTX 5080 用于深度学习的大多数人,其实都属于第二类,只是还没意识到。

现在来说说通常能节省最多时间的方案:把"繁重的工作"交给更强大的 GPU 来处理,这样就不用围绕一台新的本地机器重新调整整个工作流程。

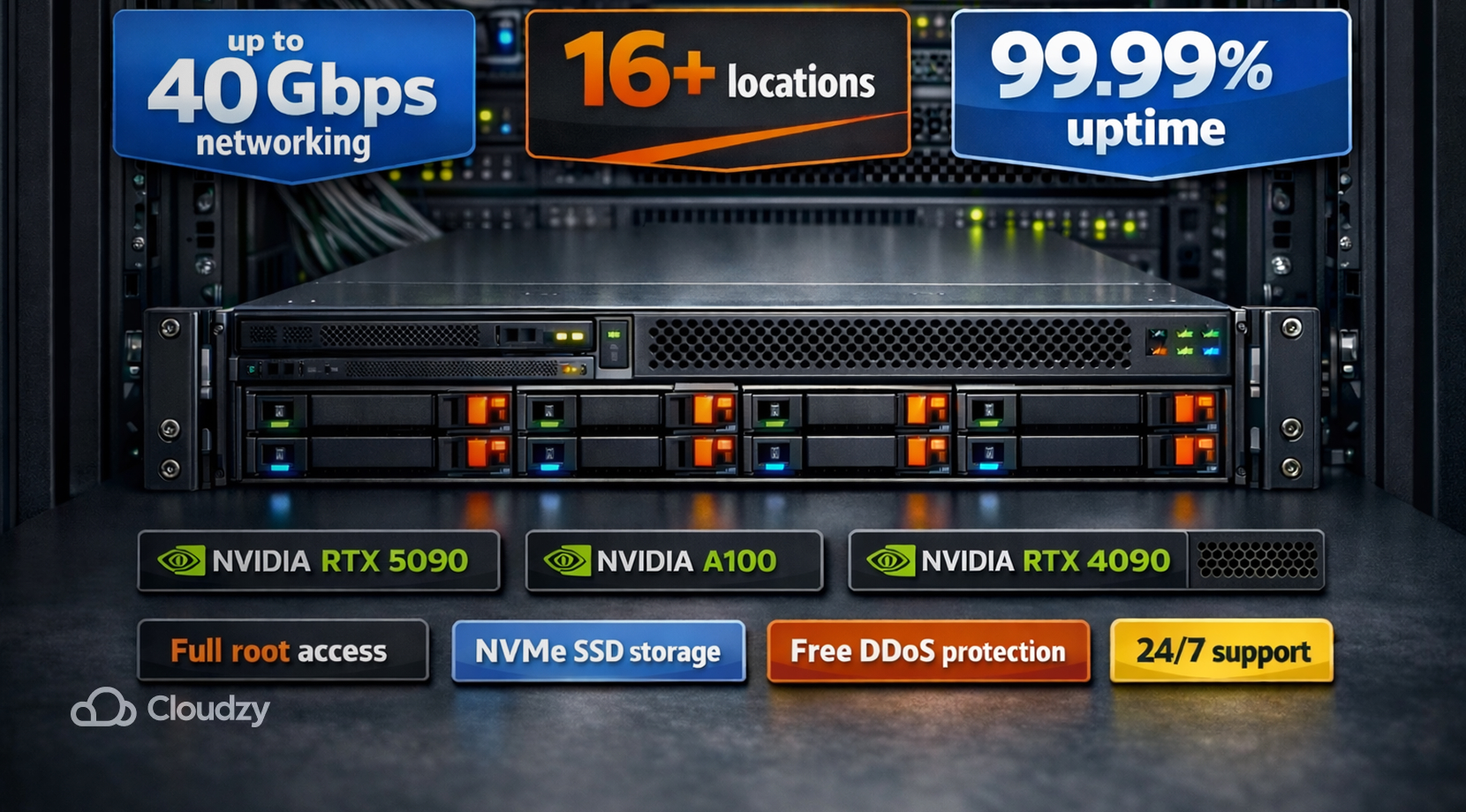

经济高效的解决方案:使用 GPU VPS 处理大规模任务

我们基础设施团队最常看到的情况是,开发者在本地做原型验证,然后很快就遇到瓶颈:RTX 5070 Ti 和 RTX 5080 的差异不再重要,因为他们的工作根本装不进去。

这时候你需要一个更大的 VRAM 池来训练模型,也需要它来进行逼真的服务测试。正是在这一点上 Cloudzy GPU VPS 完美契合。

我们的 GPU VPS 方案包含 NVIDIA 选项,如 RTX 5090、A100 和 RTX 4090,同时提供完全 root 权限、NVMe SSD 存储、高达 40 Gbps 网络、12 个地理位置、免费 DDoS 防护、全天候技术支持和 99.95% 正常运行时间保证。

但这对你有什么帮助呢?无论是 5070 Ti 还是 5080,或任何同级别的 GPU?来看看:

- 您可以在配备更多 VRAM 的硬件上运行真实模型和提示配置文件,这样决策就能从您自己的日志中清晰地显现出来。

- 本地保留 GPU 用于开发和快速测试,需要处理重型任务时再租用高性能卡。

如果你需要快速回顾一下 GPU VPS 究竟是什么,以及专有 GPU 和共享访问之间的区别,我们的初学者指南用简洁明了的语言为你解答。

如果你还不确定你的工作负载是否需要 GPU,我们的 GPU 与 CPU VPS 对比后,你会清楚地了解到训练、推理、数据库和 Web 应用这类真实任务分别需要什么样的硬件。

基础设施搞定后,最后一步是选择不会浪费你时间的工作流。

简单流程,帮你快速确定所需配置

很多做 ML 的开发者陷入了一个误区:要么买更贵的消费级卡,要么就得将就。实际上,5070 Ti 和 5080 完全可以用在正常的工作流中,只要你把它当作本地开发工具,而不是生产环境的全部。

以下是我们看到效果不错的工作流程:

- 用你的 16 GB GPU 进行代码编写、调试和小型实验。

- 为远程运行准备好一个「big GPU」环境模板。

- 将需要充足资源的训练和服务测试迁移到 GPU VPS。

- 监控运行过程并保存日志,确保结果可以重复。

如果你想深入了解如何为机器学习工作选择合适的 GPU 规格,可以查看我们的 用于机器学习的最佳 GPUs 是个不错的选择。

说白了,5070 Ti vs 5080 是本地计算的选择,但深度学习规模是基础设施的选择。既然提到规模,如果你想看看更高端的显卡如何改变实际的 AI 表现,我们的 H100 vs RTX 4090 基准测试 这个对比很有用,因为它始终围绕同一个主题:VRAM 先保证匹配,再考虑速度。